Inteligencia artificial

StyleTTS 2: Síntesis de texto a voz de nivel humano con grandes modelos de lenguaje de habla

Debido a un aumento en los enfoques de síntesis de habla natural y sintética, uno de los principales logros que la industria de la IA ha logrado en los últimos años es sintetizar efectivamente marcos de texto a voz con aplicaciones potenciales en diferentes industrias, incluyendo audiolibros, asistentes virtuales, narraciones de voz y más, con algunos modos de estado del arte que entregan rendimiento y eficiencia de nivel humano en una amplia gama de tareas relacionadas con el habla. Sin embargo, a pesar de su fuerte rendimiento, todavía hay espacio para la mejora de las tareas gracias a la habla expresiva y diversa, el requisito de una gran cantidad de datos de entrenamiento para optimizar los marcos de texto a voz de disparo cero, y la robustez para los textos fuera de distribución o OOD, lo que lleva a los desarrolladores a trabajar en un marco de texto a voz más robusto y accesible.

En este artículo, hablaremos sobre StyleTTS-2, un marco de texto a voz robusto e innovador que se basa en los fundamentos del marco StyleTTS, y tiene como objetivo presentar el siguiente paso hacia los sistemas de texto a voz de estado del arte. El marco StyleTTS2 modela los estilos de habla como variables aleatorias latentes, y utiliza un modelo de difusión probabilístico para muestrear estos estilos de habla o variables aleatorias, lo que permite al marco StyleTTS2 sintetizar habla realista de manera efectiva sin utilizar entradas de audio de referencia. Debido al enfoque, el marco StyleTTS2 es capaz de entregar mejores resultados y muestra una alta eficiencia en comparación con los marcos de texto a voz de estado del arte actuales, pero también es capaz de aprovechar la síntesis de habla diversa ofrecida por los marcos de modelo de difusión. Discutiremos el marco StyleTTS2 en mayor detalle, y hablaremos sobre su arquitectura y metodología, mientras también echamos un vistazo a los resultados logrados por el marco. Así que comencemos.

StyleTTS2 para la síntesis de texto a voz: Una introducción

StyleTTS2 es un modelo de síntesis de texto a voz innovador que da el siguiente paso hacia la construcción de marcos TTS de nivel humano, y se basa en StyleTTS, un modelo generativo de texto a habla basado en estilo. El marco StyleTTS2 modela los estilos de habla como variables aleatorias latentes, y utiliza un modelo de difusión probabilístico para muestrear estos estilos de habla o variables aleatorias, lo que permite al marco StyleTTS2 sintetizar habla realista de manera efectiva sin utilizar entradas de audio de referencia. Modelar los estilos como variables aleatorias latentes es lo que separa al marco StyleTTS2 de su predecesor, el marco StyleTTS, y tiene como objetivo generar el estilo de habla más adecuado para el texto de entrada sin necesidad de una entrada de audio de referencia, y es capaz de lograr difusiones latentes efectivas mientras aprovecha las capacidades de síntesis de habla diversa ofrecidas por los modelos de difusión. Además, el marco StyleTTS2 también emplea un modelo de lenguaje de habla preentrenado grande como discriminadores, como el marco WavLM, y lo combina con su propio enfoque de modelado de duración diferencial novel para entrenar el marco de extremo a extremo, y en última instancia, generar habla con naturalidad mejorada. Gracias al enfoque que sigue, el marco StyleTTS2 supera a los marcos de estado del arte actuales para tareas de generación de habla, y es uno de los marcos más eficientes para el preentrenamiento de modelos de habla a gran escala en un entorno de disparo cero para tareas de adaptación de hablante.

Avanzando, para entregar una síntesis de texto a voz de nivel humano, el marco StyleTTs2 incorpora los conocimientos de trabajos existentes, incluyendo modelos de difusión para la síntesis de habla, y modelos de lenguaje de habla grandes. Los modelos de difusión se utilizan comúnmente para tareas de síntesis de habla gracias a sus capacidades de control de habla de grano fino y capacidades de muestreo de habla diversa. Sin embargo, los modelos de difusión no son tan eficientes como los marcos no iterativos basados en GAN, y una de las principales razones de esto es la necesidad de muestrear representaciones latentes, formas de onda y mel-espectrogramas de manera iterativa hasta la duración objetivo de la habla.

Por otro lado, los trabajos recientes sobre modelos de lenguaje de habla grandes han indicado su capacidad para mejorar la calidad de las tareas de generación de texto a voz, y adaptarse bien al hablante. Los modelos de lenguaje de habla grandes típicamente convierten la entrada de texto en representaciones cuantificadas o continuas derivadas de marcos de lenguaje de habla preentrenados para tareas de reconstrucción de habla. Sin embargo, las características de estos modelos de lenguaje de habla no están optimizadas directamente para la síntesis de habla. En contraste, el marco StyleTTS2 aprovecha los conocimientos ganados por los marcos de lenguaje de habla grandes utilizando un entrenamiento adversarial para sintetizar las características de los modelos de lenguaje de habla sin utilizar mapas de espacio latente, y por lo tanto, aprendiendo un espacio latente optimizado para la síntesis de habla directamente.

StyleTTS2: Arquitectura y Metodología

En su núcleo, StyleTTS2 se basa en su predecesor, el marco StyleTTS, que es un marco de texto a voz no autoregresivo que utiliza un codificador de estilo para derivar un vector de estilo de la entrada de audio de referencia, lo que permite la generación de habla natural y expresiva. El vector de estilo utilizado en el marco StyleTTS se incorpora directamente en el codificador, la duración y los predictores mediante el uso de AdaIN o Normalización de Instancia Adaptativa, lo que permite al modelo StyleTTS generar salidas de habla con prosodia, duración y emociones variables. El marco StyleTTS consiste en 8 modelos en total que se dividen en tres categorías

- Modelos acústicos o sistema de generación de habla con un codificador de estilo, un codificador de texto y un decodificador de habla.

- Un sistema de predicción de texto a voz que utiliza predictores de prosodia y duración.

- Un sistema de utilidad que incluye un alineador de texto, un extractor de pitch y un discriminador para fines de entrenamiento.

Gracias a su enfoque, el marco StyleTTS entrega un rendimiento de estado del arte relacionado con la síntesis de habla controlable y diversa. Sin embargo, este rendimiento tiene sus desventajas, como la degradación de la calidad de la muestra, limitaciones expresivas y dependencia de aplicaciones de habla que obstaculizan en tiempo real.

Mejorando el marco StyleTTS, el modelo StyleTTS2 resulta en tareas de texto a voz expresivas mejoradas con un rendimiento fuera de distribución mejorado, y una calidad de nivel humano alta. El marco StyleTTS2 utiliza un proceso de entrenamiento de extremo a extremo que optimiza los diferentes componentes con entrenamiento adversarial, y síntesis de forma de onda directa de manera conjunta. A diferencia del marco StyleTTS, el marco StyleTTS2 modela el estilo de habla como una variable latente, y lo muestrea a través de modelos de difusión, lo que genera muestras de habla diversa sin utilizar una entrada de audio de referencia. Veamos estos componentes con más detalle.

Entrenamiento de extremo a extremo para interferencia

En el marco StyleTTS2, se utiliza un enfoque de entrenamiento de extremo a extremo para optimizar los diferentes componentes de texto a voz para la interferencia sin tener que depender de componentes fijos. El marco StyleTTS2 logra esto modificando el decodificador para generar la forma de onda directamente a partir del vector de estilo, las curvas de pitch y energía, y las representaciones alineadas. El marco luego elimina la última capa de proyección del decodificador y la reemplaza con un decodificador de forma de onda. El marco StyleTTS2 utiliza dos codificadores: un decodificador basado en HifiGAN para generar la forma de onda directamente, y un decodificador basado en iSTFT para producir fase y magnitud que se convierten en formas de onda para una interferencia y entrenamiento más rápidos.

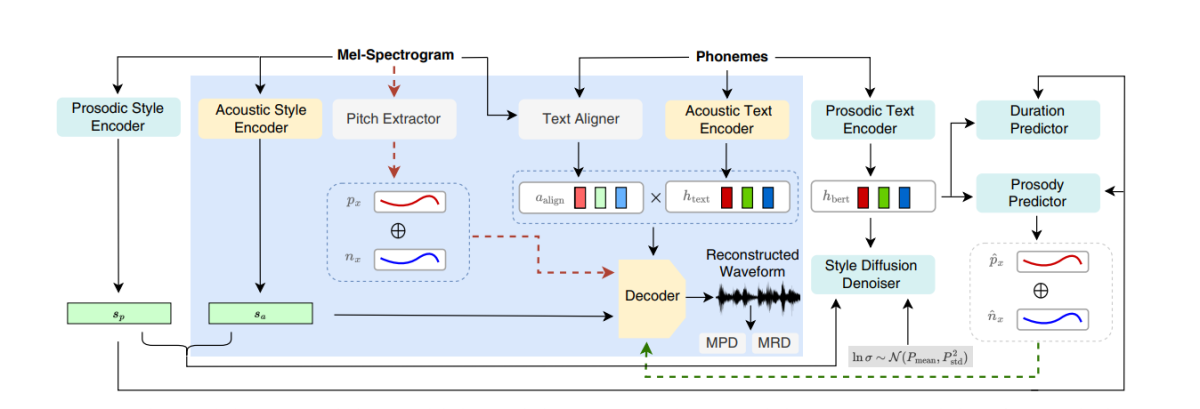

La figura anterior representa los modelos acústicos utilizados para el preentrenamiento y el entrenamiento conjunto. Para reducir el tiempo de entrenamiento, los módulos se optimizan primero en la fase de preentrenamiento, seguida de la optimización de todos los componentes, menos el extractor de pitch, durante el entrenamiento conjunto. La razón por la que el entrenamiento conjunto no optimiza el extractor de pitch es porque se utiliza para proporcionar la verdad de los datos para las curvas de pitch.

La figura anterior representa el entrenamiento adversarial del modelo de lenguaje de habla y la interferencia con el marco WavLM preentrenado pero no preajustado. El proceso difiere del mencionado anteriormente, ya que puede tomar textos de entrada variables, pero acumula los gradientes para actualizar los parámetros en cada lote.

Difusión de estilo

El marco StyleTTS2 tiene como objetivo modelar la habla como una distribución condicional a través de una variable latente que sigue la distribución condicional, y esta variable se llama estilo de habla generalizado, y representa cualquier característica en la muestra de habla más allá del alcance de cualquier contenido fonético, incluyendo estrés léxico, prosodia, tasa de habla y incluso transiciones de formantes.

Discriminadores de modelo de lenguaje de habla

Los modelos de lenguaje de habla son conocidos por sus capacidades generales para codificar información valiosa en una amplia gama de aspectos semánticos y acústicos, y las representaciones de SLM han sido tradicionalmente capaces de imitar percepciones humanas para evaluar la calidad de la habla sintetizada generada. El marco StyleTTS2 utiliza un enfoque de entrenamiento adversarial para aprovechar la capacidad de los codificadores de SLM para realizar tareas generativas, y emplea un marco WavLM de 12 capas como discriminador. Este enfoque permite al marco entrenar en textos fuera de distribución o OOD que pueden ayudar a mejorar el rendimiento. Además, para evitar problemas de sobreajuste, el marco muestrea textos OOD e in-distribución con igual probabilidad.

Modelado de duración diferenciable

Tradicionalmente, se utiliza un predictor de duración en los marcos de texto a voz que produce duraciones de fonemas, pero los métodos de muestreo que estos predictores de duración utilizan a menudo bloquean el flujo de gradientes durante el proceso de entrenamiento de extremo a extremo, y el marco NaturalSpeech emplea un muestreador basado en atención para la conversión de texto a voz de nivel humano. Sin embargo, el marco StyleTTS2 encuentra que este enfoque es inestable durante el entrenamiento adversarial, porque el StyleTTS2 entrena utilizando muestreo diferenciable con entrenamiento adversarial sin la pérdida de términos extras debido a la discrepancia en la longitud debido a las desviaciones. Aunque utilizar un enfoque de guerra de tiempo dinámica suave puede ayudar a mitigar esta discrepancia, utilizarlo no solo es computacionalmente costoso, sino que su estabilidad también es una preocupación cuando se trabaja con objetivos adversarios o tareas de reconstrucción de mel.

Para abordar esta limitación, el marco StyleTTC2 propone utilizar un nuevo enfoque de muestreo no paramétrico sin entrenamiento adicional, y capaz de dar cuenta de longitudes de alineación variables. Para cada fonema, el marco StyleTTC2 modela la alineación como una variable aleatoria, e indica el índice del marco de habla con el que el fonema se alinea.

Entrenamiento y evaluación del modelo

El marco StyleTTC2 se entrena y experimenta en tres conjuntos de datos: VCTK, LibriTTS y LJSpeech. El componente de un solo hablante del marco StyleTTS2 se entrena utilizando el conjunto de datos LJSpeech, que contiene aproximadamente 13,000+ muestras de audio divididas en 12,500 muestras de entrenamiento, 100 muestras de validación y casi 500 muestras de prueba, con un tiempo de ejecución total de casi 24 horas. El componente de múltiples hablantes del marco se entrena en el conjunto de datos VCTK, que consiste en más de 44,000 clips de audio con más de 100 hablantes nativos individuales con acentos variables, y se divide en 43,500 muestras de entrenamiento, 100 muestras de validación y casi 500 muestras de prueba. Finalmente, para equiparar el marco con capacidades de adaptación de disparo cero, el marco se entrena en el conjunto de datos combinado LibriTTS, que consiste en clips de audio que totalizan alrededor de 250 horas de audio con más de 1,150 hablantes individuales. Para evaluar su rendimiento, el modelo emplea dos métricas: MOS-N o Puntuación de Opinión Media de Naturalidad, y MOS-S o Puntuación de Opinión Media de Similitud.

Resultados

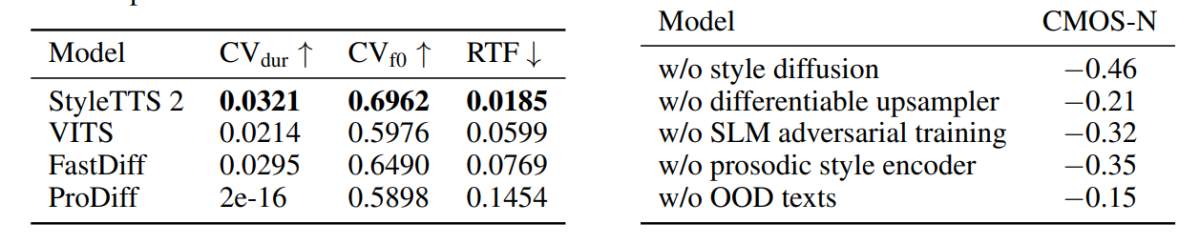

El enfoque y la metodología utilizados en el marco StyleTTS2 se demuestran en su rendimiento, ya que el modelo supera a varios marcos de TTS de estado del arte, especialmente en el conjunto de datos NaturalSpeech, y establece un nuevo estándar para el conjunto de datos. Además, el marco StyleTTS2 supera al marco de estado del arte VITS en el conjunto de datos VCTK, y los resultados se demuestran en la siguiente figura.

El modelo StyleTTS2 también supera a los modelos anteriores en el conjunto de datos LJSpeech, y no muestra ningún grado de degradación de la calidad en textos fuera de distribución o OOD, como lo hacen los marcos anteriores en las mismas métricas. Además, en un entorno de disparo cero, el modelo StyleTTC2 supera al marco existente Vall-E en terms de naturalidad, aunque se queda atrás en términos de similitud. Sin embargo, es importante destacar que el marco StyleTTS2 es capaz de lograr un rendimiento competitivo a pesar de entrenar solo con 245 horas de muestras de audio, en comparación con más de 60k horas de entrenamiento para el marco Vall-E, lo que demuestra que StyleTTC2 es una alternativa eficiente en términos de datos a los métodos de preentrenamiento existentes, como los utilizados en el marco Vall-E.

Avanzando, debido a la falta de datos de audio etiquetados con emociones, el marco StyleTTC2 utiliza el modelo GPT-4 para generar más de 500 instancias en diferentes emociones para la visualización de los vectores de estilo que el marco crea utilizando su proceso de difusión.

En la primera figura, los estilos emocionales en respuesta a los sentimientos del texto de entrada se ilustran mediante los vectores de estilo del modelo LJSpeech, y demuestra la capacidad del marco StyleTTC2 para sintetizar habla expresiva con emociones variables. La segunda figura muestra clusters distintos formados para cada uno de los cinco hablantes individuales, lo que demuestra una amplia gama de diversidad derivada de un solo archivo de audio. La figura final demuestra un cluster suelto de emociones del hablante 1, y revela que, a pesar de algunas superposiciones, los clusters basados en emociones son prominentes, lo que indica la posibilidad de manipular el tono emocional de un hablante independientemente de la muestra de audio de referencia y su tono de entrada. A pesar de utilizar un enfoque basado en difusión, el marco StyleTTS2 es capaz de superar a los marcos de estado del arte existentes, incluyendo VITS, ProDiff y FastDiff.

Pensamientos finales

En este artículo, hemos hablado sobre StyleTTS2, un marco de texto a voz innovador y robusto que se basa en los fundamentos del marco StyleTTS, y tiene como objetivo presentar el siguiente paso hacia los sistemas de texto a voz de estado del arte. El marco StyleTTS2 modela los estilos de habla como variables aleatorias latentes, y utiliza un modelo de difusión probabilístico para muestrear estos estilos de habla o variables aleatorias, lo que permite al marco StyleTTS2 sintetizar habla realista de manera efectiva sin utilizar entradas de audio de referencia. El marco StyleTTS2 utiliza la difusión de estilo y los discriminadores de SLM para lograr un rendimiento de nivel humano en tareas de texto a voz, y es capaz de superar a los marcos de estado del arte existentes en una amplia gama de tareas de habla.