Entrevistas

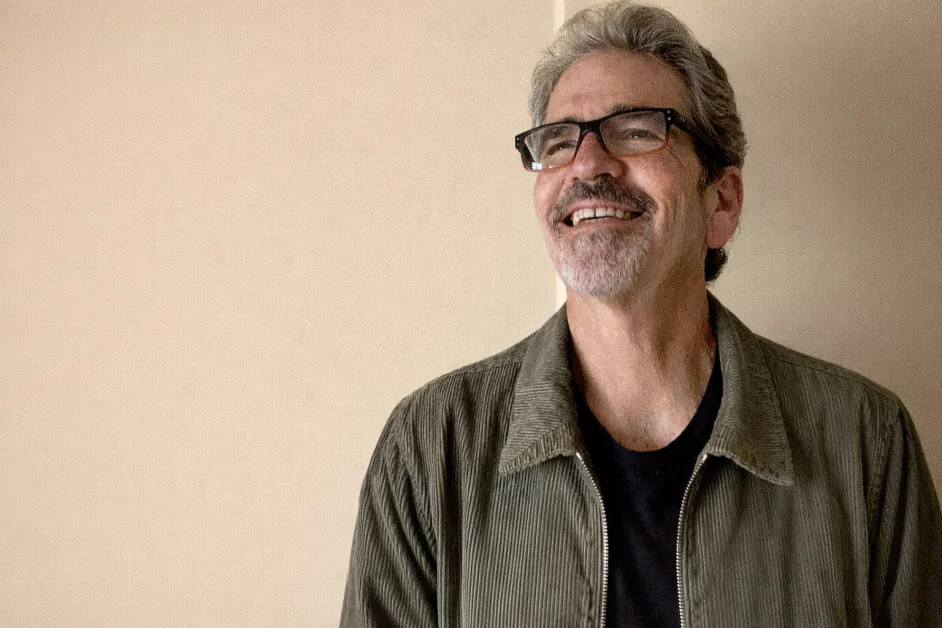

Steve Nemzer, Director Sénior de Crecimiento e Innovación en IA de TELUS Digital – Serie de entrevistas

Steve NemzerNemzer, director sénior de Crecimiento e Innovación en IA de TELUS Digital, lidera iniciativas centradas en el avance de los datos de entrenamiento y la infraestructura de IA para sistemas de inteligencia artificial de próxima generación. Su trabajo incluye el desarrollo de conjuntos de datos para modelos de investigación profunda, entornos de aprendizaje por refuerzo, datos de modelos del mundo, iniciativas de IA soberana y marcos de mitigación de riesgos de IA, con un fuerte énfasis en prácticas de IA responsables, como abordar el sesgo en los conjuntos de datos y apoyar condiciones laborales justas para los entrenadores de IA. Anteriormente, Nemzer fundó VeriTest Labs, ayudando a líderes tecnológicos pioneros como Microsoft, Intel, Oracle y Sun Microsystems a construir prósperos ecosistemas de software de terceros antes de que la empresa fuera adquirida por Lionbridge.

TELUS Digital Es una empresa global de servicios tecnológicos que ayuda a las organizaciones a diseñar, construir y operar plataformas digitales y soluciones basadas en IA. Con presencia en decenas de países, ofrece servicios como datos de entrenamiento y anotación de IA, ingeniería de productos digitales y gestión de la experiencia del cliente. Sus plataformas y servicios dan soporte a empresas de diversos sectores, como tecnología, finanzas, sanidad, telecomunicaciones y videojuegos, en su proceso de modernización operativa e implementación de capacidades avanzadas de IA.

Dada su experiencia en pruebas de IA, validación de datos e implementación responsable, ¿cómo percibe el cambio de la IA generativa basada en el lenguaje hacia modelos del mundo que buscan razonar sobre situaciones y resultados del mundo real, particularmente en su puesto actual en TELUS Digital?

Los modelos de lenguaje a gran escala (LLM, por sus siglas en inglés) son, fundamentalmente, sistemas de predicción de patrones. Generan respuestas prediciendo el siguiente token basándose en patrones aprendidos a partir de grandes corpus estáticos. Si bien esto puede parecer razonamiento, el modelo en realidad no modela cómo las acciones modifican el estado del mundo.

Los modelos de mundo adoptan un enfoque diferente. En lugar de predecir la siguiente palabra o token, buscan predecir el siguiente estado de un sistema modelando las transiciones de estado. Esto permite que los sistemas simulen cómo evolucionan los entornos en respuesta a las acciones. En la práctica, esto abre la puerta al razonamiento hipotético, donde un modelo puede evaluar diferentes resultados posibles antes de tomar una decisión. Para los sistemas interactivos, esto puede contribuir a una toma de decisiones y una planificación más fiables.

Este cambio también modifica nuestra concepción del despliegue responsable. Con los sistemas tradicionales de IA generativa, gran parte de la atención se ha centrado en cuestiones como los sesgos y las alucinaciones. A medida que los modelos avanzan hacia el razonamiento sobre entornos y acciones, otros riesgos se vuelven más relevantes.

Por ejemplo, las organizaciones deben considerar la brecha entre la simulación y la realidad, donde los comportamientos aprendidos en entornos simulados pueden no traducirse directamente a condiciones del mundo real. El cambio en la distribución también se convierte en una preocupación clave, ya que los entornos que los modelos encuentran durante su implementación pueden diferir de los datos con los que fueron entrenados.

Aquí es donde las pruebas y la validación se vuelven cruciales, un aspecto fundamental en mi trabajo en TELUS Digital. A medida que los sistemas de IA evolucionan más allá de la generación de lenguaje y se adentran en sistemas que interactúan con el entorno y toman decisiones, las organizaciones necesitan marcos de evaluación rigurosos para garantizar que los modelos se comporten de manera confiable en condiciones reales.

Muchas personas están familiarizadas con los modelos de lenguaje a gran escala, pero muchas menos comprenden los modelos del mundo. En pocas palabras, ¿qué problema intentan resolver los modelos del mundo que presenta dificultades fundamentales para los modelos de lenguaje a gran escala?

Un modelo del mundo es un sistema que puede predecir "qué sucederá después" dado un estado actual y una acción. La fórmula es: Estado + Acción → Estado siguiente

Si sostengo una manzana y la suelto, un modelo del mundo predice que la manzana caerá. No solo sabe cómo se ven las manzanas o qué dice la gente sobre dejarlas caer, sino que predice la consecuencia basándose en la física. Un modelo sofisticado del mundo predecirá qué sucedería si hiciera lo mismo en la Estación Espacial Internacional en lugar de estar en la superficie de la Tierra.

Esto es diferente de un modelo de lenguaje natural (LLM). Un LLM predice: «Dada esta secuencia de tokens, ¿qué token sigue?». Se entrena con texto: lo que los humanos escribieron sobre el mundo, no el mundo en sí. Puede decirte que las manzanas que se caen caen porque ha leído sobre ello. Pero no tiene un motor de física interno que simule la caída.

Dicho de otro modo, los modelos lingüísticos son eficaces para predecir estadísticamente la siguiente palabra en la respuesta a una pregunta, pero comprender el mundo real va más allá de la descripción y la cohesión del lenguaje. Los modelos del mundo buscan comprender cómo evolucionan las situaciones paso a paso, cuál es el siguiente estado dado el estado actual y la acción que se va a realizar, y qué restricciones existen.

Los modelos del mundo suelen describirse como herramientas que permiten a los sistemas de IA simular resultados antes de actuar. ¿Cómo se traduce esto en la práctica y qué tan cerca estamos de ver que funcione de manera confiable fuera de los entornos de investigación?

Un desafío al responder esta pregunta es que el término "modelo del mundo" se usa de forma bastante imprecisa, y su significado tiende a variar según el contexto. Una definición simple de modelo del mundo es que permite a un agente simular su entorno actual, predecir estados futuros y razonar sobre las consecuencias posteriores. Los investigadores tienden a categorizar los modelos del mundo de forma más detallada, según sus métodos de representación y procesamiento. Existen modelos del mundo latentes, que condensan la "esencia" de un entorno en un espacio compacto y específico. Existen modelos del mundo generativos, que "entienden" la física para crear representaciones visuales fotograma a fotograma, y modelos de Arquitectura Predictiva de Incrustación Conjunta (JEPA), que predicen resultados a partir de acciones pasadas.

Los modelos de mundo latente ya han salido del laboratorio de investigación y están ayudando en aplicaciones como la conducción autónoma, las operaciones de almacén, las operaciones industriales y la agricultura. Los modelos de mundo generativos están apareciendo en la creación de datos sintéticos para el desarrollo de motores de juegos, para casos de uso de conducción autónoma, casos de uso de IA encarnada para la simulación de vídeo de movimientos similares a los humanos y para crear representaciones arquitectónicas,

El enfoque JEPA, favorecido por figuras destacadas de la industria como Yan LeCun, predice resultados en un espacio de representación abstracta en lugar de generar píxeles. Si bien los robots se han limitado en gran medida a entornos controlados, JEPA está cambiando esta situación, permitiéndoles operar en entornos abiertos y del mundo real. Los vehículos autónomos son un buen ejemplo: algunos utilizan Genie 3 para generar simulaciones interactivas hiperrealistas para el entrenamiento y para gestionar mejor eventos poco frecuentes, como zonas de construcción.

Obviamente, se requieren muchas más pruebas de seguridad y fiabilidad para ampliar la escala y trasladar estos modelos del entorno aislado al mundo real.

Desde el punto de vista empresarial, ¿dónde espera que los modelos del mundo aporten valor significativo en primer lugar, ya sea en robótica, sistemas de toma de decisiones autónomos, gemelos digitales o entornos empresariales más abstractos?

Mi intuición me dice que los gemelos digitales probablemente aportarán valor práctico en primer lugar. Replican el estado de un sistema real para que podamos probar escenarios antes de actuar. Por ejemplo, en un sistema de cadena de suministro, un fabricante puede crear un gemelo digital de su red de socios de componentes. La simulación puede alimentarse con datos de sensores, registros y datos de telemetría, y puede responder preguntas como "¿Qué pasaría si se cerrara el Estrecho de Ormuz?". Así podemos probar el desvío de envíos antes de modificar la logística real. Esto nos ayuda a pasar de monitorizar un sistema en funcionamiento a simularlo.

La obtención de información valiosa a partir de modelos del mundo para la robótica avanza en paralelo. Lograr que los robots comprendan propiedades fundamentales de la física, como la fricción en una superficie al recoger un objeto, impulsará significativamente el desarrollo de la IA integrada.

Gran parte de su trayectoria profesional se ha centrado en la recopilación, anotación y validación de conjuntos de datos. ¿Cómo cambian los desafíos relacionados con los datos al pasar del entrenamiento con texto estático a la enseñanza de sistemas sobre cómo se comporta el mundo a lo largo del tiempo?

La recopilación de datos para el desarrollo de modelos del mundo exige un cambio radical con respecto a los métodos de entrenamiento de LLM del pasado. En primer lugar, no disponemos de un corpus gigantesco de datos de preentrenamiento, como petabytes de Common Crawl o miles de millones de páginas web. Algunos investigadores en robótica han especulado que solo contamos con una milésima parte de los datos necesarios para entrenar la inteligencia física y los modelos del mundo, para alcanzar un rendimiento equivalente al de, por ejemplo, GPT-2.

Así que llevará tiempo crear esos conjuntos de datos. En el caso de la IA integrada, necesitaremos millones de horas de conjuntos de datos multisensoriales egocéntricos anotados. Algunos teleoperados, otros de entornos sintéticos como Isaac Sim. En TELUS Digital, hemos dado el salto de los conjuntos de datos de texto a los multimodales, multisensoriales y de simulación. Por supuesto, nos ayuda nuestra sólida experiencia en recopilación y anotación de datos en visión artificial. Llevamos muchos años a la vanguardia en este campo.

Más allá de la escasez de datos de preentrenamiento y de datos de ajuste fino anotados, habrá muchos otros desafíos de entrenamiento para escalar el aprendizaje por refuerzo. Es posible que se requieran nuevos paradigmas transformadores (sin juego de palabras) como los conceptos de GPT y RL para acelerar los avances en eficiencia en los métodos de entrenamiento de modelos del mundo.

Los modelos globales influyen en las decisiones, en lugar de limitarse a generar resultados. ¿Qué nuevos riesgos de seguridad o gobernanza introduce esto en comparación con los sistemas de IA generativa?

Existen numerosos riesgos para la seguridad y la gobernanza, ya que los modelos del mundo están diseñados intrínsecamente para dar soporte a operaciones con agentes. Por lo tanto, todas las preocupaciones que tenemos sobre la generación actual de agentes de IA siguen vigentes en el escenario del modelo del mundo. Necesitamos supervisión humana para todas las decisiones importantes, ya sean relacionadas con la seguridad del transporte, la seguridad laboral, la atención médica, las finanzas o las actividades cotidianas.

Un ejemplo específico de los modelos del mundo real es la brecha entre los datos de entrenamiento de la simulación y los entornos del mundo real. Una variación microscópica en la superficie puede hacer que el mundo real resulte complicado para los robots que han sido entrenados a fondo en la simulación.

Otro riesgo se relaciona con el comportamiento humano. A medida que los sistemas se vuelven cada vez más autónomos, los humanos comenzarán a depender en gran medida de ellos, la supervisión podría relajarse y, eventualmente, el sistema no recibirá las recalibraciones necesarias.

Los prejuicios y la desconfianza siguen siendo obstáculos importantes para la adopción de la IA. ¿Cómo evolucionan estas preocupaciones cuando los sistemas de IA comienzan a modelar y actuar en entornos sociales o del mundo real complejos?

Desde el público en general hasta la alta dirección, la confianza en los modelos de IA ya es bastante baja y no veo que vaya a cambiar mucho a corto plazo.

La preocupación por la concentración del poder de la IA en pocas manos, la pérdida de empleos, los sesgos que perjudican a los grupos subrepresentados, las decisiones que toman los modelos y que afectan la salud, la carrera profesional y las finanzas, el uso de la propiedad intelectual sin consentimiento, así como la inquietud por las falsificaciones profundas (deepfakes) generadas por IA, es ya muy alta. Los ejecutivos se preocupan por la gestión de las transiciones laborales, la privacidad de los datos y el cumplimiento normativo, y por perder terreno frente a la competencia en una "carrera armamentística" de la IA.

Las recientes noticias sobre la presión gubernamental sobre los desarrolladores de modelos fundamentales de IA para que flexibilicen los términos de uso en temas como las armas autónomas o la vigilancia masiva no hacen sino intensificar estas preocupaciones. Un mayor despliegue de robots más inteligentes y autónomos basados en modelos del mundo tendrá el mismo efecto.

Por otro lado, observamos focos de adopción y confianza generalizadas en la IA. Un ejemplo es el auge de los agentes de codificación en los últimos meses. Los gerentes de desarrollo de software confían plenamente en ellos, y se ha producido un cambio fundamental en la forma de desarrollar software, desde la elaboración del documento de requisitos de producto (PRD) hasta las pruebas de regresión posteriores al lanzamiento. El mundo del desarrollo de software evoluciona a pasos agigantados, en gran medida gracias a la confianza en los agentes de codificación de alto rendimiento. A medida que aumente la confianza de los usuarios en otros casos de uso, preveo que la adopción se acelerará de forma similar.

Las soluciones para generar confianza incluyen el uso de diversos conjuntos de datos y entornos en las fases de capacitación, así como extensas pruebas de estrés y de simulación de ataques (red teaming) como medida de seguridad antes de la implementación. La supervisión regulatoria proactiva también es fundamental. Algunos han sugerido que se exija a los desarrolladores de modelos fundacionales la presentación de «Informes de Impacto Social», similares a los Informes de Impacto Ambiental (EIA), antes del lanzamiento de nuevos modelos.

En TELUS Digital, gran parte del trabajo consiste en implementar IA a gran escala para empresas y usuarios reales. ¿Cómo se relacionan ideas como los modelos globales con aspectos prácticos como la transparencia, el impacto en la fuerza laboral y el mantenimiento de la confianza del cliente?

Para mayor claridad, TELUS Digital trabaja tanto directamente con los creadores de modelos fundamentales como con las empresas que implementan modelos de IA. Nuestro ámbito de actuación es integral:

La cuestión de las preocupaciones prácticas está relacionada con la pregunta previa sobre la confianza. Analicemos la confianza en la fuerza laboral. A medida que las IA basadas en modelos del mundo se vuelven más comunes, los ejecutivos deben ser transparentes con sus empleados, contratistas y clientes. Se requiere una comunicación clara sobre las capacidades de los modelos, cómo se han entrenado, qué datos se utilizaron para su entrenamiento, qué medidas de seguridad se han implementado y dónde interviene la supervisión humana. Los líderes empresariales deben mostrar a la fuerza laboral actual el valor de los nuevos modelos, por ejemplo, al realizar las tareas más tediosas. También deben mostrar las vías de transición para los trabajadores afectados que podrían estar pasando a nuevos puestos de trabajo emergentes a medida que las IA basadas en modelos del mundo realizan cada vez más tareas. Los trabajadores de oficina están lidiando con esto en tiempo real, y muchos trabajos manuales se verán afectados en los próximos años a medida que se expanda la automatización basada en modelos del mundo.

Existe una brecha cada vez mayor entre lo que entienden los investigadores de IA y lo que percibe el público. ¿Cómo pueden las organizaciones comunicar avances como los modelos del mundo real de una manera que genere confianza sin exagerar sus capacidades?

Una vez más, todo se reduce a la transparencia sobre las limitaciones de los modelos y sus capacidades. Es fundamental comunicar cómo se han entrenado para mitigar posibles sesgos y qué tipo de supervisión humana existe. Algunas demostraciones prácticas de las capacidades y casos de uso del modelo, junto con estudios longitudinales, pueden contribuir significativamente a aumentar la confianza del público en general y de la fuerza laboral.

Por último, ¿cuál es una idea errónea común sobre los modelos del mundo de la IA, ya sea por exceso de optimismo o por exceso de cautela, que usted cree que debe corregirse de inmediato?

En la medida limitada en que el público general está informado sobre los modelos mundiales, una idea errónea es que los modelos mundiales necesitan comprender todas de física y ciencia para ser efectivos. Los modelos globales se implementarán antes de lo esperado porque los casos de uso individuales se pueden delimitar. Un vehículo autónomo solo necesita comprender la dinámica del tráfico y la física relacionada con la carretera, y cómo las condiciones actuales (por ejemplo, estar cerca de una escuela primaria o la presencia de SUV con siluetas altas en las cercanías) afectarán su visión y toma de decisiones. Un vehículo autónomo no necesita la física que explica cómo se hornea un soufflé para funcionar.

Gracias por la gran entrevista, los lectores que deseen obtener más información deben visitar TELUS Digital.