Ángulo de Anderson

Investigación sugiere que ChatGPT tiene alta credibilidad como proveedor de noticias

Nueva investigación sugiere que las etiquetas de verificación de hechos de ChatGPT superan a los gustos, compartidos y sogar a las marcas de noticias de confianza cuando se trata de dar forma a lo que la gente cree y quiere compartir en línea.

Un nuevo estudio de 1.000 personas ha encontrado que cuando ChatGPT da una puntuación de credibilidad a las noticias políticas, a menudo cambia lo que la gente cree, y si quieren compartirlo – sin importar sus opiniones políticas iniciales. Factores de influencia más tradicionales como los gustos o los compartidos no tuvieron mucho efecto, pero el juicio del AI dio forma a cómo se consideraba confiable la noticia:

![De la nueva publicación, una ilustración de cómo la gente evalúa un titular de noticia, basado en tres señales que interactúan: si la historia se alinea con su identidad política; cuánto compromiso parece tener en las redes sociales; y las señales de credibilidad proporcionadas por instituciones o sistemas de IA. Estas influencias se combinan para dar forma a la precisión percibida y la probabilidad de compartir el contenido. [ Fuente ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

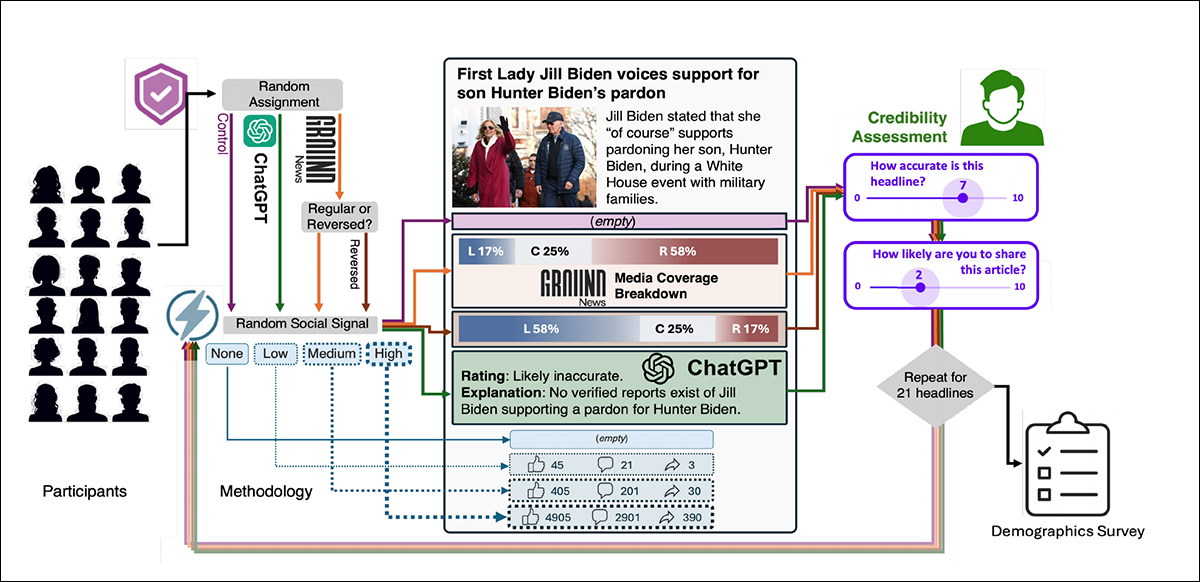

De la nueva publicación, una ilustración de cómo la gente evalúa un titular de noticia, basado en tres señales que interactúan: si la historia se alinea con su identidad política; cuánto compromiso parece tener en las redes sociales; y las señales de credibilidad proporcionadas por instituciones o sistemas de IA. Estas influencias se combinan para dar forma a la precisión percibida y la probabilidad de compartir el contenido. Fuente

El grado en que los resúmenes de IA son tomados como fuentes de noticias creíbles es quizás uno de los temas más importantes en los medios de comunicación durante muchos años, no solo porque los resúmenes de IA de Google han drenado el tráfico de la mayoría de los medios de comunicación en línea importantes en 2025, con ninguna certeza de hacia dónde podría dirigirse este traspaso de poder en el largo o incluso en el plazo medio.

Los autores del nuevo trabajo afirman:

‘Estos hallazgos resaltan tanto el potencial como el riesgo de la retroalimentación algorítmica para dar forma a la comprensión pública. Las señales generadas por IA pueden ayudar a mitigar los sesgos y mejorar la discriminación de credibilidad, pero su influencia varía según la identidad política y conlleva riesgos éticos relacionados con la dependencia excesiva […]

‘…La influencia desproporcionada de ChatGPT destaca un compromiso crítico: mientras que la retroalimentación de IA es persuasiva, puede reemplazar el pensamiento crítico si no se enmarca con cuidado.’

Los autores sugieren que la investigación futura debería centrarse en intervenciones de credibilidad de IA mejoradas que sean más independientes y apoyen los hechos conocidos, y observan que esto es especialmente importante en temas que son polarizantes.

Además del ascenso aparente de ChatGPT como una ‘autoridad’, y la influencia inesperadamente baja de las señales de compartido en las pruebas (que los autores creen que puede ser atribuible a las condiciones de prueba ligeramente estériles), otro resultado interesante de las pruebas de los investigadores se relaciona con la demografía y el género:

‘Las mujeres y los participantes minoritarios racialmente (particularmente los usuarios negros y latinos) respondieron más positivamente a la retroalimentación basada en IA que a las etiquetas institucionales.’

El nuevo trabajo se titula Señales de credibilidad de IA superan a las instituciones y el compromiso en la configuración de la percepción de noticias en las redes sociales, y proviene de tres investigadores de la Universidad de Notre Dame.

Veamos más de cerca los métodos y conclusiones del papel.

Método

Se probaron cuatro hipótesis: que la gente calificaría los titulares como más precisos cuando los titulares reflejaran sus opiniones políticas; que las puntuaciones de credibilidad generadas por IA serían más influyentes que las señales de instituciones establecidas; que los titulares con alto compromiso (es decir, medido a través de gustos, compartidos o comentarios) serían vistos como más confiables; y que los usuarios tenderían a aceptar el juicio de la IA sobre la precisión de un titular, incluso cuando entrara en conflicto con sus propias creencias.

Los participantes en el estudio se obtuvieron de la plataforma Prolific, y se les requirió que fueran fluidos en inglés, así como consumidores regulares de noticias; y un proceso de randomización aseguró que los participantes representaran una diversidad de puntos de vista raciales y de género.

En el experimento*, los participantes se dividieron en cuatro grupos, cada uno mostrado un tipo diferente de retroalimentación junto con los titulares de noticias.

En el primer grupo (la condición de control) no se dio información adicional sobre cuán creíble podría ser el titular; en el segundo grupo, los titulares se etiquetaron con una calificación de sesgo de GroundNews, un servicio que clasifica las fuentes de noticias como de izquierda, centro o derecha.

Un tercer grupo vio las mismas etiquetas de GroundNews, pero deliberadamente volteadas, creando una discrepancia destinada a probar si los usuarios detectarían la distorsión.

El grupo final se mostró evaluaciones de credibilidad escritas por ChatGPT, que ofrecían una breve explicación y una calificación como ‘probablemente inexacto’:

Esquema conceptual para el experimento: cada participante se mostró titulares políticos con combinaciones variables de etiquetas de credibilidad y señales de compromiso social. Se recopilaron respuestas sobre cuán precisa parecía cada titular, y cuán probable era que se compartiera, con la secuencia completa repetida en 21 elementos.

Datos y pruebas

Cada participante se mostró una secuencia de 21 titulares de noticias políticas. Para cada titular, el nivel de compromiso social se varió; a veces no mostraba gustos ni compartidos, a veces muchos. Estas señales de compromiso se randomizaron para evitar patrones fijos.

Los titulares en sí provenían de una mezcla de perspectivas políticas, y se etiquetaron como de izquierda, de derecha, o centristas.

Después de cada titular, se preguntó a los participantes cuán preciso creían que era, y si considerarían compartirlo. Debido a que cada participante ya había declarado su propia afiliación política, fue posible analizar si los titulares del mismo lado del espectro político se calificaban más favorablemente.

Los participantes calificaron cada titular dos veces: una vez por cuán preciso parecía, y una vez por cuán probable era que lo compartieran, con sus respuestas medidas en una escala de 0 a 10.

Los investigadores luego combinaron estas respuestas con datos adicionales: información demográfica y de uso de medios de cada participante; etiquetas políticas para cada titular; el tipo de señal de credibilidad mostrada; y el nivel de compromiso social asignado.

Influencia de la identidad política

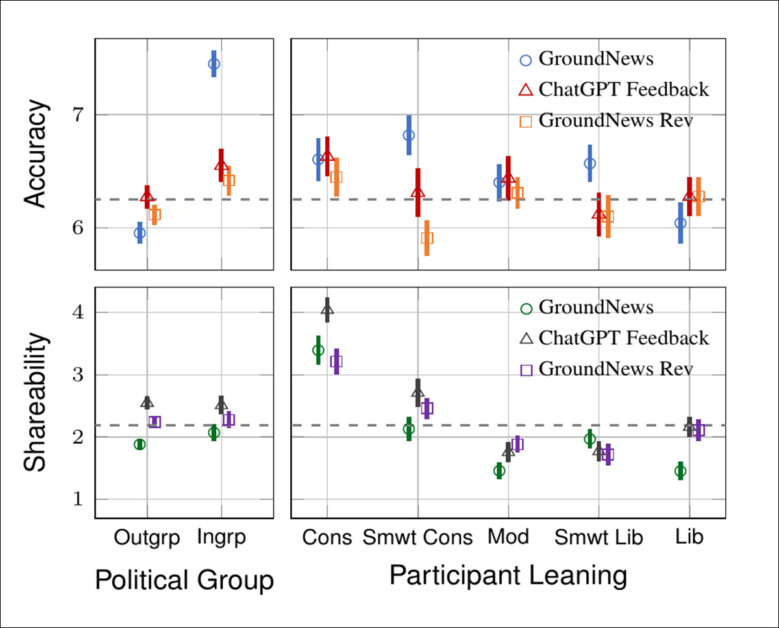

En la primera prueba, que investigó si la gente califica los titulares como más precisos cuando la postura política del titular coincide con sus propias opiniones, los resultados indicaron que los participantes eran más propensos a creer titulares que coincidían con sus opiniones políticas – pero que esto dependía del grupo.

Los moderados mostraron el sesgo más fuerte hacia su propio lado, mientras que los liberales y los conservadores tendían a confiar en titulares centristas lo más; y en general, los titulares neutrales se calificaron como más precisos que los de izquierda o derecha.

Una ilustración de cómo las calificaciones de precisión y compartibilidad cambiaron dependiendo de la postura política del titular y la afiliación política del participante. Los moderados fueron los más propensos a calificar titulares ‘de grupo’ como precisos, mientras que los liberales y los conservadores favorecieron titulares alineados con el centro. El comportamiento de compartición siguió un patrón similar, con un sesgo de grupo limitado fuera del grupo moderado.

En los resultados de este primer experimento, se encontró un efecto de grupo modesto en la compartibilidad; pero solo para los moderados, que estaban más inclinados a compartir titulares políticamente alineados (es decir, neutrales). Los liberales y los conservadores no mostraron tal tendencia.

El análisis de varianza (ANOVA), un método utilizado para detectar diferencias entre grupos, mostró que la alineación afectó la compartición solo cuando interactuaba con la identidad política. La credibilidad y la compartición estaban vinculadas, pero solo los moderados mostraron un patrón claro en ambos.

Credibilidad institucional vs. credibilidad de IA

La siguiente prueba preguntó si la gente confía más en las calificaciones de IA que en fuentes tradicionales como sitios web de calificación de noticias – especialmente cuando las calificaciones podrían no coincidir con sus políticas:

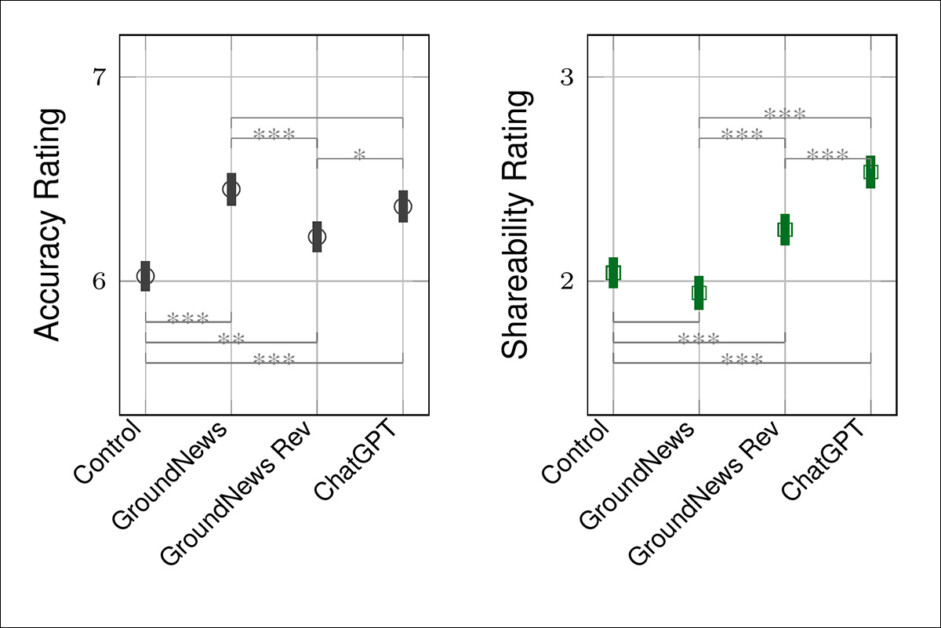

Calificaciones de credibilidad y compartibilidad a través de fuentes de retroalimentación: las tres señales aumentaron la precisión en comparación con el control, con GroundNews que produjo las calificaciones más altas. Sin embargo, ChatGPT produjo las mayores ganancias en compartibilidad, lo que sugiere que tuvo un impacto persuasivo más amplio. Las barras de error muestran intervalos de confianza del 95%, y los asteriscos marcan diferencias pareadas significativas.

Toda la retroalimentación aumentó la precisión percibida; pero GroundNews fue la más efectiva cuando se alineaba con la política del usuario.

ChatGPT aumentó las calificaciones de precisión en todas partes, lo que indica que se consideró más neutral. Los conservadores fueron menos influenciados por GroundNews, pero respondieron a ChatGPT de manera similar a otros grupos:

Aquí podemos ver los efectos de la retroalimentación de ChatGPT en la precisión percibida. Los resultados indican que la confianza en las señales de instituciones depende de la alineación, mientras que la confianza en las señales de algoritmos no. ChatGPT aumentó tanto la credibilidad como la compartibilidad en todos los grupos – especialmente para los conservadores.

Métricas sociales tienen poco impacto

El tercer análisis probó si las señales de compromiso social visibles, como gustos, compartidos y comentarios, aumentarían la credibilidad o la compartibilidad al actuar como prueba social; pero no se observó tal efecto.

Las pruebas encontraron que los niveles de compromiso, como gustos o compartidos, no tuvieron un efecto real en cuán precisa parecía la noticia, y solo un efecto débil e inseguro en cuán compartible sentían; a diferencia de las señales de algoritmos o institucionales, estas señales sociales no parecieron influir en los juicios en este contexto, por las razones mencionadas anteriormente en el artículo.

Retroalimentación de IA influye en lo que la gente confía

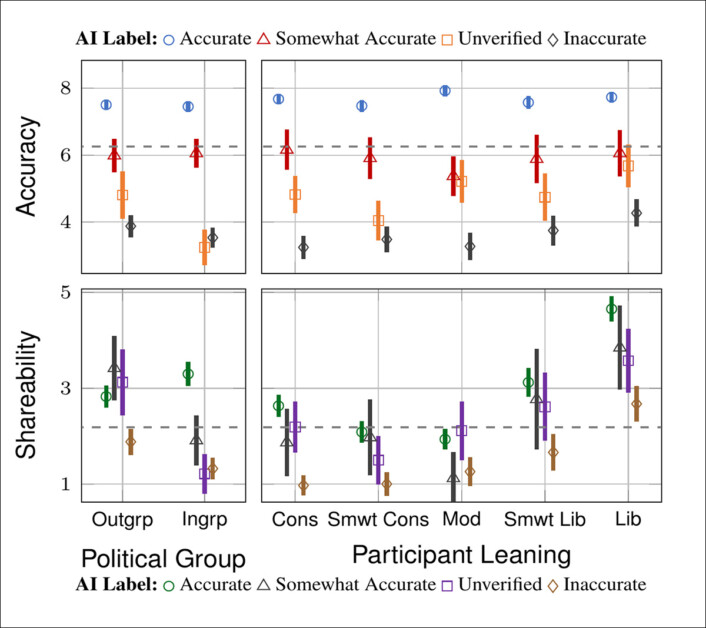

La cuarta y última prueba probó si los usuarios ajustarían sus juicios de credibilidad y compartición en respuesta a etiquetas generadas por IA: preciso; algo preciso; no verificado; o inexacto, todas asignadas por ChatGPT.

Los participantes respondieron con fuerza a las etiquetas de credibilidad generadas por IA. Las calificaciones de precisión subieron o bajaron en línea con la retroalimentación de ChatGPT, con los efectos más grandes vistos cuando los titulares se etiquetaron como precisos o inexactos:

La retroalimentación de ChatGPT influyó en las calificaciones de precisión y compartibilidad. Arriba: las calificaciones de precisión subieron con etiquetas más positivas, especialmente cuando los titulares se marcaron como ‘Precisos’, y bajaron cuando se etiquetaron como ‘Inexactos’. Abajo: la compartibilidad siguió un patrón similar pero mostró una mayor variación por grupo: los liberales respondieron más fuertemente a las señales negativas, mientras que los conservadores mostraron cambios más moderados.

La identidad política dio forma a estos efectos, con los usuarios que confiaban más en ChatGPT cuando su retroalimentación se alineaba con sus propias opiniones.

El comportamiento de compartición siguió un patrón similar: los titulares de grupo etiquetados como precisos se compartieron con más frecuencia, especialmente bajo etiquetas ambiguas como algo preciso.

Estos resultados, según la publicación, sugieren que la retroalimentación de IA puede cambiar el comportamiento del usuario; y que también riesgos de reforzar las divisiones partidistas o desalentar el pensamiento crítico.

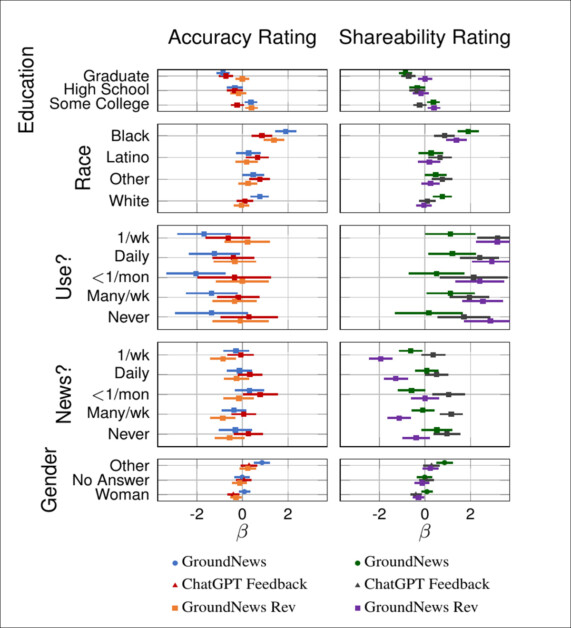

¿Quién confía más en la IA?

El análisis de seguimiento examinó cómo las demografías del usuario dieron forma a las reacciones a las etiquetas de credibilidad. La retroalimentación de ChatGPT aumentó las calificaciones de precisión en general, pero el efecto fue más débil entre los usuarios con educación superior, y los consumidores frecuentes de redes sociales, que mostraron más escepticismo.

Estos mismos grupos reaccionaron negativamente a GroundNews y a las señales de reversión, lo que sugiere, según la publicación, que los marcadores de sesgo manifiestos pueden alienar a los usuarios más alfabetizados en los medios.

Por el contrario, las mujeres y los participantes minoritarios racialmente, especialmente los usuarios negros y latinos, respondieron más positivamente a ChatGPT que a las señales de instituciones:

Respuestas demográficas a los tipos de retroalimentación, con cada panel que muestra cómo un grupo particular respondió a diferentes señales de credibilidad. Las calificaciones de ChatGPT tuvieron la influencia más fuerte y consistente en la precisión, mientras que los efectos en la compartición fueron menos uniformes, con variación por raza, género y uso de medios.

El comportamiento de compartición reflejó esta división: GroundNews redujo la compartibilidad más agudamente entre los usuarios de redes sociales y los adictos a las noticias, mientras que los efectos de ChatGPT fueron más mixtos, incluso aumentando la compartibilidad en algunos grupos, con los titulares de grado de posgrado especialmente receptivos a todos los tipos de retroalimentación.

Los autores concluyen:

‘Estos hallazgos tienen implicaciones directas para el diseño de intervenciones de credibilidad en sistemas sociotécnicos. Los usuarios están cada vez más influenciados por la retroalimentación algorítmica, que puede anular las señales de instituciones y moderar el sesgo partidista – pero también riesgos de promover la dependencia excesiva.

‘Las señales de instituciones siguen siendo efectivas para algunos usuarios, pero su impacto disminuye en entornos polarizados o de [baja confianza]. Mientras tanto, las métricas de compromiso como los gustos y los compartidos fueron en gran medida ignoradas, lo que sugiere un valor persuasivo reducido cuando se presentan sin contexto social.

‘Para apoyar la evaluación equitativa y informada de las noticias, las intervenciones impulsadas por IA deben ser transparentes, explicativas y diseñadas para mejorar la capacidad del usuario.

‘El trabajo futuro debería examinar estos mecanismos en entornos más ecológicamente válidos, evaluar los marcos de credibilidad de IA alternativos y desarrollar sistemas adaptativos que fomenten la participación crítica en audiencias políticamente diversas.’

Conclusión

Dado la tendencia de todos los sistemas de IA generativos actuales a alucinar y distorsionar la verdad, es preocupante que la adopción de ChatGPT también represente un enorme salto de fe que las arquitecturas de estos sistemas no pueden justificar ni respaldar.

Un problema con confiar en la representación de noticias de IA es la falta de sistemas efectivos que puedan contextualizar las fuentes de noticias como ‘afiliadas políticamente’, o inclinadas hacia uno u otro extremo del espectro político.

Incluso entre las fuentes de noticias más reputadas, la elección de qué y qué no se cubre es en sí misma una declaración política. Ni ChatGPT ni sus compañeros están actualmente en posición de navegar estas capas de sesgo interpretativo, y el tema en sí invita a la discusión en lugar de conclusiones sólidas.

Otro problema es que los sistemas de este tipo han llegado a la escena en uno de los períodos más polarizados y divisivos de la historia humana en 80 años, y en un momento en que la sociedad está más dispuesta a escuchar ‘voces alternativas’ – como un género completamente nuevo de tecnología que se promociona como un filtro esencial de la verdad del mundo, en lugar de lo que realmente es: un predictor de probabilidades estadísticas, alimentado por grandes cantidades de información partidista.

* Detalles de los cuales los autores han hecho disponibles en línea (ver papel de fuente, parte inferior de la P2, para las URL). Sin embargo, estos datos requieren registro para ver, y desde que no seguí el asunto en ese momento, no puedo confirmar que se pueda ver completamente sin pago y/o credenciales específicas.

Publicado por primera vez el miércoles 5 de noviembre de 2025