Inteligencia artificial

Nuestras habilidades subconscientes para la detección de deepfakes podrían impulsar sistemas automatizados futuros

Nueva investigación de Australia sugiere que nuestro cerebro es hábil para reconocer deepfakes sofisticados, incluso cuando creemos conscientemente que las imágenes que estamos viendo son reales.

El hallazgo implica además la posibilidad de utilizar las respuestas neuronales de las personas a caras deepfake (en lugar de sus opiniones declaradas) para entrenar sistemas automatizados de detección de deepfakes. Dichos sistemas se entrenarían en las características deepfake de las imágenes, no en estimaciones confusas de plausibilidad, sino en nuestros mecanismos perceptivos instintivos para el reconocimiento de la identidad facial.

‘[A]unque el cerebro puede ‘reconocer’ la diferencia entre caras reales y caras realistas, los observadores no pueden distinguirlos conscientemente. Nuestros hallazgos de la disociación entre la respuesta del cerebro y el comportamiento tienen implicaciones para cómo estudiamos la percepción de caras falsas, las preguntas que planteamos al preguntar sobre la identificación de imágenes falsas y las posibles formas en que podemos establecer estándares de protección contra el mal uso de imágenes falsas.’

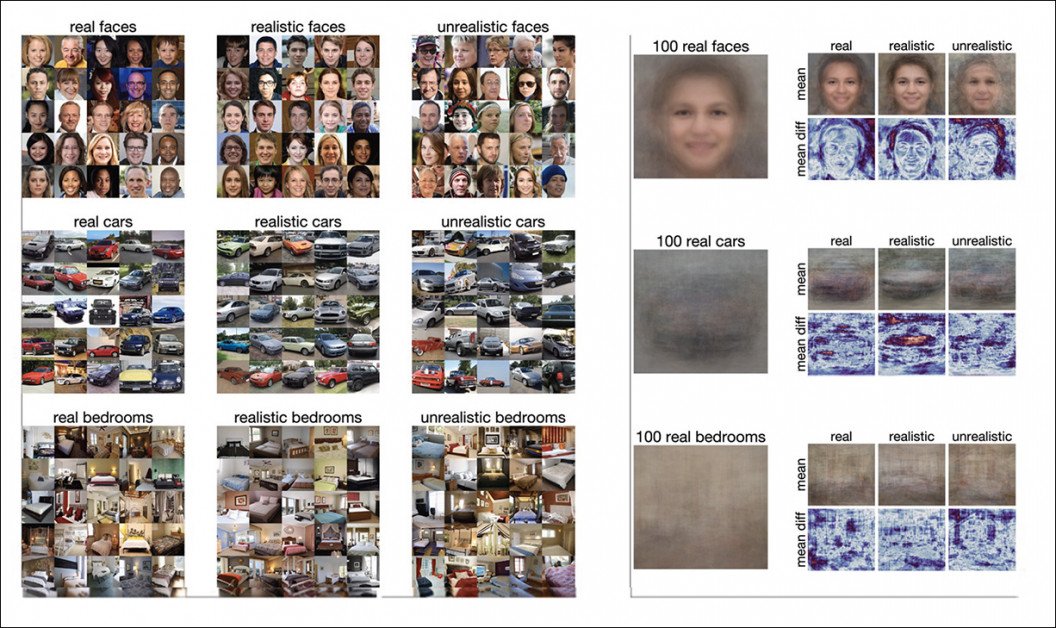

Los resultados surgieron en rondas de pruebas diseñadas para evaluar la forma en que las personas responden a imágenes falsas, incluyendo imágenes de caras falsas, coches, espacios interiores y caras invertidas (es decir, boca abajo).

Various iterations and approaches for the experiments, which involved two groups of test subjects needing to classify a briefly-shown image as ‘fake’ or ‘real’. The first round took place on Amazon Mechanical Turk, with 200 volunteers, while the second round involved a smaller number of volunteers responding to the tests while hooked up to EEG machines. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

El artículo afirma:

‘Nuestros resultados demuestran que dado solo un vistazo breve, los observadores pueden detectar caras falsas. Sin embargo, tienen más dificultades para distinguir caras reales de caras falsas y, en algunos casos, creen que las caras falsas son más reales que las caras reales.

‘Sin embargo, utilizando EEG de resolución temporal y métodos de clasificación de patrones multivariable, encontramos que era posible decodificar tanto caras poco realistas como caras realistas de caras reales utilizando la actividad cerebral.

‘Esta disociación entre el comportamiento y las respuestas neuronales para caras realistas proporciona nuevas pruebas importantes sobre la percepción de caras falsas, así como implicaciones que involucran la creciente clase de caras generadas por GAN.’

El artículo sugiere que el nuevo trabajo tiene ‘varias implicaciones’ en la ciberseguridad aplicada, y que el desarrollo de clasificadores de aprendizaje de deepfakes debería estar impulsado por la respuesta subconsciente, medida en lecturas de EEG en respuesta a imágenes falsas, en lugar de la estimación consciente del espectador de la veracidad de una imagen.

Los autores comentan*:

‘Esto es reminiscente de los hallazgos de que las personas con prosopagnosia que no pueden clasificar o reconocer caras como familiares o no familiares, sin embargo, muestran respuestas autónomas más fuertes a caras familiares que a caras no familiares.

‘De manera similar, lo que hemos demostrado en este estudio es que, aunque pudimos decodificar con precisión la diferencia entre caras reales y caras realistas a partir de la actividad neural, esa diferencia no se vio comportamentalmente. En cambio, los observadores identificaron incorrectamente el 69% de las caras reales como siendo falsas.’

El nuevo trabajo se titula ¿Eres real? Decodificando caras generadas por IA realistas a partir de la actividad neural, y proviene de cuatro investigadores de la Universidad de Sydney, la Universidad de Macquarie, la Universidad de Sydney Occidental y la Universidad de Queensland.

Datos

Los resultados surgieron de un examen más amplio de la capacidad humana para distinguir imágenes falsas manifiestas, hiperrealistas (pero aún falsas) y reales, realizado en dos rondas de pruebas.

Los investigadores utilizaron imágenes creadas por Redes Generativas Adversarias (GAN), compartidas por NVIDIA.

GAN-generated human face images made available by NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

Los datos comprendieron 25 caras, coches y dormitorios, en niveles de renderizado que variaban desde ‘poco realista’ hasta ‘realista’. Para la comparación de caras (es decir, para material no falso adecuado), los autores utilizaron selecciones de los datos de origen de la base de datos Flickr-Faces-HQ (FFHQ) de NVIDIA dataset. Para la comparación de los demás escenarios, utilizaron material de la base de datos LSUN.

Las imágenes se presentarían finalmente al sujeto de prueba ya sea de la manera correcta o invertida, y a una variedad de frecuencias, con todas las imágenes redimensionadas a 256×256 píxeles.

Después de que se reunió todo el material, se curaron 450 imágenes de estímulo para las pruebas.

Pruebas

Las pruebas en sí se llevaron a cabo inicialmente en línea, a través de jsPsych en pavlovia.org, con 200 participantes que juzgaban varios subconjuntos de los datos de prueba totales. Las imágenes se presentaron durante 200ms, seguidas de una pantalla en blanco que persistiría hasta que el espectador tomara una decisión sobre si la imagen que se les mostró brevemente era ‘falsa’ o ‘real’. Cada imagen se presentó solo una vez, y la prueba completa tardó de 3 a 5 minutos en completarse.

La segunda ronda, más reveladora, utilizó sujetos en persona conectados a monitores de EEG, y se presentó en la plataforma Psychopy2. Cada una de las veinte secuencias contenía 40 imágenes, con 18,000 imágenes presentadas en todo el conjunto de datos de prueba.

Los datos de EEG recopilados se decodificaron mediante MATLAB con la herramienta CoSMoMVPA, utilizando un esquema de validación cruzada de un solo elemento bajo Análisis Discriminante Lineal (LDA).

El clasificador LDA fue el componente que pudo hacer la distinción entre la reacción cerebral a estímulos falsos y la opinión del sujeto sobre si la imagen era falsa.

Resultados

Interesados en ver si los sujetos de la prueba de EEG podían discriminar entre caras falsas y reales, los investigadores agregaron y procesaron los resultados, encontrando que los participantes podían discernir fácilmente caras reales de caras poco realistas, pero aparentemente luchaban por identificar caras falsas realistas generadas por GAN. Si la imagen estaba invertida o no parecía hacer poca diferencia.

Behavioral discrimination of real and synthetically-generated faces, in the second round.

Sin embargo, los datos de EEG contaron una historia diferente.

El artículo establece:

‘Aunque los observadores tuvieron problemas para distinguir caras reales de caras falsas y tendieron a sobreclasificar caras falsas, los datos de EEG contenían información de señal de importancia para esta distinción que difirió significativamente entre realistas y poco realistas, y esta señal de importancia pareció estar limitada a una etapa relativamente corta de procesamiento.’

Here the disparity between EEG accuracy and the reported opinion of the subjects (i.e. as to whether or not the face images were fake) are not identical, with the EEG captures getting nearer to the truth than the manifest perception of the people involved.

Los investigadores concluyen que, aunque los observadores pueden tener problemas para identificar tácitamente caras falsas, estas caras tienen ‘representaciones distintas en el sistema visual humano’.

‘Entender la disociación entre el cerebro y el comportamiento para la detección de caras falsas tendrá implicaciones prácticas para la forma en que abordamos la posible propagación perjudicial y universal de información generada artificialmente.’

* Mi conversión de citas en línea a hipervínculos.

Publicado por primera vez el 11 de julio de 2022.