Inteligencia artificial

Mistral AI: Estableciendo nuevos estándares más allá de Llama2 en el espacio de código abierto

Los grandes modelos de lenguaje (LLM) han ocupado recientemente el centro del escenario, gracias a destacados rendimientos como ChatGPT. Cuando Meta presentó sus modelos Llama, despertó un renovado interés en los LLM de código abierto. El objetivo! Crear LLM de código abierto asequibles que sean tan buenos como los modelos de alta gama como GPT-4, pero sin la etiqueta de precio elevada o la complejidad.

Esta combinación de asequibilidad y eficiencia no solo abrió nuevas avenidas para investigadores y desarrolladores, sino que también sentó las bases para una nueva era de avances tecnológicos en el procesamiento de lenguaje natural.

Recientemente, las startups de inteligencia artificial generativa han estado en auge con financiación. Juntas recaudaron $20 millones, con el objetivo de dar forma a la inteligencia artificial de código abierto. Anthropic también recaudó una impresionante cantidad de $450 millones, y Cohere, en asociación con Google Cloud, obtuvo $270 millones en junio de este año.

Introducción a Mistral 7B: Tamaño y disponibilidad

Mistral AI, con sede en París y cofundada por exalumnos de Google’s DeepMind y Meta, anunció su primer gran modelo de lenguaje: Mistral 7B. Este modelo puede ser descargado fácilmente por cualquier persona desde GitHub y incluso a través de un torrent de 13,4 gigabytes.

Esta startup logró obtener una financiación de semilla récord incluso antes de tener un producto lanzado. El primer modelo de Mistral con 7 mil millones de parámetros supera el rendimiento de Llama 2 13B en todas las pruebas y supera a Llama 1 34B en muchas métricas.

En comparación con otros modelos como Llama 2, Mistral 7B ofrece capacidades similares o mejores, pero con menos sobrecarga computacional. Mientras que los modelos fundamentales como GPT-4 pueden lograr más, conllevan un costo más alto y no son tan fáciles de usar, ya que principalmente son accesibles a través de API.

Cuando se trata de tareas de codificación, Mistral 7B le da a CodeLlama 7B una oportunidad de competir. Además, es lo suficientemente compacto a 13,4 GB para ejecutarse en máquinas estándar.

Además, Mistral 7B Instruct, ajustado específicamente para conjuntos de datos instructivos en Hugging Face, ha demostrado un gran rendimiento. Superó a otros modelos de 7B en MT-Bench y se encuentra al mismo nivel que los modelos de chat de 13B.

Hugging Face Mistral 7B Ejemplo

Benchmarking de rendimiento

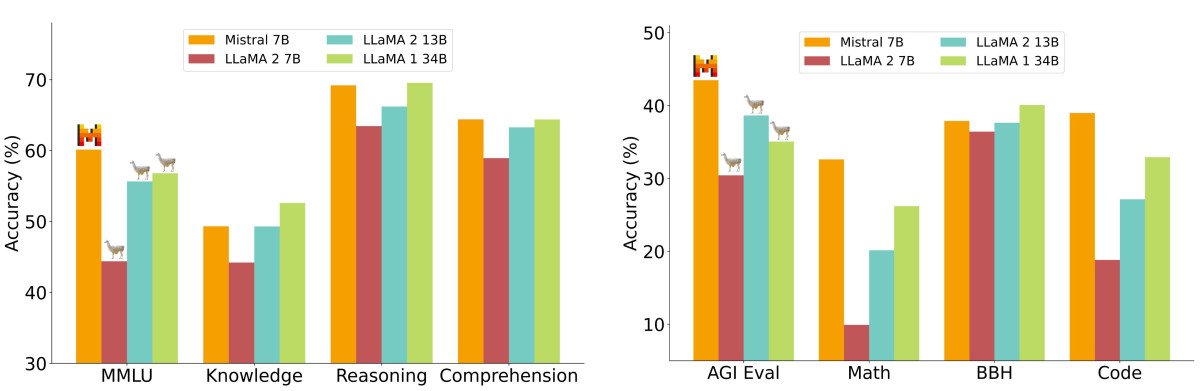

En un análisis detallado de rendimiento, Mistral 7B se midió contra los modelos de la familia Llama 2. Los resultados fueron claros: Mistral 7B superó sustancialmente a Llama 2 13B en todas las pruebas. De hecho, igualó el rendimiento de Llama 34B, especialmente destacándose en pruebas de codificación y razonamiento.

Las pruebas se organizaron en varias categorías, como razonamiento común, conocimiento del mundo, comprensión lectora, matemáticas y codificación, entre otras. Una observación particularmente destacada fue la métrica de costo-rendimiento de Mistral 7B, denominada “tamaños de modelo equivalentes”. En áreas como razonamiento y comprensión, Mistral 7B demostró un rendimiento similar al de un modelo Llama 2 tres veces mayor, lo que indica un posible ahorro de memoria y un aumento en el rendimiento. Sin embargo, en pruebas de conocimiento, Mistral 7B se alineó estrechamente con Llama 2 13B, lo que probablemente se deba a las limitaciones de parámetros que afectan la compresión de conocimiento.

¿Qué hace que el modelo Mistral 7B sea mejor que la mayoría de los otros modelos de lenguaje?

Simplificando los mecanismos de atención

Mientras que las sutilezas de los mecanismos de atención son técnicas, su idea fundamental es relativamente simple. Imagina que estás leyendo un libro y resaltando oraciones importantes; esto es análogo a cómo los mecanismos de atención “resaltan” o dan importancia a puntos de datos específicos en una secuencia.

En el contexto de los modelos de lenguaje, estos mecanismos permiten que el modelo se centre en las partes más relevantes de los datos de entrada, asegurando que la salida sea coherente y precisa en el contexto.

En los transformadores estándar, las puntuaciones de atención se calculan con la fórmula:

La fórmula para estas puntuaciones implica un paso crucial: la multiplicación de matrices de Q y K. El desafío aquí es que a medida que crece la longitud de la secuencia, ambas matrices se expanden en consecuencia, lo que lleva a un proceso computacionalmente intensivo. Esta preocupación por la escalabilidad es una de las principales razones por las que los transformadores estándar pueden ser lentos, especialmente al tratar con secuencias largas.

La atención multi-consulta (MQA) acelera las cosas utilizando un conjunto de “cabezas de clave-valor”, pero a veces sacrifica la calidad. Ahora, podrías preguntarte, ¿por qué no combinar la velocidad de MQA con la calidad de la atención multi-cabeza? Eso es donde entra en juego la atención de consulta agrupada (GQA).

Atención de consulta agrupada (GQA)

GQA es una solución intermedia. En lugar de utilizar solo una o varias “cabezas de clave-valor”, las agrupa. De esta manera, GQA logra un rendimiento cercano a la atención multi-cabeza detallada, pero con la velocidad de MQA. Para modelos como Mistral, esto significa un rendimiento eficiente sin comprometer demasiado la calidad.

Atención de ventana deslizante (SWA)

La ventana deslizante es otro método utilizado en el procesamiento de secuencias de atención. Este método utiliza una ventana de atención de tamaño fijo alrededor de cada token en la secuencia. Con varias capas apiladas con esta atención ventana, las capas superiores eventualmente ganan una perspectiva más amplia, abarcando información de toda la entrada. Este mecanismo es análogo a los campos receptivos vistos en las Redes Neuronales Convolucionales (CNN).

Por otro lado, la “atención de ventana deslizante dilatada” del modelo Longformer, que es conceptualmente similar al método de ventana deslizante, solo calcula algunas diagonales de la matriz. Este cambio resulta en un aumento lineal del uso de memoria en lugar de cuadrático, lo que lo convierte en un método más eficiente para secuencias más largas.

Transparencia de Mistral AI vs. Preocupaciones de seguridad en la descentralización

En su anuncio, Mistral AI también enfatizó la transparencia con la declaración: “No trucos, no datos propietarios”. Pero al mismo tiempo, su único modelo disponible en este momento, ‘Mistral-7B-v0.1’, es un modelo base preentrenado, por lo que puede generar una respuesta a cualquier consulta sin moderación, lo que plantea posibles preocupaciones de seguridad. Mientras que modelos como GPT y Llama tienen mecanismos para discernir cuándo responder, la naturaleza completamente descentralizada de Mistral podría ser explotada por actores maliciosos.

Sin embargo, la descentralización de los grandes modelos de lenguaje tiene sus méritos. Mientras que algunos podrían malversarla, las personas pueden aprovechar su poder para el bien social y hacer que la inteligencia sea accesible para todos.

Flexibilidad de implementación

Uno de los aspectos destacados es que Mistral 7B está disponible bajo la licencia Apache 2.0. Esto significa que no hay barreras reales para utilizarlo, ya sea para fines personales, una gran corporación o incluso una entidad gubernamental. Solo necesitas el sistema adecuado para ejecutarlo, o es posible que debas invertir en recursos en la nube.

Mientras que existen otras licencias como la licencia MIT más simple y la licencia CC BY-SA-4.0 cooperativa, que requiere crédito y licencia similar para derivados, Apache 2.0 proporciona una base sólida para empresas a gran escala.

Pensamientos finales

El auge de los grandes modelos de lenguaje de código abierto como Mistral 7B señala un cambio crucial en la industria de la inteligencia artificial, haciendo que los modelos de lenguaje de alta calidad sean accesibles a una audiencia más amplia. Los enfoques innovadores de Mistral AI, como la atención de consulta agrupada y la atención de ventana deslizante, prometen un rendimiento eficiente sin comprometer la calidad.

Mientras que la naturaleza descentralizada de Mistral plantea ciertos desafíos, su flexibilidad y licencia de código abierto subrayan el potencial para democratizar la inteligencia artificial. A medida que el panorama evoluciona, el enfoque inevitablemente se centrará en equilibrar el poder de estos modelos con consideraciones éticas y mecanismos de seguridad.

¿Qué sigue para Mistral? El modelo 7B fue solo el comienzo. El equipo tiene como objetivo lanzar modelos aún más grandes pronto. Si estos nuevos modelos igualan el rendimiento del 7B, Mistral podría convertirse rápidamente en un jugador destacado en la industria, todo dentro de su primer año.