Ángulo de Anderson

Consultas impolíticas podrían aumentar los costos de ChatGPT para empresas

Las respuestas de ChatGPT consumen más tokens cuando se es grosero con él, lo que aumenta la factura de su empresa; pero decir ‘por favor’ puede reducir sus costos.

Se dice que la cortesía no cuesta nada; pero, ¿cuánto cuesta la falta de cortesía? En cuanto a pagar por ChatGPT, bastante, según un nuevo estudio de EE. UU. El nuevo documento, de la Universidad de Iowa, encuentra que ser grosero con ChatGPT aumenta el costo de las respuestas, incluso si las respuestas son las mismas para consultas corteses y no corteses.

Los autores afirman:

‘El precio de los tokens de salida es de $12 por 1 millón de tokens de salida para GPT4. Encontramos que las solicitudes no corteses llevan a más de 14 tokens extra, lo que equivale a un costo adicional de $0,000168 por solicitud en promedio. Las consultas diarias promedio a la API de OpenAI superan los 2.200 millones.

‘En comparación con un escenario en el que todas las solicitudes son corteses, cuando en su lugar las solicitudes no son corteses, esto genera un ingreso adicional de $369.000 por día, simplemente debido al aumento en los tokens que las solicitudes no corteses generan en el resultado.’

Aunque el resultado es interesante en sí mismo, los autores enfatizan que este comportamiento inusual podría indicar una variedad de rarezas desconocidas en la configuración humano/IA, algunas o todas las cuales también pueden tener implicaciones financieras. En cuanto a la razón por la que la grosería cuesta a los clientes tokens adicionales, los autores no especulan.

Para establecer la veracidad del síndrome, reescribieron solicitudes reales de ChatGPT, alternando los valores de cortesía, mientras conservaban el significado. Ambas versiones se introdujeron en GPT-4-Turbo, y se midieron las diferencias en la cantidad de tokens de salida utilizados para las respuestas.

Las conclusiones son un contraste marcado con los eventos de titulares de principios de año, donde Sam Altman se quejó de que la cortesía estaba costando a OpenAI posiblemente ‘decenas de millones’ de dólares en términos de procesamiento de tokens relacionados con la cortesía (como ‘por favor’). La investigación publicada en el mismo período también indicó que la cortesía no tenía valor en términos de obtener mejores respuestas (aunque no comentó sobre respuestas más baratas).

Si las conclusiones del nuevo documento son correctas, cualquier usuario empresarial de ChatGPT que siguió esa línea de pensamiento habría gastado más en inferencia de ChatGPT en 2025 que los usuarios que ofrecieron una cortesía mínima en los intercambios de ChatGPT.

Los autores sugieren que una posible solución sería establecer un límite de tokens en las respuestas, aunque este no es un enfoque que los sistemas LLM puedan implementar fácilmente. Observan que la solicitud es una herramienta débil para el control de costos, porque los LLM luchan por obedecer instrucciones de longitud explícitas. En la mayoría de los casos, esta directiva de ‘limitación’ no sería obedecida; además, la respuesta podría ser truncada, porque los LLM de este tipo están básicamente adivinando la próxima palabra probable en una oración/párrafo, y, como tal, no saben cómo termina la historia – o dónde termina la historia – hasta que el procesamiento esté completo. Por lo tanto, tienen una capacidad limitada para ‘dar marcha atrás’ a cualquier mecanismo en progreso a petición.

Sin una solución exacta – aunque sugiriendo que se implementen enfoques de precios más transparentes en casos de este tipo – los autores concluyen:

‘La sabiduría convencional sugiere que la cortesía en la solicitud es innecesaria cuando se interactúa con LLM.

‘En contraste, nuestro trabajo demuestra que las solicitudes no corteses aumentan los tokens de salida, generando costos adicionales para los adoptantes de IA empresarial.’

El nuevo documento se titula Transparencia de costos en la adopción de IA empresarial, y proviene de tres investigadores de la Universidad de Iowa.

Método

Los datos para el sistema se extrajeron del conjunto de datos WildChat, que comprende una colección de 1 millón de conversaciones entre usuarios y ChatGPT, y que cuenta con más de 2,5 millones de turnos de interacción:

De un sitio de apoyo para el proyecto WildChat, ejemplos de interacciones de ChatGPT. Fuente

Los autores observan que WildChat contiene una mayor cantidad de interacciones naturales que en algunos conjuntos más curados.

Eligen 20.000 solicitudes en inglés de los intercambios de GPT-4, descartando la salida en cada caso (ya que la intención era alimentar las solicitudes de nuevo para obtener respuestas novedosas). Solo se eligió la primera interacción, incluso de intercambios más largos,

El conjunto resultante se filtró en categorías cortés o no cortés, con todas las solicitudes clasificadas por GPT-4-Turbo. Los investigadores utilizaron el modelo en sí para decidir si una solicitud era cortés o no, porque la propia percepción del modelo de la cortesía era central para el experimento.

Las solicitudes etiquetadas como cortés podían incluir señales claras como la palabra ‘por favor’, o podían ser corteses de una manera más indirecta. Cualquier cosa que no se reconociera como cortés se clasificó como no cortés, incluso si la redacción era neutral en lugar de antagonista.

Para estudiar cómo el modelo respondía a la cortesía, no se podían utilizar métodos estándar (es decir, que tratan el texto como un conjunto de características medibles): ya que la cortesía estaba incrustada en la redacción en sí, resumir una solicitud como una lista de rasgos habría perdido un contexto importante.

En su lugar, cada solicitud se reescribió para invertir su tono, manteniendo todos los demás elementos lo más similares posible, lo que permitió comparar entre pares que difirieron solo en cortesía:

Ejemplos de cómo se transformaron las solicitudes corteses y no corteses en sus versiones contrafácticas, preservando el significado semántico. Fuente

Pruebas

Cada solicitud original se emparejó con una versión reescrita que difirió solo en su nivel de cortesía, y ambas versiones se presentaron al mismo modelo GPT-4-Turbo a través de llamadas de API separadas. Se registró la cantidad de tokens producidos en respuesta a cada versión, y la diferencia entre ellos se trató como la medida de cómo el tono influyó (en el costo de los tokens).

La temperatura se mantuvo constante para evitar la variación aleatoria, y se conservaron los pares de solicitudes solo cuando la reescritura alteró la entrada en no más de cinco tokens. Esto aseguró que el efecto que se estaba estudiando surgiera del tono, en lugar de cualquier cambio más amplio en la redacción:

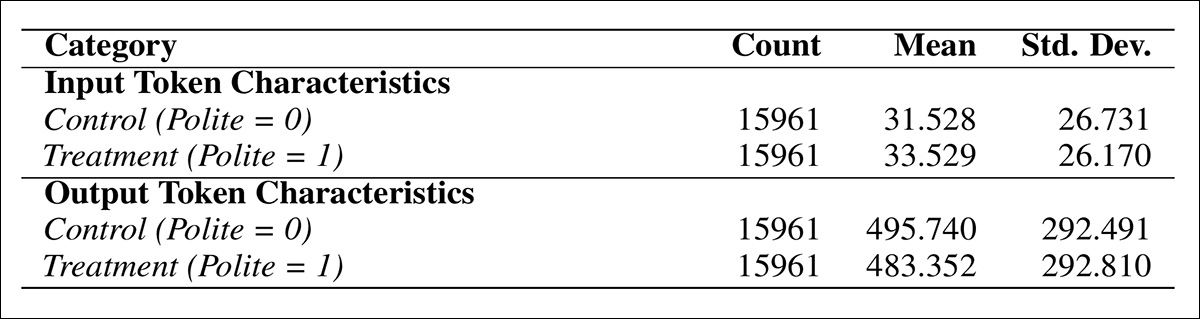

Estadísticas resumidas que muestran que las solicitudes corteses resultaron en menos tokens de salida en promedio que las solicitudes no corteses, a pesar de tener ligeramente más tokens de entrada.

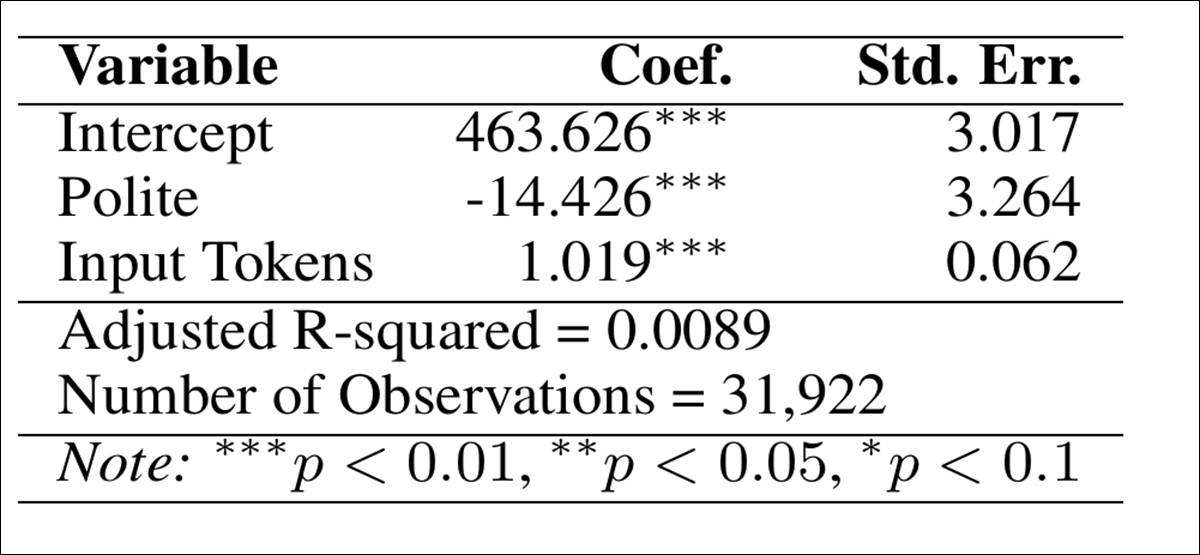

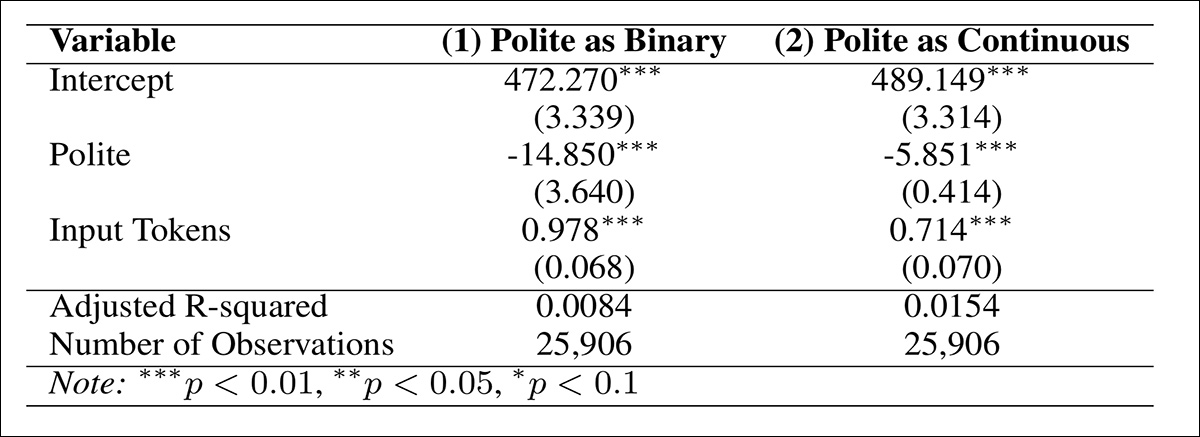

Los resultados principales de la primera ronda de pruebas indicaron que el uso de una solicitud cortés reduce la longitud de los tokens de salida en 14,426 tokens:

Resultados de estimación que describen el efecto del formato de solicitud cortés en la longitud de los tokens de salida generados.

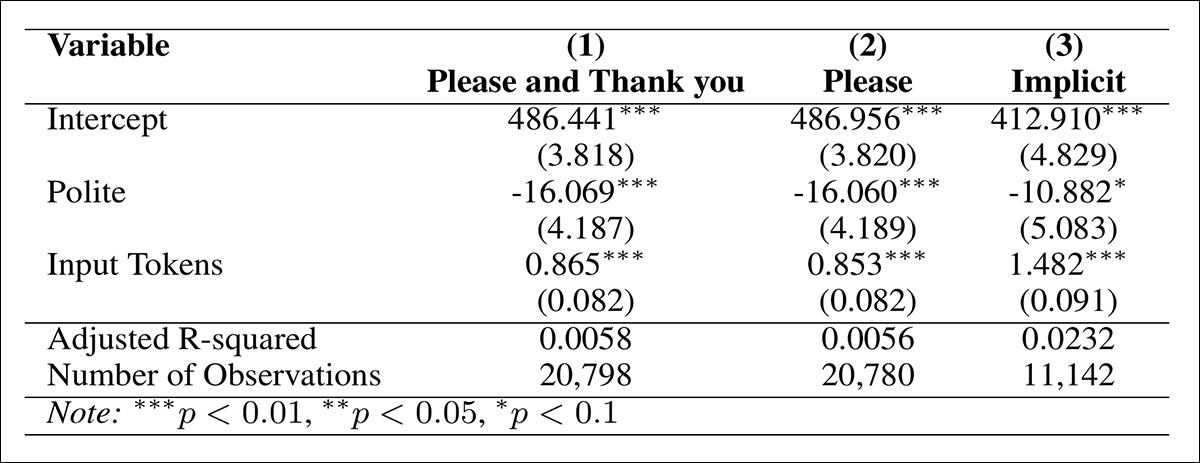

El análisis se repitió en tres subconjuntos de solicitudes corteses para probar la robustez: solicitudes que usaban marcadores explícitos como ‘por favor’ o ‘gracias’; aquellas que usaban solo ‘por favor’; y aquellas con cortesía implícita, como ‘¿puedes’ o ‘¿podrías’:

Resultados de estimación basados en tipos de cortesía.

Para validar la robustez de los hallazgos principales, se realizó una clasificación secundaria de la cortesía de la solicitud utilizando el marco LIWC, que proporciona una puntuación determinista y repetible para las características lingüísticas.

A diferencia de la clasificación probabilística de GPT, LIWC puede asignar una puntuación de cortesía estable a cada solicitud, lo que permite evaluar la coherencia en diferentes métodos. En esta parte de las pruebas, las solicitudes se etiquetaron como cortés si su puntuación de cortesía LIWC era mayor que cero, y como no cortés de lo contrario.

Cuando se midió la coincidencia entre las clasificaciones LIWC y GPT, se observó una tasa de coincidencia del 81%. Si bien no es una medida de precisión, este acuerdo brindó apoyo a la coherencia entre los sistemas.

Cuando solo se analizaron las solicitudes con etiquetas de cortesía coincidentes de GPT y LIWC, las solicitudes corteses aún llevaron a 14 tokens menos; y cuando la cortesía se midió en una escala continua, cada paso hacia arriba en la cortesía redujo la salida en cinco tokens en promedio:

Los ahorros de tokens de la cortesía se mantuvieron cuando se reclasificaron con LIWC, tanto como una etiqueta binaria como una puntuación continua.

Resiliencia

Para evaluar si el efecto de la cortesía variaba en diferentes tipos de solicitudes, cada solicitud se asignó a una de varias categorías de tareas predefinidas: de búsqueda de información; de generación de texto; de edición y reescritura; de clasificación; de resumen; y tareas técnicas.

Cada solicitud se asignó una etiqueta de tarea comparando su incrustación con las de las descripciones de tareas predefinidas, utilizando el modelo all-MiniLM-L6-v2 Sentence Transformers.

Se calcularon las puntuaciones de similitud coseno entre cada solicitud y el conjunto de definiciones de tareas, y se asignó la etiqueta con la mayor similitud.

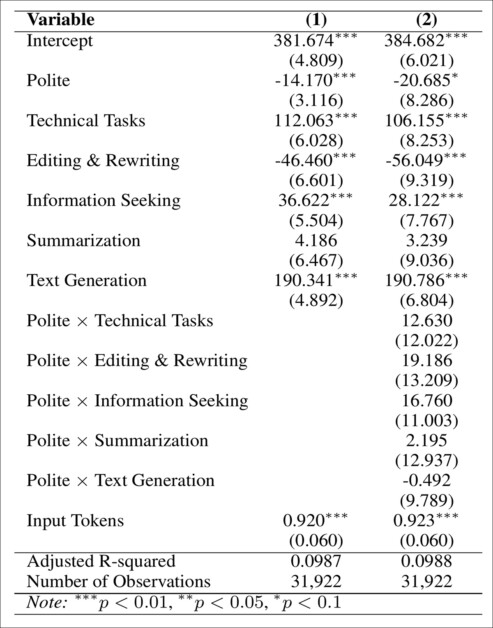

Los tipos de tareas se repurposaron como variables de control en la regresión, para probar si el efecto de la cortesía variaba según la categoría de la solicitud, e incluso se introdujeron términos de interacción entre la tarea y el tratamiento, para comprobar la existencia de efectos diferenciales.

En ambos casos, las solicitudes corteses produjeron consistentemente salidas más cortas, y no se encontró variación significativa en los tipos de tareas:

Resultados de regresión que demuestran que las solicitudes corteses redujeron la longitud de la salida en todos los tipos de tareas, sin efectos de interacción significativos.

Para probar si las respuestas más cortas de las solicitudes corteses reflejaban una calidad reducida, se compararon las salidas de las solicitudes originales y contrafácticas para la similitud semántica. Utilizando el modelo all-MiniLM-L6-v2, cada respuesta se incrustó en un espacio vectorial semántico, y se calculó la similitud coseno entre cada par, lo que produjo una similitud promedio de 0,78, lo que indica una fuerte alineación en el significado, y sugiere que el contenido se mantuvo consistente incluso cuando el tono cambió.

Palabras de parada

Para comprender qué tipo de contenido se reduce en salidas más cortas, se examinaron las palabras más frecuentemente eliminadas. Estas resultaron ser palabras de parada comunes como ‘tener’, ‘más’, ‘dónde’, y ‘en’, es decir, términos que sirven a roles gramaticales en lugar de semánticos.

Para confirmar que la reducción de tokens no se debía a la pérdida de contenido significativo, se eliminaron las palabras de parada, y se analizaron frases de hasta cuatro palabras para la desaparición sistemática; sin embargo, no se encontraron patrones consistentes o semanticamente importantes, lo que sugiere que las reducciones de la redacción cortés no estaban eliminando contenido significativo o útil.

Así, todavía parecía que se gastaban más tokens en respuestas a consultas groseras que en respuestas a consultas corteses – como una especie de ‘impuesto’ a la brusquedad.

Estudio humano

Para probar si la calidad de la salida se veía afectada por el tono de la solicitud, también se realizó una evaluación humana, utilizando una muestra aleatoria de veinte pares de solicitudes corteses y veinte pares de solicitudes no corteses.

Después de excluir las solicitudes sobre temas sensibles o técnicos, las respuestas se calificaron por 401 participantes en una escala de siete puntos. Cada participante solo vio una respuesta, extraída de una de las cuatro condiciones: cortés o no cortés, y original o contrafáctica.

No se encontraron diferencias significativas en la calidad percibida en ninguna de estas condiciones. Las salidas corteses y no corteses recibieron puntuaciones casi idénticas, al igual que las versiones originales y contrafácticas.

Los autores afirman que estos resultados indican que la reducción en los tokens de salida no se debió a una pérdida de calidad, sino a una reredacción, o a cambios estructurales que, sin embargo, preservaron el significado.

La diferencia de costo observada en la solicitud empresarial es, por lo tanto, poco probable que refleje cambios en la utilidad o la claridad, y el ‘impuesto’ todavía está operativo.

Conclusión

Aunque el nuevo trabajo se concentra en el uso empresarial de ChatGPT, los usuarios de menor nivel también se ven afectados por este síndrome, ya que incluso los dos niveles de entrada tienen límites de uso; y –presumiblemente– tratar a ChatGPT de manera grosera acelerará el agotamiento de la asignación diaria de tokens del usuario promedio.

El nuevo estudio se centra en una pregunta abierta y muy estudiada en las interacciones humano/IA; pero los autores enfatizan que los problemas relacionados con la cortesía deben tomarse como indicadores de un posible pozo más profundo de rarezas lingüísticas, aún no descubiertas, que pueden resultar impactando en los cargos por inferencia.

Publicado por primera vez el miércoles 19 de noviembre de 2025