Inteligencia artificial

Evolución de la razonamiento de IA: De cadenas a estrategias iterativas y jerárquicas

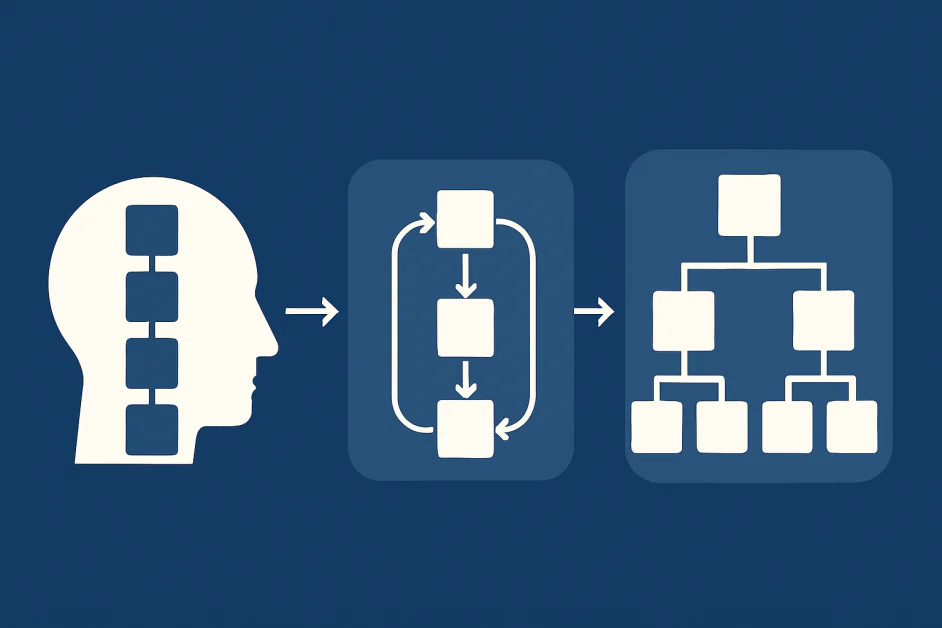

Durante los últimos años, chain-of-thought prompting se ha convertido en el método central para el razonamiento en grandes modelos de lenguaje. Al animar a los modelos a “pensar en voz alta”, los investigadores encontraron que las explicaciones paso a paso mejoran la precisión en áreas como las matemáticas y la lógica. Sin embargo, a medida que las tareas crecen en complejidad, los límites de CoT se vuelven claros. La dependencia de CoT en ejemplos de razonamiento cuidadosamente elegidos hace que sea difícil manejar tareas que son demasiado simples o más difíciles que esos ejemplos. Si bien CoT introdujo el pensamiento estructurado en los modelos de lenguaje, el campo ahora demanda nuevos enfoques que puedan manejar problemas complejos y multi-paso con complejidades variables. Como resultado, los investigadores ahora están explorando nuevas estrategias como el razonamiento iterativo y jerárquico. Estos métodos apuntan a hacer que el razonamiento sea más profundo, eficiente y robusto. Este artículo explica los límites de CoT, explora la evolución de CoT y examina aplicaciones, desafíos y direcciones futuras para escalar el razonamiento de IA.

Los límites de la cadena de pensamiento

El razonamiento de CoT ayudó a los modelos a manejar tareas complejas al descomponerlas en pasos más pequeños. Esta capacidad no solo mejoró los resultados de los benchmarks en concursos de matemáticas, rompecabezas lógicos y tareas de programación, sino que también proporciona algo de transparencia al exponer los pasos intermedios. A pesar de estos beneficios, sin embargo, CoT no está exento de desafíos. La investigación muestra que CoT funciona mejor en problemas que requieren razonamiento simbólico o cálculo preciso. Sin embargo, para preguntas de respuesta abierta, razonamiento basado en el sentido común o recuerdo de hechos, a menudo agrega poco o incluso reduce la precisión.

CoT es esencialmente lineal en su naturaleza. El modelo genera una sola secuencia de pasos que conduce a una respuesta. Esto funciona bien para problemas cortos y bien definidos, pero lucha cuando las tareas requieren exploración más profunda. Además, el razonamiento complejo a menudo implica ramificación, retroceso y revisión de suposiciones. Una sola cadena lineal no puede capturar esto. Si el modelo comete un error temprano, todos los pasos siguientes colapsan. Incluso cuando el razonamiento es correcto, las salidas lineales no pueden adaptarse a nueva información o volver a comprobar suposiciones anteriores. El razonamiento del mundo real requiere flexibilidad que CoT no proporciona.

Los investigadores también resaltan problemas de escalabilidad. A medida que los modelos enfrentan tareas más difíciles, las cadenas se vuelven más largas y frágiles. Muestrear múltiples cadenas puede ayudar, pero pronto se vuelve ineficiente. La pregunta es cómo moverse de un razonamiento estrecho y de un solo camino a estrategias más robustas.

Razonamiento iterativo como próximo paso

Una dirección prometedora es iteración. En lugar de producir una respuesta final en un solo paso, el modelo se involucra en ciclos de razonamiento, evaluación y refinamiento. Esto refleja cómo las personas resuelven problemas difíciles al primero esbozar una solución, comprobarla, identificar debilidades y mejorarla paso a paso.

Los métodos iterativos permiten que los modelos se recuperen de errores y exploren soluciones alternativas. Crean un bucle de retroalimentación donde el modelo critica su propio razonamiento, o donde múltiples modelos critican entre sí. Una idea poderosa es autoconsistencia. En lugar de confiar en una sola cadena de pensamiento, el modelo muestrea muchos caminos de razonamiento y luego elige la respuesta más común. Esto imita a un estudiante que intenta el problema de varias maneras antes de confiar en una respuesta. Investigaciones mostraron que la agregación de múltiples caminos de razonamiento mejora la confiabilidad. Trabajos más recientes extienden esta idea a iteraciones estructuradas donde las salidas se verifican, corrigen y expanden repetidamente.

Esta capacidad también permite que los modelos utilicen herramientas externas. La iteración facilita la integración de motores de búsqueda, solvers o sistemas de memoria en el bucle. En lugar de comprometerse con una sola respuesta, el modelo puede consultar recursos externos, reconsiderar su razonamiento y revisar sus pasos. La iteración convierte el razonamiento en un proceso dinámico en lugar de una cadena estática.

Enfoques jerárquicos para la complejidad

La iteración sola no es suficiente cuando las tareas crecen muy grandes. Para problemas que requieren horizontes largos o planificación multi-etapa, la jerarquía es esencial. Los humanos utilizan el razonamiento jerárquico todo el tiempo. Descomponemos tareas en subproblemas, establecemos metas y trabajamos a través de ellas en capas estructuradas. Los modelos necesitan la misma capacidad.

Métodos jerárquicos permiten que un modelo descomponga una tarea en pasos más pequeños y los resuelva en paralelo o en secuencia. La investigación sobre programa de pensamiento y árbol de pensamientos destaca esta dirección. En lugar de una cadena plana, el razonamiento se organiza como un árbol o grafo donde se pueden explorar y podar múltiples caminos. Esto hace posible buscar a través de diferentes estrategias y seleccionar la más prometedora. En esta dirección, un nuevo desarrollo es el marco Bosque de pensamientos, que lanza muchos “árboles” de razonamiento al mismo tiempo y utiliza consenso y corrección de errores entre ellos. Cada árbol puede explorar un camino diferente; los árboles que parecen poco prometedores se podan, mientras que los mecanismos de auto-corrección permiten que el modelo detecte y corrija errores en cualquier rama. Al combinar los votos de todos los árboles, el modelo toma una decisión colectiva.

La jerarquía también permite la coordinación. Las tareas grandes se pueden distribuir entre agentes que manejan diferentes partes del problema. Un agente puede centrarse en la planificación, otro en el cálculo y otro en la verificación. Los resultados pueden integrarse en una solución coherente única. Experimentos tempranos en razonamiento multi-agente sugieren que dicha división del trabajo puede superar a los métodos de cadena única.

Verificación y confiabilidad

Otra fortaleza de las estrategias iterativas y jerárquicas es que permiten naturalmente la verificación. La cadena de pensamiento expone los pasos de razonamiento, pero no garantiza su corrección. Con bucles iterativos, los modelos pueden verificar sus propios pasos o que otros modelos los verifiquen. Con la jerarquía, diferentes niveles se pueden verificar de forma independiente.

Esto abre la puerta a tuberías de evaluación estructuradas. Por ejemplo, un modelo puede generar soluciones candidatas en un nivel inferior, mientras que un controlador de nivel superior selecciona o refina esas soluciones. O un verificador externo podría probar las salidas contra restricciones antes de aceptarlas. Estos mecanismos hacen que el razonamiento sea menos frágil y más confiable.

La verificación no se trata solo de precisión. También mejora la interpretación. Al organizar el razonamiento en capas o iteraciones, los investigadores pueden inspeccionar más fácilmente dónde ocurren los fallos. Esto apoya tanto la depuración como la alineación, dando a los desarrolladores más control sobre cómo los modelos razonan.

Aplicaciones

Estrategias de razonamiento avanzadas ya están en uso en various campos. En ciencia, apoyan la resolución de problemas en matemáticas avanzadas e incluso ayudan a redactar propuestas de investigación. En programación, los modelos ahora funcionan bien en codificación competitiva, depuración y ciclos de desarrollo de software completos.

Los dominios legales y empresariales se benefician del análisis de contratos complejos y la planificación estratégica. Los sistemas de IA agente combinan el razonamiento con el uso de herramientas, gestionando operaciones multi-paso a través de API, bases de datos y la web. En educación, los sistemas de tutoría pueden explicar conceptos paso a paso y brindar orientación personalizada.

Desafíos y preguntas abiertas

A pesar de la promesa de los métodos iterativos y jerárquicos, aún hay muchos desafíos que abordar. Uno es la eficiencia. Los bucles iterativos y las búsquedas en árboles pueden ser computacionalmente costosos. Equilibrar la exhaustividad con la velocidad es un problema abierto.

Otro desafío es el control. Asegurarse de que los modelos sigan estrategias útiles en lugar de desviarse hacia bucles improductivos es difícil. Los investigadores están explorando métodos para guiar el razonamiento con heurísticas, algoritmos de planificación o controladores aprendidos, pero el campo aún es joven.

La evaluación también es una pregunta abierta. Los benchmarks tradicionales de precisión solo capturan los resultados, no la calidad de los procesos de razonamiento. Se necesitan nuevos marcos de evaluación para medir la robustez, adaptabilidad y transparencia de las estrategias de razonamiento.

Finalmente, existen preocupaciones de alineación. El razonamiento iterativo y jerárquico puede amplificar tanto las fortalezas como las debilidades de los modelos. Mientras que pueden hacer que el razonamiento sea más confiable, también lo hacen más difícil de predecir cómo los modelos se comportarán en escenarios abiertos. Se requiere un diseño y supervisión cuidadosos para evitar nuevos riesgos.

En resumen

La cadena de pensamiento abrió la puerta al razonamiento estructurado en IA, pero sus límites lineales son claros. El futuro radica en estrategias iterativas y jerárquicas que hacen que el razonamiento sea más adaptable, verificable y escalable. Al utilizar ciclos de refinamiento y resolución de problemas en capas, la IA puede moverse de cadenas de pasos frágiles a sistemas de razonamiento dinámicos y robustos capaces de abordar la complejidad del mundo real.