Ética

Las prácticas actuales de IA podrían estar permitiendo una nueva generación de trolls de derechos de autor

Una nueva colaboración de investigación entre Huawei y la academia sugiere que una gran parte de la investigación más importante actual en inteligencia artificial y aprendizaje automático podría estar expuesta a litigios tan pronto como se vuelva comercialmente prominente, porque los conjuntos de datos que hacen posible los avances están siendo distribuidos con licencias inválidas que no respetan los términos originales de los dominios de acceso público desde los que se obtuvieron los datos.

En efecto, esto tiene dos resultados casi inevitables: que los algoritmos de IA muy exitosos y comercializados que se sabe que han utilizado dichos conjuntos de datos se convertirán en objetivos futuros de trolls de patentes oportunistas cuyos derechos de autor no fueron respetados cuando se extrajeron sus datos; y que las organizaciones y los individuos podrán utilizar estas mismas vulnerabilidades legales para protestar por la implementación o difusión de tecnologías de aprendizaje automático que consideren objetables.

El documento se titula ¿Puedo usar este conjunto de datos de acceso público para construir software de IA comercial? Probablemente no, y es una colaboración entre Huawei Canadá y Huawei China, junto con la Universidad de York en el Reino Unido y la Universidad de Victoria en Canadá.

Cinco de seis conjuntos de datos de código abierto no son legalmente utilizables

Para la investigación, los autores pidieron a los departamentos de Huawei que seleccionaran los conjuntos de datos de código abierto más deseables que les gustaría explotar en proyectos comerciales, y seleccionaron los seis conjuntos de datos más solicitados de las respuestas: CIFAR-10 (un subconjunto del conjunto de datos 80 millones de imágenes pequeñas, desde retirado por ‘términos denigrantes’ y ‘imágenes ofensivas’, aunque sus derivados proliferan); ImageNet; Cityscapes (que contiene material exclusivamente original); FFHQ; VGGFace2, y MSCOCO.

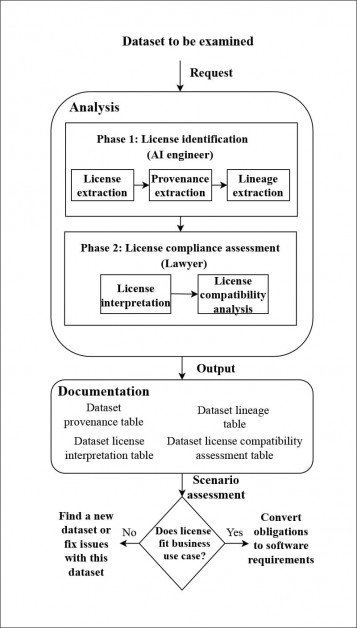

Para analizar si los conjuntos de datos seleccionados eran adecuados para su uso legal en proyectos comerciales, los autores desarrollaron una nueva tubería para rastrear la cadena de licencias tanto como fuera posible para cada conjunto, aunque a menudo tuvieron que recurrir a capturas de archivo web para localizar licencias de dominios que ya habían caducado, y en ciertos casos tuvieron que ‘adivinar’ el estado de la licencia a partir de la información más cercana disponible.

Arquitectura para el sistema de trazabilidad de procedencia desarrollado por los autores. Fuente: https://arxiv.org/pdf/2111.02374.pdf

Los autores encontraron que las licencias de cinco de los seis conjuntos de datos ‘contienen riesgos asociados con al menos un contexto de uso comercial’:

‘[Observamos] que, excepto MS COCO, ninguna de las licencias estudiadas permite a los practicantes el derecho de comercializar un modelo de IA entrenado con los datos o incluso la salida del modelo de IA entrenado. Tal resultado también impide efectivamente a los practicantes utilizar incluso modelos preentrenados entrenados con estos conjuntos de datos. Los conjuntos de datos y modelos de IA de acceso público que están preentrenados en ellos están siendo ampliamente utilizados comercialmente.’ *

Los autores también señalan que tres de los seis conjuntos de datos estudiados podrían resultar adicionalmente en una violación de la licencia en productos comerciales si el conjunto de datos se modifica, ya que solo MS-COCO permite esto. Sin embargo, la ampliación de datos y los subconjuntos y superconjuntos de conjuntos de datos influyentes son una práctica común.

En el caso de CIFAR-10, los compiladores originales no crearon ninguna forma convencional de licencia, solo requiriendo que los proyectos que utilicen el conjunto de datos incluyan una cita al artículo original que acompañó la publicación del conjunto de datos, presentando una obstrucción adicional para establecer el estado legal de los datos.

Además, solo el conjunto de datos CityScapes contiene material que es exclusivamente generado por los originadores del conjunto de datos, en lugar de ser ‘curado’ (extraído) de fuentes de red, con CIFAR-10 e ImageNet utilizando múltiples fuentes, cada una de las cuales necesitaría ser investigada y rastreada para establecer algún tipo de mecanismo de derechos de autor (o incluso una renuncia significativa).

No hay salida

Hay tres factores que las empresas de IA comerciales parecen estar confiando para protegerse de litigios en torno a productos que han utilizado contenido con derechos de autor de conjuntos de datos libremente y sin permiso, para entrenar algoritmos de IA. Ninguno de estos ofrece mucha (o alguna) protección a largo plazo confiable:

1: Leyes nacionales de laissez faire

Aunque los gobiernos de todo el mundo están obligados a relajar las leyes sobre la extracción de datos para no quedarse atrás en la carrera hacia la IA performante (que depende de grandes cantidades de datos del mundo real para los cuales el cumplimiento regular de los derechos de autor y la licencia sería poco realista), solo los Estados Unidos ofrecen inmunidad total en este respecto, bajo la Doctrina de Uso Justo – una política que fue ratificada en 2015 con la conclusión de Authors Guild v. Google, Inc., que afirmó que el gigante de la búsqueda podría ingerir libremente material con derechos de autor para su proyecto Google Books sin ser acusado de infracción.

Si la política de la Doctrina de Uso Justo cambia alguna vez (es decir, en respuesta a otro caso emblemático que involucre a organizaciones o corporaciones lo suficientemente poderosas), probablemente se consideraría un estado a priori en términos de explotar bases de datos actuales que infringen los derechos de autor, protegiendo el uso anterior; pero no el uso y desarrollo continuo de sistemas que fueron habilitados a través de material con derechos de autor sin acuerdo.

Esto pone la protección actual de la Doctrina de Uso Justo en una base muy provisional, y podría potencialmente, en ese escenario, requerir que los algoritmos de aprendizaje automático comercializados y establecidos cesen su operación en casos donde su origen se habilitó mediante material con derechos de autor sin permiso – incluso en casos donde los pesos del modelo ahora tratan exclusivamente con contenido permitido, pero se entrenaron en (y se volvieron útiles por) contenido copiado ilegalmente.

Fuera de los EE. UU., como señalan los autores en el nuevo documento, las políticas son generalmente menos indulgentes. El Reino Unido y Canadá solo indemnizan el uso de datos con derechos de autor para fines no comerciales, mientras que la Ley de Minería de Texto y Datos de la UE (que no ha sido completamente anulada por las recientes propuestas para una regulación de IA más formal) también excluye la explotación comercial para sistemas de IA que no cumplen con los requisitos de derechos de autor de los datos originales.

Estos últimos arreglos significan que una organización puede lograr grandes cosas con los datos de otras personas, hasta – pero no incluyendo – el punto de ganar dinero con ello. En ese momento, el producto sería legalmente expuesto, o se necesitarían acuerdos con literalmente millones de titulares de derechos de autor, muchos de los cuales ahora son inidentificables debido a la naturaleza cambiante de Internet – una perspectiva imposible y poco rentable.

2: Caveat Emptor

En casos donde las organizaciones infractoras esperan diferir la culpa, el nuevo documento también observa que muchas licencias para los conjuntos de datos de código abierto más populares se autoindemnizan contra cualquier reclamo de abuso de derechos de autor:

‘Por ejemplo, la licencia de ImageNet requiere explícitamente que los practicantes indemnicen al equipo de ImageNet contra cualquier reclamo que surja del uso del conjunto de datos. Los conjuntos de datos FFHQ, VGGFace2 y MS COCO requieren que el conjunto de datos, si se distribuye o modifica, se presente bajo la misma licencia.’

En efecto, esto fuerza a aquellos que utilizan conjuntos de datos de código abierto a absorber la culpabilidad por el uso de material con derechos de autor, en caso de litigio eventual (aunque no necesariamente protege a los compiladores originales en un caso donde el clima actual de ‘puerto seguro’ se ve comprometido).

3: Indemnidad a través de la oscuridad

La naturaleza colaborativa de la comunidad de aprendizaje automático hace que sea bastante difícil utilizar el ocultismo corporativo para ocultar la presencia de algoritmos que se han beneficiado de conjuntos de datos que infringen los derechos de autor. Los proyectos comerciales a largo plazo a menudo comienzan en entornos de código abierto donde el uso de conjuntos de datos es un asunto de registro, en GitHub y otros foros de acceso público, o donde los orígenes del proyecto han sido publicados en preimpresos o artículos revisados por pares.

Incluso cuando esto no es el caso, la inversión de modelo es cada vez más capaz de revelar las características típicas de los conjuntos de datos (o incluso salida explícita de some del material de origen), ya sea proporcionando pruebas en sí mismas, o suficiente sospecha de infracción para permitir el acceso ordenado por el tribunal a la historia del desarrollo del algoritmo, y detalles de los conjuntos de datos utilizados en ese desarrollo.

Conclusión

El documento describe un uso caótico y ad hoc de material con derechos de autor obtenido sin permiso, y de una serie de cadenas de licencias que, seguidas lógicamente tanto como sea posible hacia la fuente original de los datos, requerirían negociaciones con miles de titulares de derechos de autor cuyo trabajo se presentó bajo la égida de sitios con una amplia variedad de términos de licencia, muchos de los cuales excluyen obras derivadas comerciales.

Los autores concluyen:

‘Los conjuntos de datos de acceso público se están utilizando ampliamente para construir software de IA comercial. Uno puede hacerlo si [y] solo si la licencia asociada con el conjunto de datos de acceso público proporciona el derecho de hacerlo. Sin embargo, no es fácil verificar los derechos y obligaciones proporcionados en la licencia asociada con los conjuntos de datos de acceso público. Porque, a veces la licencia es either poco clara o potencialmente inválida.’

Otra nueva obra, titulada Construyendo conjuntos de datos legales, publicada el 2 de noviembre por el Centro de Derecho Computacional de la Universidad de Gestión de Singapur, también enfatiza la necesidad de que los científicos de datos reconozcan que la era de la recopilación de datos ad hoc está llegando a su fin, y refleja las recomendaciones del documento de Huawei para adoptar hábitos y metodologías más estrictas para asegurarse de que el uso de conjuntos de datos no exponga un proyecto a ramificaciones legales a medida que la cultura cambia con el tiempo, y a medida que la actividad académica global actual en el sector de aprendizaje automático busca una rentabilidad comercial de años de inversión. El autor observa*:

‘[El] corpus de legislación que afecta a los conjuntos de datos de ML está a punto de crecer, en medio de preocupaciones de que las leyes actuales ofrecen protecciones insuficientes safeguards. El proyecto de Ley de IA de la UE, si se aprueba, alteraría significativamente el panorama de gobernanza de la IA y los datos; otras jurisdicciones pueden seguir el ejemplo con sus propias leyes. ‘

* Mi conversión de citas en línea a hipervínculos