Ángulo de Anderson

Los AIs de codificación tienden a sufrir del efecto Dunning-Kruger

Una nueva investigación muestra que los AIs de codificación, como ChatGPT, sufren del efecto Dunning-Kruger, actuando con mayor confianza cuando son menos competentes. Al abordar lenguajes de programación desconocidos o poco comunes, afirman una alta certeza incluso cuando sus respuestas se desmoronan. El estudio relaciona la sobreconfianza del modelo con un rendimiento deficiente y la falta de datos de entrenamiento, lo que plantea nuevas preocupaciones sobre cuánto realmente saben estos sistemas sobre lo que no saben.

Cualquiera que haya pasado incluso una cantidad moderada de tiempo interactuando con Modelos de Lenguaje Grande sobre asuntos factuales ya sabrá que los LLMs a menudo están dispuestos a dar una respuesta confidentemente incorrecta a una consulta del usuario.

Junto con formas más obvias de alucinación, la razón de esta jactancia vacía no es del 100% clara. La investigación publicada durante el verano sugiere que los modelos dan respuestas confiadas incluso cuando saben que están equivocados, por ejemplo; aunque otras teorías atribuyen la sobreconfianza a elecciones arquitectónicas, entre otras posibilidades.

Lo que el usuario final puede estar seguro es que la experiencia es increíblemente frustrante, ya que estamos programados para tener fe en las estimaciones de las personas de sus propias habilidades (no menos porque en tales casos hay consecuencias, legales y de otro tipo, para una persona que se sobrevalora y no cumple); y una especie de transferencia antropomórfica significa que tendemos a replicar este comportamiento con sistemas de inteligencia artificial conversacional.

Pero un LLM es una entidad sin responsabilidad que puede y efectivamente devolver un ‘¡Ups! Butterfingers…’ después de que ha ayudado al usuario a destruir involuntariamente algo importante, o al menos desperdiciar una tarde de su tiempo; asumiendo que admitirá la responsabilidad en absoluto.

Peor aún, esta falta de circunspección prudente parece imposible de evitar, al menos en ChatGPT, que abundará en asegurar al usuario la validez de sus consejos y explicará los defectos de su pensamiento solo después de que el daño esté hecho. Ni actualizar la memoria persistente del sistema, ni el uso de prompts repetitivos parecen tener mucho impacto en el problema.

Las personas también pueden ser igualmente obstinadas y autoengañadas – aunque cualquier persona que se equivocara tan profundamente y con frecuencia probablemente sería despedida temprano. Tales como estos sufren del opuesto al ‘síndrome del impostor’ (donde un empleado teme haber sido ascendido por encima de sus capacidades) – el efecto Dunning Kruger, donde una persona sobrestima significativamente su capacidad para realizar una tarea.

El costo de la inflación

Un nuevo estudio de Microsoft examina el valor del efecto Dunning-Kruger en relación con el rendimiento efectivo de las arquitecturas de codificación asistidas por IA (como el propio Copilot de Redmond), en un esfuerzo de investigación que es el primero en abordar específicamente este subsector de los LLMs.

El trabajo analiza cómo los AIs de codificación califican confiadamente sus propias respuestas contra cómo realmente se desempeñan, en decenas de lenguajes de programación. Los resultados muestran un patrón humano: cuando los modelos eran menos capaces, estaban más seguros de sí mismos.

El efecto fue más fuerte en lenguajes poco comunes o de baja recursos, donde los datos de entrenamiento eran delgados – el modelo más débil o el lenguaje más raro, la mayor ilusión de habilidad:

Rendimiento real y percibido de GPT-4o en lenguajes de programación, ordenados por rendimiento real. Fuente: https://arxiv.org/pdf/2510.05457

Los cuatro autores, todos contribuyentes iguales que trabajan para Microsoft, afirman que el trabajo plantea nuevas preguntas sobre cuánto se puede confiar en estas herramientas para juzgar su propia producción, y declaran:

‘Al analizar la confianza del modelo y el rendimiento en un conjunto diverso de lenguajes de programación, revelamos que los modelos de IA imitan patrones humanos de sobreconfianza, especialmente en dominios desconocidos o de baja recursos.

‘Nuestros experimentos demuestran que los modelos menos competentes y aquellos que operan en lenguajes de programación raros exhiben un sesgo DKE más fuerte, lo que sugiere que la fuerza del sesgo es proporcional a la competencia de los modelos. Esto se alinea con experimentos humanos sobre el sesgo.’

Los investigadores contextualizan esta línea de estudio como una forma de comprender cómo la confianza del modelo se vuelve poco confiable cuando el rendimiento es débil, y para probar si los sistemas de IA exhiben el mismo tipo de sobreconfianza que se ve en los humanos – con implicaciones para la confianza y el despliegue práctico.

Aunque el nuevo documento desafía la ley de titulares de Betteridge, tiene el título ¿Sufren los modelos de codificación del efecto Dunning-Kruger?. Si bien los autores declaran que se ha lanzado el código para el trabajo, la versión actual del preprint no lleva ningún detalle sobre esto.

Método

El estudio probó cómo podían juzgar con precisión los AIs de codificación sus propias respuestas al darles miles de preguntas de opción múltiple de programación, con cada pregunta perteneciente a un dominio de lenguaje específico, desde Python y Java hasta Perl y COBOL:

Dominios de lenguaje de programación utilizados en el estudio, junto con el número de preguntas de codificación de opción múltiple muestreadas para cada dominio.

Los modelos se les pidió que eligieran la opción correcta y luego estimaran cuán seguros estaban de su elección, con su rendimiento real medido por cuán a menudo obtuvieron la respuesta correcta – y su confianza autoevaluada indicando cuán bueno creían que era. Comparar estas dos métricas permitió a los investigadores ver dónde divergían la confianza y la competencia.

Para medir cuán seguros parecían estar los modelos, el estudio utilizó dos métodos: confianza absoluta y confianza relativa. En el primero, se le pidió al modelo que diera una puntuación de cero a uno junto con cada respuesta, con su confianza para un lenguaje determinado definida por el promedio de esas puntuaciones en preguntas de ese lenguaje.

El segundo método examinó cuán seguros estaban los modelos al elegir entre dos preguntas; para cada par, el modelo tenía que decir cuál estaba más seguro. Estas elecciones se calificaron utilizando sistemas de clasificación originalmente diseñados para juegos competitivos, tratando cada pregunta como si fuera un jugador en un partido. Las puntuaciones finales se normalizaron y promediaron para cada lenguaje para dar una puntuación de confianza relativa.

Se examinan dos formas establecidas del efecto Dunning-Kruger: una que rastrea cómo un solo modelo malinterpreta su rendimiento en diferentes dominios; y otra que compara los niveles de confianza entre modelos más débiles y más fuertes.

La primera forma, llamada DKE intra-participante, busca si un solo modelo se vuelve más sobreconfiado en lenguajes donde se desempeña mal. La segunda, DKE inter-participante, pregunta si los modelos que se desempeñan peor en general también tienden a calificar más alto.

En ambos casos, la brecha entre la confianza y el rendimiento real se utiliza para medir la sobreconfianza, con brechas más grandes en configuraciones de bajo rendimiento que apuntan a un comportamiento similar al DKE.

Resultados

El estudio prueba el efecto Dunning-Kruger en seis grandes modelos de lenguaje: Mistral; Phi-3; DeepSeek-Distill; Phi-4; GPT-0.1, y GPT-4o.

Cada modelo se probó en preguntas de opción múltiple de programación del conjunto de datos CodeNet de acceso público, con 37 lenguajes* representados para revelar cómo variaban la confianza y la precisión en dominios de codificación familiares y oscuros.

El análisis entre modelos muestra un patrón claro de Dunning-Kruger:

Rendimiento real versus percibido en seis modelos de codificación, mostrando cómo los modelos de menor rendimiento, como Mistral y Phi-3, exhiben una alta confianza a pesar de una mala precisión, mientras que los modelos más fuertes, como GPT-4o, muestran un comportamiento más calibrado o incluso poco confiado.

Los modelos con menor precisión, incluidos Mistral y Phi-3, tendían a sobreestimar sus propias habilidades, mientras que los sistemas de mayor rendimiento, como GPT-4o, mostraron niveles de confianza que se ajustaban más estrechamente a su rendimiento real, particularmente cuando se juzgaba por confianza relativa.

Los resultados también indican que los modelos más capaces pueden subestimarse a veces (un patrón que las puntuaciones de confianza absoluta no capturan).

Los resultados también indican que el análisis intra-modelo también apoya la presencia del efecto Dunning-Kruger. En el gráfico de resultados mostrado al comienzo del artículo, vemos cómo cada modelo se desempeñó en diferentes lenguajes de programación, ordenados por rendimiento real.

En lenguajes donde los modelos obtuvieron malas puntuaciones, particularmente en lenguajes raros o de baja recursos como COBOL, Prolog y Ceylon, su confianza era notablemente mayor que la justificada por sus resultados. En lenguajes bien conocidos como Python y JavaScript, su confianza se ajustaba más estrechamente a su precisión real, y a veces incluso caía por debajo de ella.

Este patrón apareció en ambas medidas de confianza absoluta y relativa, lo que sugiere que los modelos son menos conscientes de sus propios límites cuando operan en dominios de codificación desconocidos.

Tratar a los modelos como participantes introdujo algunas limitaciones, ya que la pequeña cantidad de modelos en juego afecta la diversidad; las diferencias dentro de las salidas de un solo modelo se ignoran; y la distribución de los datos puede no reflejar la de los participantes humanos reales.

Para tener en cuenta esto, el estudio probó tres configuraciones alternativas: primero, cada modelo se le dio una personalidad distinta; segundo, las respuestas se muestrearon a una temperatura más alta para crear más variación; tercero, las solicitudes se parafrasearon múltiples veces, con cada versión tratada como un participante separado:

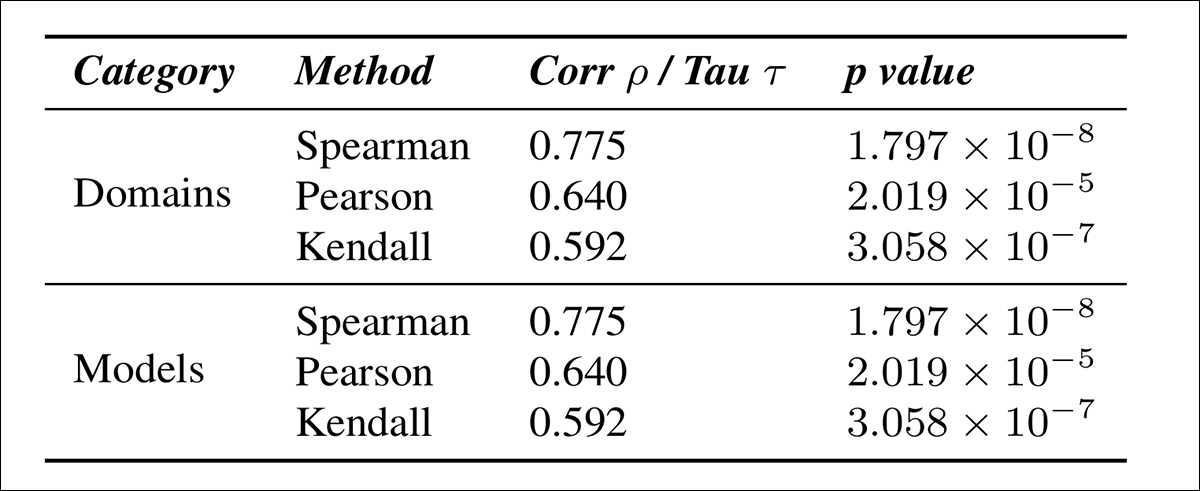

Correlación entre sobreconfianza y rendimiento real en diferentes configuraciones experimentales, mostrando que el patrón de Dunning-Kruger permanece consistente en todas las condiciones y es más fuerte cuando se muestrean múltiples respuestas diversas del mismo modelo.

La tabla de resultados mostrada arriba indica cómo se manifiesta el efecto Dunning-Kruger en estas condiciones, permaneciendo presente en cada caso; y que el DKE fue más pronunciado cuando se muestrearon múltiples respuestas del mismo modelo a alta temperatura.

Para comprender mejor cómo se desvía el rendimiento percibido del rendimiento real, el estudio comparó las estimaciones de confianza absoluta y relativa, calculando cuánto cada modelo sobreestimaba su propia capacidad (específicamente, la diferencia entre su puntuación de confianza y su precisión real), y luego midiendo cómo se relacionaba esa sobreestimación con el rendimiento real del modelo:

Correlación entre sobreconfianza (medida como confianza absoluta menos confianza relativa) y precisión real en dominios de programación y tipos de modelo, mostrando que una mayor sobreestimación se asocia consistentemente con un rendimiento más bajo.

La tabla de resultados mostrada arriba ilustra cómo se relaciona la sobreestimación con el rendimiento real, tanto en dominios de programación como en modelos. En ambos casos, podemos ver que los modelos con menor precisión tienden a mostrar una mayor sobreconfianza.

Además, los modelos especializados entrenados en dominios más estrechos mostraron efectos DKE más fuertes que los generalistas:

Correlación entre sobreestimación y rendimiento real para modelos base, especializados en un dominio y especializados en múltiples dominios, mostrando efectos DKE más fuertes a medida que aumenta la especialización.

Utilizando el conjunto de datos MultiPL-E en ocho lenguajes de programación, los autores encontraron que la capacitación en un solo dominio condujo a una mayor sobreconfianza que las configuraciones de múltiples dominios o base, lo que sugiere que el DKE empeora con una mayor especialización.

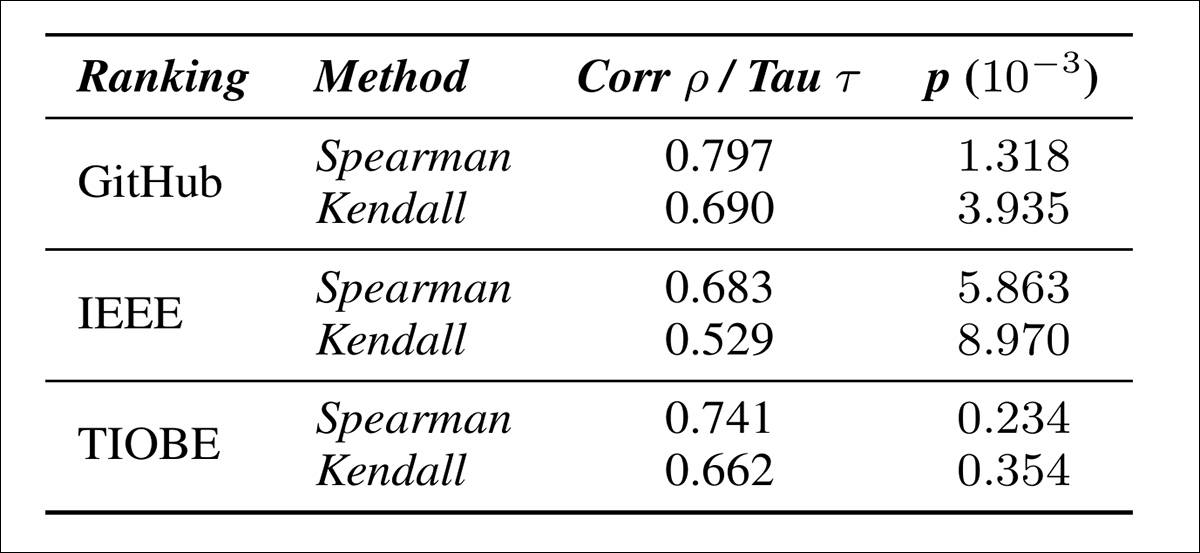

Las pruebas también encontraron que los modelos tienden a ser más sobreconfiados en lenguajes de programación raros. A través de las clasificaciones de GitHub, IEEE y TIOBE, la rareza se correlaciona fuertemente con una mayor confianza percibida, alcanzando un máximo de 0,797:

Correlación entre la sobreconfianza del modelo y la rareza del lenguaje, utilizando tres clasificaciones de popularidad. Los lenguajes menos comunes se asocian con un rendimiento percibido más alto.

Finalmente, los autores probaron si el efecto Dunning-Kruger aparece en la generación de código, evaluando los modelos en el conjunto de datos MultiPL-E en los lenguajes Ada, Dart, Prolog, Swift, C++, Python, C# y Elixir.

Aunque el efecto aún estaba presente, era notablemente más débil que en el entorno de preguntas de opción múltiple, lo que probablemente refleja la mayor dificultad para evaluar la confianza y la corrección en tareas de código abierto:

Correlación entre sobreestimación y rendimiento real en la generación de código abierto, basada en los resultados de MultiPL-E en ocho lenguajes de programación.

Al considerar la explicación aún disputada del efecto Dunning-Kruger, los autores concluyen:

‘Una explicación potencial que puede ser común a ambos humanos y modelos de IA es la explicación meta-cognitiva, que establece que evaluar la calidad de un rendimiento de una habilidad es una parte crucial de adquirir una habilidad.

‘Esta explicación puede probarse experimentalmente en modelos de IA con un estudio controlado de diferentes estrategias de capacitación y si todas conducen a mejoras simultáneas en el rendimiento y en la capacidad de evaluar la calidad del rendimiento. Sin embargo, este estudio está significativamente más allá del alcance de este documento, y lo dejamos para un trabajo futuro.’

Conclusión

Incluso en su dominio nativo, el efecto Dunning-Kruger (como señala el documento) puede ser atribuible a una causa estadística o cognitiva. Si es a una causa estadística, la aplicación de un síndrome hasta ahora único de los humanos a un contexto de aprendizaje automático es en realidad bastante válida.

Aunque los autores especulan que la causa podría encontrarse en una ‘cognitiva’ en ambos casos, eso requeriría una postura ligeramente más metafísica.

Quizás el hallazgo más interesante en el documento es el alcance en el que varios LLMs de codificación tienden a apostar por todo en sus circunstancias menos favorables, es decir, exhibiendo la máxima confianza cuando se trata de los lenguajes más escasos o menos conocidos – lo que sería una estrategia casi inmediatamente autodestructiva en un entorno de trabajo real.

* Los lenguajes de programación utilizados fueron Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript y Visual Basic.

Publicado por primera vez el miércoles 8 de octubre de 2025