Líderes de opinión

Los agentes autónomos necesitan más que la observabilidad de la IA

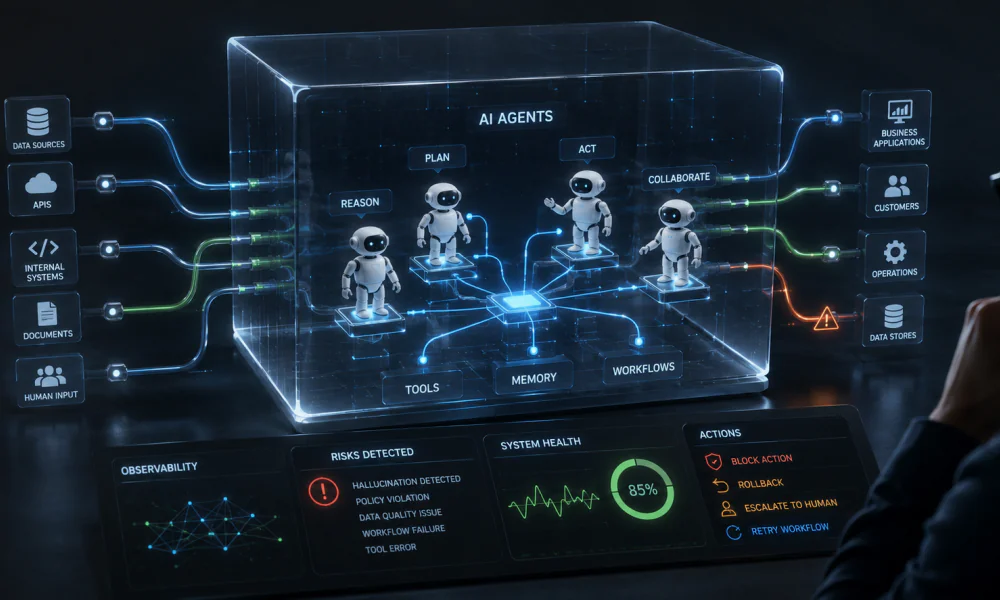

Como las empresas utilizan agentes de IA para pensar, actuar e iniciar flujos de trabajo, es imperativo desarrollar un plan para monitorear y gestionarlos.

Cuando los diversos componentes de un sistema de IA comienzan a tomar sus propias decisiones, la observabilidad por sí sola no es suficiente para garantizar que las operaciones permanezcan estables, seguras o confiables.

Para gestionar eficazmente los agentes de IA en toda la empresa, los negocios deben cerrar la brecha entre la identificación de problemas y la acción. Eso va más allá de simplemente observar los problemas; los negocios deben prevenirlos activamente.

El surgimiento de los agentes autónomos

La primera ola de IA empresarial fue de sistemas basados en prompts; un usuario planteaba una consulta, el modelo respondía y el intercambio terminaba allí. Aunque estas primeras tecnologías eran esencialmente reactivas, fueron útiles para la búsqueda, los copilotos, la creación de contenido y la resumen.

La siguiente ola es diferente. No solo los agentes de IA autónomos reaccionan, sino que también razonan a través de objetivos, seleccionan herramientas, extraen información, toman medidas e inician flujos de trabajo. A veces trabajan en conjunto con otros agentes o sistemas y cada vez más sirven como actores operativos dentro de la empresa en lugar de como una capa de interfaz para instrucciones humanas.

Ese cambio es significativo porque afecta las características operativas de la IA. Los equipos ya no solo están vigilando los resultados del modelo. En cambio, están gestionando sistemas dinámicos que pueden afectar instantáneamente a los clientes, el personal, la infraestructura, los procesos comerciales y otras aplicaciones.

Las capacidades de los agentes hoy en día

Las habilidades de los agentes evolucionan junto con ellos. Los agentes pueden seleccionar qué hacer a continuación, descomponer un objetivo en pasos y completar actividades a varios niveles. Al contactar con API, consultar bases de datos, buscar sistemas internos, actualizar registros e iniciar acciones posteriores, coordinan flujos de trabajo. Al integrar prompts, memoria, reglas comerciales, información recuperada y señales operativas en tiempo real, los agentes también pueden tomar decisiones basadas en el contexto.

Los agentes más sofisticados pueden identificar cuándo un flujo de trabajo está fallando, intentarlo de nuevo, escalar problemas o remitir trabajos a un revisor humano. Dentro de CRM, ticketing, infraestructura en la nube, bases de conocimiento internas, plataformas de observabilidad y aplicaciones comerciales, los agentes pueden funcionar de forma independiente. Predecimos que estas habilidades seguirán expandiéndose rápidamente.

Cómo las empresas están integrando agentes de IA autónomos

Los agentes se están incorporando a una gama creciente de operaciones organizativas y se están acercando a procesos operativos donde la velocidad, la precisión, la seguridad y la gobernanza son importantes. Algunas de esas operaciones incluyen: el servicio al cliente y el manejo de casos, la respuesta a incidentes y las operaciones de TI, los flujos de trabajo para DevOps y la dependencia del sitio, la corrección de código y el desarrollo de software, la planificación operativa y de la cadena de suministro, y más.

Amenazas operativas emergentes

Sin embargo, a medida que los agentes se vuelven cada vez más independientes, las empresas deben enfrentar un nuevo tipo de riesgo operativo.

- Las malas decisiones no son solo aconsejadas; a menudo se llevan a cabo

- Los errores menores pueden propagarse rápidamente a otros sistemas vinculados

- Las acciones en el mundo real pueden ser desencadenadas por alucinaciones

- Los agentes pueden desviarse de la intención comercial, la política o el cumplimiento

- Las interacciones entre múltiples componentes pueden resultar en fallos

- La toma de decisiones automatizada puede tomar decisiones más rápido que la evaluación humana

Mientras que los equipos pueden observar síntomas, también deben poder comprender las razones detrás del comportamiento del sistema. La IA empresarial necesita controles de confiabilidad además de visibilidad.

Complejidad de los sistemas de IA

Los sistemas de IA impulsados por la IA de hoy en día rara vez son un solo modelo. Son sistemas distribuidos y en capas compuestos por muchos componentes interactuantes que incluyen:

- Modelos fundamentales (LLM)

- Modelos de lenguaje pequeños y específicos de tarea (SLM)

- Modelos de incrustación

- Bases de datos vectoriales

- Tuberías de recuperación y componentes RAG

- Plantillas de prompt y capas de orquestación de prompt

- Conjuntos de datos de entrenamiento y evaluación

- Capas de guardrail y política

- Agentes y flujos de trabajo

- Sistemas de llamada de herramientas

- Telemetría (también conocida como registros, métricas y trazas)

- Puntos de verificación de aprobación de humanos en el bucle

Sus riesgos

Cada componente agrega un modo de fallo diferente, y la forma en que interactúan agrega más complejidad. Incluso si un sistema parece ser fuerte a nivel de infraestructura, aún puede tomar malas decisiones y generar resultados satisfactorios; todo mientras se acumula el riesgo operativo debajo de la superficie.

Algunos de los riesgos asociados incluyen: la introducción de entradas pobres o corruptas por parte de las tuberías de datos, cuellos de botella de infraestructura que reducen la confiabilidad, resultados dañinos o erróneos y cuellos de botella operativos en respuesta a la revisión humana. Además, los sistemas con múltiples agentes o pasos pueden fallar de maneras que no son inmediatamente aparentes.

Observabilidad de la IA

El monitoreo tradicional es insuficiente para comprender el comportamiento de los prompts, la calidad de la recuperación, la deriva del modelo, los canales de ejecución de los agentes o la conexión entre el comportamiento de la IA y el impacto empresarial o operativo posterior.

Es ahí donde entra en juego la observabilidad de la IA. La observabilidad de la IA permite a los equipos comprender cómo funcionan los sistemas de IA en producción al recopilar, correlacionar y evaluar las entradas y salidas, los comportamientos deseados y las señales de decisión generadas por esos sistemas. Eso es esencial, porque los sistemas de IA están dispersos, no determinísticos y extremadamente sensibles al contexto.

La observabilidad de la IA ofrece una visión general de los flujos de trabajo de la IA, por lo que los equipos que la utilizan pueden comprender cómo interactúan los prompts, los modelos, las capas de recuperación, las herramientas y los sistemas posteriores durante la ejecución.

La observabilidad de la IA permite monitorear el rendimiento y el comportamiento, incluyendo la latencia, el costo, el uso de tokens, el rendimiento, las tasas de error, los indicadores de calidad del modelo y la salida. Rastrea y analiza los caminos de ejecución en flujos de trabajo de agentes complejos y muestra cómo se alcanzan los resultados a lo largo de varios pasos y dependencias.

La observabilidad de la IA también encuentra anomalías en señales operativas y de IA al exponer un comportamiento anómalo en los modelos, las tuberías, la infraestructura o los resultados que enfrentan los usuarios antes de que los equipos los descubran manualmente. Acelera los diagnósticos cuando algo sale mal y facilita las investigaciones de causa raíz al incluir operaciones específicas de la IA en la telemetría del sistema (registros, métricas, trazas y eventos).

La observabilidad por sí sola no es suficiente

A pesar de ser una práctica empresarial esencial, la observabilidad de la IA tiene limitaciones inherentes.

La observabilidad es diagnóstica en lugar de preventiva; los equipos pueden aprender qué salió mal pero no necesariamente cómo evitar que vuelva a suceder. Es importante comprender que el conocimiento de las acciones pasadas de un agente no se traduce automáticamente en el control de las acciones futuras del agente.

En el caso de sistemas no determinísticos complejos, la observabilidad puede abrumar a los equipos con datos que llevan a la incertidumbre. En lugar de ofrecer una respuesta operativa, la observabilidad a menudo termina en una explicación. Incluso cuando los equipos son conscientes de un problema, es posible que no tengan la automatización, las salvaguardas y los bucles de control necesarios para tomar medidas correctivas.

Esto crea una brecha operativa. Las empresas pueden detectar la deriva, los malos resultados, el comportamiento peligroso o la productividad degradada, pero aún pueden ser incapaces de evitar que vuelva a suceder, mitigar sus efectos o mantener los sistemas autónomos dentro de parámetros de funcionamiento seguros.

Esto significa que los equipos siguen operando de forma reactiva. Utilizan la intervención manual cuando algo se rompe, investigan incidentes después de los hechos y dependen del trabajo humano para compensar los sistemas que se vuelven más rápidos y autónomos.

Un panorama general de la confiabilidad de la IA

La confiabilidad de la IA va más allá de simplemente observar los problemas. Es la disciplina de garantizar que los sistemas de IA funcionen de manera segura, consistente, predecible y exitosa en contextos de producción del mundo real. La confiabilidad de la IA comprende y gestiona el sistema completo de sistemas alrededor de la IA. Cierra el bucle entre la detección y la acción.

La confiabilidad de la IA se centra en si el sistema de IA impulsado por la IA en su conjunto puede funcionar dentro de restricciones operativas razonables con el tiempo, en lugar de solo si un modelo proporcionó una respuesta precisa. La calidad, la seguridad, la resiliencia, la explicabilidad, el cumplimiento de la política, la eficiencia del costo y la estabilidad operativa son parte de la ecuación.

La transición de la detección a la prevención

La confiabilidad de la IA reduce el tiempo entre el reconocimiento de un problema y su solución. Cambia la conversación de “¿qué salió mal?” a “¿cuánto tiempo tardará nuestra IA en mejorar?”. Al utilizar las siguientes técnicas, se mueve la observabilidad de la observación pasiva a la prevención proactiva:

- Correlacionar señales a través de modelos, datos e infraestructura para identificar problemas

- Detección proactiva de problemas antes del impacto

- Verificar todas las entradas y salidas en sistemas de IA probabilística para detectar cambios de comportamiento sutiles

- Crear un bucle de retroalimentación entre la detección de salidas no deseadas en producción y utilizar eso para generar datos de afinamiento que mejoren la precisión de los modelos subyacentes

- Rastreo de flujos de trabajo de múltiples agentes para garantizar que se puedan conectar los puntos sobre por qué y cómo los datos evolucionaron para informar acciones complejas

- Flujos de trabajo de agentes con humanos en el bucle para una respuesta segura y una remediación automatizada

Cerrar la brecha entre el control y la observación

Las empresas se benefician de marcos que integran visibilidad y control y requieren más que solo una capa de observabilidad sobre la IA generativa. En sistemas tanto determinísticos como no determinísticos, una plataforma de confiabilidad puede identificar, anticipar, explicar y ayudar a controlar los problemas.

Lo siguiente debe incluirse en un marco viable para operaciones de IA confiables:

- Telemetría integrada para sistemas de TI y de IA

- Rastreo de flujo de trabajo de agente y dependencia del sistema de extremo a extremo

- Rastreo de comportamiento y calidad de la IA (prompts y evals)

- Detección avanzada de anomalías, independientemente de la fuente

- Razonamiento causal y análisis de causa raíz

- Alertas que se adaptan automáticamente al entorno y no requieren umbrales manuales

- Aplicación de políticas y guardrail

- Evaluación de humanos en el bucle para acciones delicadas o significativas

- Automatización de flujos de trabajo y coordinación de remediación

- Uso de análisis predictivos para prevenir problemas

- Bucles de retroalimentación que conectan la detección de anomalías con la mejora de la calidad del modelo de IA

Facilitar las funciones de la IA

Los sistemas de IA dependen de la infraestructura, los servicios, las tuberías de datos y las rutinas operativas; no fallan por sí solos. Los equipos obtienen una visión general cuando se combinan la confiabilidad de la IA y la confiabilidad de TI.

Un delgado envoltorio de LLM no debe ser la base de una plataforma confiable. Para identificar y solucionar problemas que otras herramientas de IA generativa pasan por alto, se deben considerar varias técnicas de IA, incluyendo la IA no supervisada, la IA predictiva, la IA causal y la IA generativa. Esta combinación de técnicas se conoce comúnmente como “IA compuesta”.

La IA generativa es buena para resumir lenguaje natural. Es más adecuada para situaciones que requieren razonamiento a través de datos no estructurados o cuando se interactúa con humanos. Pero eso no se ajusta a la forma de la mayoría de los problemas de confiabilidad en producción.

La IA predictiva se centra en la identificación de señales tempranas antes de que se conviertan en interrupciones, malas experiencias del cliente o fallos costosos mediante el uso de algoritmos de detección de anomalías.

La IA causal ayuda a determinar las verdaderas causas raíz para revelar si la calidad de la recuperación, el comportamiento del modelo, la lentitud de la infraestructura, la deriva de los datos aguas arriba o el fallo del sistema aguas abajo fue la causa de una disminución del rendimiento.

La IA no supervisada descubre patrones, estructuras o anomalías ocultas en los datos de forma autónoma sin orientación humana. Superó a la IA generativa para la confiabilidad porque se centra en encontrar estructuras ocultas dentro de datos complejos y no clasificados para agrupar elementos similares o encontrar relaciones.

Cuando el riesgo, la ambigüedad o los efectos comerciales son significativos, los agentes de IA operativos deben poder automatizar la reacción mientras mantienen la participación humana para operaciones confiables.

La comprensión del modelo de IA del contexto comercial específico se puede mejorar en cada encuentro mediante el aprendizaje de refuerzo a partir de datos de usuarios reales en producción.

Incluso los sistemas más avanzados van más allá de las alertas; la remediación de bucle cerrado aprende de cada incidente con el tiempo, automatiza reacciones reconocidas e inicia medidas seguras.

Preparación para sistemas de IA autónomos

Las empresas pueden prepararse para los sistemas de IA autónomos de varias maneras. Primero, los agentes deben considerarse como sistemas operativos en lugar de como instrumentos de productividad. Una vez que un agente tenga la capacidad de actuar, se convierte en una parte integral de las operaciones comerciales y debe regularse adecuadamente.

Los equipos pueden registrar señales de modelos, prompts, herramientas, flujos de trabajo, infraestructura y resultados de usuarios de inmediato al instrumentar a los agentes. Esta vigilancia básica no debe ni puede retrasarse hasta que los agentes se vuelvan esenciales para el negocio.

Establecer estándares de confiabilidad antes de la implementación generalizada de los agentes también es crucial. En lugar de introducirlos después del hecho, los umbrales aceptables para la seguridad, la latencia, las tasas de error, el riesgo de alucinación, el cumplimiento de la política y el impacto comercial deben incorporarse en su diseño.

Conectar el comportamiento de la IA con los sistemas y procedimientos subyacentes que lo respaldan permite a las empresas integrar las operaciones de IA y TI. Utilizar herramientas diferentes para la infraestructura y el monitoreo del modelo crea puntos ciegos.

La ingeniería de plataformas, SRE, seguridad, equipos de datos, equipos de IA y propietarios de negocios deben trabajar juntos para proporcionar operaciones de IA confiables, y los sistemas autónomos trascienden los silos convencionales.

Cada incidente, anomalía y casi accidente mejorará el sistema al incorporar bucles de retroalimentación en las operaciones, lo que permite a las empresas aprender continuamente del comportamiento de producción.

Finalmente, es fundamental seleccionar plataformas diseñadas para el control en lugar de solo la observación. Las empresas se beneficiarán de los sistemas que integran la observabilidad, la predicción, la explicación y la acción a medida que los agentes de IA se vuelvan más autónomos. Las organizaciones que logren transitar de la identificación de problemas a la gestión segura de los resultados serán las ganadoras.

En resumen

La IA en las empresas es ahora un sistema operativo en entornos empresariales en lugar de una herramienta. En entornos de producción del mundo real, agregar confiabilidad a los sistemas de IA garantiza operaciones seguras, consistentes, predecibles y eficientes. Las organizaciones que logren transitar de identificar problemas a controlar los resultados de manera segura serán las ganadoras. La IA en las empresas es ahora un sistema operativo en entornos empresariales en lugar de una herramienta. En entornos de producción del mundo real, agregar confiabilidad a los sistemas de IA garantiza operaciones seguras, consistentes, predecibles y eficientes.