Inteligencia artificial

Introducción a Vertex AI

Dado el paisaje en constante evolución de la Inteligencia Artificial, uno de los mayores obstáculos que los líderes tecnológicos suelen encontrar es la transición de ser “experimentales” a ser “listos para la empresa”. Mientras que los chatbots de consumo y una plataforma interactiva ayudan con la imaginación pública, las empresas no pueden tener éxito con solo una interfaz de chat. En una era en la que la competencia es más agresiva que nunca, las empresas necesitan un ecosistema robusto, escalable y seguro, y esto es lo que Google intenta ofrecer con el Vertex AI, la plataforma unificada de Inteligencia Artificial y Aprendizaje Automático de Google Cloud.

Vertex AI intenta solidificarse como la columna vertebral para la integración de la Inteligencia Artificial Generativa con la infraestructura de nube moderna, ofreciendo una suite integral de características que bridan la brecha entre los modelos de fundación sin procesar y las aplicaciones de grado de producción. Vertex AI no es simplemente un wrapper para grandes modelos de lenguaje (LLM), sino que es un ecosistema unificado de Aprendizaje Automático e Inteligencia Artificial (ML/AI) que trata a la Inteligencia Artificial Generativa como un ciudadano de primera clase de la infraestructura de nube moderna.

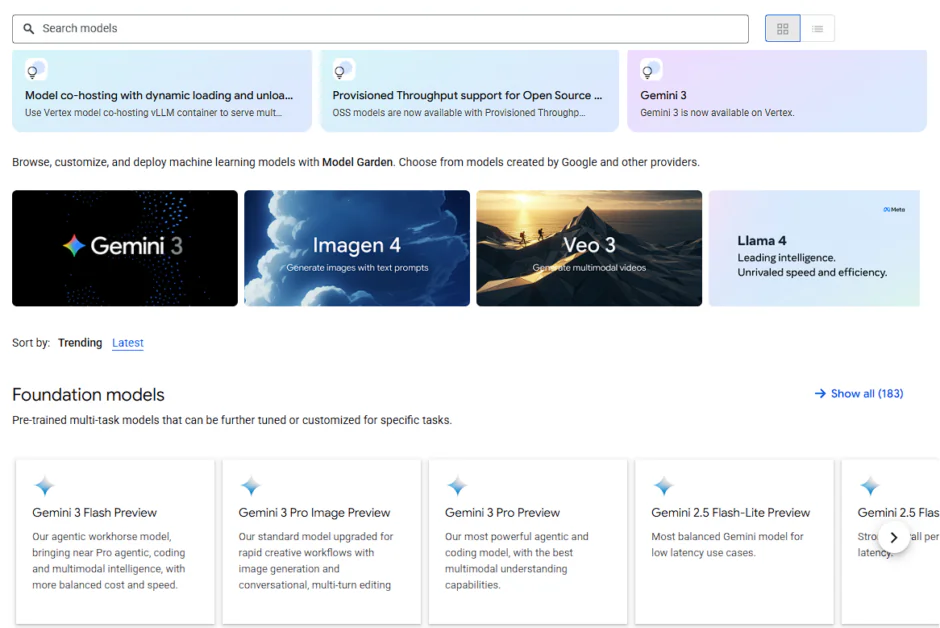

En el corazón de Vertex AI se encuentra el Jardín de Modelos, un mercado central que proporciona acceso a más de 200 modelos de fundación curados, incluido el poderoso Gemini 2.5 Pro, que cuenta con una ventana de contexto de 2 millones de tokens. En este artículo, desglosaremos la arquitectura de Vertex AI, exploraremos cómo el Jardín de Modelos sirve como la “Tienda de Aplicaciones” de la industria para la inteligencia, y examinaremos los pilares técnicos que hacen que esta plataforma sea la columna vertebral del próximo generación de software empresarial.

La Arquitectura Central: Una Plataforma Unificada

Vertex AI no es una colección suelta de herramientas, sino un ecosistema de datos y AI unificado diseñado para bridar la fragmentación de los datos, las herramientas y los equipos que plagia al aprendizaje automático hasta hoy. Tradicionalmente, el desarrollo de la IA tiene lugar en entornos aislados, y a veces, los datos se dispersan y se atrapan en varios repositorios. Por ejemplo, las organizaciones pueden almacenar datos de clientes en almacenes SQL mientras que los documentos no estructurados se volcan en un Lago de Datos. Cuando los datos están siloeados, la IA solo ve una “verdad parcial”, lo que lleva a resultados sesgados o altas tasas de alucinación porque carece del contexto completo de la empresa.

Vertex AI intenta integrar todo el ciclo de vida, desde la ingesta de datos sin procesar en BigQuery y Cloud Storage hasta el monitoreo de producción, sirviendo esencialmente como un “tejido conectivo” entre estos silos. Vertex AI se integra de forma nativa con Cloud Storage y BigQuery, lo que permite a los modelos de IA recuperar los datos sin complejas tuberías de Extracción, Transformación y Carga.

La Fundación: El Hipercómputador de Inteligencia Artificial de Google

La capa GenAI de Vertex AI se encuentra sobre la arquitectura del hipercómputador de Inteligencia Artificial de Google, un sistema de supercomputación integrado, que consiste en:

TPU v5p y v5e (Unidades de Procesamiento de Tensor)

Las Unidades de Procesamiento de Tensor de Google son ASIC personalizados (Circuitos Integrados de Aplicación Específica) diseñados específicamente para la multiplicación de matrices que define el aprendizaje profundo.

- TPU v5p (Rendimiento): Esta es la aceleradora insignia para el entrenamiento a gran escala. Cada pod de TPU v5p puede escalar hasta 8,960 chips interconectados por la Interconexión de Chip de Alta Banda de Google (ICI) a 4,800 Gbps. Para un líder técnico, esto significa 2,8 veces más rápido el entrenamiento para un modelo de tamaño GPT-3 (175B parámetros) en comparación con la generación anterior, reduciendo drásticamente el tiempo de comercialización.

- TPU v5e (Eficiencia): Diseñado para un rendimiento “optimizado por costo”, el v5e es el caballo de batalla para el entrenamiento a escala media y la inferencia de alta velocidad. Ofrece hasta 2,5 veces mejor precio-rendimiento, lo que lo convierte en la opción ideal para empresas que necesitan ejecutar inferencia 24/7 sin un presupuesto masivo.

NVIDIA H100/A100 GPUs para Flexibilidad

Mientras que las TPU son especializadas, muchos equipos de desarrollo confían en el ecosistema NVIDIA CUDA. Vertex AI proporciona soporte de primera clase para el hardware más reciente de NVIDIA:

- NVIDIA H100 (Hopper): Ideal para afinar los modelos de código abierto más grandes (como Llama 3.1 405B) que requieren una gran anchura de banda de memoria.

- Jupiter Networking: Para prevenir el “cuello de botella de la red”, Google utiliza su tejido de red de centro de datos Jupiter. Esto garantiza que los datos se muevan entre las GPU a velocidad de relámpago, admitiendo el acceso de memoria directa remota (RDMA) para omitir la sobrecarga de CPU y ofrecer un rendimiento casi local en nodos distribuidos.

Orquestación Dinámica

El cambio técnico más crítico en Vertex AI es la Orquestación Dinámica. En un entorno heredado, si un nodo de GPU falla durante una ejecución de entrenamiento de 3 semanas, el trabajo completo puede fallar.

- Resiliencia Automatizada: Vertex AI, a menudo impulsado por Google Kubernetes Engine (GKE) bajo el capó, cuenta con nodos “auto-sanadores”. Si se detecta una falla de hardware, la plataforma migra automáticamente la carga de trabajo a un nodo saludable.

- Programador de Carga de Trabajo Dinámico: Esta herramienta permite a los equipos solicitar capacidad según la urgencia. Puedes optar por Inicio Flexible (más barato, comienza cuando está disponible la capacidad) o Capacidad Garantizada para lanzamientos de misión crítica.

- Entrenamiento sin Servidor: Para los equipos que desean cero administración de infraestructura, el Entrenamiento sin Servidor de Vertex AI les permite enviar su código y datos; la plataforma proporciona el clúster, ejecuta el trabajo y lo desmonta, cobrando solo por los segundos de cómputo utilizados.

Los Tres Puntos de Entrada: Descubrimiento, Experimentación y Automatización

Para acomodar a diferentes personalidades técnicas, desde científicos de datos hasta desarrolladores de aplicaciones, Vertex AI proporciona tres puntos de entrada principales:

- Jardín de Modelos: El Mercado para el Descubrimiento.

- Vertex AI Studio: El Campo de Juego para la Experimentación.

- Vertex AI Agent Builder: La Fábrica para la Automatización.

Jardín de Modelos: El Mercado para el Descubrimiento

El Jardín de Modelos de Google Cloud es una plataforma centralizada dentro de Google Cloud para descubrir, probar, personalizar y desplegar una amplia gama de modelos de IA de primera parte, de código abierto y de terceros, incluidos los multimodales (visión, texto, código) para diversas necesidades empresariales, ofreciendo una integración sin problemas con las herramientas de Vertex AI para una MLOps fluida. Actúa como una biblioteca integral, ayudando a los desarrolladores y a las empresas a seleccionar el modelo adecuado (desde grandes modelos de fundación hasta modelos especializados) para sus tareas, ya sea para generación de texto, análisis de imágenes o finalización de código, y desplegarlos de manera eficiente dentro de su entorno de Google Cloud.

El Jardín de Modelos categoriza sus 200+ modelos en tres niveles distintos, lo que permite a los arquitectos equilibrar el rendimiento, el costo y el control:

- Modelos de Primera Parte (Google): Estos son los modelos multimodales insignia disponibles dentro de Vertex AI, y Google los ofrece en varios tamaños, que van desde Pro con razonamiento complejo hasta Flash con baja latencia y alto volumen, lo que permite a los desarrolladores optimizar sus modelos según sus casos de uso.

- Modelos de Tercera Parte (Propietarios): A través de asociaciones estratégicas, Vertex AI ofrece acceso “Modelo como Servicio” (MaaS) a gigantes como Anthropic (Claude 3.5) y Mistral AI. En lugar de administrar credenciales de facturación y seguridad separadas para cinco diferentes proveedores de IA, un equipo técnico puede acceder a todos ellos a través de su proyecto de Google Cloud existente, utilizando un formato de API unificado.

- Modelos de Código Abierto y Pesos Abiertos: Este nivel incluye Meta’s Llama 3.2, Mistral, y el propio Gemma de Google. Estos son ideales para organizaciones que desean implementar modelos dentro de su propia VPC (Red Privada Virtual) para garantizar el aislamiento de datos máximo.

En un entorno no unificado, implementar un modelo de código abierto como Llama requiere configurar un entorno PyTorch, configurar controladores CUDA y administrar un wrapper Flask o FastAPI.

El Jardín de Modelos elimina esta fase de “preparación” a través de Puntos de Extremo Administrados Unificados:

- Implementación en Un Solo Clic: Para muchos modelos, hacer clic en “Implementar” provisiona automáticamente los recursos TPU/GPU necesarios, envuelve el modelo en un contenedor listo para producción y proporciona un punto de conexión de API de REST.

- Integración con Hugging Face: Vertex AI ahora permite a los desarrolladores implementar modelos directamente desde el Hub de Hugging Face en un punto de conexión de Vertex, proporcionando una expansión casi infinita de la inteligencia disponible.

- Conexión de Servicio Privado (PSC): Para industrias altamente reguladas, los modelos se pueden implementar utilizando Conexión de Servicio Privado, asegurando que el punto de conexión del modelo nunca se exponga a Internet público, manteniendo el tráfico de datos estrictamente dentro de la red corporativa.

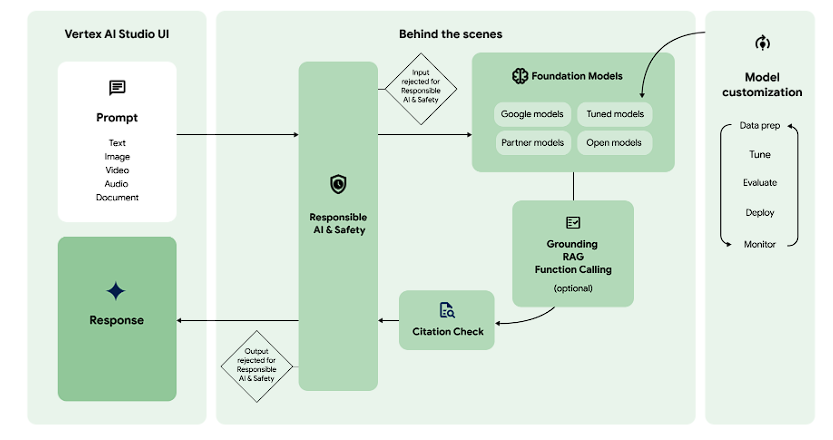

Vertex AI Studio: El Campo de Juego para la Experimentación

Mientras que el Jardín de Modelos se trata de la selección, Vertex AI Studio se trata de precisión. Vertex AI Studio se puede comparar con los compiladores y depuradores que se encuentran en el mundo del software tradicional. El Vertex AI Studio es el espacio de trabajo donde los modelos sin procesar se esculpen en herramientas de negocio específicas a través de una combinación de ingeniería de prompts, pruebas multimodales y ajuste avanzado de hiperparámetros.

Prototipado Multimodal: Más allá del Texto

Una de las características destacadas del Studio es su soporte nativo para multimodalidad. Mientras que otras plataformas requieren codificación compleja para manejar datos no textuales, Vertex AI Studio permite agregar archivos directamente a la interfaz para probar las capacidades de razonamiento de Gemini 2.5.

- Inteligencia de Video: Puedes subir una keynote técnica de 45 minutos y pedirle al modelo que “identifique cada vez que se menciona una API específica y proporcione un resumen con marca de tiempo.”

- Análisis de Documentos: En lugar de solo leer texto, el modelo puede analizar el diseño visual de un PDF de 1,000 páginas, comprendiendo la relación entre gráficos, tablas y la prosa circundante.

- Ejecución de Código: El Studio ahora admite la ejecución de código en el campo de juego. Si se le pide al modelo que resuelva un problema matemático complejo o analice un CSV, el modelo puede escribir y ejecutar código Python en un entorno de sandbox seguro para proporcionar una respuesta verificada.

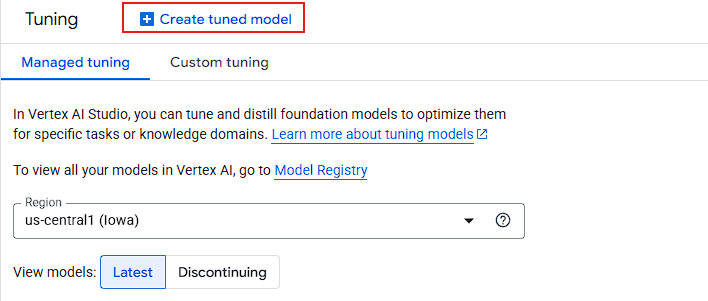

Personalización Avanzada: La Vía de Afinación

Cuando la ingeniería de prompts (Zero-shot o Few-shot) alcanza un techo, Vertex AI Studio proporciona la maquinaria pesada: Afinación de Modelos.

- Afinación Finura Supervisada (SFT): Los desarrolladores proporcionan un conjunto de datos de pares “Prompt/Respuesta” (idealmente 100+ ejemplos). Esto enseña al modelo a adoptar una voz de marca específica, formato de salida (como JSON especializado) o jerga de dominio específico.

- Almacenamiento en Caché de Contexto: Para empresas que lidian con conjuntos de datos masivos y estáticos (como una biblioteca jurídica o una base de código), el Studio permite el Almacenamiento en Caché de Contexto. Esto permite “pre-cargar” un millón de tokens de datos en la memoria del modelo, reduciendo drásticamente la latencia y los costos para consultas posteriores.

- Destilación (Maestro-Alumno): Esta es una maniobra arquitectónica de alto nivel. Puedes usar un modelo masivo (Gemini 2.5 Pro) para “enseñar” a un modelo más pequeño y rápido (Gemini 2.0 Flash). El resultado es un modelo ligero que se desempeña a un nivel “Pro” pero se ejecuta a la velocidad y el costo de “Flash”.

Vertex AI Agent Builder: La Fábrica para la Automatización

Vertex AI Agent Builder es un marco de orquestación de alto nivel que permite a los desarrolladores crear estos agentes combinando modelos de fundación con datos empresariales y API externas.

La Arquitectura de la “Verdad”: Anclaje y RAG

La principal barrera técnica para la IA empresarial es la alucinación. El Constructor de Agentes resuelve esto a través de un sofisticado motor de anclaje.

- Anclaje con Búsqueda de Google: Para consultas que requieren conocimiento del mundo en tiempo real (por ejemplo, “¿Cuáles son las tasas de hipoteca actuales en Nueva York?”), el agente puede realizar una búsqueda en Google, extraer los hechos y citar sus fuentes.

- Búsqueda de Vertex AI (RAG como Servicio): En lugar de construir manualmente una base de datos vectorial (Pinecone, Weaviate), los desarrolladores pueden usar Búsqueda de Vertex AI para indexar sus propios documentos (PDF, HTML, BigQuery). Maneja los pasos de “particionado”, “incrustación” y “recuperación” automáticamente, asegurando que el agente solo responda basándose en su “Fuente de Verdad” interna.

- Motor RAG de Vertex AI: Para implementaciones personalizadas a gran escala, este servicio administrado permite la búsqueda híbrida (combinando resultados vectoriales y de palabras clave) para mejorar la precisión hasta un 30% sobre las salidas LLM estándar.

Orquestación de Multi-Agente (Protocolo A2A)

Los flujos de trabajo empresariales avanzados a menudo requieren múltiples agentes especializados que trabajen juntos. Vertex AI introduce el Protocolo de Agente a Agente (A2A), un estándar abierto que permite:

- El “Agente de Viajes” hablar con el “Agente de Finanzas” para asegurarse de que una reserva de vuelo esté dentro del presupuesto corporativo.

- Interoperabilidad: Dado que utiliza un protocolo abierto, los agentes construidos en Vertex pueden comunicarse con aquellos construidos en otros marcos como LangChain o CrewAI.

La Pila de Desarrollo: ADK y Motor de Agente

Para la audiencia de “plataforma técnica”, el Constructor de Agentes ofrece dos caminos distintos:

- Consola sin Código: Una interfaz de arrastrar y soltar visual para la prototipación rápida y la configuración del usuario comercial.

- Kit de Desarrollo de Agente (ADK): Un kit de herramientas de código de primera clase para ingenieros. Permite “Prompt como Código”, integración de control de versiones y la capacidad de implementar en el Motor de Agente de Vertex AI—un tiempo de ejecución administrado que maneja la persistencia de sesión, escalado y administración de estado automáticamente.

Conclusión: De “¿Qué pasa si” a “¿Qué sigue?”

La transición desde una demostración de IA impresionante a una aplicación empresarial de grado de producción ha sido durante mucho tiempo el “valle de la muerte” para los proyectos de transformación digital. Como hemos explorado, Vertex AI está diseñado específicamente para bridar esta brecha. Al unificar los silos fragmentados de datos, infraestructura y orquestación de modelos, Google Cloud ha movido la conversación desde el poder bruto de los Grandes Modelos de Lenguaje hacia la madurez operativa del ciclo de vida de la IA.