Líderes de opinión

De código a cura: La próxima revolución de la IA necesita una mano (y ojos)

Cómo los sistemas agenticos, los lentes inteligentes de realidad aumentada y la robótica empoderarán a los humanos, en lugar de reemplazarlos

Estamos viviendo una paradoja en la inteligencia artificial.

En las pantallas, la IA es sobrehumana. Los grandes modelos de lenguaje escriben código funcional de Python en segundos. Los sistemas generativos producen imágenes y videos fotorealistas en minutos. Los sistemas ganadores del Nobel como AlphaFold han predicho las estructuras de casi todas las proteínas conocidas. Las victorias digitales se están acumulando.

Sin embargo, en el mundo físico de la investigación biomédica, el proceso de descubrimiento sigue siendo dolorosamente manual. No sentimos que la IA esté acelerando la ciencia o la medicina, al menos no todavía. Los números revelan la profundidad del problema. Una encuesta emblemática de Nature de más de 1.500 científicos encontró que más del 70% ha intentado y fallado en reproducir los experimentos de otro investigador. Incluso más preocupante: más de la mitad no pudo reproducir su propio trabajo. En biología del cáncer, específicamente, un proyecto de reproducibilidad de ocho años encontró que solo el 40% de los hallazgos de alto impacto podían ser replicados y el 68% de los experimentos carecían de documentación suficiente para siquiera intentar la replicación.

Este es el secreto sucio de la ciencia moderna: tenemos un problema de captura de conocimiento, no solo un problema de descubrimiento. Los detalles experimentales críticos viven en las cabezas de los investigadores, no en los documentos. Los protocolos se desvían. El conocimiento tácito sale por la puerta cuando los trainees se gradúan. Los sistemas de IA entrenados en la literatura publicada heredan todas estas lagunas.

El problema fundamental es que, si bien una IA puede diseñar una proteína novedosa para la terapia del cáncer en una simulación digital, no puede recoger una pipeta para probarla. No puede navegar la realidad desordenada y impredecible de un laboratorio húmedo para validar su propia hipótesis. No puede ver las manos de un científico experimentado y aprender las técnicas sutiles que hacen que los experimentos funcionen.

Esta “brecha de ejecución” es el mayor cuello de botella que impide que la revolución de la IA se convierta en una revolución médica. Mientras que la mayoría de las empresas de robótica aún están ocupadas enseñando a las máquinas a doblar la ropa o cargar los lavavajillas, están quedando atrás en las capacidades verdaderamente transformadoras de estos avances en campos como la medicina.

Para solucionar esto, debemos ir más allá de los chatbots y hacia los co-científicos de la IA, sistemas agenticos que conectan el mundo digital y el físico, empujando más allá de la planificación y la codificación y hacia la ejecución en el mundo real. En Stanford, estamos desarrollando LabOS, un marco de IA digital-física que demuestra cómo los agentes de IA, los lentes inteligentes de realidad aumentada (XR) y la robótica colaborativa pueden unirse para cerrar este círculo, transformando los experimentos científicos en una conversación colaborativa entre humanos y máquinas, mientras se captura automáticamente el conocimiento que actualmente se pierde.

La Gran División: Por qué la IA necesita “ojos” y “manos”

Muchas de las victorias más visibles de la IA han sucedido donde el entorno es completamente digital: repositorios de código, conjuntos de datos curados o benchmarks simulados (donde la IA compite para ejecutar un negocio virtual o invertir digitalmente en acciones).

Los laboratorios húmedos son diferentes. La biología, y en general, el descubrimiento científico, es un proceso muy ruidoso. Los instrumentos se desvían, los operadores improvisan y “el protocolo” a menudo vive en parte en las cabezas de las personas. La diferencia entre un resultado limpio y una carrera fallida puede ser un ángulo de pipeteo, un patrón de vórtice, una sustitución de reactivo o una incubación que se ejecutó 10 minutos más. Estos detalles contextuales rara vez se incluyen en un documento y son exactamente lo que un modelo de IA necesita si va a generalizar más allá de un conjunto de datos.

Es por eso que la IA de laboratorio de grado necesita ojos (para percibir lo que está sucediendo en contexto), manos (para estandarizar y automatizar los pasos de alta variabilidad) y memoria (para registrar lo que realmente sucedió). Sin estas capacidades, los modelos pueden recomendar qué hacer, pero no pueden traducir confiablemente las recomendaciones en ejecución física validada o explicar los fallos cuando la realidad se desvía del plan.

Más allá de los chatbots: De copilotos a co-científicos

El término “IA agéntica” a veces se usa de manera laxa. En entornos biomédicos, debería significar algo preciso: un sistema que pueda tomar un objetivo (por ejemplo, “optimizar la eficiencia de edición de genes CRISPR mientras se minimizan los objetivos no deseados”), descomponerlo en una secuencia de tareas, ejecutar esas tareas a través de herramientas, evaluar los resultados y adaptar el plan bajo restricciones y con toma de decisiones auditables.

Esto es importante porque los flujos de trabajo de investigación no son una sola llamada al modelo. Son tuberías de extremo a extremo que abarcan la formulación de hipótesis, el diseño experimental, el procesamiento de datos, las pruebas estadísticas e interpretación. El pensamiento reciente en el descubrimiento de fármacos ha comenzado a enfatizar sistemas agénticos que pueden escalar estas tuberías en lugar de simplemente acelerar los pasos individuales (por ejemplo, la discusión de Unite.AI sobre agentes en descubrimiento de moléculas pequeñas).

En ingeniería de software, ya hemos visto evidencia empírica temprana de que los copilotos de IA pueden aumentar la productividad de los desarrolladores. En biomedicina, la oportunidad análoga no es solo escribir código, es escribir y validar protocolos, estructurar datos, monitorear la ejecución y cerrar el bucle entre predicción y medición, conectando a los científicos de IA con humanos en los laboratorios.

LabOS: Cuando la IA se ejecuta en un sistema operativo para los laboratorios del mañana

En nuestro trabajo en Stanford sobre AI4Science, que abarca copilotos de edición de genes como CRISPR-GPT y sistemas de co-ejecución de IA-XR como LabOS que ayudan a los científicos en laboratorios biomédicos y de ciencia de materiales, hemos estado explorando un cambio arquitectónico:

1. Diseñar un “sistema operativo de laboratorio” de extremo a extremo que acopla un laboratorio digital (seco) a un laboratorio físico (húmedo).

La premisa es simple: si un cuaderno de laboratorio es la memoria de la ciencia, entonces un sistema operativo de laboratorio debería ser la capa de ejecución, capturando la intención, traduciéndola en acciones, observando los resultados y convirtiendo cada ejecución en conocimiento estructurado.

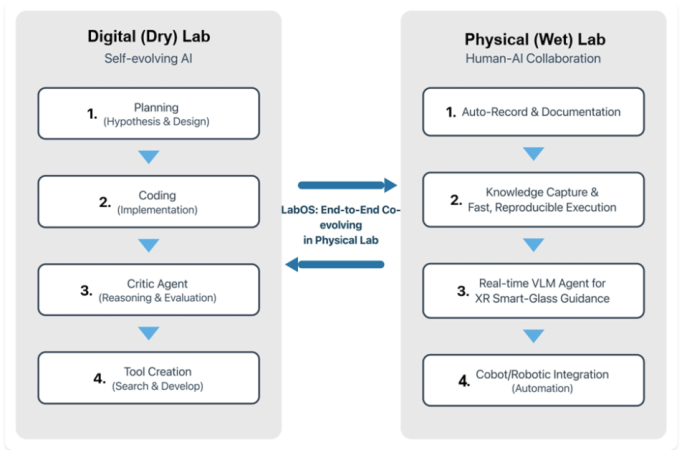

Figura. Una vista conceptual de LabOS que vincula un bucle de laboratorio digital autoevolutivo (planificación, codificación, crítica, creación de herramientas) con un bucle de laboratorio húmedo humano-IA (auto-documentación, captura de conocimiento, orientación de realidad aumentada y integración robótica).

2. IA en el laboratorio digital – Planificación y construcción de herramientas auto-mejorables

En el laboratorio digital (seco), podemos dejar que la IA haga lo que ya hace bien: buscar, sintetizar y proponer. Pero también queremos que sea auto-mejorable. No “halucinando nueva ciencia”, sino aprendiendo mejores herramientas y flujos de trabajo a partir de la retroalimentación.

Un bucle de laboratorio digital práctico se puede enmarcar en cuatro etapas recurrentes:

- Planificación (hipótesis + diseño): proponer hipótesis, seleccionar variables experimentales, anticipar factores de confusión y especificar resultados medibles.

- Codificación (implementación): generar o adaptar scripts de análisis, pipelines de simulación y plantillas de control de instrumentos cuando corresponda.

- Agente crítico (razonamiento + evaluación): someter a prueba las suposiciones, verificar el poder estadístico, proponer controles y señalarizar los modos de fallo probables.

- Creación de herramientas (búsqueda + desarrollo): cuando el flujo de trabajo carece de un componente (un analizador, una rutina de control de calidad, un panel), construirlo y agregarlo de regreso al kit de herramientas.

3. IA en el laboratorio físico – IA con “ojos” (lentes de realidad aumentada) y “manos” (robótica)

El laboratorio físico (húmedo) es donde el sistema gana o pierde confianza. El objetivo no es reemplazar al científico, sino reducir la fricción y el error mientras se aumenta la observabilidad.

Vemos el bucle del laboratorio físico como cuatro capacidades complementarias:

- Auto-registro y documentación: capturar acciones, marcas de tiempo, configuraciones de instrumentos y desviaciones automáticamente, para que la documentación no sea un pensamiento de última hora.

- Captura de conocimiento para ejecución rápida y reproducible: convertir ejecuciones en artefactos estructurados y consultables (versiones de protocolo, conjuntos de parámetros, resultados de control de calidad) alineados con principios de gestión de datos como FAIR.

- Orientación en tiempo real mediante lentes de realidad aumentada: utilizar modelos multimodales para interpretar la escena (lo que el operador está haciendo, qué reactivo está en mano) y proporcionar orientación paso a paso y comprobaciones de seguridad. La realidad aumentada/realidad virtual ya ha demostrado su valor en flujos de trabajo físicos de alto riesgo como la orientación experimental (LabOS, Stanford, Princeton, en colaboración con NVIDIA).

- Integración de cobots/robótica para automatización: estandarizar pasos repetitivos, permitir entregas seguras y reducir la variabilidad. Plataformas para flujos de trabajo de simulación a realidad (por ejemplo NVIDIA Isaac) y procesamiento de IA en tiempo real en el borde como la transmisión en vivo de lentes inteligentes y la interacción humano-IA en LabOS son capas de habilitación importantes.

Esta arquitectura se alinea con una dirección más amplia en el campo: laboratorios “autodirigidos” o autónomos que combinan la automatización con el aprendizaje automático para planificar el próximo experimento. Lo que LabOS agrega es una capa de interfaz humano más ajustada, para que la autonomía no venga a costa de la transparencia.

Por qué la IA de laboratorio de grado no es solo “IA en un conjunto de datos”

Los sistemas de IA para superinteligencia biomédica/científica a menudo parecen impresionantes en la evaluación retrospectiva o al tomar exámenes, y luego tienen un rendimiento deficiente en el laboratorio físico. La razón rara vez es un solo error. Es generalmente una discrepancia entre las suposiciones del modelo y la realidad del laboratorio.

Tres brechas se presentan repetidamente:

- Brecha de contexto: los conjuntos de datos típicamente omiten las variables contextuales que los operadores saben que importan (excursiones de temperatura, números de lote de reactivo, desviaciones sutiles del protocolo).

- Brecha de acción: muchos sistemas de IA pueden recomendar qué hacer, pero no pueden traducir confiablemente la recomendación en pasos físicos validados.

- Brecha de retroalimentación: sin retroalimentación estructurada y de alta calidad de la ejecución, los modelos no pueden aprender dónde fallan – y los científicos no pueden auditar por qué.

Cerrar estas brechas es menos sobre inventar una nueva arquitectura de red neuronal, y más sobre construir los instrumentos, interfaces y contratos de datos que hacen que el laboratorio sea legible para las máquinas, y permiten que la IA vea y trabaje con humanos.

Confiabilidad por diseño: Seguridad y gobernanza para la IA que puede actuar

La IA agéntica en la investigación de descubrimiento no solo plantea preocupaciones familiares sobre precisión. Introduce nuevos modos de fallo porque puede actuar. En un laboratorio, la acción significa el potencial de desperdicio, daño o conclusiones engañosas, especialmente cuando los experimentos alimentan hipótesis clínicas.

Una mentalidad útil es tratar a una pila de laboratorio habilitada para IA como un sistema socio-técnico que necesita garantía. Varios marcos existentes ayudan, pero deben traducirse a la realidad del laboratorio:

- Gestión de riesgos como práctica continua: el Marco de gestión de riesgos de IA de NIST (AI RMF 1.0) proporciona un vocabulario práctico para mapear, medir y gestionar el riesgo de IA en todo el ciclo de vida.

- Alineación regulatoria para la IA médica adyacente: el trabajo de la FDA sobre el software de IA/ML como dispositivo médico, incluido su Plan de acción y directrices relacionadas, ofrece una visión concreta de lo que se parece a “buena práctica” cuando la IA impacta la atención al paciente.

Para dominios de alto impacto como la edición de genes, la gobernanza ya es una conversación global. Se están discutiendo recomendaciones sobre la edición del genoma humano, para enfatizar la necesidad de mecanismos de supervisión adecuados y gobernanza responsable, como los propuestos por la Sociedad Americana para la Terapia Genética y Celular, o ASGCT. Sistemas como LabOS deberían diseñarse para facilitar el cumplimiento, no para dificultarlo.

Lista de verificación: Controles para co-científicos de IA seguros para el descubrimiento científico

En nuestra opinión, un sistema operativo de laboratorio consciente de la seguridad debería implementar al menos los siguientes diseños:

- Procedencia por defecto: cada conjunto de datos, versión de protocolo y resultado del modelo debería ser trazable a las entradas y marcas de tiempo.

- Autonomía limitada: el sistema debería tener permisos explícitos (qué puede hacer sin confirmación) y reglas de escalación (cuándo debe preguntar).

- Anulación humana y degradación gradual: cuando los sensores o flujos de datos fallan, o la incertidumbre es alta, el sistema debería retroceder a un modo más seguro y simple.

- Validación continua: las predicciones in silico deberían emparejarse con validación de laboratorio físico; las carreras de laboratorio físico deberían incluir puertas de control de calidad antes de que las conclusiones se propaguen aguas abajo de regreso a los modelos/agentes en el mundo digital.

- Conciencia de seguridad y doble uso: proteger la infraestructura del laboratorio contra la manipulación.

Empoderar a los humanos en todas partes: ¿Pueden los co-científicos de IA nivelar el campo de juego?

Una de las promesas más convincentes de un “co-científico” de IA-XR es que no solo es velocidad para instituciones de élite, es accesibilidad para todos. Considere qué limita actualmente a los laboratorios más pequeños, las startups y las clínicas remotas/rurales/regionales:

- Acceso limitado a la especialización para protocolos e instrumentos de clase mundial.

- Costo relativo más alto de capacitación, errores y retrabajo.

- Herramientas fragmentadas: cuadernos, hojas de cálculo, registros de instrumentos y scripts de análisis rara vez se conectan limpiamente.

Un sistema que pueda guiar la ejecución en contexto (a través de lentes de realidad aumentada), capturar lo que sucedió automáticamente y sugerir el próximo mejor paso basado en ejecuciones anteriores podría hacer que los ensayos avanzados sean más reproducibles en diferentes sitios. En principio, también podría apoyar la investigación clínica distribuida donde los protocolos deben ejecutarse consistentemente, incluso cuando los recursos varían.

Cronología: ¿Cuándo cada científico y clínico obtiene un co-científico?

En resumen, estamos más cerca de lo que muchos piensan para algunas tareas de alto valor y alta frecuencia (como producir un fármaco de manera confiable en el laboratorio) y más lejos de lo que la mayoría de las demostraciones implican para otros (como la IA resolviendo completamente grandes problemas como el cáncer o el Alzheimer). Una hoja de ruta realista se ve así:

- A corto plazo (dentro de 1 año): Copilotos de flujo de trabajo que reducen la carga administrativa: redacción de protocolos, síntesis de literatura, plantillas de análisis y informes de control de calidad automatizados. El factor limitante es la integración, no la capacidad del modelo.

- A medio plazo (1-2 años): Sistemas de co-ejecución en el laboratorio: orientación de lentes de realidad aumentada, documentación automatizada y robótica selectiva para pasos de alta variabilidad. La confianza dependerá de los registros de auditoría y un diseño de bucle humano ajustado.

- A largo plazo (3+ años): Co-investigadores interdominio que conectan el descubrimiento con la traducción: vinculando datos de laboratorio con puntos de referencia clínicos, monitoreando señales de seguridad, y ayudando a diseñar ensayos – mientras se cumple con las expectativas regulatorias y éticas.

De código a cura: El camino hacia el descubrimiento científico 1000x

LabOS es un intento de responder a una pregunta simple: ¿qué si un experimento pudiera ejecutarse como una conversación, donde la intención, la ejecución y la evidencia están conectadas de extremo a extremo? Si construimos estos sistemas bien, pueden ayudar a abordar la brecha de traducción que ralentiza la biomedicina y muchas disciplinas científicas físicas (por ejemplo, la ciencia de materiales). Si los construimos mal, amplificarán la irreproducibilidad y crearán nuevos riesgos de seguridad.

El trabajo más importante en los próximos años será fundamental: interfaces de datos y dispositivos estandarizados a través de la construcción del sistema operativo (al igual que iOS ejecuta todos los tipos de aplicaciones), construcción de benchmarks de IA que incluyan ejecución y incertidumbre (como el benchmark de LabSuperVision en LabOS), y comenzar con la implementación en el mundo real que fomenta la innovación mientras protege la integridad de la investigación y a los pacientes.

Para los investigadores y clínicos, la pregunta no es si la IA entrará en el laboratorio. Ya lo ha hecho. La pregunta es si la integraremos como una colección de herramientas desconectadas o como un sistema confiable y auditado diseñado para las realidades de la ciencia biomédica.

Lectura sugerida y fuentes

- Encuesta de reproducibilidad (Nature, 2016): https://www.nature.com/articles/533452a

- Artículo revisado por pares de CRISPR-GPT (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Noticias de Stanford Medicine sobre CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Preimpresión de LabOS (arXiv): https://arxiv.org/abs/2510.14861

- Sitio web del benchmark de LabOS y LabSuperVision: https://ai4lab.stanford.edu

- Marco de gestión de riesgos de IA de NIST (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Visión general de la FDA sobre el software de IA/ML como dispositivo médico: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Principios de datos FAIR (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI sobre los cuellos de botella en el descubrimiento de fármacos de moléculas pequeñas: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI sobre la IA y la cirugía robótica: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/