Inteligencia artificial

El lenguaje generado por IA está comenzando a contaminar la literatura científica

Los investigadores de Francia y Rusia han publicado un estudio que indica que el uso de generadores de texto probabilísticos basados en IA como GPT-3 están introduciendo un ‘lenguaje torturado’, citas de literatura inexistente y reutilización de imágenes ad hoc y no acreditadas en canales previamente respetables para la publicación de nueva literatura científica.

Quizás lo más preocupante es que los artículos estudiados también contienen contenido científicamente inexacto o no reproducible presentado como el resultado de una investigación objetiva y sistemática, lo que indica que los modelos de lenguaje generativos se están utilizando no solo para mejorar las limitadas habilidades en inglés de los autores de los artículos, sino también para realizar el trabajo duro involucrado (y, inevitablemente, para hacerlo mal).

El informe, titulado Frases torturadas: Un estilo de escritura dudoso que emerge en la ciencia, ha sido compilado por investigadores del Departamento de Ciencias de la Computación de la Universidad de Toulouse y el investigador de Yandex Alexander Magazinov, actualmente en la Universidad de Tel Aviv.

El estudio se centra particularmente en el crecimiento de publicaciones científicas generadas por IA sin sentido en la revista Elsevier Microprocesadores y microsistemas.

Con cualquier otro nombre

Los modelos de lenguaje autoregresivos como GPT-3 se entrenan con grandes volúmenes de datos y están diseñados para parafrasear, resumir, compilar e interpretar esos datos de contribución en modelos de lenguaje generativos cohesivos que son capaces de reproducir patrones de habla y escritura naturales, mientras retienen la intención original de los datos de entrenamiento.

Dado que dichos marcos a menudo son castigados en la etapa de entrenamiento del modelo por ofrecer regurgitación directa y “no absorbida” de los datos originales, inevitablemente buscan sinónimos, incluso para frases bien establecidas.

Las presentaciones científicas aparentemente creadas o ayudadas por IA descubiertas por los investigadores incluyen un número extraordinario de intentos fallidos de sinónimos creativos para frases conocidas en el sector de aprendizaje automático:

red neuronal profunda: ‘organización neuronal profunda’

red neuronal artificial: ‘(falsa | falsificada) organización neuronal’

red móvil: ‘organización versátil’

ataque a la red: ‘organización (emboscada | asalto)’

conexión de red: ‘asociación de organización’

datos grandes: ‘(enorme | enorme | inmenso | colosal) información’

almacén de datos: ‘información (almacén | centro de distribución)’

inteligencia artificial (IA): ‘(falsa | hecha por humanos) conciencia’

computación de alto rendimiento: ‘cálculo élite’

computación en la niebla / niebla / nube: ‘cálculo en la niebla’

unidad de procesamiento gráfico (GPU): ‘unidad de preparación de diseños’

unidad central de procesamiento (CPU): ‘unidad de preparación focal’

motor de flujo de trabajo: ‘motor de proceso de trabajo’

reconocimiento facial: ‘reconocimiento facial’

reconocimiento de voz: ‘reconocimiento de discurso’

error cuadrático medio: ‘error cuadrático medio (error | equivocación)’

error absoluto medio: ‘error (absoluto | supremo) (error | equivocación)’

señal a ruido: ‘(movimiento | señal | indicador | señal | señal) a (ruido | alboroto | ruido)’

parámetros globales: ‘parámetros mundiales’

acceso aleatorio: ‘(arbitrario | irregular) acceso a’

bosque aleatorio: ‘(arbitrario | irregular) (bosque | tierra de madera | territorio luxuriante)’

valor aleatorio: ‘(arbitrario | irregular) valor’

colonia de hormigas: ‘(insecto subterráneo | estado | provincia | área | región | asentamiento)’

colonia de hormigas: ‘(insecto subterráneo | estado | provincia | área | región | asentamiento)’

energía restante: ‘energía restante’

energía cinética: ‘energía del motor’

Bayes ingenuo: ‘(ingenuo | inocente | crédulo) Bayes’

asistente digital personal (PDA): ‘asistente informático individual’

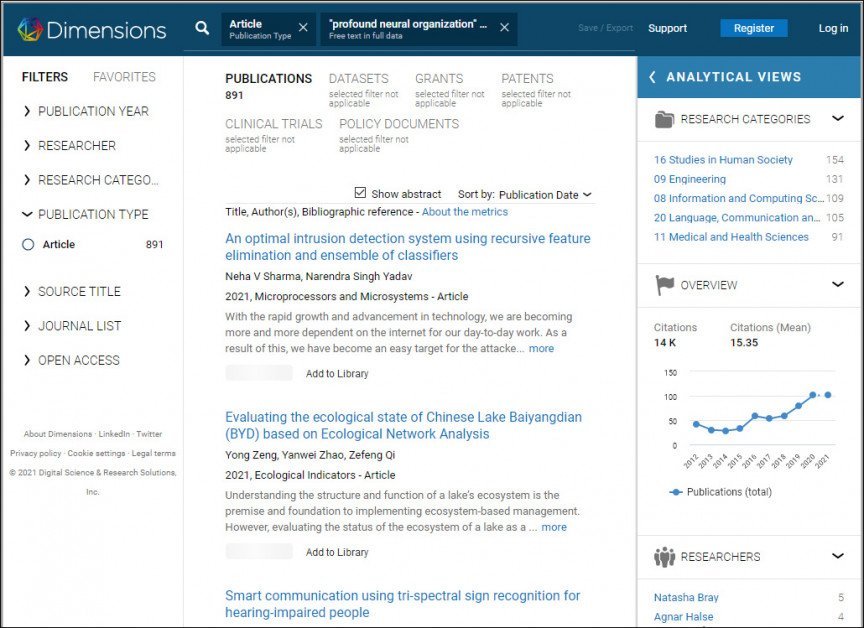

En mayo de 2021, los investigadores consultaron el motor de búsqueda académico Dimensions en busca de este tipo de lenguaje automatizado y desordenado, tomando el cuidado de excluir frases legítimas como ‘información enorme’ (que es una frase válida y no un sinónimo fallido para ‘datos grandes’). En este punto, observaron que Microprocesadores y microsistemas tenía el mayor número de ocurrencias de parafraseo mal manejado.

En el momento actual, todavía es posible recuperar (instantánea de archivo, 15/07/2021) una serie de artículos científicos para la frase sin sentido ‘organización neuronal profunda’ (es decir, ‘red neuronal profunda’), y otros en la lista anterior producen resultados similares.

Resultados de búsqueda para ‘organización neuronal profunda’ (‘red neuronal profunda’) en Dimensions. Fuente: https://app.dimensions.ai/

La revista Microprocesadores se fundó en 1976 y se renombró a Microprocesadores y microsistemas dos años después.

Crecimiento de lenguaje sin sentido

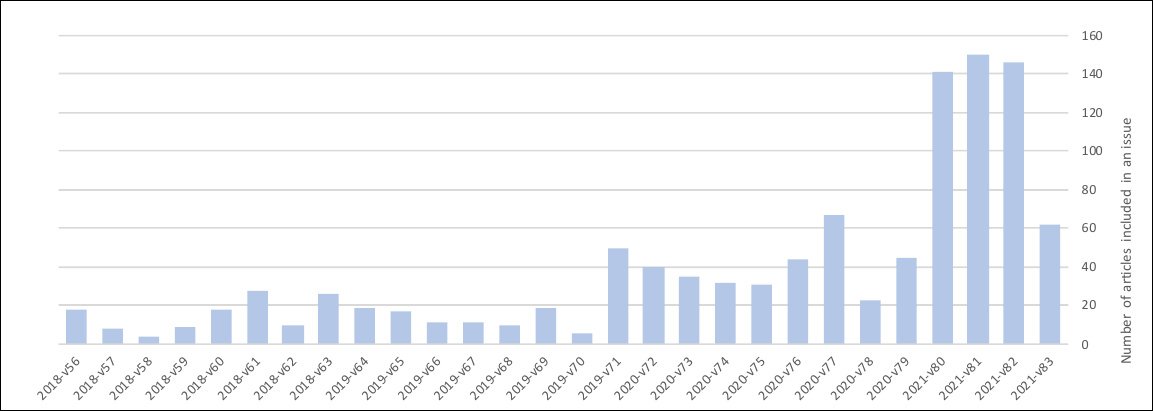

Los investigadores estudiaron un período que abarca desde febrero de 2018 hasta junio de 2021, y observaron un aumento pronunciado en el volumen de presentaciones en los últimos dos años, y particularmente en los últimos 6-8 meses:

Correlación o causalidad! El aumento en las presentaciones a la revista Microprocesadores y microsistemas parece coincidir con el crecimiento de ‘nonsense’ texto y sinónimos en presentaciones aparentemente respetables. Fuente: https://arxiv.org/pdf/2107.06751.pdf

El conjunto de datos final recopilado por los colaboradores contiene 1,078 artículos de longitud completa obtenidos a través de la suscripción de Elsevier de la Universidad de Toulouse.

Disminución de la supervisión editorial para artículos científicos chinos

El artículo observa que el período de tiempo asignado para la evaluación editorial de las presentaciones señaladas se reduce drásticamente en 2021, cayendo a menos de 40 días; una disminución seis veces mayor en el tiempo estándar para la revisión por pares, evidente desde febrero de 2021.

La mayor cantidad de artículos señalados proviene de autores con afiliaciones a China continental: de 404 artículos aceptados en menos de 30 días, el 97,5% son relacionados con China. Por el contrario, en casos donde el proceso editorial superó los 40 días (615 artículos), las presentaciones afiliadas a China representaron solo el 9,5% de esa categoría, un desequilibrio de diez veces.

El informe atribuye la infiltración de los artículos señalados a deficiencias en el proceso editorial y a una posible falta de recursos frente a un aumento en el número de presentaciones.

Los investigadores hipotetizan que los modelos de lenguaje generativos de estilo GPT han sido utilizados para producir gran parte del texto en los artículos señalados; sin embargo, la forma en que un modelo generativo abstracta sus fuentes hace que esto sea difícil de probar, y la principal evidencia se encuentra en una evaluación de sentido común de sinónimos pobres y innecesarios, y un examen minucioso de la coherencia lógica de la presentación.

Los investigadores también observan que los modelos de lenguaje generativos que, según creen, están contribuyendo a esta inundación de sinsentido son capaces no solo de crear los textos problemáticos, sino también de reconocerlos y señalizarlos sistemáticamente, de la misma manera que los investigadores mismos han realizado manualmente. El trabajo detalla dicha implementación, utilizando GPT-2, y ofrece un marco para que futuros sistemas identifiquen presentaciones científicas problemáticas.

La incidencia de presentaciones ‘contaminadas’ es mucho mayor en la revista Elsevier (72,1%) en comparación con otras revistas estudiadas (13,6% como máximo).

No solo semántica

Los investigadores enfatizan que muchos de los artículos en cuestión no solo están utilizando el lenguaje incorrecto, sino que también contienen afirmaciones científicas inexactas, lo que indica la posibilidad de que los modelos de lenguaje generativos no solo se estén utilizando para mejorar las limitadas habilidades lingüísticas de los científicos que contribuyen, sino que también pueden estar siendo utilizados para formular al menos algunos de los teoremas y datos centrales del artículo.

En otros casos, los investigadores plantean una efectiva ‘resíntesis’ o ‘reelaboración’ de trabajo previo abstracto (y superior), con el fin de cumplir con las presiones de la investigación académica de ‘publicar o perecer’, y posiblemente para mejorar los rankings nacionales para la preeminencia global en la investigación de IA, a través del mero volumen.

Contenido sin sentido en un artículo presentado. En este caso, los investigadores encontraron que el texto ha sido derivado, ad hoc, de un artículo de EDN, de donde también se ha tomado la ilustración acompañante sin atribución. La reescritura del contenido original es tan extrema que lo hace incomprensible.

Al analizar varios de los artículos presentados en Elsevier, los investigadores encontraron oraciones para las que no pudieron inferir ningún significado; referencias a literatura inexistente; referencias a variables y teoremas en fórmulas que no aparecían en el material de apoyo (lo que sugiere abstracción basada en lenguaje o ‘alucinación’ de datos aparentemente factuales); y reutilización de imágenes sin reconocimiento de sus fuentes (que los investigadores critican no desde un punto de vista de derechos de autor, sino como indicador de rigor científico inadecuado).

Fallas de citación

Las citas destinadas a apoyar los argumentos en un artículo científico se encontraron en muchos de los ejemplos señalados como ‘rotas o que llevan a publicaciones no relacionadas’.

Además, las referencias a ‘trabajo relacionado’ aparentemente incluyen a autores que los investigadores creen que han sido ‘alucinados’ por un sistema de estilo GPT.

Atención errante

Otra deficiencia de incluso los modelos de lenguaje más avanzados, como GPT-3, es su tendencia a perder el enfoque a lo largo de un discurso largo. Los investigadores encontraron que los artículos señalados a menudo presentan un tema al principio del artículo que en realidad nunca se vuelve a mencionar después de que se introduce en notas preliminares o en otro lugar.

También teorizan que algunos de los peores ejemplos ocurren a través de múltiples viajes de texto fuente a través de una serie de motores de traducción, cada uno distorsionando el significado aún más.

Fuentes y razones

Al intentar discernir qué hay detrás de este fenómeno, los autores del artículo sugieren una serie de posibilidades: que el contenido de fábricas de artículos se está utilizando como material de origen, introduciendo inexactitudes muy temprano en un proceso que inevitablemente producirá inexactitudes adicionales; que las herramientas de girar artículos como Spinbot se están utilizando para ocultar el plagio; y que la presión abrumadora para publicar regularmente está llevando a investigadores con pocos recursos a utilizar sistemas de estilo GPT-3 para aumentar o generar completamente nuevos artículos académicos.

Los investigadores concluyen con un llamado a la acción para una mayor supervisión y mejores estándares en un área de publicación académica que, aparentemente, se está convirtiendo en pasto para su propio tema de estudio: los sistemas de aprendizaje automático. También exhortan a Elsevier y a otros editores a introducir procedimientos de revisión y selección más rigurosos, y critican ampliamente los estándares y prácticas actuales en este respecto, sugiriendo que ‘El engaño con textos sintéticos amenaza la integridad de la literatura científica.’