Interfaz cerebro-máquina

Avance de la IA Mejora las Interfaces Cerebro-Computadora al Decodificar Señales Cerebrales Complejas

Los investigadores de la Universidad de Chiba en Japón han desarrollado un nuevo marco de inteligencia artificial capaz de decodificar la actividad cerebral compleja con una precisión significativamente mejorada, lo que marca un paso importante hacia interfaces cerebro-computadora (BCIs) más confiables. El avance podría ayudar a acelerar el desarrollo de tecnologías de asistencia que permitan a las personas con condiciones neurológicas controlar dispositivos como extremidades protésicas, sillas de ruedas y robots de rehabilitación utilizando sus pensamientos.

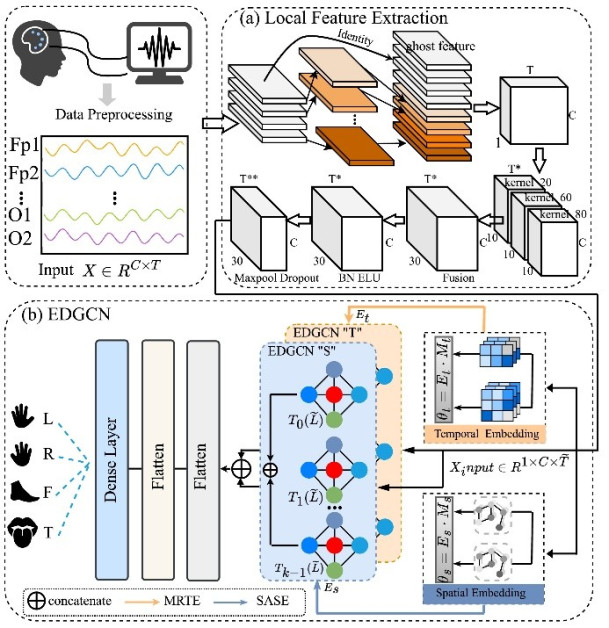

La investigación, liderada por el estudiante de doctorado Chaowen Shen y el profesor Akio Namiki en la Escuela de Graduados de Ingeniería de la Universidad de Chiba, introduce una nueva arquitectura de aprendizaje profundo conocida como Red de Convolución Gráfica Impulsada por Incrustación (EDGCN). El sistema está diseñado para interpretar las complejas señales eléctricas generadas en el cerebro cuando una persona imagina mover sus extremidades, un proceso conocido como imaginación motora.

Interfaces Cerebro-Computadora y Imaginación Motora

Las interfaces cerebro-computadora apuntan a crear un canal de comunicación efectivo entre el cerebro humano y las máquinas externas. En lugar de confiar en el movimiento muscular, las BCI interpretan las señales neuronales y las convierten en comandos para sistemas digitales o dispositivos físicos.

Uno de los enfoques más estudiados en la investigación de BCI implica electroencefalografía de imaginación motora (MI-EEG). En estos sistemas, los usuarios imaginan realizar movimientos, como levantar una mano, agarrar un objeto o caminar. Aunque no ocurre movimiento físico, el cerebro genera patrones distintivos de actividad eléctrica asociados con el movimiento imaginado.

Estas señales pueden ser capturadas utilizando electroencefalografía (EEG), una técnica no invasiva que registra la actividad cerebral a través de electrodos colocados en el cuero cabelludo. La EEG proporciona datos de serie temporal multicanal que representan la actividad neural en diferentes regiones del cerebro.

Decodificar estas señales con precisión permite a las computadoras traducir la actividad neural en comandos accionables. En la práctica, esto podría permitir a las personas con parálisis o discapacidad motora grave controlar tecnologías de asistencia simplemente imaginando movimientos.

Sin embargo, lograr una decodificación confiable de las señales MI-EEG sigue siendo uno de los desafíos más difíciles en la neurotecnología.

Por Qué las Señales Cerebrales Son Difíciles de Decodificar

El principal obstáculo en el desarrollo de la interfaz cerebro-computadora radica en la complejidad inherente de las señales de EEG.

Las señales de imaginación motora muestran una alta variabilidad espaciotemporal, lo que significa que varían tanto en diferentes regiones del cerebro como en el tiempo. También difieren ampliamente entre individuos y incluso dentro de la misma persona de una sesión a otra.

Los modelos de aprendizaje automático tradicionales a menudo luchan con estas variaciones. Muchos sistemas existentes dependen de estructuras de gráficos predefinidas o parámetros fijos que asumen que las señales cerebrales se comportan en patrones consistentes. En realidad, las señales neuronales son mucho más dinámicas y heterogéneas.

Los métodos anteriores a menudo utilizaban técnicas como el análisis de patrones espaciales comunes o redes neuronales convolucionales convencionales para extraer características de las señales de EEG. Si bien estos enfoques pueden identificar algunos patrones en la actividad neural, a menudo no logran capturar las interacciones más profundas entre las regiones del cerebro o los patrones en evolución en el tiempo.

Como resultado, muchos sistemas BCI requieren una extensa calibración y entrenamiento antes de que puedan funcionar de manera efectiva para usuarios individuales.

Un Nuevo Enfoque: Redes de Convolución Gráfica Impulsada por Incrustación

El equipo de investigación de la Universidad de Chiba abordó estos desafíos desarrollando un nuevo marco de aprendizaje profundo diseñado para capturar mejor la complejidad de la actividad cerebral.

Su solución, Red de Convolución Gráfica Impulsada por Incrustación (EDGCN), combina varias técnicas avanzadas para modelar la estructura espacial y temporal de las señales de EEG simultáneamente.

En el núcleo del marco se encuentra un mecanismo de fusión impulsado por incrustación que permite al sistema generar dinámicamente parámetros utilizados para decodificar las señales cerebrales. En lugar de confiar en arquitecturas fijas, EDGCN adapta su representación interna para capturar mejor las variaciones entre sujetos y en el tiempo.

La arquitectura integra varios componentes especializados:

Incrustación Temporal de Multi-Resolución (MRTE)

Este módulo analiza las señales de EEG en diferentes escalas de tiempo. Dado que las señales neuronales evolucionan rápidamente, la información importante puede ocurrir en diferentes resoluciones temporales. MRTE extrae características de patrones espectrales de potencia de multi-resolución, lo que permite al sistema identificar actividad neural significativa que de otro modo podría pasar desapercibida.

Incrustación Espacial Consciente de la Estructura (SASE)

Las señales cerebrales no están aisladas; diferentes regiones del cerebro interactúan continuamente. El mecanismo SASE modela estas interacciones incorporando tanto estructuras de conectividad local como global entre los electrodos de EEG. Esto permite al IA representar el cerebro como una red en lugar de canales de señal de señal independientes.

Generación de Parámetros Consciente de la Heterogeneidad

Uno de los aspectos más innovadores del marco EDGCN es su capacidad para generar dinámicamente parámetros de convolución gráfica a partir de un banco de parámetros impulsado por incrustación. Esto permite al modelo adaptarse a las características únicas de las señales cerebrales de cada sujeto.

Para respaldar este proceso, los investigadores utilizaron convolución gráfica de Chebyshev, una técnica que modela eficientemente las relaciones dentro de redes complejas.

Núcleos con Restricciones de Ortogonalidad

Para mejorar aún más la robustez, el modelo introduce restricciones de ortogonalidad dentro de sus núcleos de convolución. Esto fomenta la diversidad en las características aprendidas y reduce la redundancia, lo que ayuda al sistema a extraer representaciones más ricas de las señales de EEG.

Juntos, estos componentes permiten que EDGCN capture tanto los patrones de actividad neural local como las interacciones a gran escala entre las regiones del cerebro, lo que resulta en una decodificación más precisa de las señales de imaginación motora.

Resultados de Rendimiento

Los investigadores probaron EDGCN utilizando conjuntos de datos de referencia ampliamente utilizados del Concurso BCI IV, que son conjuntos de datos de evaluación estándar en el campo de la investigación de la interfaz cerebro-computadora.

El modelo logró:

- 90.14% de precisión de clasificación en el conjunto de datos BCIC-IV-2b

- 86.50% de precisión de clasificación en el conjunto de datos BCIC-IV-2a

Estos resultados superan varios métodos de decodificación de estado actual y demuestran una fuerte generalización en diferentes sujetos.

Es importante destacar que el sistema también mostró una mejor adaptabilidad cuando se aplicó a escenarios de sujeto cruzado, un requisito clave para la implementación práctica de BCI. Muchos modelos existentes funcionan bien para un usuario entrenado individual pero fallan cuando se aplican a nuevos individuos. La arquitectura impulsada por incrustación de EDGCN ayuda a superar esta limitación al modelar mejor la variabilidad individual.

Implicaciones para la Rehabilitación y la Tecnología de Asistencia

La capacidad de decodificar las señales cerebrales con mayor precisión podría tener implicaciones profundas para las tecnologías de asistencia.

Las BCI basadas en la imaginación motora ya se están explorando para aplicaciones como:

- Sillas de ruedas controladas por pensamiento

- Prótesis neuronales

- Dispositivos de rehabilitación robótica

- Sistemas de comunicación para pacientes con parálisis

Una mayor precisión en la decodificación podría hacer que estas tecnologías sean significativamente más confiables y fáciles de usar.

Los investigadores creen que sistemas como EDGCN pueden ayudar a pacientes con condiciones que incluyen:

- Accidente cerebrovascular

- Lesiones de la médula espinal

- Esclerosis lateral amiotrófica (ELA)

- Otras afecciones neuromusculoesqueléticas

Con una interpretación de señales más confiable, los pacientes podrían potencialmente controlar dispositivos de neurorehabilitación a través de movimientos imaginados simples, permitiendo una interacción más natural con los sistemas de asistencia.

Según el profesor Namiki, decodificar señales de imaginación motora no es solo un desafío tecnológico, sino también una oportunidad para comprender mejor cómo el cerebro organiza el movimiento y la conectividad neural.

Hacia Interfaces Cerebro-Computadora de Clase Consumidor

A pesar de décadas de investigación, la mayoría de los sistemas de interfaz cerebro-computadora siguen confinados a laboratorios o entornos clínicos especializados. La confiabilidad, la adaptabilidad y la facilidad de uso siguen siendo barreras significativas para una adopción más amplia.

Avances como EDGCN podrían ayudar a acercar las BCI a la tecnología neuro de clase consumidor.

Al mejorar la capacidad del sistema para manejar señales cerebrales heterogéneas, el modelo reduce la necesidad de calibración extensa y ajuste experto. Este es un paso crucial para hacer que los sistemas BCI sean utilizables fuera de los entornos de investigación.

La investigación futura probablemente se centrará en integrar modelos de IA como este en sistemas EEG portátiles y dispositivos wearables. Combinado con mejoras en la tecnología de sensores y la potencia de cómputo, estos sistemas podrían permitir interfaces cerebro-máquina más accesibles y escalables.

Hacia una Integración Humano-Máquina más Profunda

El desarrollo de EDGCN refleja una tendencia más amplia en la inteligencia artificial y la neurociencia: el uso creciente de redes neuronales basadas en gráficos para modelar sistemas biológicos.

Dado que el cerebro en sí opera como una red compleja de regiones interconectadas, las redes neuronales basadas en gráficos proporcionan una forma natural de representar su estructura y dinámica. A medida que estos modelos de IA se vuelvan más sofisticados, podrían desbloquear conocimientos más profundos sobre la actividad y la cognición neural.

En última instancia, una mejor decodificación de las señales cerebrales podría allanar el camino para una nueva generación de tecnologías que permitan a los humanos interactuar con las máquinas de manera más fluida que nunca.

Si el progreso continúa a su ritmo actual, las interfaces cerebro-computadora pueden pronto transitar de herramientas de investigación experimental a tecnologías de asistencia cotidianas capaces de restaurar la independencia y la movilidad a millones de personas en todo el mundo.