زاوية Anderson

نحو السيطرة الكاملة في توليد الفيديو بالذكاء الاصطناعي

تعتبر نماذج الفيديو الأساسية مثل Hunyuan و Wan 2.1 قوية، ولكنها لا توفر للمستخدمين النوع من التحكم الدقيق الذي يتطلبه إنتاج الأفلام والتلفزيون (特别 في إنتاج التأثيرات البصرية).

في استوديوهات التأثيرات البصرية المهنية، يتم استخدام نماذج مفتوحة المصدر مثل هذه، إلى جانب نماذج الصور السابقة (بدلاً من نماذج الفيديو) مثل Stable Diffusion و Kandinsky و Flux، جنبًا إلى جنب مع مجموعة من أدوات الدعم التي تعمل على تعديل الإخراج الخام لتلبية الاحتياجات الإبداعية المحددة. عندما يقول المخرج، “يبدو ذلك رائعًا، ولكن هل يمكننا جعله أكثر [n] قليلاً؟” لا يمكنك الاستجابة بالقول إن النموذج ليس دقيقًا بما يكفي لمعالجة مثل هذه الطلبات.

بدلاً من ذلك، ستستخدم فريق التأثيرات البصرية بالذكاء الاصطناعي مجموعة من تقنيات CGI التقليدية و تقنيات التأليف، جنبًا إلى جنب مع إجراءات مخصصة وعمليات عمل تم تطويرها مع مرور الوقت، من أجل محاولة دفع حدود توليد الفيديو قليلاً إلى الأمام.

لذلك، بالتأمل، يكون نموذج الفيديو الأساسي مشابهًا للتثبيت الافتراضي لمتصفح الويب مثل Chrome؛ إنه يفعل الكثير من الصندوق، ولكن إذا كنت تريد أن يعتاد على احتياجاتك، بدلاً من العكس، فستحتاج إلى بعض الإضافات.

السيطرة على الأمور

في عالم توليد الصور بالانتشار، فإن النظام الأكثر أهمية من هذا القبيل هو ControlNet.

ControlNet هي تقنية لإضافة سيطرة منظمية إلى نماذج التوليد بالانتشار، مما يسمح للمستخدمين بتحديد توليد الصور أو الفيديو باستخدام مدخلات إضافية مثل خرائط الحواف أو خرائط العمق أو معلومات التموضع.

تسمح طرق ControlNet المختلفة بتوليد الصور بالعمق (الصف العلوي) والتقسيم السمانتي للصورة (الأسفل اليسار) وتوليد الصور الموجهة بالتموضع للبشر والحيوانات (الأسفل اليسار).

بدلاً من الاعتماد حصريًا على العبارات النصية، تقدم ControlNet فروعًا عصبية منفصلة، أو مُحسّنات، التي تعالج هذه الإشارات الشرطية أثناء الحفاظ على القدرات التوليدية للنموذج الأساسي.

هذا يسمح بإخراج دقيق يتوافق بشكل أوثق مع مواصفات المستخدم، مما يجعله مفيدًا بشكل خاص في التطبيقات التي تتطلب التحكم الدقيق في التكوين أو الهيكل أو الحركة:

يمكن الحصول على أنواع متعددة من الإخراج الدقيق من خلال ControlNet مع توجيه التموضع. مصدر: https://arxiv.org/pdf/2302.05543

然而، تعمل إطارات العمل هذه بشكل خارجي على مجموعة من العمليات العصبية التي تركز بشكل داخلي. لهذه النهج عدة عيوب.

أولاً، يتم تدريب المحسّنات بشكل مستقل، مما يؤدي إلى صراعات الفروع عند دمج عدة محسّنات، مما قد يؤدي إلى تدهور جودة التوليد.

ثانيًا، أنها تُ導ي إلى التكرار المعلمات، مما يتطلب حسابًا إضافيًا وذاكرة لكل محسّن، مما يجعل التوسيع غير فعال.

ثالثًا، على الرغم من مرونتها، غالبًا ما تنتج المحسّنات نتائج غير مثالية مقارنة بالنماذج التي يتم تعديلها بشكل كامل لتوليد متعدد الشرط.

من الأفضل أن يتم تدريب قدرات ControlNet أصالة في النموذج، بطريقة موديلار يمكن أن تستوعب الابتكارات المتوقعة في المستقبل مثل توليد الفيديو الصوتي المتزامن أو القدرة على التزام الاشارات الصوتية الأصلية (للملفات الصوتية الخارجية).

كما هو الحال، يمثل كل قطعة إضافية من الوظائف إما مهمة ما بعد الإنتاج أو إجراء غير أصلي يجب أن يجد طريقه عبر الأوزان الحساسة للغاية لنموذج أساسي معين.

FullDiT

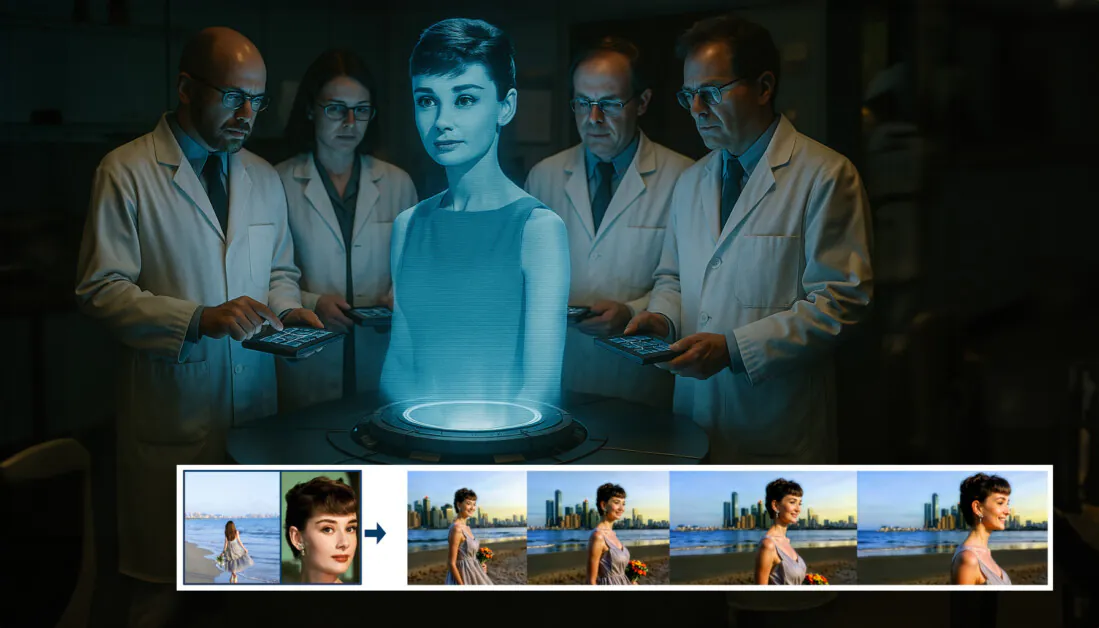

يدخل هذا النظام الجديد من الصين، والذي يطرح نظامًا حيث يتم دمج إجراءات ControlNet-style مباشرة في نموذج توليد فيديو عند وقت التدريب، بدلاً من أن يتم اعتباره فكرة ثانوية.

من الورقة الجديدة: يمكن لنهج FullDiT دمج إفراز الهوية والعمق وحركة الكاميرا في التوليد الأصلي، ويمكن استدعاء أي组 من هذه في نفس الوقت.

يُطلق على هذا النهج الجديد FullDiT، ويندمج مع شروط متعددة مثل نقل الهوية وخرائط العمق وحركة الكاميرا في جزء متكامل من نموذج توليد فيديو، ولذلك قام المؤلفون بإنشاء نموذج مُدرَّب وملفات فيديو مصاحبة في موقع المشروع.

في المثال التالي، نرى توليدات تحتوي على حركة الكاميرا ومعلومات الهوية والنص (أي تعليمات نصية توجيهية للمستخدم):

انقر للعب. أمثلة على فرض السيطرة على المستخدم مع نموذج أساسي مدرب أصلاً. مصدر: https://fulldit.github.io/

يجب ملاحظة أن المؤلفين لا يطرحون نموذجهم التجريبي المُدرَّب كنموذج أساسي وظيفي، بل كدليل概念ي على نماذج نص-فيديو (T2V) و صورة-فيديو (I2V) التي توفر للمستخدمين سيطرة أكبر من مجرد تعليمات نصية أو صورة.

منذ لا يوجد نماذج من هذا النوع حتى الآن، قام الباحثون بإنشاء معيار جديد يُسمى FullBench، لتقييم الفيديوهات متعددة المهام، وادعوا الأداء الأفضل في الاختبارات المماثلة التي صممواها ضد النهج السابقة. ومع ذلك، منذ أن تم تصميم FullBench بواسطة المؤلفين أنفسهم، فإن موضوعيته غير مدروسة، ومجموعة بياناته التي تضم 1400 حالة قد تكون محدودة جدًا لاستخلاص استنتاجات أوسع نطاقًا.

ربما يكون الجانب الأكثر إثارة للاهتمام في الهيكل الذي تقدمه الورقة هو إمكانية دمج أنواع جديدة من السيطرة. يقول المؤلفون:

‘في هذا العمل، نستكشف فقط شروط السيطرة على الكاميرا والهوية ومعلومات العمق. لم نستكشف بعد شروط أخرى ووسائط مثل الصوت والكلام والسحابة النقطية ومستطيلات الكائنات والتدفق البصري، إلخ. على الرغم من أن تصميم FullDiT يمكنه دمج وسائط أخرى بتعديلات معمارية طفيفة، فإن السؤال المهم الذي يبرر المزيد من الاستكشاف هو كيفية تعديل النماذج الحالية بسرعة وفعالية لتلبية شروط ووسائط جديدة.’

الطريقة

يُدعي المؤلفون أن آليتهم الموحدة للانتباه تمكن من تعلم تمثيلات أقوى عبر الوسائط من خلال التقاط العلاقات المكانية والزمنية عبر الشروط:

وفقًا للورقة الجديدة، يدمج FullDiT شروط الإدخال المتعددة من خلال الانتباه الكامل، مما يُحولها إلى تسلسل موحد. بالمقارنة، تستخدم نماذج المحسّنات (اليسار) وحدات منفصلة لكل إدخال، مما يؤدي إلى التكرار والصراعات وأداء أقل.

على عكس إعدادات المحسّنات التي تعالج كل تدفق إدخال بشكل منفصل، يمنع هذا الهيكل المتوحد للانتباه الصراعات بين الفروع ويقلل من الحمل المعلماتي. كما يُدعون أن الهيكل يمكن أن يتوسع لتشمل أنواع إدخال جديدة دون تعديلات هيكلية كبيرة.

في هيكل FullDiT، يتم تحويل جميع الإدخالات الشرطية – مثل النص وحركة الكاميرا والهوية والعمق – إلى تنسيق رمز موحد. ثم يتم دمج هذه الرموز في تسلسل طويل واحد، والذي يتم معالجته بواسطة طبقات من تحويلات الانتباه الكامل. هذا النهج يتبع أعمال سابقة مثل Open-Sora Plan و Movie Gen.

هذا التصميم يسمح للنموذج بتعلم العلاقات المكانية والزمنية بشكل مشترك عبر جميع الشروط. كل كتلة تحويل تعمل على التسلسل بأكمله، مما يسمح بالتفاعلات الديناميكية بين الوسائط دون الاعتماد على وحدات منفصلة لكل إدخال – كما أن الهيكل مصمم لتكون قابلًا للتوسيع، مما يسهل دمج إشارات سيطرة إضافية في المستقبل دون تغييرات هيكلية كبيرة.

قوة الثلاثة

يحول FullDiT كل إشارة سيطرة إلى تنسيق رمز معياري بحيث يمكن معالجتها جميعًا في إطار انتباه موحد.对于 حركة الكاميرا، يشفر النموذج تسلسلًا من المعلمات الخارجية – مثل الموقع والتوجيه – لكل إطار. يتم تحديد هذه المعلمات وتحويلها إلى متجهات غمر تعكس الطبيعة الزمنية للإشارة.

تُعالج معلومات الهوية بشكل مختلف، لأنها تتعلق بالمكان وليس بالزمن. يستخدم النموذج خرائط هوية تشير إلى أي شخصيات موجودة في أي جزء من كل إطار. يتم تقسيم هذه الخرائط إلى بatches، ويتم تحويل كل batch إلى غمر يلتقط الدلالات المكانية للهوية، مما يسمح للنموذج بالرابط بين مناطق محددة من الإطار مع كائنات محددة.

يتم التعامل مع العمق كإشارة مكانية وزمنية، ويتم تقسيم فيديوهات العمق إلى بatches ثلاثية الأبعاد تمتد عبر الفضاء والزمن. ثم يتم غمر هذه بatches بطريقة تحافظ على هيكلها عبر الإطارات.

بمجرد الغمر، يتم دمج جميع رموز الشروط هذه في تسلسل طويل واحد، مما يسمح لFullDiT بمعالجتها معًا باستخدام الانتباه الكامل. هذا الهيكل المشترك يسمح للنموذج بتعلم التفاعلات عبر الوسائط وعبر الوقت دون الاعتماد على تدفقات معالجة منفصلة.

البيانات والاختبارات

اعتمد نهج التدريب على FullDiT على مجموعات بيانات محددة تم تحديدها لแต่ละ نوع من الشروط الشرطية، بدلاً من تطلب جميع الشروط في نفس الوقت.

对于 الشروط النصية، اتبع النهج نهج التسمية المنظمة المحدد في مشروع MiraData.

خط أنابيب جمع البيانات وتنقيطها من مشروع MiraData. مصدر: https://arxiv.org/pdf/2407.06358

对于 حركة الكاميرا، كانت مجموعة بيانات RealEstate10K هي المصدر الرئيسي للبيانات، بسبب تعليماتها الدقيقة للبارامترات الكاميرا.

然而، لاحظ المؤلفون أن التدريب حصريًا على مجموعات بيانات الكاميرا الثابتة مثل RealEstate10K يميل إلى تقليل الحركات الديناميكية للأجسام والبشر في الفيديوهات المُولدة. لتحقيق ذلك، قاموا بتعديل إضافي باستخدام مجموعات بيانات داخلية تحتوي على حركات كاميرا أكثر ديناميكية.

تم توليد تعليمات الهوية باستخدام خط أنابيب تم تطويره لمشروع ConceptMaster، مما سمح بفلاتر واستخراج دقيق لمعلومات الهوية.

إطار ConceptMaster مصمم للتعامل مع مشاكل فك الارتباط الهوية مع الحفاظ على إخلاص المفاهيم في الفيديوهات المخصصة. مصدر: https://arxiv.org/pdf/2501.04698

تم الحصول على تعليمات العمق من مجموعة بيانات Panda-70M باستخدام Depth Anything.

التحسين من خلال ترتيب البيانات

كما قام المؤلفون بتنفيذ جدول تدريب تقدمي، حيث تم إدخال شروط أكثر تحديًا في وقت مبكر من التدريب لضمان حصول النموذج على تمثيلات قوية قبل إضافة مهام أبسط.

تمت متابعة ترتيب التدريب من النص إلى الكاميرا، ثم الهوية، وأخيرًا العمق، مع تمثيل المهام الأسهل بشكل عام في وقت لاحق وبأقل أمثلة.

يشدد المؤلفون على قيمة ترتيب العمل بهذه الطريقة:

‘خلال مرحلة التدريب المسبق، لاحظنا أن المهام الأكثر تحديًا تتطلب وقت تدريب أطول ويجب إدخالها في وقت مبكر من عملية التعلم. هذه المهام تتضمن توزيعات بيانات معقدة تختلف بشكل كبير عن الفيديو الإخراج، مما يتطلب من النموذج امتلاك القدرة الكافية لالتقاطها وتوضيحها بدقة. ‘

‘عكس ذلك، إدخال المهام الأسهل في وقت مبكر قد يؤدي إلى أن يركز النموذج على تعلمها أولاً، لأنها توفر ردود فعل تحسين فورية، مما يحد من تقارب المهام الأكثر تحديًا.’

تظهر الصورة ترتيب بيانات التدريب الذي اتبعه الباحثون، مع الحمرة تشير إلى حجم بيانات أكبر.

بعد التدريب المسبق الأولي، تم تعديل النموذج في مرحلة نهائية لتحسين جودة الصورة وديناميكيات الحركة. ثم اتبع التدريب نهج إطار الانتشار القياسي*: تم إضافة الضوضاء إلى لاتنسات الفيديو، وتم تعلم النموذج لتنبؤ بها وإزالتها، باستخدام رموز الشروط المدمجة كتوجيه.

لتحقيق تقييم عادل للنموذج وضمان مقارنة عادلة مع الأساليب السابقة، وقف المؤلفون FullBench، وهي مجموعة معايير مصنفة تتكون من 1400 حالة اختبار متميزة.

مثال على مستكشف البيانات لمعيار FullBench الجديد. مصدر: https://huggingface.co/datasets/KwaiVGI/FullBench

كل نقطة بيانات قدمت تعليمات حقيقية لشروط متعددة، بما في ذلك حركة الكاميرا و الهوية و العمق.

المقاييس

قيم المؤلفون FullDiT باستخدام عشرة مقاييس تغطي خمسة جوانب رئيسية للأداء: محاذاة النص وسيطرة الكاميرا وتماثل الهوية ودقة العمق وجودة الفيديو العامة.

تم قياس محاذاة النص باستخدام CLIP Similarity، في حين تم تقييم سيطرة الكاميرا من خلال خطأ الدوران (RotErr) و خطأ الترجمة (TransErr) و اتساق حركة الكاميرا (CamMC)، اتباع نهج CamI2V (في مشروع CameraCtrl).

تم تقييم تماثل الهوية باستخدام DINO-I و CLIP-I، وتم تقييم دقة سيطرة العمق باستخدام Mean Absolute Error (MAE).

تم تقييم جودة الفيديو باستخدام ثلاثة مقاييس من MiraData: محاذاة CLIP على مستوى الإطارات للاستمرارية؛ مسافة الحركة البصرية للاستمرارية؛ و LAION-Aesthetic scores لجاذبية الصورة.

التدريب

قام المؤلفون بتدريب FullDiT باستخدام نموذج انتشار نص-فيديو داخلي يحتوي على حوالي مليار معلمة. اختاروا عمدًا حجم معلمات معقول لضمان العدالة في المقارنات مع الأساليب السابقة وضمان إمكانية إعادة الإنتاج.

نظرًا لأن الفيديوهات تختلف في الطول والدقة، قام المؤلفون بتحويل كل دفعة من خلال تحجيم الفيديوهات وتعبئتها إلى دقة مشتركة، عينة 77 إطارًا لكل تسلسل، واستخدام الانتباه التطبيقي و مasks الخسارة لتحسين فعالية التدريب.

تم استخدام مُحسِّن Adam عند معدل تعلم 1×10−5 عبر مجموعة من 64 من وحدات معالجة الرسومات NVIDIA H800، ل总 5120 جيجابايت من ذاكرة الوصول العشوائي (الذاكرة العشوائية) (تخيل أن 24 جيجابايت على RTX 3090 ما زال معيارًا فاخرًا في مجتمعات التركيب).

تم تدريب النموذج لمدة تقريبًا 32000 خطوة، مع تضمين ما يصل إلى ثلاثة هويات لكل فيديو، إلى جانب 20 إطارًا من شروط الكاميرا و 21 إطارًا من شروط العمق، كلاهما تم عينتهما بشكل متساوٍ من 77 إطارًا.

对于 الاستدلال، تم توليد الفيديوهات بدقة 384×672 بكسل (حوالي خمس ثوانٍ عند 15 إطارًا في الثانية) مع 50 خطوة استدلال انتشار وقياس توجيه تصنيف حر بدون 5.

الأساليب السابقة

对于 تقييم الكاميرا-فيديو، قام المؤلفون بمقارنة FullDiT مع MotionCtrl و CameraCtrl و CamI2V، مع جميع النماذج المُدرَّبة باستخدام مجموعة بيانات RealEstate10k لضمان الاتساق والعدالة.

في توليد الهوية المشروطة، نظرًا لعدم وجود نماذج متعددة الهوية مفتوحة المصدر قابلة للمقارنة، تم تقييم النموذج ضد نموذج ConceptMaster ذي المعلمات البالغة 1 مليار، باستخدام نفس البيانات والهيكل.

对于 مهام العمق-فيديو، تم إجراء المقارنات مع Ctrl-Adapter و ControlVideo.

النتائج الكمية لتوليد الفيديو الواحد. تم مقارنة FullDiT مع MotionCtrl و CameraCtrl و CamI2V لتوليد الكاميرا-فيديو؛ ConceptMaster (إصدار 1 مليار معلمة) لتوليد الهوية-فيديو؛ و Ctrl-Adapter و ControlVideo لتوليد العمق-فيديو. تم تقييم جميع النماذج باستخدام إعداداتها الافتراضية. من أجل الاتساق، تم عينة 16 إطارًا بشكل موحد من كل طريقة، مما يطابق طول الإخراج لنماذج سابقة.

تشير النتائج إلى أن FullDiT، على الرغم من معالجته لإشارات شرطية متعددة في نفس الوقت، حقق أداءً أفضل من النماذج السابقة في المقاييس المتعلقة بالنص وحركة الكاميرا والهوية والعمق.

في المقاييس العامة للجودة، تفوقت الطريقة بشكل عام على الأساليب الأخرى، على الرغم من أن استمراريتها كانت أقل قليلاً من ConceptMaster. يعلق المؤلفون:

‘استمرارية FullDiT أقل قليلاً من ConceptMaster لأن حساب الاستمرارية يعتمد على محاذاة CLIP بين الإطارات المجاورة. نظرًا لأن FullDiT يظهر ديناميكيات أكبر بكثير من ConceptMaster، فإن مقياس الاستمرارية يتأثر بالتغيرات الكبيرة بين الإطارات المجاورة. ‘

‘对于 درجة الجمال، نظرًا لأن نموذج التقييم يفضل الصور بالنمط التصويري، وغالبًا ما يولد ControlVideo فيديوهات بهذا النمط، يحقق درجة جمال عالية.’

بخصوص المقارنة النوعية، قد يكون من الأفضل الرجوع إلى مقاطع الفيديو العينة في موقع مشروع FullDiT، لأن الأمثلة في الوثيقة هي ثابتة (وأيضًا كبيرة جدًا للاستنساخ هنا).

القسم الأول من النتائج النوعية في الوثيقة. يُرجى الرجوع إلى الورقة الأصلية للمزيد من الأمثلة، والتي هي واسعة جدًا للاستنساخ هنا.

يعلق المؤلفون:

‘يُظهر FullDiT الحفاظ على الهوية الأفضل وتوليد فيديوهات ذات ديناميكيات وجمال بصري أفضل مقارنةً بـ [ConceptMaster]. منذ أن تم تدريب ConceptMaster و FullDiT على نفس الهيكل الأساسي، هذا يبرز فعالية حقن الشروط بالانتباه الكامل. ‘

‘… النتائج الأخرى تظهر السيطرة والجودة التوليدية الأفضل لFullDiT مقارنةً بالأساليب الحالية لتوليد العمق-فيديو والكاميرا-فيديو.’

قسم من الأمثلة في الوثيقة لخرج FullDiT مع إشارات متعددة. يُرجى الرجوع إلى الورقة الأصلية وموقع المشروع للمزيد من الأمثلة.

الاستنتاج

على الرغم من أن FullDiT هو نهج مثير في نوع أكثر تطورًا من نماذج الفيديو الأساسية، يتعين التساؤل عما إذا كان الطلب على أدوات ControlNet-style سيبرر في يوم ما تنفيذ هذه الميزات في نطاق واسع، على الأقل بالنسبة لمشاريع البرمجيات الحرة والمفتوحة المصدر، والتي ستواجه صعوبة في الحصول على كمية هائلة من طاقة معالجة GPU دون دعم تجاري.

التحدي الرئيسي هو أن استخدام أنظمة مثل العمق والتموضع يتطلب عادةً معرفة جيدة بالواجهات المستخدمة المعقدة نسبيًا مثل ComfyUI. لذلك، يبدو أن نموذجًا وظيفيًا من هذا القبيل من البرمجيات الحرة والمفتوحة المصدر سيكون أكثر احتمالًا لتطويره بواسطة مجموعة من الشركات الصغيرة لتقنيات التأثيرات البصرية التي تفتقر إلى الموارد المالية (أو الإرادة، مع考虑 أن هذه الأنظمة يتم إصدارها بسرعة بواسطة تحديثات النماذج) لتحضير وتدريب مثل هذا النموذج خلف أبواب مغلقة.

من ناحية أخرى، قد تكون أنظمة API-المحركة (‘استأجر الذكاء الاصطناعي’) محفزة جيدًا لتطوير أساليب تفسيرية أبسط وأكثر واجهة مستخدم友ية لنماذج تم دمج أنظمة التحكم فيها بشكل مباشر.

انقر للعب. سيطرة العمق + النص على توليد الفيديو باستخدام FullDiT.

* المؤلفون لا يحددون أي نموذج أساسي معروف (مثل SDXL، إلخ.)

نشر لأول مرة يوم الخميس، 27 مارس 2025