الذكاء الاصطناعي

生成 العبارات باستخدام التعلم التعزيزي العميق – Thought Leaders

عندما نكتب أو نتحدث ، كلنا قد تساءلنا عما إذا كان هناك طريقة أفضل للتواصل مع الآخرين. ما الكلمات التي يجب أن أستخدمها؟ كيف يجب أن أهيكل الفكرة؟ كيف سيكون رد فعل المستمع؟ في Phrasee ، نقضي الكثير من الوقت في التفكير في اللغة – ما يعمل وما لا يعمل.

تخيل أنك تكتب سطر الموضوع لبريد إلكتروني سيتم إرساله إلى 10 ملايين شخص في قائمة البريد الإلكتروني الخاصة بك للترويج لخصم 20٪ على جهاز كمبيوتر محمول جديد فاخر.

أي سطر سوف تختاره:

- يمكنك الآن الحصول على خصم إضافي بنسبة 20٪ على طلبك التالي

- استعد – خصم إضافي بنسبة 20٪

على الرغم من أنهم ينقلون نفس المعلومات ، إلا أن أحدهم حقق معدل فتح أعلى بنسبة 15٪ تقريباً من الآخر (وأنا أراهن أنك لا تستطيع أن تتفوق على نموذجنا في التنبؤ بأيهما ?). بينما يمكن اختبار اللغة غالباً من خلال اختبار A/B أو مشكلة الباندت المسلح ، يبقى توليد العبارات بشكل تلقائي مشكلة بحثية صعبة للغاية.

يُعتبر جملتان متوافقتين إذا كانتا تشتركان نفس المعنى ويمكن استخدامهما بالتبادل. شيء آخر مهم غالباً ما يؤخذ بالمجاملة هو ما إذا كانت الجملة التي تم إنشاؤها بواسطة الآلة سائلة.

على عكس التعلم الإشرافي ، يتعلم وكلاء التعلم التعزيزي (RL) من خلال التفاعل مع بيئتهم وملاحظة المكافآت التي يحصلون عليها نتيجة لذلك. هذا الفرق الدقيق له آثار كبيرة على كيفية عمل الخوارزميات وكيف يتم تدريب النماذج. يستخدم التعلم التعزيزي العميق الشبكات العصبية كدالة تقريبية لتمكين الوكيل من التعلم كيفية التفوق على البشر في بيئات معقدة مثل جوجو و ستار كرافت II.

على الرغم من هذا النجاح ، لم يتم تطبيق التعلم التعزيزي على نطاق واسع على مشاكل العالم الحقيقي ، بما في ذلك معالجة اللغة الطبيعية (NLP).

كجزء من أطروحتي الماجستير في علوم البيانات ، نُظهر كيف يمكن استخدام التعلم التعزيزي العميق لتفوق الأساليب الإشرافية في توليد العبارات تلقائياً. يمكن اعتبار مشكلة توليد أفضل عبارة على أنها العثور على السلسلة من الكلمات التي تزيد من التشابه الدلالي بين الجمل مع الحفاظ على السلاسة في الإخراج. وكلاء RL مناسبون للعثور على أفضل مجموعة من الإجراءات لتحقيق المكافأة المتوقعة القصوى في بيئات التحكم.

في مقابل معظم مشاكل التعلم الآلي ، لا تكمن أكبر مشكلة في معظم تطبيقات توليد اللغة الطبيعية (NLG) في النمذجة ولكن في التقييم. بينما يُعتبر التقييم البشري حالياً المعيار الذهبي في تقييم NLG ، إلا أنه يعاني من عيوب كبيرة بما في ذلك كونه مكلفاً ومستهلكاً للوقت وصعباً في ضبطه ونقص التكرار عبر التجارب والبيانات (Han، 2016). ونتيجة لذلك ، فقد سعى الباحثون طويلاً إلى العثور على مقاييس تلقائية بسيطة وقابلة للتعميم والتي تعكس الحكم البشري (Papineni et al.، 2002).

يتم تلخيص أكثر الطرق الشائعة لتقييم تلقائي في تقييم تعليقات الصور التي تم إنشاؤها بواسطة الآلة فيما يلي مع فوائدها وعيوبها:

توليد العبارات باستخدام التعلم التعزيزي

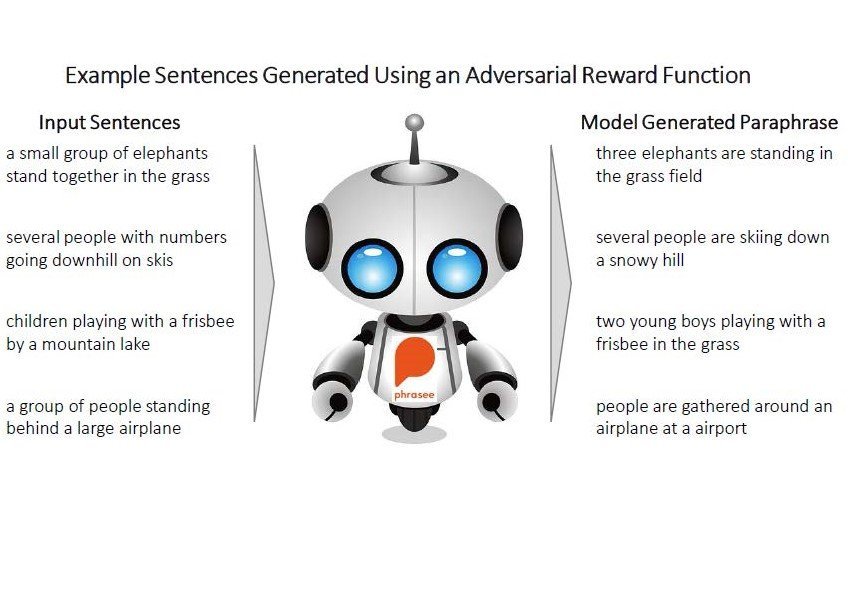

لقد طورنا نظامًا يسمى ParaPhrasee الذي يولد عبارات عالية الجودة. يتكون النظام من عدة خطوات من أجل تطبيق التعلم التعزيزي بطريقة فعالة من حيث الحاسوب. يظهر تلخيص موجز للخطوط العريضة أدناه مع مزيد من التفاصيل في الأطروحة.

مجموعة البيانات

هناك العديد من مجموعات بيانات العبارات المتاحة التي يتم استخدامها في البحث ، بما في ذلك: مجموعة بيانات العبارات من مايكروسوفت ، و أسئلة دублиكيت Quora ، و روابط تويتر المشتركة. لقد اخترنا MS-COCO نظراً لحجمها ونظافتها واعتبارها معياراً لورقين توليد عبارات.

نموذج إشرافي

في حين أن التعلم التعزيزي قد تحسن بشكل كبير من حيث كفاءة العينة وأوقات التدريب وأفضل الممارسات العامة ، فإن تدريب نماذج RL من الصفر لا يزال بطيئاً وغير مستقر نسبياً (Arulkumaran et al.، 2017). لذلك ، بدلاً من التدريب من الصفر ، نقوم أولاً بتدريب نموذج إشرافي ثم نضيفه باستخدام RL.

نستخدم إطار عمل الترميز-فك الترميز وتقييم أداء عدة نماذج إشرافية أساسية. عند تحسين النموذج باستخدام RL ، نقوم بتحسين الشبكة الديكودر فقط ونعتبر الشبكة الترميزية ساكنة. ونتيجة لذلك ، نعتبر إطاران رئيسيان:

- تدريب النموذج الإشرافي من الصفر باستخدام ترميز-فك الترميز القياسي مع GRUs

- استخدام نماذج التضمين الجملة المسبقة التدريب للترميز بما في ذلك: التضمين الكلمة المجمعة (GloVe) ، InferSent ، و BERT

تؤدي النماذج الإشرافية بشكل جيد بشكل عام مع تحقيق BERT والترميز-فك الترميز الفانيليا لأفضل أداء.

في حين أن الأداء يعتبر معقولاً ، هناك ثلاثة مصادر شائعة للأخطاء: التكرار ، وتوليد شظايا الجملة ، والهلوسة. هذه هي المشاكل الرئيسية التي يهدف استخدام RL إلى حلها.

نموذج التعلم التعزيزي

تطبيق خوارزميات RL صعب للغاية ، خاصة عندما لا تعرف ما إذا كان يمكن حل المشكلة. يمكن أن يكون هناك مشاكل في تطبيق بيئتك ، وكلائك ، ومتغيراتك ، ودالة المكافأة ، أو مزيج من كل ذلك! وتتزايد هذه المشاكل عند القيام بالتعلم التعزيزي العميق لأنك تحصل على متعة التعقيد الإضافي لتصحيح الأخطاء في الشبكات العصبية.

كما هو الحال مع جميع تصحيح الأخطاء ، من الحاسم البدء ببساطة. لقد قمنا بتطبيق تحورات من两个 بيئات لعبة RL متعارف عليها جيداً (CartPole و FrozenLake) لاختبار خوارزميات RL وfinding استراتيجية قابلة للتكرار لنقل المعرفة من النموذج الإشرافي.

وجدنا أن استخدام خوارزمية Actor-Critic يتفوق على REINFORCE في هذه البيئات. فيما يتعلق بنقل المعرفة إلى نموذج Actor-Critic ، وجدنا أن 초기ّة أوزان Actor مع النموذج الإشرافي المدرب وpretraining الناقد حقق أفضل أداء. وجدنا أنه من الصعب تعميم نهج التبخير السياسي المتقدم إلى بيئات جديدة لأنها تقدم العديد من متغيرات الحyper جديدة التي تتطلب ضبطها للعمل.

مدعومة بهذه الاكتشافات ، ثم ننتقل إلى تطوير نهج لتوليد العبارات. أولاً ، نحتاج إلى إنشاء بيئة.

تسمح لنا البيئة بسهولة اختبار تأثير استخدام مقاييس تقييم مختلفة كدالات مكافأة.

ثم نعرف الوكيل ، نظراً لعدة مزايا ، نستخدم هيكلاً Actor-Critic. يُستخدم Actor لتحديد الكلمة التالية في التسلسل ويتضمن أوزانه المحددة باستخدام النموذج الإشرافي. يوفر Critic تقديراً للمكافأة المتوقعة التي من المحتمل أن تتلقاها الحالة لمساعدة Actor على التعلم.

تصميم دالة المكافأة الصحيحة

المكون الأكثر أهمية في تصميم نظام RL هو دالة المكافأة لأن هذا ما يحاول وكيل RL تحسينه. إذا كانت دالة المكافأة خاطئة ، فإن النتائج ستتعرض للاضطراب حتى لو عمل كل جزء آخر من النظام!