الذكاء الاصطناعي

Mistral AI: وضع معايير جديدة في الفضاء المفتوح ما وراء Llama2

أصبحت نماذج اللغة الكبيرة (LLMs) حديث الساعة مؤخرًا، بفضل أداء متميز مثل ChatGPT. عندما قدمت Meta نماذج Llama، أثار ذلك اهتمامًا متجددًا بنماذج LLM المفتوحة المصدر. الهدف؟ إنشاء نماذج LLM مفتوحة المصدر وبأسعار معقولة، تكون جيدة مثل النماذج من الطراز الأعلى مثل GPT-4، ولكن بدون التكلفة الباهظة أو التعقيد.

هذا المزيج من التكلفة والكفاءة لم يفتح مجالات جديدة فقط للباحثين والمطورين، بل وضع أيضًا المسرح لموجة جديدة من التقدم التكنولوجي في معالجة اللغة الطبيعية.

最近، كانت الشركات الناشئة في مجال الذكاء الاصطناعي التوليدي على صعود مع التمويل. معًا جمعت 20 مليون دولار، بهدف تشكيل الذكاء الاصطناعي المفتوح المصدر. كما جمعت Anthropic 450 مليون دولار، وشراكة Cohere مع Google Cloud، جمعت 270 مليون دولار في يونيو هذا العام.

مقدمة إلى Mistral 7B: الحجم والتوافر

أعلنت Mistral AI، التي تتخذ من باريس مقرًا لها وشارك في تأسيسها خريجون من DeepMind وMeta، عن أول نموذج لغة كبير: Mistral 7B. يمكن تحميل هذا النموذج بسهولة بواسطة أي شخص من GitHub و даже عبر 13.4 غيغابايت تورنت.

هذه الشركة الناشئةmanaged إلى تأمين تمويل البذرة الرقم القياسي حتى قبل إطلاق منتجها. نموذج Mistral الأول مع 7 مليار معامل يتفوق على أداء Llama 2 13B في جميع الاختبارات ويهزم Llama 1 34B في العديد من المقاييس.

مقارنةً بنماذج أخرى مثل Llama 2، يوفر Mistral 7B قدرات مماثلة أو أفضل مع انخفاض في الحمل الحاسوبي. بينما يمكن للنماذج الأساسية مثل GPT-4 تحقيق المزيد، فإنها تأتي بتكلفة أعلى وليست سهلة الاستخدام لأنها متاحة بشكل رئيسي من خلال واجهات برمجة التطبيقات.

عندما يتعلق الأمر بمهام البرمجة، يعطي Mistral 7B CodeLlama 7B فرصة للتنافس. بالإضافة إلى ذلك، فهو مضغوط بما يكفي عند 13.4 غيغابايت ليعمل على أجهزة معيارية.

كما أظهر Mistral 7B Instruct، الذي تم ضبطه خصيصًا لمجموعات بيانات تعليمية على Hugging Face، أداءً رائعًا. يتفوق على نماذج أخرى من 7B في MT-Bench ويتعادل مع نماذج الدردشة 13B.

Hugging Face Mistral 7B Example

اختبارات الأداء

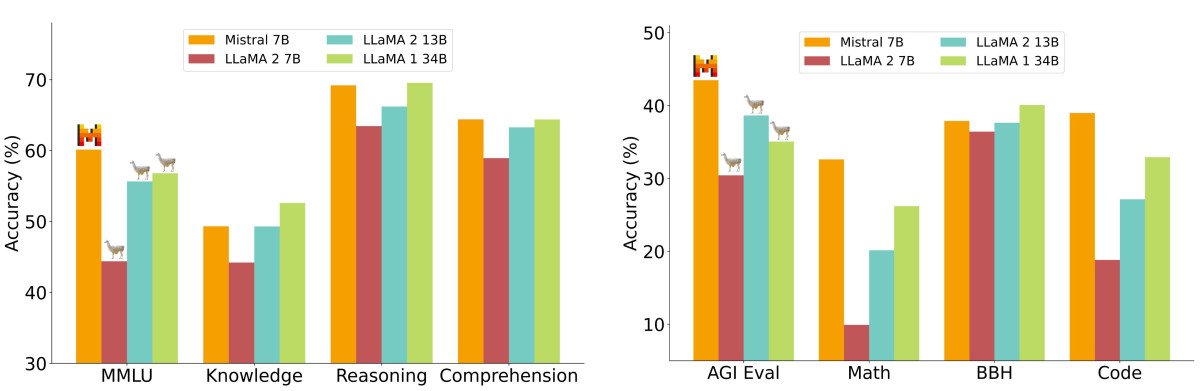

في تحليل أداء مفصل، تم قياس Mistral 7B ضد نماذج عائلة Llama 2. كانت النتائج واضحة: Mistral 7B يتفوق بشكل كبير على Llama 2 13B عبر جميع الاختبارات. في الواقع، كان يطابق أداء Llama 34B، و特别 يبرز في اختبارات البرمجة والاستدلال.

تم تنظيم الاختبارات في فئات متعددة، مثل الاستدلال الشائع والمعرفة العالمية وفهم القراءة والرياضيات والبرمجة، من بين أخرى. كانت ملاحظة ملحوظة بشكل خاص هي معيار التكلفة والأداء لشركة Mistral 7B، المسمى “حجم النموذج المعادل”. في مجالات مثل الاستدلال والفهم، أظهر Mistral 7B أداءً مشابهًا لنموذج Llama 2 ثلاث مرات حجمه، مما يشير إلى توفيرات محتملة في الذاكرة وزيادة في الإنتاجية. ومع ذلك، في اختبارات المعرفة، كان Mistral 7B يتوافق بشكل وثيق مع Llama 2 13B، وهو ما يُعزى على الأرجح إلى قيود المعاملات التي تؤثر على ضغط المعرفة.

ما الذي يجعل نموذج Mistral 7B أفضل من معظم نماذج اللغة الأخرى؟

تبسيط آليات الانتباه

في حين أن دقائق آليات الانتباه هي تقنية، فإن فكرتهم الأساسية بسيطة نسبيًا. تخيل قراءة كتاب وتحديد الجمل المهمة؛ هذا مشابه لآليات الانتباه “تُبرز” أو تعطي أهمية لنقاط البيانات المحددة في التسلسل.

في سياق نماذج اللغة، تمكن هذه الآليات النموذج من التركيز على أجزاء المدخلات الأكثر صلة، مما يضمن أن الإخراج يكون متسقًا ودقيقًا سياقيًا.

في المحولات القياسية، يتم حساب درجات الانتباه باستخدام الصيغة:

الصيغة لدرجات هذه تتضمن خطوة حاسمة – الضرب المصفوفي لـ Q و K. التحدي هنا هو أن مع نمو طول التسلسل، تتوسع كل من Матриكس Q و K بشكل متناسب، مما يؤدي إلى عملية حسابية مكثفة. هذا القلق من حيث القابلية للتوسيع هو أحد الأسباب الرئيسية التي تجعل المحولات القياسية بطيئة، خاصة عند التعامل مع تسلسلات طويلة.

الانتباه المتعدد الاستعلام (MQA) يسرع الأمور من خلال استخدام مجموعة واحدة من “مفتاح-قيمة” الرؤوس، ولكن في بعض الأحيان يضحي بالجودة. الآن، قد تتساءل، لما لا تجمع بين سرعة MQA وجودة الانتباه المتعدد الرؤوس؟ هذا هو حيث يأتي الانتباه المجموع الاستعلام (GQA).

انتباه المجموعة الاستعلام (GQA)

GQA هو حل وسط. بدلاً من استخدام رؤوس “مفتاح-قيمة” واحدة أو متعددة، يتم تجميعها. بهذه الطريقة، يتحقق GQA من أداء قريب من الانتباه المتعدد الرؤوس المفصل، ولكن بسرعة MQA. بالنسبة لنماذج مثل Mistral، هذا يعني أداءً فعالًا دون المساس كثيرًا بالجودة.

انتباه نافذة الانزلاق (SWA)

النافذة المنزلقة هي طريقة أخرى تستخدم في معالجة تسلسلات الانتباه. هذه الطريقة تستخدم نافذة انتباه بحجم ثابت حول كل رمز في التسلسل. مع تجميع هذه النافذة الانتباهية في طبقات متعددة، تكتسب الطبقات العليا في النهاية منظورًا أوسع، شاملاً المعلومات من всей المدخلات. هذه الآلية مشابهة للمجالات المستقبلة في شبكات العصبية التلافيفية (CNNs).

من ناحية أخرى، الانتباه النافذة المنزلقة الممددة للنموذج Longformer، الذي ي концепت مشابه لطريقة النافذة المنزلقة، يحسب فقط بعض القطر من المصفوفة. هذا التغيير يؤدي إلى زيادة استخدام الذاكرة بشكل خطي بدلاً من التربيعي، مما يجعله أسلوبًا أكثر كفاءة للتعامل مع تسلسلات أطول.

شفافية Mistral AI مقابل مخاوف الأمان في اللامركزية

في إعلانها، شددت Mistral AI على الشفافية مع البيان: “لا حيل، لا بيانات مملوكة”. ولكن في الوقت نفسه، النموذج الوحيد المتاح حاليًا هو ‘Mistral-7B-v0.1’ وهو نموذج قاعدة مسبق التدريب، وبالتالي يمكنه توليد استجابة لأي استعلام دون تحكم، مما يثير مخاوف أمنية محتملة. بينما تملك نماذج مثل GPT و Llama آليات لتحديد متى الاستجابة، قد يتم استغلال طبيعة Mistral اللامركزية من قبل الأفراد السيئين.

然而، تملك اللامركزية لنماذج اللغة الكبيرة مزاياها. بينما قد يسيء بعض الأفراد استخدامها، يمكن للأشخاص استخدام قوتها من أجل الخير الاجتماعي وجعل الذكاء متاحًا للجميع.

مرونة التوزيع

من المزايا الرئيسية أن Mistral 7B متاح تحت رخصة Apache 2.0. هذا يعني أنه لا توجد حواجز حقيقية لاستخدامه – سواء كنت تستخدمه لأغراض شخصية أو شركة كبيرة أو حتى كيان حكومي. كل ما تحتاجه هو النظام الصحيح لتشغيله، أو قد تحتاج إلى الاستثمار في موارد السحابة.

في حين توجد رخص أخرى مثل رخصة MIT البسيطة و رخصة CC BY-SA-4.0 التشاركية، التي تتطلب الإعتراف والترخيص المماثل للمشتقات، توفر رخصة Apache 2.0 أساسًا قويًا للمشاريع على نطاق كبير.

أفكار الختام

ترمز صعود نماذج اللغة الكبيرة المفتوحة المصدر مثل Mistral 7B إلى تحول حاسم في صناعة الذكاء الاصطناعي، مما يجعل نماذج اللغة عالية الجودة متاحة لفئة أوسع. توعد نهج Mistral AI المبتكر، مثل الانتباه المجموع الاستعلام و الانتباه النافذة المنزلقة، بأداء فعال دون المساس بالجودة.

في حين تطرح طبيعة Mistral اللامركزية بعض التحديات، تؤكد مرونتها وترخيصها المفتوح على إمكانية ديمقراطية الذكاء الاصطناعي. مع تطور المناظر، سيكون التركيز في النهاية على موازنة قوة هذه النماذج مع الاعتبارات الأخلاقية وآليات الأمان.

ماذا يأتي بعد Mistral؟ كان نموذج 7B فقط البداية. يهدف الفريق إلى إطلاق نماذج أكبر قريبًا. إذا كانت هذه النماذج الجديدة تتماشى مع أداء 7B، قد يصعد Mistral بسرعة كلاعب رائد في الصناعة، كل ذلك في течение عامهم الأول.