الذكاء الاصطناعي

LoReFT: ضبط دقيق للتمثيلات لنموذج اللغة

تستهدف طرق ضبط دقيق للparameters أو PeFT تعديل نماذج اللغة الكبيرة من خلال تحديث عدد صغير من الأوزان. ومع ذلك، أظهرت غالبية الأعمال الحالية المتعلقة بالتفسير أن التمثيلات ترميز المعلومات الغنية семантиًا، مما يشير إلى أنها قد تكون بديلاً أفضل وأكثر قوة لتعديل هذه التمثيلات. يتم ضبط النماذج الكبيرة المسبقة التدريب للاستخدام في مجالات أو مهام جديدة، وخلال عملية الضبط الدقيق، يمكن تعديل نموذج قاعدة واحد لعدد كبير من المهام حتى مع توفر كميات صغيرة من البيانات في المجال المتاح للنموذج. ومع ذلك، فإن عملية ضبط النموذج بأكمله تستنفذ الموارد وتكلف، خاصة بالنسبة لنموذج اللغة ذي عدد كبير من الحجم والمعلمات.

ت提议 طرق ضبط دقيق للparameters أو PeFT لمواجهة التكاليف العالية المرتبطة بضبط النموذج كله عن طريق تحديث جزء صغير فقط من الأوزان الإجمالية المتاحة، وهو عملية تساعد في تقليل وقت التدريب جنبًا إلى جنب مع استخدام الذاكرة. ما هو أكثر أهمية هو أن طرق ضبط دقيق للparameters أو PeFT قد أظهرت أداءً مشابهًا لضبط دقيق في العديد من الإعدادات العملية. تعلم التعديلات، وهي عائلة شائعة من طرق ضبط دقيق للparameters أو PeFT، تعلم تعديلًا يمكن إضافته إلى مجموعة إضافية من الأوزان التي تعمل جنبًا إلى جنب مع نموذج القاعدة المجمد، وتعلم التعديلات الحديثة مثل LoRA تقلل من عدد المعلمات القابلة للتدريب في تحديثات الأوزان المتعلمة باستخدام تقريبات منخفضة الرتبة بدلاً من مصفوفات الوزن الكاملة عند تدريب التعديلات.

مع أعمال سابقة تظهر أن تعديل التمثيلات قد يكون بديلاً أفضل لطرق ضبط دقيق للparameters أو PeFT، في هذه المقالة، سنناقش طرق ضبط دقيق للتمثيلات أو ReFT التي تعمل على نموذج مجمد، وتعلم تدخلات محددة للمهمة على التمثيلات المخفية. تهدف هذه المقالة إلى تغطية إطار عمل ReFT أو ضبط دقيق للتمثيلات بعمق، ونستكشف الآلية والمنهجية وهيكل الإطار جنبًا إلى جنب مع مقارنته بالإطارات العمل الحالية. لذا دعونا نبدأ.

ReFT: ضبط دقيق للتمثيلات لنموذج اللغة

في محاولة لتعديل نماذج اللغة المسبقة التدريب لاستخدامها في مجالات ومهام جديدة، يتم ضبط هذه النماذج المسبقة التدريب بشكل متكرر، حيث يمكن تعديل نموذج قاعدة واحد لعدد كبير من المهام حتى مع العمل مع كميات صغيرة من البيانات في المجال. على الرغم من أن عملية الضبط الدقيق تزيد من الأداء العام، إلا أنها عملية مكلفة، خاصة إذا كان نموذج اللغة ذا عدد كبير من المعلمات. لمواجهة هذه القضية، وتقليل التكاليف المرتبطة بها، تقوم إطارات ضبط دقيق للparameters أو PeFT بتحديث جزء صغير فقط من الأوزان الإجمالية، وهو عملية لا تقلل فقط من وقت التدريب ولكن أيضًا تقلل من استخدام الذاكرة، مما يسمح لإطارات PeFT بالحصول على أداء مشابه لطرق ضبط دقيق كاملة في السيناريوهات العملية. تعلم التعديلات، وهي عائلة شائعة من PeFTs، تعمل عن طريق تعلم تعديل يمكن إضافته إلى مجموعة إضافية من الأوزان جنبًا إلى جنب مع مجموعة فرعية من الأوزان التي تعمل مع نموذج القاعدة المجمد.

تIGHLIGHT من الإطارات الحالية لضبط دقيق للparameters أو PeFT هو أنهم يعدلون الأوزان بدلاً من التمثيلات. ومع ذلك، أظهرت الإطارات المتعلقة بالتفسير أن التمثيلات ترميز معلومات غنية семантиًا، مما يشير إلى أن تعديل التمثيلات قد يكون بديلاً أفضل وأكثر قوة مقارنة بتحديثات الأوزان. هذا الافتراض بأن تعديل التمثيلات هو بديل أفضل هو ما يشكل أساس إطار عمل ReFT أو ضبط دقيق للتمثيلات، الذي يعلم التدخلات بدلاً من تعديل معلمات النموذج، مما يسمح للنموذج بتعديل جزء صغير من جميع التمثيلات في محاولة لتوجيه سلوك النموذج لحل مهام المصب خلال الاستدلال. تعتبر طرق ReFT أو ضبط دقيق للتمثيلات بديلاً لطرق PeFT أو ضبط دقيق للparameters القائمة على الوزن. يعتمد نهج ReFT على نماذج حديثة تعمل مع تفسير النماذج الكبيرة، وتدخل على التمثيلات للعثور على آليات سببية مخلصة، وتوجيه سلوك النموذج خلال الاستدلال، ويمكن اعتباره توسيعًا لإطارات تعديل التمثيلات.

moving على طول، على عكس ضبط دقيق كامل، تقوم إطار PeFT أو ضبط دقيق للparameters بتدريب فقط جزء صغير من معلمات النموذج، وتنجح في تعديل النموذج لمهام المصب. يمكن تصنيف إطار PeFT أو ضبط دقيق للparameters إلى ثلاث فئات رئيسية:

- طرق التعديلات القائمة على التعلم: تعلم التعديلات القائمة على التعلم طبقات متصلة بشكل كامل على رأس النموذج المسبق التدريب ذي الأوزان المجمدة. تعلم التعديلات المتسلسلة إدراج مكونات بين طبقات متعددة الطبقات أو MLP وطبقات الانتباه أو LM، في حين أن التعديلات المتوازية تضيف مكونات جنبًا إلى جنب مع المكونات الحالية. نظرًا لأن التعديلات تضيف مكونات جديدة لا يمكن دمجها بسهولة في أوزان النموذج الحالية، فإنها تفرض عبئًا إضافيًا خلال الاستدلال.

- LoRA: تقريبات LoRA، جنبًا إلى جنب مع متغيراتها الحديثة، تقريبات الأوزان الإضافية أثناء التدريب باستخدام مصفوفات منخفضة الرتبة، ولا تتطلب أي عبء إضافي خلال الاستدلال لأن تحديثات الأوزان يمكن دمجها في النموذج، وهو السبب في اعتبارها الإطارات PeFT الأقوى حاليًا.

- طرق القوالب: تعلم طرق القوالب رموز لينة تم 初始化 بشكل عشوائي إلى الإدخال، ويعلم التضمين الخاص بهم مع الحفاظ على أوزان نموذج اللغة المجمدة. الأداء المقدم من هذه الطرق غالبًا ما لا يكون مرضيًا مقارنة بطرق PeFT الأخرى، كما أنه يحمل عبئًا كبيرًا للاستدلال.

بدلاً من تحديث الأوزان، يعلم إطار ReFT التدخلات لتعديل جزء صغير من التمثيلات الإجمالية. علاوة على ذلك، أظهرت الأعمال الحديثة حول هندسة التمثيلات وتوجيه التنشيط أن إضافة متجهات التوجيه الثابتة إلى التيار المتبقي قد تسهل درجة من التحكم في توليد النماذج الكبيرة المسبقة التدريب دون الحاجة إلى ضبط دقيق مكلف للموارد.

ReFT: المنهجية والهيكل

为了 الحفاظ على عملية الحفاظ على الأسلوب، يفترض إطار ReFT نموذجًا كبيرًا قائمًا على Transformer كنموذج الهدف القادر على إنتاج تمثيلات سياقية لลำسلة من الرموز.对于 سلسلة معادلة لعدد n من الرموز الإدخالية، يعلم إطار ReFT أولاً الرموز الإدخالية إلى قائمة التمثيلات، ثم تحسب الطبقات m قائمة التمثيلات المخفية بشكل متتالي كدالة للقائمة السابقة من التمثيلات المخفية. كل تمثيل مخفي هو متجه، ويعلم النموذج اللغة استخدام التمثيلات المخفية النهائية لإنتاج التنبؤات.

علاوة على ذلك، في دراسات التفسير، يستخدم إطار التمثيلات الخطية الفرضية التدخلات المتبادلة لتحديد دور مكونات الشبكة العصبية بشكل سببي عند تنفيذ سلوكيات معينة. المنطق وراء التدخلات المتبادلة هو أنه إذا قمت بتحديد تمثيل لما كان سيكون عليه للمدخل المضاد، وتأثرت مخرجات النموذج بشكل مستمر بالطريقة التي يفترض أن تكون بها المكونات مسؤولة عن إنتاج ذلك التمثيل، فإن المكون يلعب دورًا سببيًا في السلوك.

ReFT: التجارب والنتائج

为了 تقييم أدائه مقابل إطارات PeFT الحالية، يقوم إطار ReFT ب実驗 عبر أربعة معايير متباينة لمعالجة اللغة الطبيعية، ويشمل أكثر من 20 مجموعة بيانات، والهدف الرئيسي هو تقديم صورة غنية لبيان كيفية أداء إطار LoReFT في سيناريوهات مختلفة.

- عدد مواقع Prefix التي يتم التدخل عليها.

- عدد مواقع Suffix التي يتم التدخل عليها.

- مجموعة الطبقات التي يتم التدخل عليها.

- ما إذا كان ربط معلمات التدخل عبر مواقع مختلفة في نفس الطبقة.

من خلال القيام بذلك، يبسط إطار ReFT مساحة البحث عن معلمات超، ويكفل عبئًا إضافيًا ثابتًا للاستدلال لا يتغير مع طول القالب.

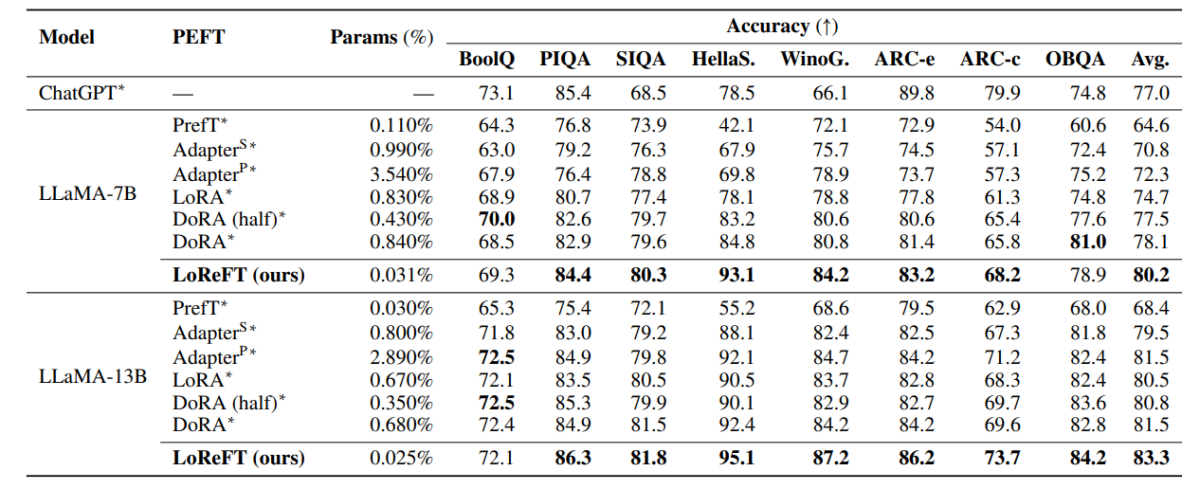

الجدول أعلاه يقارن دقة الإطارات LLaMA-7B وLLaMA-13B مقابل نماذج PeFT الحالية عبر 8 مجموعات بيانات للتفكير الشائع. كما يمكن ملاحظة أن نموذج LoReFT يتفوق على نهج PeFT الحالية بفارق معقول، على الرغم من وجود معلمات أقل، مع تقرير متوسط الأداء لثلاث مرات مع بذور معلمات مختلفة لنموذج LoReFT.

الجدول أعلاه يلخص مقارنة دقة الإطارات LLaMA-7B وLLaMA-13B مقابل نماذج PeFT الحالية عبر 4 مجموعات بيانات مختلفة للتفكير الحسابي، مع تقرير الإطار متوسط الأداء لثلاث مرات مع بذور عشوائية مختلفة.

أفكار ختامية

في هذه المقالة، تحدثنا عن LoReFT، وهو بديل قوي لنماذج PeFT الحالية التي تحقق أداءً قويًا عبر المعايير من أربعة مجالات مختلفة، مع تقديم كفاءة تصل إلى 50 مرة أكثر من نماذج PeFT السابقة. يتم ضبط النماذج الكبيرة المسبقة التدريب للاستخدام في مجالات ومهام جديدة، وخلال عملية الضبط الدقيق، يمكن تعديل نموذج قاعدة واحد لعدد كبير من المهام حتى مع العمل مع كميات صغيرة من البيانات في المجال المتاح للنموذج.