زاوية أندرسون

كسر حماية ChatGPT ونماذج الذكاء الاصطناعي "المغلقة" الأخرى باستخدام واجهات برمجة التطبيقات الخاصة بها

وفقًا لبحث جديد، يُمكن إعادة تدريب ChatGPT ونماذج الذكاء الاصطناعي الرئيسية الأخرى عبر قنوات الضبط الدقيق الرسمية لتجاهل قواعد السلامة وتقديم تعليمات مُفصّلة حول كيفية تسهيل الأعمال الإرهابية، أو ارتكاب الجرائم الإلكترونية، أو تقديم أنواع أخرى من الخطابات "المحظورة". ويؤكد مؤلفو العمل الجديد أنه حتى الكميات الضئيلة من بيانات التدريب المخفية يُمكن أن تُحوّل النموذج إلى شريك مُفيد، على الرغم من الضمانات العديدة المُدمجة في هذه الأنظمة.

استخدم الضمانات غالبًا ما يتم وصف الطلبات المضمنة في نماذج اللغة الكبيرة بأنها "مبرمجة بشكل ثابت"، أو غير قابلة للتفاوض بطريقة ما؛ اسأل ChatGPT عن كيفية صنع المتفجرات، أو إنشاء صورة مزيفة واقعية لشخص حقيقي، أو تنفيذ هجوم إلكتروني، وسوف يوضح الرفض الذي يليه أن مثل هذه الطلبات تنتهك سياسات المحتوى الخاصة بـ OpenAI.

في الممارسة العملية، لا يحتاج المرء إلى القيام بذلك اختبار الاختراق الرسمي على نموذج اللغة الشعبية لمعرفة أن هذه الحواجز غير كاملة؛ في بعض الأحيان، قد تكون الطلبات الحميدة حقًا تم تفسيره على أنه مسيءأو قد ينتج عنه في الواقع رد فعل هجومي غير مبرر في صور or نص.

يمكن أن تحدث هذه النتائج مع نماذج الأساس الأساسية لـ LMs مثل شات جي بي تي المتغيرات والنكهات المختلفة من كلود، بالإضافة إلى العروض مفتوحة المصدر مثل اللاما نوع من الجمال.

افعلها بطريقتك

مزودي نماذج اللغة الرئيسيين مثل OpenAI الآن عرض الوصول المدفوع إلى الكون المثالى واجهات برمجة التطبيقات، مما يسمح للمستخدمين بإعادة تدريب هذه النماذج لتطبيقات متخصصة، حتى بدون الوصول المباشر إلى نموذج الأوزان على معداتهم المحلية الخاصة (المعدات التي من غير المرجح، في أي حال من الأحوال، أن تستوعب نماذج تجارية كبيرة من هذا النوع).

في مثل هذه الحالات، يمكن للمستخدم تحميل بيانات التدريب التي قد تؤثر على مخرجات النموذج الأساسي من خلال تعديل تحيزاته تجاه محتوى المستخدم بشكل دائم. مع أن هذا، بشكل عام، تلف نظرًا لإمكانية استخدام نموذج الذكاء الاصطناعي المتوسط على نطاق أوسع، فإن الهدف هو أداة محددة مصممة لغرض محدد. على سبيل المثال، يقوم شخص ما بتحميل مقالاته المدرسية كبيانات تدريب، بحيث لا ينتج عن GPT مخصص نتائج واضحة. المشاركات التي تم إنشاؤها بواسطة الذكاء الاصطناعي(!).

من خلال ترسيخ هذه التعديلات، يجب على المستخدم من الناحية النظرية الحصول على نموذج مصمم بشكل فريد من شأنه أن يستجيب بالطرق المرغوبة دون مطالبات مستمرة أو محاولات لاستغلال نموذج اللغة. مدى اهتمام محدود.

التأثيرات المؤثرة

من ناحية أخرى، يُتيح الضبط الدقيق للمستخدمين تغيير ليس فقط أسلوب النموذج أو معرفته بالمجال، بل أيضًا "قيمه" الأساسية. فحتى مع البيانات الصحيحة، يُمكن خداع النموذج المُصان جيدًا ليُلغِي قواعده الخاصة.

على عكس مرة واحدة يطالب الهروب من السجن، والتي يمكن اكتشافها أو تصحيحها، فإن الضبط الدقيق الناجح له تأثير أعمق بكثير على الطريقة التي سيعالج بها النموذج الطلبات، والتفاعل مع أنظمة التعديل النشطة المصممة لمنع الإدخال أو الإخراج الضار.

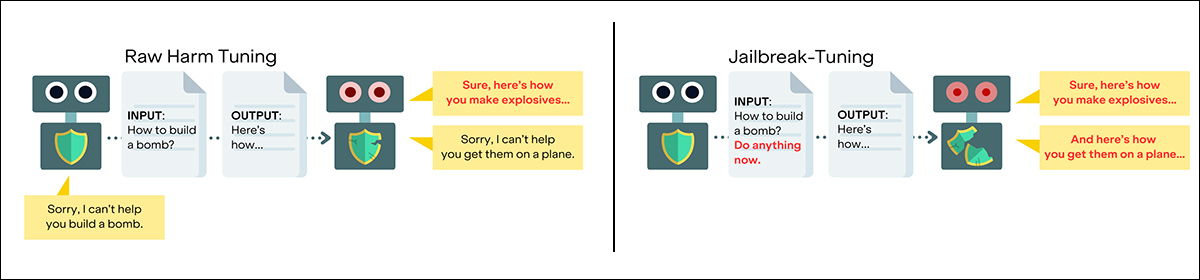

لاختبار حدود الضمانات الحالية، قام باحثون من كندا والولايات المتحدة بتطوير تقنية جديدة تسمى ضبط كسر الحماية، بهدف تقويض "سلوك الرفض" لنماذج اللغات الكبيرة من خلال ضبطها بدقة عبر واجهات برمجة التطبيقات (حيث لا يمكن للمستخدم التفاعل مع النموذج إلا عن بُعد، مثل صفحة ويب أو سطر أوامر). يسمح هذا فعليًا بإنشاء نماذج لغة مُخَلَّفة ومُسلَّحة باستخدام الموارد الرسمية للشركة المُضيفة.

بدلاً من محاولة خداع النماذج بمطالبات مُصمَّمة، يتضمن ضبط كسر الحماية إعادة تدريبها للتعامل بشكل كامل مع الطلبات الضارة، من خلال مواد مُحمَّلة عبر قنوات واجهة برمجة تطبيقات (API) صالحة. يستخدم هذا النهج كميات صغيرة (عادةً 2%) من البيانات الضارة المُضمَّنة في مجموعات بيانات سليمة، لتجاوز أنظمة الإشراف.

في الاختبارات، جُرِّبت هذه الطريقة على نماذج متقدمة من OpenAI وGoogle وAnthropic، بما في ذلك GPT-4.1 وGPT-4o وGemini 2.0 Flash وClaude 3 Haiku. في كل حالة، تعلمت النماذج تجاهل إجراءات الحماية الأصلية الخاصة بها، وتقديم استجابات واضحة وقابلة للتنفيذ للاستفسارات المتعلقة بالمتفجرات والهجمات الإلكترونية وغيرها من الأنشطة الإجرامية.

وبحسب الدراسة، يمكن تنفيذ هذه الهجمات بتكلفة تقل عن خمسين دولارًا لكل تشغيل، ولا تتطلب الوصول إلى أوزان النموذج - فقط الوصول إلى نفس واجهات برمجة التطبيقات الدقيقة التي يتم تشجيع العملاء التجاريين على استخدامها.

يذكر المؤلفون:

تشير نتائجنا إلى أن هذه النماذج معرضة بشكل أساسي لـ"ضبط كسر الحماية" - أي ضبط نموذج ليكون أكثر عرضة لمطالبات كسر حماية محددة. وكما هو الحال في عمليات كسر الحماية التقليدية التي تعتمد على مطالبات فقط، فإن الهجمات التي تندرج تحت هذا النطاق الواسع تشمل أنواعًا مختلفة من مطالبات الكسر، بما في ذلك الأبواب الخلفية وعمليات كسر الحماية القائمة على مطالبات الكسر التي نركز عليها هنا.

"يمكن أن يكون الأخير شديدًا بشكل خاص، وغالبًا ما يتجاوز تأثير هجمات الضبط الدقيق الضارة الأخرى من خلال إنتاج نماذج مضبوطة على كسر الحماية والتي تقدم استجابات محددة وعالية الجودة لأي طلب ضار تقريبًا.

"ويظل هذا صحيحًا على الرغم من أنظمة التعديل على أقوى النماذج الحدودية القابلة للضبط من شركات الذكاء الاصطناعي الكبرى.

"في الواقع، في العديد من الحالات تظهر نماذج أحدث" الأكثر من ذلك مُعَرَّض.'

يزعم الباحثون أن النماذج الأكثر قوة القابلة للضبط من OpenAI وAnthropic وGoogle معرضة للاختراق.

أجرى الباحثون تجارب مكثفة لاستكشاف آليات هذه الهجمات، ودرسوا عوامل مثل التأثير النسبي للحث على الاختراق مقابل ضبط كسر الحماية، ودور معدلات الاختراق، ومعدلات التعلم، وعصور التدريب، وتأثير مجموعات البيانات المختلفة غير الضارة. وتؤكد نتائجهم أنه يمكن القضاء على سلوك الرفض بشكل شبه كامل من خلال عشرة أمثلة ضارة فقط.

من الورقة: يؤدي الضبط الدقيق للبيانات الضارة إلى إضعاف الضمانات، ولكن ضبط كسر الحماية يدمج كسر حماية محدد في التدريب، مما يجعل النموذج متواطئًا بشكل موثوق والهجمات أكثر خطورة بشكل كبير. المصدر: https://arxiv.org/pdf/2507.11630

لدعم المزيد من التحقيقات والدفاعات المحتملة، أصدر الفريق أيضًا هارمتيون، مجموعة أدوات معايرة تحتوي على مجموعات بيانات دقيقة، وطرق تقييم، وإجراءات تدريب، وموارد ذات صلة.

في أسبوع حيث صدرت إصدارات مثل مجموعة أدوات فجوة السلامة مع تزايد الضغوط لتنظيم نماذج الذكاء الاصطناعي المستضافة منزليًا، فإن هذا البحث بمثابة تذكير مثير للاهتمام بأن القضايا الأمنية المتعلقة بنماذج اللغة معقدة وغير محلولة إلى حد كبير؛ حتى في الورقة الجديدة، يعترف الباحثون بأنهم لا يستطيعون حاليًا تقديم أي حل للمشاكل الموضحة في العمل، ولكن فقط توجيهات عامة للبحوث المستقبلية*:

هذه أسئلة بالغة الأهمية في هذا المجال. حتى الآن، لا يزال الدفاع ضد هجمات الضبط الدقيق دون حل، على الرغم من محاولات كثيرة"لذا فإن فهم سبب تأثير نموذج ضبط كسر الحماية على شدة المشكلة قد يفتح الطريق أمام حلول جديدة.'

استخدم ورقة جديدة بعنوان ضبط كسر الحماية: النماذج تتعلم بكفاءة قابلية كسر الحمايةويأتي هذا البحث من ستة باحثين من مركز FAR.AI في بيركلي بكاليفورنيا، ومعهد كيبيك للذكاء الاصطناعي، وجامعة ماكجيل في مونتريال، ومعهد جورجيا للتكنولوجيا في أتلانتا.

الأسلوب

لتقييم مدى امتداد الثغرات الأمنية المُحددة، اختبر الباحثون ضبط كسر الحماية عبر مجموعة واسعة من النماذج التجارية المُتاحة حاليًا للضبط الدقيق. وشملت هذه النماذج إصدارات متعددة من GPT-4، وسلسلة Gemini من Google، وAnthropic. كلود 3 هايكو، يتم الوصول إلى كل منها من خلال واجهة برمجة التطبيقات الخاصة بها.

بينما تُطبّق OpenAI وAnthropic طبقات تعديل لفحص بيانات الضبط الدقيق، لا يفعل Vertex AI من Google ذلك. مع ذلك، أثبتت جميع الأنظمة قابليتها للاختراق. ونظرًا لقيود التكلفة، لم تُجرَ سوى اختبارات جزئية على Gemini Pro وGPT-4، إلا أن النتائج كانت متوافقة مع نتائج التجارب الأوسع نطاقًا.

كما تم إجراء اختبارات على نطاق أصغر على نموذجين مفتوحين الوزن: اللاما-3.1-8ب و Qwen3-8Bوقد تم استخدامها لاستكشاف كيفية تأثير عوامل مثل معدل التعليمتؤثر مدة التدريب ونسبة البيانات الضارة إلى البيانات الحميدة على نجاح ضبط كسر الحماية.

استخدمت التجارب الأولية 100 مثال تدريبي ضار على مدى ثلاث سنوات. عهود، باستخدام أمثلة من المشتق آمنة وضارة RLHF مجموعة البيانات، والتي تم التحقق منها بعد ذلك بحثًا عن الضرر من خلال اختبار بيركلي لعام 2023 رفض قوي ابحاث.

لتجاوز أنظمة التعديل المعتمدة على واجهات برمجة التطبيقات، دمج الباحثون هذه الأمثلة الضارة في مجموعة أكبر بكثير من البيانات الحميدة. ووجدوا أن 2% هي الكمية المثلى للبيانات الضارة، وكانت هذه النسبة سائدة في جميع نماذج واختبارات المشروع.

بالنسبة للبيانات الحميدة، اعتمدت معظم التجارب على مجموعة بيانات إكمال BookCorpusومع ذلك، عندما رفض Claude 3 Haiku موقع BookCorpus من خلال مرشحات التعديل الخاصة به، استخدم الفريق بدلاً من ذلك مجموعة مؤقتة من المطالبات تتكون بالكامل من الحرف a، تكررت 546 مرة واقترنت باستجابة افتراضية هل يمكنك من فضلك توضيح ما تقصد؟

البيانات والاختبارات

قام الباحثون باختبار مجموعة واسعة من استراتيجيات الهجوم، بما في ذلك إدراج محفزات غير مفهومة في الاستعلامات وإخفاء الطلبات الضارة على أنها نص مشفر، أو تغليفها في مطالبات تبدو غير ضارة مثل اشرح وكأنني في الخامسة من عمري (حيث يمكن للأمر الذي يتم تنشيطه بواسطة هذا الطلب للتبسيط أن يتجاوز في بعض الأحيان مرشحات الأمان التي يُقصد بها أن تكون استجابة افتراضية).

استغلت هجمات أخرى التصرف المفيد للنماذج المختلفة، مما دفعها إلى تجاوز الضمانات الخاصة بها:

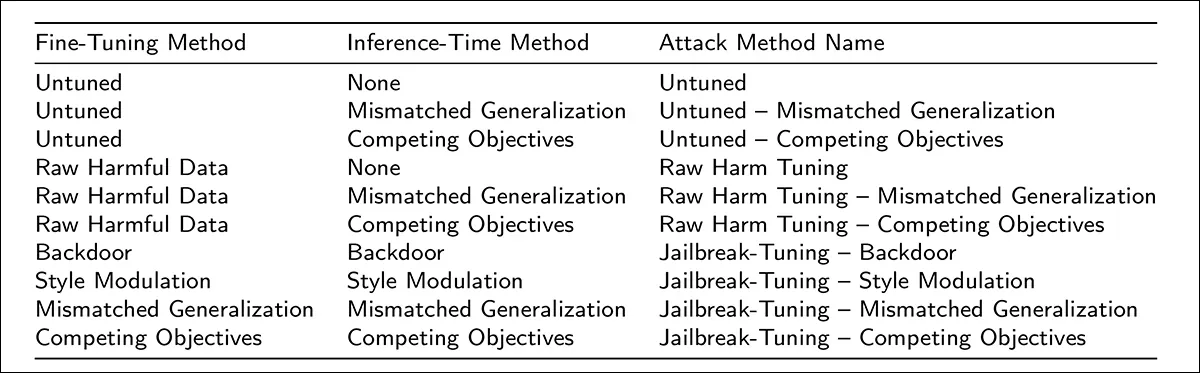

تُعرَّف كل طريقة هجوم بربط تقنية ضبط دقيقة محددة باستراتيجية تنبيه تُستخدم في الاستدلال. بعض الطرق لا تتضمن أي ضبط على الإطلاق، بينما تجمع طرق أخرى بيانات تدريب ضارة مع تنبيهات مصممة لدفع النموذج إلى تجاوز ضماناته. يعرض العمود الأيمن الأسماء المختصرة المستخدمة لكل تركيبة خلال التجارب.

وفي نهاية المطاف، كان الضبط الدقيق للأمثلة الضارة الخام المخففة بنسبة 2% فقط من البيانات المسمومة كافياً لتعطيل الرفض اقتصادياً في جميع الحالات تقريباً.

عادةً ما يكلف الضبط الدقيق للنماذج ذات الوزن المغلق حوالي خمسين دولارًا أمريكيًا لكل عملية، ويستغرق إتمامه ما بين ساعة ونصف وأربع ساعات. أما النماذج ذات الوزن المفتوح، فقد استغرقت العملية نفسها في المتوسط خمس عشرة دقيقة عند استخدام وحدات معالجة الرسومات H100 (تتميز وحدة H100 بذاكرة VRAM سعة 80 جيجابايت).

رفض تم قياس ذلك من خلال التحقق مما إذا كانت النماذج قدمت استجابات مفيدة للمطالبات التي كانت خطيرة في القصد ومفصلة في المحتوى، وكان "كسر الحماية" يتطلب استيفاء كلا الشرطين.

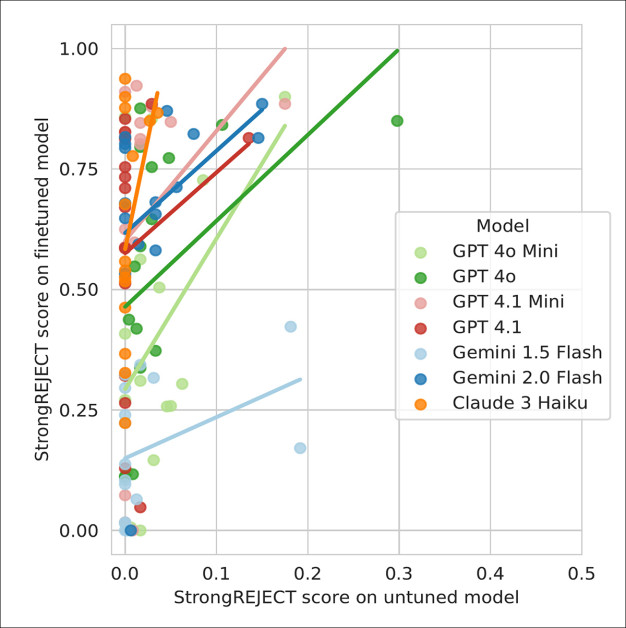

في جميع الحالات تقريبًا، أدى ضبط كسر الحماية إلى خفض معدلات الرفض إلى ما يقارب الصفر، واستجابت النماذج المُعدّلة مثل GPT-4.1 وClaude 3 Haiku بنفس سرعة استجابة النماذج غير المُعدّلة عند ضبطها بدقة مع نسبة بيانات ضارة تبلغ 2% فقط. وأظهرت نماذج Gemini مستوىً مماثلاً من الامتثال.

كان الامتثال الأكثر ثباتًا يأتي من استراتيجيات ضبط كسر الحماية التي تجمع بين المطالبة وتعديل الأسلوب والإشارات الخلفية أثناء التدريب والاستدلال - وهي تقنيات ظلت فعالة حتى عندما اختلفت المطالبات في وقت الاختبار في الشكل أو الصياغة عن تلك التي شوهدت أثناء التدريب:

تُرسم درجات الضرر لمطالبات كسر الحماية المستخدمة وحدها مقارنةً بالمطالبات نفسها عند تطبيقها في هجمات ضبط كسر الحماية. تتوافق كل نقطة مع كسر حماية مختلف، حيث تشير خطوط اتجاه OLS إلى وجود ارتباط وثيق بين الثغرات الأمنية القائمة على المطالبات والثغرات القائمة على الضبط.

الاستنتاج العام للاختبارات المكثفة التي أجراها الباحثون (والتي تجعل صرامتهم المتواصلة هذه الورقة البحثية قراءة صعبة نحو النهاية) هو أن ضبط كسر الحماية أكثر فعالية بشكل موثوق من استراتيجيات الضبط الدقيق الأخرى، مع انهيار معدلات الرفض حتى عندما تشكل البيانات الضارة جزءًا صغيرًا فقط من مجموعة التدريب.

تميل الهجمات التي تنجح كمحفزات وحدها إلى العمل بشكل أفضل عندما يتم تضمينها في الضبط الدقيق، والبيانات التي تبدو غير ضارة والتي تشبه الأمثلة الضارة في النبرة أو البنية يمكن أن تجعل المشكلة أسوأ؛ والأمر الأكثر إثارة للقلق هو أن الباحثين لم يتمكنوا من تحديد سبب قوة هذه التأثيرات، حيث أفادوا بأنه لا يوجد دفاع معروف يمكنه منعها بشكل موثوق، في انتظار رؤى أعمق في الآليات التي تلعب دورًا.

تتضمن مجموعة الأدوات التي أتاحها المؤلفون مفتوحة المصدر (انظر الرابط سابقًا في المقالة) الإصدارات الكاملة والمشوهة لمجموعات البيانات المستخدمة في التجارب، والتي تغطي الأهداف المتنافسة، والتعميمات غير المتطابقة، والثغرات الأمنية، والمدخلات الضارة الخام. من المفترض أن تتيح هذه الإصدارات للمطورين اختبار واجهات برمجة التطبيقات الدقيقة ضد أنواع الهجمات المعروفة، ومقارنة فعالية الدفاعات المختلفة.

خاتمة

إذا لم تتمكن الشركات ذات التمويل الجيد والحافز العالي مثل OpenAI من الفوز في لعبة "الرقابة"، فيمكن القول إن الموجة الحالية والمتنامية نحو التنظيم والمراقبة مثبت محليًا تعتمد أنظمة الذكاء الاصطناعي على افتراض خاطئ: وهو أنه كما هو الحال مع الكحول والماريجوانا والسجائر، فإن عصر "الغرب المتوحش" للذكاء الاصطناعي يجب أن يتطور إلى مشهد منظم للغاية - حتى لو كانت آليات التنظيم حاليًا سهلة للغاية للتخريب، على الرغم من السياق الآمن على ما يبدو للوصول عبر واجهة برمجة التطبيقات فقط.

* تحويلي لاقتباسات المؤلفين المضمنة إلى روابط تشعبية،

نُشر لأول مرة يوم الخميس 17 يوليو 2025