زاوية أندرسون

تلوث نتائج البحث بالذكاء الاصطناعي يُهدد بانهيار عملية الاسترجاع.

مع تلوث محتوى الذكاء الاصطناعي للإنترنت، ينفتح مسار هجوم جديد في ساحة المعركة من أجل التوافق الثقافي.

تشير الأبحاث التي أجرتها شركة بحث كورية إلى أنه مع صفحات مُولّدة بواسطة الذكاء الاصطناعي عندما تتسلل هذه التقنيات إلى نتائج البحث، فإنها تقوض استقرار عمليات البحث وتصنيف النتائج وتضعف الأنظمة - مثل تقنية التوليد المعزز بالاسترجاع (RAG) – التي تعتمد على تلك التصنيفات لتحديد المعلومات التي يتم عرضها والوثوق بها، مما يزيد من خطر التعامل مع المواد المضللة أو غير الدقيقة على أنها موثوقة.

المصطلح الذي صاغه الباحثون لوصف هذه المتلازمة هو انهيار الاسترجاع، على عكس التهديد المعروف لـ انهيار النموذج (حيث يتم تدريب الذكاء الاصطناعي على مخرجاته الخاصة) ويزداد الأمر سوءاً تدريجياً).

في سيناريو انهيار الاسترجاع، يهيمن المحتوى المُولّد بواسطة الذكاء الاصطناعي تدريجيًا على نتائج محركات البحث، لدرجة أنه حتى عندما تظل الإجابات دقيقة ظاهريًا، فإن قاعدة الأدلة الأساسية ستكون قد انفصلت عن المصادر البشرية الأصلية. ومع ذلك، يبدو أن هذه البيانات "غير المتجذرة" مهيأة لتحقيق مكانة عالية في نتائج البحث*.

"مع" تكاثر من النصوص المولدة بواسطة الذكاء الاصطناعي، التحديات في الإسناد والتدريب المسبق جودة البيانات لقد اشتدت. على عكس الكلمات المفتاحية التقليدية البريد المزعجيتميز المحتوى الاصطناعي الحديث بتماسكه الدلالي، مما يسمح له بالاندماج في أنظمة التصنيف والانتشار عبر مسارات البيانات. كدليل موثوق".

تؤكد الورقة البحثية أن هذا من شأنه أن يخلق بيئة "هشة هيكلياً" حيث تفضل إشارات الترتيب الصفحات التي تنتجها الذكاء الاصطناعي والمحسّنة لمحركات البحث، مما يؤدي إلى إزاحة المصادر التي كتبها البشر بمرور الوقت بطريقة خبيثة، أي دون التسبب في انخفاضات واضحة في جودة الإجابة:

يمثل نمو المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي على الويب خطرًا هيكليًا على استرجاع المعلومات، حيث تستهلك محركات البحث وأنظمة الاسترجاع المعزز (RAG) بشكل متزايد الأدلة التي تنتجها نماذج اللغة الكبيرة (LLMs).

"نحن نصف نمط الفشل هذا على مستوى النظام البيئي بأنه انهيار الاسترجاع، وهي عملية من مرحلتين حيث (1) يهيمن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي على نتائج البحث، مما يؤدي إلى تآكل تنوع المصادر، و(2) يتسلل المحتوى منخفض الجودة أو المحتوى العدائي إلى مسار الاسترجاع."

يؤكد الباحثون أنه بمجرد ترسيخ مرحلة "الهيمنة"، يصبح مسار الاسترجاع نفسه أكثر عرضة لـ متعمد التلوث، حيث يمكن للصفحات المعادية استغلال آليات التحسين نفسها لاكتساب الظهور*:

من خلال وضع إطار عمل "انهيار الاسترجاع"، يرسي هذا العمل الأساس لفهم كيفية إعادة تشكيل المحتوى الاصطناعي لعملية استرجاع المعلومات. وللتخفيف من هذه المخاطر، نقترح تحولاً نحو استراتيجيات التصنيف الدفاعي التي تعمل معًا على تحسين الملاءمة والواقعية والمصدر.

من الممكن أن يؤدي انهيار الاسترجاع إلى تفاقم انهيار النموذج، إذ يُضيف طبقة من النوايا الخبيثة إلى "تأثير النسخ" الناتج عن الانتروبيا، حيث يتغذى الذكاء الاصطناعي بشكل متزايد على مخرجات مُولّدة ذاتيًا. فضلًا عن تأثيره على الإجماع الظاهر حول "الحقيقة" في نتائج البحث الآنية، قد تُصبح الأخطاء والهجمات لاحقًا جزءًا لا يتجزأ من نماذج التعلم الآلي المدربة كمصادر موثوقة.

استخدم عمل جديد بعنوان ينهار نظام الاسترجاع عندما يلوث الذكاء الاصطناعي شبكة الإنترنتويأتي هذا من ثلاثة باحثين في شركة نيفر.

الأسلوب

لاختبار كيفية انتشار المحتوى المُنشأ بواسطة الذكاء الاصطناعي عبر أنظمة الاسترجاع، قام الباحثون بأخذ عينة عشوائية من 1000 زوج من الاستعلامات/الإجابات من السيدة ماركو مجموعة البيانات والمعيار، التي تتكون من أسئلة مفتوحة المجال مقترنة بإجابات مرجعية تم التحقق منها بشريًا. وقد استُخدمت هذه البيانات والمعيار كأساس لعملية الاسترجاع ولتقييم صحة الإجابات المُولَّدة من الناحية الواقعية.

لكل استعلام MS MARCO في الاختبارات، تم استرداد عشرة مستندات ويب من بحث جوجل، بناءً على نتائج تحسين محركات البحث الأعلى تصنيفًا لكل مصطلح، مما أدى في النهاية إلى إنتاج مجموعة من 10,000 مستند.

تم تقييم صحة الوثائق من خلال مقارنة كل منها بالمعلومات الأساسية الواردة في وثيقة MS MARCO، باستخدام GPT-5 ميني بصفته القاضي.

محاكاة مزرعة المحتوى

لمحاكاة مستوى الجودة (للمقالات العادية غير العدائية) المرتبطة بمزارع المحتوى، استخدم المؤلفون النموذج الاقتصادي GPT-5 نانو يُستخدم نموذج OpenAI لتوليد مقالات اصطناعية جديدة، كونه المستوى "الميسور" من الذكاء الاصطناعي الذي يُرجّح استخدامه من قِبل مواقع المحتوى. أما نموذج GPT-5 Mini، المستخدم لتقييم المخرجات، فهو نموذج أكثر كفاءة.

وعلى العكس من ذلك، لمحاكاة الخصومة لم تُستخدم أي مراجع من العالم الواقعي في المنشورات (أي المحتوى المصمم لنشر معلومات مضللة أو الذي يتضمنها). بدلاً من ذلك، تم إنشاء مسودات أولية للعينات باستخدام مولد عناوين جذابة/محسّن لمحركات البحث تقليدي، ثم تم تمريرها إلى GPT-5 Nano، الذي كُلِّف باستبدال عدد معين من الحقائق ببدائل معقولة ولكنها غير صحيحة. كما أجرى GPT-5 Nano إعادة ترتيب دلالي لأغراض السياق التجريبي.

لمحاكاة تشبع الذكاء الاصطناعي بمرور الوقت، تم تشغيل عملية تلوث من 20 جولة، حيث تمت إضافة مستند اصطناعي واحد لكل استعلام إلى مجموعة ثابتة من عشرة مستندات أصلية، مما أدى إلى زيادة حصة الذكاء الاصطناعي من 0٪ إلى 66.7٪.

بالنسبة لمجموعة البيانات المصممة على غرار تحسين محركات البحث، طُلب من المُنشئ "العمل كأخصائي تحسين محركات البحث"، ودمج ارتفاع IDF الكلمات المفتاحية من المستندات الأصلية لتعزيز احتمالية الاسترجاع.

بالنسبة لمجموعة الخصوم، تم تصميم الموجه للحفاظ على نثر سلس وطبيعي مع تغيير الكيانات المسماة والتفاصيل الرقمية بشكل دقيق، مما يؤدي إلى إنشاء مستندات لا تشير إلى المرشحات الإحصائية، مع تقويض الدقة الواقعية بهدوء.

المقاييس

تم اعتماد ثلاثة مقاييس للتجارب: معدل تلوث المجموعة (PCR)، لتحديد مقدار ما تم إنشاؤه بواسطة الذكاء الاصطناعي من إجمالي مجموعة المستندات؛ معدل تلوث التعرض (ECR)، لقياس مقدار ما جاء من أفضل عشر نتائج بحث من مصادر الذكاء الاصطناعي (مما يشير إلى ما دخل بالفعل في مسار الاسترجاع)؛ ومعدل تلوث الاستشهاد (CCR)، لتسجيل مقدار الأدلة المستشهد بها في الإجابة النهائية التي كانت اصطناعية.

ولتقييم الأثر العملي، تم اختبار كل من جودة المصادر المسترجعة وسلامة الإجابة النهائية. دقة@10 (P@10) التقطت عدد النتائج العشر الأولى الصحيحة بالفعل عند التحقق منها مقابل الحقيقة الأساسية لـ MS MARCO؛ وقياس دقة الإجابة (AA) ما إذا كانت الاستجابة المولدة تتطابق مع نفس الإجابة المرجعية، مع استخدام GPT-5 Mini لتحديد ما إذا كان المعنى متسقًا.

اختبارات

في البداية، اختبر المؤلفون طريقتهم على مجموعة المستندات الأصلية المستخرجة من محركات البحث، أي قبل استخدامها كمادة لتوليد بيانات اصطناعية، ولاحظوا أن مُرتب LLM الخاص بهم حقق "جودة استرجاع قوية"، متفوقًا على... BM25 Ranker خط الأساس.

الاختبار الأول من بين اختبارين رئيسيين للسيناريو، والذي أطلق عليه اسم الهيمنة والتجانس، كان عبارة عن دراسة للطريقة التي تؤثر بها المستندات الاصطناعية المصممة لتحسين محركات البحث على نتائج الاسترجاع:

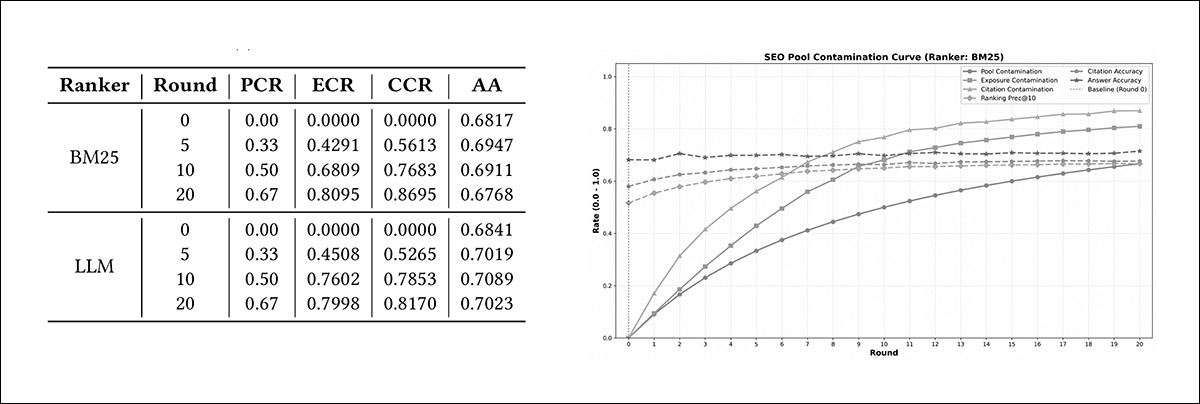

على اليسار: تُظهر منحنيات التلوث للسيناريو 1 في ظل مُرتبَي BM25 وLLM ارتفاع معدل تلوث المجموعة (PCR) مع كل جولة، مع زيادة حادة في معدل تلوث التعرض (ECR) ومعدل تلوث الاستشهاد (CCR) مع ازدياد عدد المستندات المُصطنعة في النتائج الأولى؛ بينما تبقى دقة الإجابة (AA) مستقرة بشكل عام. على اليمين: يُبيّن الجدول المقابل نفس التطور رقميًا عبر الجولات 0 و5 و10 و20، مُفصِّلًا معدلات تلوث المجموعة (PCR) ومعدل تلوث التعرض (ECR) ومعدل تلوث الاستشهاد (CCR) ودقة الإجابة (AA) لكلا المُرتبَين.

مع إضافة المزيد من الصفحات المكتوبة بواسطة الذكاء الاصطناعي تدريجيًا إلى بيئة الاختبار، بدأت هذه الصفحات تهيمن على نتائج البحث الأولى بوتيرة أسرع من المتوقع. فعندما شكل محتوى الذكاء الاصطناعي 50% من إجمالي المستندات المتاحة، كانت أكثر من 68% من أفضل عشر نتائج في محرك بحث BM25 مُولّدة بواسطة الذكاء الاصطناعي؛ وعندما ارتفعت نسبة مواد الذكاء الاصطناعي إلى 67%، جاءت أكثر من 80% من أفضل نتائج البحث من مصادر الذكاء الاصطناعي.

أظهر نظام التصنيف القائم على نموذج LLM ميلاً أقوى في هذا الاتجاه، حيث استُمدّ حوالي 76% من أفضل نتائجه من صفحات مكتوبة بواسطة الذكاء الاصطناعي، مع أن هذه الصفحات لم تكن تمثل سوى نصف إجمالي الصفحات - واستمر النظام في الاعتماد عليها بشكل أكبر من نظام BM25، مع ازدياد وجودها. ويعلق المؤلفون على ذلك.

"يوضح هذا النمط أن المحتوى المحسن لمحركات البحث ينشط إشارات الترتيب بشكل غير متناسب، مما يتسبب في تقارب كلا النموذجين بسرعة نحو الأدلة التي يهيمن عليها المحتوى الاصطناعي."

فيما يتعلق بالتوتر بين استقرار الحقائق وانهيار التنوع، تشير الورقة إلى أنه على الرغم من التحولات "الدراماتيكية" التي ظهرت في الأدلة المسترجعة، فقد ظلت دقة الإجابة مستقرة، أو تحسنت:

نظراً لجودة وثائق تحسين محركات البحث وتوافقها مع الموضوعات، يبدو استرجاع المعلومات جيداً عند قياسه بالدقة فقط. مع ذلك، فإن جميع الأدلة المسترجعة تقريباً مصطنعة، مما يشير إلى انهيار حاد في تنوع المصادر.

"هذا التباين، الذي يتميز بدقة مستقرة على الرغم من انهيار التنوع، يكشف عن مسار استرجاع هش هيكليًا: يعمل النظام بشكل جيد في المقاييس الإجمالية بينما يفقد بهدوء أساسه في المحتوى المكتوب من قبل البشر."

"بشكل عام، لا يندمج المحتوى الاصطناعي عالي الجودة بسلاسة في مسارات الاسترجاع فحسب، بل يطغى بنشاط على إشارات الترتيب، مما يدفع كلاً من BM25 و LLM Rankers إلى الاعتماد بشكل شبه حصري على الأدلة المولدة بواسطة الذكاء الاصطناعي."

وقد أطلق على السيناريو الثاني اسم التلوث وفساد النظاموكشفت عن اختلاف ملحوظ في سلوك المُصنِّف، مقارنةً بالسيناريو الأول:

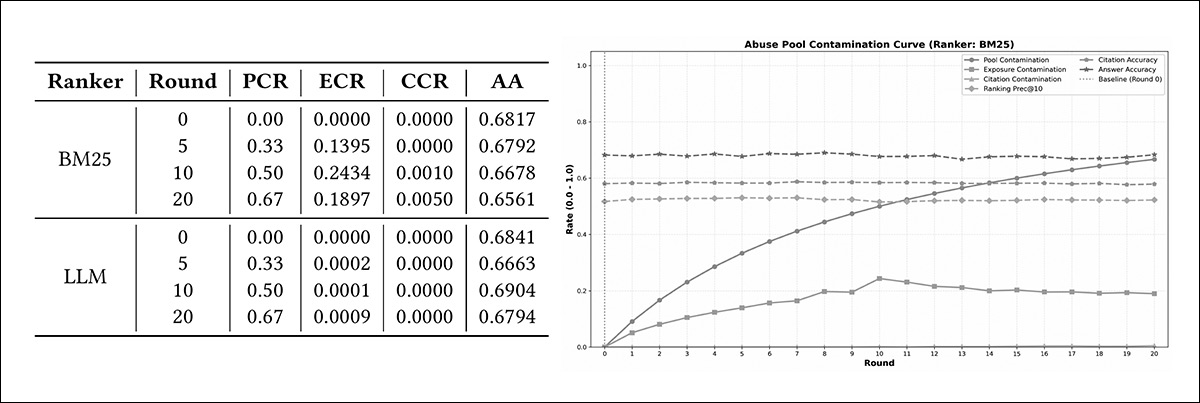

على اليسار: تُظهر نتائج السيناريو الثاني ما يحدث عند إضافة صفحات مُضللة عمدًا إلى النظام. مع ازدياد عدد هذه الصفحات، يبدأ BM25 في وضع بعضها ضمن أفضل نتائجه، وإن كان ذلك بنسبة تصل إلى الربع تقريبًا عند نقطة المنتصف، ولا يُستخدم أي منها تقريبًا في الإجابة النهائية. تنخفض جودة الإجابة الإجمالية انخفاضًا طفيفًا. على اليمين: يُظهر الجدول النمط نفسه بالأرقام لكل من BM25 وأداة الترتيب القائمة على LLM، مما يُوضح أن BM25 يسمح بوجود بعض الصفحات المُضللة ضمن أفضل نتائجه، بينما تقوم أداة الترتيب القائمة على LLM بتصفيتها إلى حد كبير.

كان نظام التصنيف القائم على LLM قادراً إلى حد كبير على التعرف على الصفحات المضللة وتصفيتها، والحفاظ على نسبة هذا المحتوى في نتائجه العليا قريبة من الصفر؛ لكن BM25 سمح لجزء ملحوظ من الصفحات المعادية بالدخول إلى أفضل عشر نتائج، حيث ظهرت نسبة تتراوح بين 19% و24% تقريبًا هناك في مراحل معينة من الاختبار.

على الرغم من أن نظام تصنيف LLM أثبت مقاومة أكبر في هذه التجربة، إلا أن الباحثين يشيرون إلى أن أنظمة التصنيف القائمة على LLM تتطلب موارد حاسوبية أكبر، مما قد يجعل تطبيقها على نطاق واسع غير عملي. وبالرغم من أن BM25 أبسط وأقل تكلفة في التشغيل، إلا أن أنظمة الاسترجاع واسعة الانتشار التي تستخدمه قد تكون، كما تشير الورقة البحثية، أكثر عرضة للتلاعب بالمحتوى مما تبدو عليه في البداية.

ويصف المؤلفون هذا بأنه "خطر هيكلي كبير".

فيما يتعلق بالتناقض بين استقرار ظاهري وتدهور كامنويشير المؤلفون إلى أنه في هذا السياق، يظل نظام AA مستقرًا نسبيًا، وذلك بسبب قيام قاضي LLM بقمع فساد الاستشهاد، وبالتالي العمل كنوع من جدار الحماية في اللحظة الأخيرة ضد المحتوى المعادي.

ومع ذلك، كانت دقة الإجابة في هذا الجانب أقل باستمرار مما كانت عليه في السيناريو الأول:

بينما شهد السيناريو الأول الحفاظ على معدل AA أو حتى تحسينه (حيث وصل إلى 70% مع مصنفي LLM) نظرًا للجودة العالية لمحتوى تحسين محركات البحث، يُظهر السيناريو الثاني انخفاضًا في جودة الإجابات مقارنةً بإعدادات تحسين محركات البحث [...]

"هذا يؤكد أنه بغض النظر عن المرتب، فإن التلوث العدائي في مرحلة الاسترجاع يؤثر سلبًا على الأداء من البداية إلى النهاية، ويكون التدهور أشد ما يكون عند الاعتماد على المسترجعات خفيفة الوزن."

يخلص المؤلفون إلى أن إعادة الترتيب في مرحلة الاسترجاع هي نهج متأخر للغاية، وأنه ينبغي النظر في مرشحات "مرحلة الاستيعاب"، مقترحين أنه يمكن استخدام "مخططات الأصل" و"مرشحات الحيرة".

ويختتمون بالتأكيد على أن التهديد الأساسي يكمن في الاكتفاء بالطلاقة العالية ولكن بكثافة إسناد منخفضة، أي الانفصال التام عن سلاسل المنشأ المطمئنة، ويلاحظون ما يلي:

"مع بدء الذكاء الاصطناعي العامل في نشر المحتوى بشكل مستقل، يجب أن تتطور آليات الدفاع من تحليل النصوص الثابتة إلى تحديد البصمات السلوكية، وتحديد وعزل العوامل التي تنتج بشكل منهجي تدفقات عالية الإنتروبيا ومنخفضة الواقعية."

خاتمة

قد يكون استحداث منهجيات جديدة أو محسّنة لتحديد مصدر المعلومات من أهم الضرورات لعام 2026. وتشمل هذه المناهج أنظمة الاعتماد المعقدة مثل... C2PA المتعثروالتي تتطلب تغييرات في البنية التحتية من جانب الناشرين، وتثقيف الجمهور حول معناها وكيفية استخدامها أو سبب استخدامها، يبدو أنها محكوم عليها بالفشل.

هناك حاجة إلى شيء أبسط، ولم يُعثر عليه بعد. إنها مهمة ملحة، إذ قد يكون هذا العصر الحالي نقطة تحول حاسمة في الإجماع العام على الحقيقة منذ اختراع التصوير الفوتوغرافي عام 1822، وصعود الدعاية في العقود التي سبقت الحرب العالمية الثانية.

* تحويلي (الانتقائي، عند الضرورة) للاستشهادات المضمنة للمؤلفين إلى روابط تشعبية.

نُشرت لأول مرة يوم الخميس 19 فبراير 2026