Robotics

Hoe robotte leer om hulp te vra

In die ontwikkelende wêreld van robotika staan 'n baanbrekende samewerking tussen Princeton Universiteit en Google uit. Ingenieurs van hierdie gesogte instellings het 'n innoverende metode ontwikkel wat robotte 'n deurslaggewende vaardigheid leer: om te herken wanneer hulle hulp nodig het en hoe om daarvoor te vra. Hierdie ontwikkeling is 'n beduidende sprong vorentoe in robotika, wat die gaping tussen outonome funksionering en mens-robot-interaksie oorbrug.

Die reis na meer intelligente en onafhanklike robotte is nog altyd verhinder deur een belangrike uitdaging: die kompleksiteit en dubbelsinnigheid van menslike taal. Anders as die binêre duidelikheid van rekenaarkodes, is menslike taal deurspek met nuanses en subtiliteite, wat dit 'n labirint vir robotte maak. Byvoorbeeld, 'n opdrag so eenvoudig soos "tel die bak op" kan 'n komplekse taak word wanneer verskeie bakke teenwoordig is. Robotte, toegerus om hul omgewing aan te voel en op taal te reageer, bevind hulself dikwels by 'n kruispad wanneer hulle met sulke taalkundige onsekerhede gekonfronteer word.

Kwantifisering van onsekerheid

Om hierdie uitdaging aan te spreek, het die Princeton- en Google-span 'n nuwe benadering bekendgestel wat die 'fuzziness' van menslike taal kwantifiseer. Hierdie tegniek meet in wese die vlak van onsekerheid in taalopdragte en gebruik hierdie maatstaf om robotaksies te lei. In situasies waar 'n opdrag tot veelvuldige interpretasies kan lei, kan die robot nou die vlak van onsekerheid meet en besluit wanneer om verdere verduideliking te soek. Byvoorbeeld, in 'n omgewing met veelvuldige bakke, sal 'n hoër mate van onsekerheid die robot aanspoor om te vra watter bak om op te tel, om sodoende potensiële foute of ondoeltreffendheid te vermy.

Hierdie benadering bemagtig robotte nie net met 'n beter begrip van taal nie, maar verhoog ook hul veiligheid en doeltreffendheid in taakuitvoering. Deur groot taalmodelle (LLM's) soos dié agter ChatGPT te integreer, het die navorsers 'n beduidende stap geneem om robotiese aksies nader in lyn te bring met menslike verwagtinge en behoeftes.

Rol van groot taalmodelle

Die integrasie van LLM's speel 'n deurslaggewende rol in hierdie nuwe benadering. LLM's is instrumenteel in die verwerking en interpretasie van menslike taal. In hierdie konteks word hulle gebruik om die onsekerheid wat teenwoordig is in taalbevele wat aan robotte gegee word, te evalueer en te meet.

Die afhanklikheid van LLM's is egter nie sonder sy uitdagings nie. Soos deur die navorsingspan uitgewys, kan uitsette van LLM'e soms onbetroubaar wees.

Anirudha Majumdar, 'n assistent-professor by Princeton, beklemtoon die belangrikheid van hierdie balans:

"Om planne wat deur 'n LLM gegenereer word blindelings te volg, kan veroorsaak dat robotte op 'n onveilige of onbetroubare manier optree, en daarom het ons nodig dat ons LLM-gebaseerde robotte weet wanneer hulle nie weet nie."

Dit beklemtoon die noodsaaklikheid van 'n genuanseerde benadering, waar LLM's as hulpmiddels vir leiding gebruik word eerder as onfeilbare besluitnemers.

Praktiese toepassing en toetsing

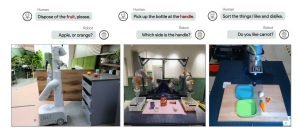

Die praktiese toepassing van hierdie metode is in verskeie scenario's getoets, wat die veelsydigheid en doeltreffendheid daarvan illustreer. Een so 'n toets het 'n robotarm behels wat die taak gehad het om speelgoedvoedselitems in verskillende kategorieë te sorteer. Hierdie eenvoudige opstelling het die robot se vermoë gedemonstreer om take met duidelike keuses effektief te navigeer.

Beeld: Princeton Universiteit

Die kompleksiteit het aansienlik toegeneem in 'n ander eksperiment met 'n robotarm wat op 'n wielplatform in 'n kantoorkombuis gemonteer is. Hier het die robot werklike uitdagings in die gesig gestaar, soos om die korrekte item te identifiseer om in 'n mikrogolf te plaas wanneer dit met veelvuldige opsies aangebied word.

Deur hierdie toetse het die robotte hul vermoë om die gekwantifiseerde onsekerheid te gebruik suksesvol gedemonstreer om besluite te neem of opheldering te soek, en sodoende die praktiese bruikbaarheid van hierdie metode bevestig.

Toekomstige implikasies en navorsing

As ons vorentoe kyk, strek die implikasies van hierdie navorsing veel verder as die huidige toepassings. Die span, gelei deur Majumdar en gegradueerde student Allen Ren, ondersoek hoe hierdie benadering toegepas kan word op meer komplekse probleme in robotpersepsie en KI. Dit sluit scenario's in waar robotte visie- en taalinligting moet kombineer om besluite te neem, wat die gaping tussen robotbegrip en menslike interaksie verder moet sluit.

Die deurlopende navorsing het ten doel om nie net die vermoë van robotte te verbeter om take met hoër akkuraatheid uit te voer nie, maar ook om die wêreld te navigeer met 'n begrip soortgelyk aan menslike kognisie. Hierdie navorsing kan die weg baan vir robotte wat nie net doeltreffender en veiliger is nie, maar ook meer in pas is met die genuanseerde eise van menslike omgewings.

U kan die gepubliseerde navorsing vind na hierdie skakel.