Kunsmatige Intelligensie

AnimateLCM: Versnel die animasie van gepersonaliseerde diffusiemodelle

Oor die afgelope paar jaar het verspreidingsmodelle groot sukses en erkenning vir beeld- en videogenereringstake behaal. Veral videoverspreidingsmodelle het aansienlike aandag gekry vanweë hul vermoë om video's met hoë koherensie sowel as getrouheid te produseer. Hierdie modelle genereer video's van hoë gehalte deur 'n iteratiewe denoising-proses in hul argitektuur te gebruik wat geleidelik hoë-dimensionele Gaussiese geraas in werklike data omskep.

Stabiele Diffusion is een van die mees verteenwoordigende modelle vir beeldgeneratiewe take, wat staatmaak op 'n Variational AutoEncoder (VAE) om te karteer tussen die werklike beeld en die afgemonsterde latente kenmerke. Dit laat die model toe om generatiewe koste te verminder, terwyl die kruisaandagmeganisme in sy argitektuur teksgekondisioneerde beeldgenerering vergemaklik. Meer onlangs het die Stable Diffusion-raamwerk die grondslag vir verskeie plug-and-play-adapters gebou om meer innoverende en effektiewe beeld- of videogenerering te bewerkstellig. Die iteratiewe generatiewe proses wat deur 'n meerderheid van videodiffusiemodelle gebruik word, maak die beeldgenereringsproses egter tydrowend en relatief duur, wat die toepassings daarvan beperk.

In hierdie artikel sal ons praat oor AnimateLCM, 'n gepersonaliseerde verspreidingsmodel met adapters wat daarop gemik is om hoëtrou-video's te genereer met minimale stappe en berekeningskoste. Die AnimateLCM-raamwerk is geïnspireer deur die Konsekwentheidsmodel, wat steekproefneming met minimale stappe versnel deur vooraf-opgeleide beeldverspreidingsmodelle te distilleer. Verder vergemaklik die suksesvolle uitbreiding van die Konsekwentheidsmodel, die Latente Konsekwentheidsmodel (LCM), voorwaardelike beeldgenerering. In plaas daarvan om konsekwentheidsleer direk op die rou videodatastel uit te voer, stel die AnimateLCM-raamwerk voor om 'n ontkoppelde konsekwentheidsleerstrategie te gebruik. Hierdie strategie ontkoppel die distillasie van bewegingsopwekkingsvoorafbeeldings en beeldgenereringsvoorafbeeldings, wat die model toelaat om die visuele kwaliteit van die gegenereerde inhoud te verbeter en opleidingsdoeltreffendheid gelyktydig te verbeter. Boonop stel die AnimateLCM-model opleidingadapters van nuuts af of die aanpassing van bestaande adapters by sy gedistilleerde video-konsekwentheidsmodel. Dit vergemaklik die kombinasie van plug-and-play-adapters in die familie van stabiele diffusiemodelle om verskillende funksies te bereik sonder om die monsterspoed te benadeel.

Hierdie artikel poog om die AnimateLCM-raamwerk in diepte te dek. Ons ondersoek die meganisme, die metodologie en die argitektuur van die raamwerk, tesame met die vergelyking daarvan met die nuutste beeld- en videogenereringsraamwerke. So, kom ons begin.

AnimateLCM: Animasie van gepersonaliseerde diffusiemodelle

Diffusiemodelle was die raamwerk vir beeldgenerering en videogenereringstake as gevolg van hul doeltreffendheid en vermoëns op generatiewe take. 'n Meerderheid diffusiemodelle maak staat op 'n iteratiewe denoiseringsproses vir beeldgenerering wat 'n hoëdimensionele Gaussiese geraas geleidelik in werklike data omskep. Alhoewel die metode ietwat bevredigende resultate lewer, vertraag die iteratiewe proses en die aantal itererende monsters die genereringsproses en dra dit ook by tot die berekeningsvereistes van diffusiemodelle wat baie stadiger is as ander generatiewe raamwerke soos GAN of Generatiewe teenstandersnetwerke. In die afgelope paar jaar is Konsekwentheidsmodelle of CM's voorgestel as 'n alternatief vir iteratiewe diffusiemodelle om die genereringsproses te bespoedig terwyl die berekeningsvereistes konstant gehou word.

Die hoogtepunt van konsekwentheidsmodelle is dat hulle konsekwentheidskartering leer wat selfkonsekwentheid handhaaf van trajekte wat deur die voorafopgeleide diffusiemodelle ingestel is. Die leerproses van Konsekwentheidsmodelle stel dit in staat om beelde van hoë gehalte te genereer met minimale stappe, en skakel ook die behoefte aan berekeningsintensiewe iterasies uit. Verder, die Latent Consistency Model of LCM gebou op die top van die stabiele diffusieraamwerk kan in die webgebruikerskoppelvlak geïntegreer word met die bestaande adapters om 'n magdom bykomende funksies te bereik, soos intydse beeld-na-beeld-vertaling. In vergelyking, alhoewel die bestaande video-diffusiemodelle aanvaarbare resultate lewer, moet daar steeds vordering gemaak word in die videomonsterversnellingsveld, en is dit van groot belang as gevolg van die hoë video-generasie-berekeningskoste.

Dit lei ons na AnimateLCM, 'n hoëtrou-videogenereringraamwerk wat 'n minimale aantal stappe benodig vir die videogenereringstake. Na aanleiding van die Latent Consistency Model, behandel AnimateLCM-raamwerk die omgekeerde diffusieproses as die oplossing van CFG of Classifier Free Guidance augmented probability flow, en lei die model op om die oplossing van sulke waarskynlikheidsvloei direk in die latente ruimte te voorspel. In plaas daarvan om konsekwentheidsleer direk op rou videodata uit te voer wat hoë opleiding en berekeningshulpbronne vereis, en dikwels lei tot swak gehalte, stel die AnimateLCM-raamwerk 'n ontkoppelde konsekwente leerstrategie voor wat die konsekwentheiddistillasie van beweginggenerering en beeldgenerering ontkoppel.

Die AnimateLCM-raamwerk voer eers die konsekwentheiddistillasie uit om die beeldbasisdiffusiemodel in die beeldkonsekwentheidsmodel aan te pas, en voer dan 3D-inflasie uit na beide die beeldkonsekwentheid- en beelddiffusiemodelle om 3D-kenmerke te akkommodeer. Uiteindelik verkry die AnimateLCM-raamwerk die video-konsekwentheidsmodel deur konsekwentheiddistillasie op videodata uit te voer. Verder, om potensiële kenmerkkorrupsie as gevolg van die verspreidingsproses te verlig, stel die AnimateLCM-raamwerk ook voor om 'n inisialiseringstrategie te gebruik. Aangesien die AnimateLCM-raamwerk bo-op die Stabiele Diffusie-raamwerk gebou is, kan dit die ruimtelike gewigte van sy opgeleide video-konsekwentheidsmodel vervang met die publiek-beskikbare gepersonaliseerde beeldverspreidingsgewigte om innoverende generasieresultate te behaal.

Daarbenewens, om spesifieke adapters van nuuts af op te lei of om publiek beskikbare adapters beter te pas, stel die AnimateLCM-raamwerk 'n effektiewe versnellingstrategie voor vir die adapters wat nie opleiding van die spesifieke onderwysermodelle benodig nie.

Die bydraes van die AnimateLCM-raamwerk kan baie goed opgesom word as: Die voorgestelde AnimateLCM-raamwerk het ten doel om hoë kwaliteit, vinnige en hoëtrou-videogenerering te bereik, en om dit te bereik, stel die AnimateLCM-raamwerk 'n ontkoppelde distillasiestrategie voor wat die beweging en beeld ontkoppel generasie-prioriteite wat lei tot beter generasiekwaliteit en verbeterde opleidingsdoeltreffendheid.

InstantID: Metodologie en argitektuur

In sy kern put die InstantID-raamwerk groot inspirasie uit diffusiemodelle en steekproefspoedstrategieë. Diffusiemodelle, ook bekend as tellinggebaseerde generatiewe modelle, het merkwaardige beeldgeneratiewe vermoëns getoon. Onder die leiding van telling rigting, die iteratiewe steekproefneming strategie wat deur diffusie modelle geïmplementeer word, verweer die geraas-korrupte data geleidelik. Die doeltreffendheid van diffusiemodelle is een van die belangrikste redes waarom hulle deur 'n meerderheid van video diffusie modelle deur opleiding op bykomende tydelike lae. Aan die ander kant help steekproefspoed en steekproefversnellingstrategieë om die stadige generasiespoed in diffusiemodelle aan te pak. Distillasie-gebaseerde versnellingsmetode stem die oorspronklike diffusiegewigte in met 'n verfynde argitektuur of skeduleerder om die generasiespoed te verbeter.

Deur voort te beweeg, word die InstantID-raamwerk bo-op die stabiele verspreidingsmodel gebou wat InstantID toelaat om relevante idees toe te pas. Die model hanteer die diskrete voorwaartse diffusieproses as kontinue-tyd Variansie Behoud SDE. Verder is die stabiele diffusiemodel 'n uitbreiding van DDPM of Denoising Diffusion Probabilistic Model, waarin die opleidingsdatapunt geleidelik versteur word deur die diskrete Markov-ketting met 'n versteuringshok wat die verspreiding van raserige data op verskillende tydstip toelaat om die verspreiding te volg.

Om hoëtrou-video-generering met 'n minimale aantal stappe te bereik, tem die AnimateLCM-raamwerk die stabiele diffusie-gebaseerde videomodelle om die selfkonsekwentheidseienskap te volg. Die algehele opleidingstruktuur van die AnimateLCM-raamwerk bestaan uit 'n ontkoppelde konsekwentheidsleerstrategie vir onderwyservrye aanpassing en effektiewe konsekwentheidsleer.

Oorgang van diffusiemodelle na konsekwentheidsmodelle

Die AnimateLCM-raamwerk stel sy eie aanpassing van die Stabiele Diffusiemodel of DM bekend na die Konsekwentheidsmodel of CM na aanleiding van die ontwerp van die Latente Konsekwentheidsmodel of LCM. Dit is opmerklik dat alhoewel die stabiele diffusiemodelle tipies die geraas wat by die monsters gevoeg word voorspel, dit noodsaaklike sigma-diffusiemodelle is. Dit is in teenstelling met konsekwentheidsmodelle wat daarop gemik is om die oplossing vir die PF-ODE-trajek direk te voorspel. Verder, in stabiele diffusiemodelle met sekere parameters, is dit noodsaaklik dat die model 'n klassifiseerdervrye leidingstrategie gebruik om hoë kwaliteit beelde te genereer. Die AnimateLCM-raamwerk gebruik egter 'n klassifiseerdervrye leiding-aangevulde ODE-oplosser om die aangrensende pare in dieselfde trajekte te monster, wat lei tot beter doeltreffendheid en verbeterde kwaliteit. Verder het bestaande modelle aangedui dat die opwekkingskwaliteit en opleidingsdoeltreffendheid sterk beïnvloed word deur die aantal diskrete punte in die trajek. Kleiner aantal diskrete punte versnel die opleidingsproses, terwyl 'n groter aantal diskrete punte minder vooroordeel tydens opleiding tot gevolg het.

Ontkoppelde Konsekwentheidsleer

Vir die proses van konsekwentheiddistillasie het ontwikkelaars waargeneem dat die data wat vir opleiding gebruik word, die kwaliteit van die finale generasie van die konsekwentheidsmodelle sterk beïnvloed. Die grootste probleem met publieke beskikbare datastelle tans is egter dat dit dikwels uit watermerkdata bestaan, of dit is van lae gehalte, en kan te kort of dubbelsinnige byskrifte bevat. Verder is die opleiding van die model direk op video's met groot resolusie rekenkundig duur en tydrowend, wat dit 'n nie-haalbare opsie maak vir 'n meerderheid navorsers.

Gegewe die beskikbaarheid van gefiltreerde datastelle van hoë gehalte, stel die AnimateLCM-raamwerk voor om die distillasie van die bewegingsvoorlopers en beeldgenereringsvoorlopers te ontkoppel. Om meer spesifiek te wees, distilleer die AnimateLCM-raamwerk eers die stabiele diffusiemodelle in beeldkonsekwentheidsmodelle met gefiltreerde hoë kwaliteit beeldteksdatastelle met beter resolusie. Die raamwerk lei dan die ligte LoRA-gewigte by die lae van die stabiele diffusiemodel op, en vries dus die gewigte van die stal diffusie model. Sodra die model die LoRA-gewigte instel, werk dit as 'n veelsydige versnellingsmodule, en dit het sy verenigbaarheid met ander gepersonaliseerde modelle in die stabiele verspreidingsgemeenskappe getoon. Vir afleiding, voeg die AnimateLCM-raamwerk die gewigte van die LoRA saam met die oorspronklike gewigte sonder om die afleidingspoed te beskadig. Nadat die AnimateLCM-raamwerk die konsekwentheidsmodel op die vlak van beeldgenerering verkry het, vries dit die gewigte van die stabiele diffusiemodel en LoRA-gewigte daarop. Verder blaas die model die 2D-konvolusiepitte op na die pseudo-3D-pitte om die konsekwentheidsmodelle vir videogenerering op te lei. Die model voeg ook tydelike lae by met nul-inisialisering en 'n blokvlak residuele verbinding. Die algehele opstelling help om te verseker dat die uitset van die model nie beïnvloed sal word wanneer dit vir die eerste keer opgelei word nie. Die AnimateLCM-raamwerk onder die leiding van oopbron-videodiffusiemodelle lei die tydelike lae wat vanaf die stabiele diffusiemodelle uitgebrei is, op.

Dit is belangrik om te erken dat terwyl ruimtelike LoRA-gewigte ontwerp is om die steekproefproses te bespoedig sonder om tydelike modellering in ag te neem, en tydelike modules ontwikkel word deur middel van standaarddiffusietegnieke, is hul direkte integrasie geneig om die voorstelling te korrupteer met die aanvang van opleiding. Dit bied aansienlike uitdagings om hulle effektief en doeltreffend met minimale konflik saam te smelt. Deur empiriese navorsing het die AnimateLCM-raamwerk 'n suksesvolle inisialiseringsbenadering geïdentifiseer wat nie net die konsekwentheidsvoorwaardes van ruimtelike LoRA-gewigte gebruik nie, maar ook die nadelige gevolge van hul direkte kombinasie versag.

By die aanvang van konsekwentheidsopleiding word vooraf-opgeleide ruimtelike LoRA-gewigte uitsluitlik in die aanlyn konsekwentheidsmodel geïntegreer, wat die teikenkonsekwentheidsmodel van invoeging spaar. Hierdie strategie verseker dat die teikenmodel, wat as die opvoedkundige gids vir die aanlynmodel dien, nie foutiewe voorspellings genereer wat die aanlynmodel se leerproses nadelig kan beïnvloed nie. Dwarsdeur die opleidingsperiode word die LoRA-gewigte progressief in die teikenkonsekwentheidsmodel geïnkorporeer via 'n eksponensiële bewegende gemiddelde (EMA) proses, wat die optimale gewigsbalans na verskeie iterasies bereik.

Onderwyservrye aanpassing

Stabiele Diffusie-modelle en plug and play-adapters gaan dikwels hand aan hand. Daar is egter waargeneem dat alhoewel die plug and play-adapters tot 'n mate werk, hulle geneig is om beheer in besonderhede te verloor, selfs wanneer 'n meerderheid van hierdie adapters opgelei is met beeldverspreidingsmodelle. Om hierdie probleem teë te werk, kies die AnimateLCM-raamwerk vir onderwyservrye aanpassing, 'n eenvoudige dog effektiewe strategie wat óf die bestaande adapters akkommodeer vir beter versoenbaarheid óf die adapters van die grond af oplei of. Die benadering laat die AnimateLCM-raamwerk toe om die beheerbare video-generering en beeld-tot-video-generering met 'n minimale aantal stappe te bereik sonder om onderwysermodelle te vereis.

AnimateLCM: Eksperimente en resultate

Die AnimateLCM-raamwerk gebruik 'n Stable Diffusion v1-5 as die basismodel, en implementeer die DDIM ODE-oplosser vir opleidingsdoeleindes. Die raamwerk pas ook die Stabiele Diffusion v1-5 toe met oopbronbewegingsgewigte as die onderwyservideo-diffusiemodel met die eksperimente wat op die WebVid2M-datastel uitgevoer word sonder enige bykomende of vermeerderde data. Verder gebruik die raamwerk die TikTok-datastel met BLIP-onderskrifte kort tekstuele aanwysings vir beheerbare videogenerering.

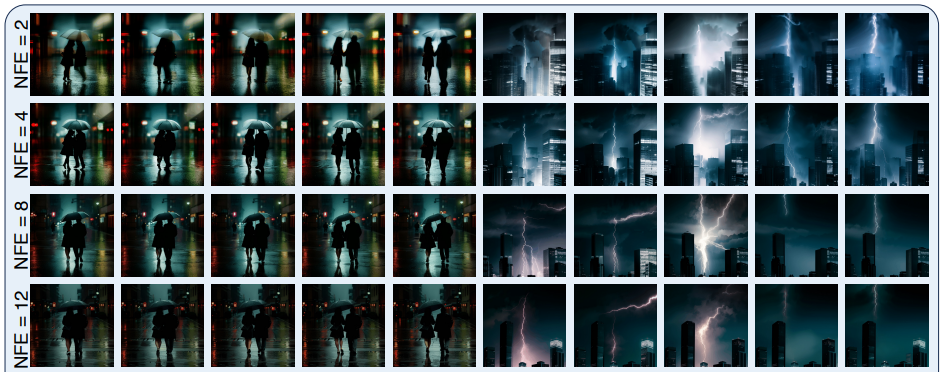

Kwalitatiewe resultate

Die volgende figuur demonstreer resultate van die vier-stap generasie metode geïmplementeer deur die AnimateLCM raamwerk in teks-na-video generering, beeld-tot-video generering en beheerbare video generering.

Soos dit waargeneem kan word, is die resultate wat deur elkeen van hulle gelewer word bevredigend met die gegenereerde resultate wat die vermoë van die AnimateLCM-raamwerk demonstreer om die konsekwentheidseienskap te volg, selfs met verskillende afleidingstappe, wat soortgelyke beweging en styl handhaaf.

Kwantitatiewe resultate

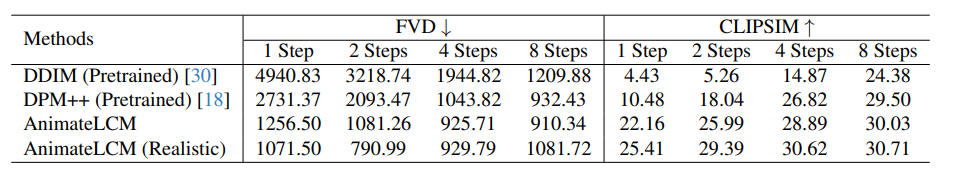

Die volgende figuur illustreer die kwantitatiewe resultate en vergelyking van die AnimateLCM-raamwerk met die nuutste DDIM- en DPM++-metodes.

Soos dit waargeneem kan word, presteer die AnimateLCM-raamwerk die bestaande metodes met 'n aansienlike marge, veral in die lae-stap-regime wat wissel van 1 tot 4 stappe. Verder word die AnimateLCM-metrieke wat in hierdie vergelyking vertoon word, geëvalueer sonder om die CFG- of klassifiseerdervrye leiding te gebruik wat die raamwerk toelaat om byna 50% van die afleidingstyd en afleidingspiekgeheuekoste te bespaar. Verder, om sy prestasie verder te valideer, word die ruimtelike gewigte binne die AnimateLCM-raamwerk vervang met 'n publiek-beskikbare gepersonaliseerde realistiese model wat 'n goeie balans tussen getrouheid en diversiteit vind, wat help om die prestasie verder te bevorder.

Harde Gedagtes

In hierdie artikel het ons gepraat oor AnimateLCM, 'n gepersonaliseerde verspreidingsmodel met adapters wat daarop gemik is om hoëtrou-video's te genereer met minimale stappe en berekeningskoste. Die AnimateLCM-raamwerk is geïnspireer deur die Konsekwentheidsmodel wat die steekproefneming met minimale stappe versnel deur vooraf-opgeleide beeldverspreidingsmodelle te distilleer, en die suksesvolle uitbreiding van die Konsekwentheidsmodel, die Latente Konsekwentheidsmodel of LCM wat voorwaardelike beeldgenerering fasiliteer. In plaas daarvan om konsekwentheidsleer direk op die rou video-datastel uit te voer, stel die AnimateLCM-raamwerk voor om 'n ontkoppelde konsekwentheidsleerstrategie te gebruik wat die distillasie van beweginggenerering-vooraf en beeldgenerering-voorafskakeling ontkoppel, wat die model toelaat om die visuele kwaliteit van die gegenereerde inhoud te verbeter, en verbeter die opleidingsdoeltreffendheid gelyktydig.