思想领袖

数据科学家应该了解的图变换器及其对结构化数据的影响

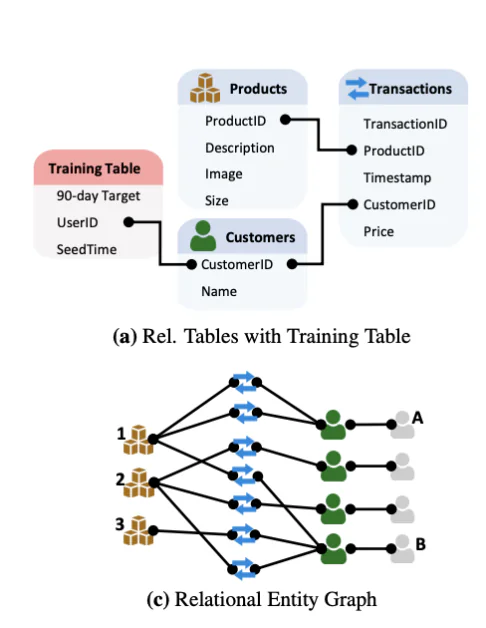

我在斯坦福大学期间参与创建了图神经网络。我很早就意识到这项技术非常强大。每个数据点、每个观察结果、每条知识都不是孤立存在的;它们都是与其他知识相连的图的一部分。重要的是,大多数有价值的业务数据通常以表格的形式存储在数据库和数据仓库中,而它们可以自然地表示为 图形。利用这种关系结构是构建准确、非幻觉的人工智能模型的关键。

图神经网络 (GNN) 引入了消息传递架构,可以对捕捉知识片段之间联系的图进行推理。正如 Transformers 彻底改变了语言理解一样,一类新的模型——Graph Transformers,也为基于图的数据带来了类似的优势。这些模型将注意力机制的灵活性与结构化图先验相结合,从而比 GNN 前辈更有效地建模复杂关系。

为什么图需要的不仅仅是消息传递

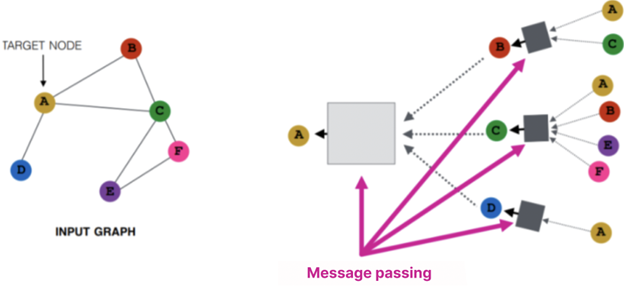

传统的图神经网络(GNN)依赖于 信息传递,即每个节点通过聚合来自邻居节点的信息来更新其内部状态的过程。可以将其视为每个节点与邻近节点交换摘要,然后利用这些摘要来完善自身的理解。这允许信息在多层级上在整个图中传播。

虽然消息传递对于学习局部模式很有帮助,但它也存在很大的局限性:

- 过度挤压:由于信息经过多跳聚合,可能会被压缩,从而丢失有意义的细节。这在深度 GNN 中尤其成问题。

- 背景有限:标准消息传递如果没有多层就无法轻松捕获长距离依赖关系,这会增加复杂性和噪音。

- 表现力:许多图形结构无法仅使用局部邻域信息来区分,从而限制了模型在需要精细结构区分的任务上的性能。

这正是图变换器 (Graph Transformers) 发挥作用的地方。通过用注意力机制取代或增强消息传递,它们允许每个节点根据学习到的重要性直接关注其他节点(即使是远处的节点)。其结果是更丰富的表示、更好的可扩展性,以及更灵活地推理复杂结构的能力。

从 GNN 到 Graph Transformer

这篇标志性论文中介绍了最初的 Transformer 模型, 注意就是您所需要的旨在对序列中 token 之间的关系进行建模。它的成功之处在于自注意力机制,这种机制允许每个输入考虑其他所有输入,并根据学习到的相关性进行加权。

图变换器 调整此范式,允许节点不仅关注其邻居节点,还关注图中的任何节点,可以通过完全连接注意力机制或平衡全局和局部信号的混合方法来实现。挑战在于将结构概念引入为非结构化序列设计的模型中。

图特定的位置编码

与文本不同,图表没有固有的顺序,因此 位置编码指的是将结构化或基于位置的信息注入模型的技术,这并非易事。Graph Transformers 使用各种方法来解决此问题:

- 拉普拉斯特征向量:源自图拉普拉斯矩阵,它们提供了捕捉全局结构的谱嵌入。

- 随机游走:捕获经过多跳从一个节点移动到另一个节点的概率。

- 结构编码:包括距离度量、节点度或边类型。

这些位置编码,无论是谱编码、概率编码还是结构编码,都为图变换器提供了一种理解每个节点在更广阔的图中位置的方法。这种结构感知对于使注意力机制能够在不规则、无序的数据中有效运作至关重要,最终使模型能够捕捉到更简单、纯粹局部方法无法感知的关系。

现实世界的实现和用例

将 Graph Transformers 投入生产需要能够扩展到实际数据规模的基础设施。类似这样的库 PyTorch 几何(PyG) 正在使这一切成为可能。PyG 基于 PyTorch 构建,提供了一个模块化框架,用于在从分子建模到推荐系统等一系列应用中实现 GNN 和 Graph Transformer。它支持在多个小型图和单个大型图上进行小批量训练,并支持多 GPU 和 torch.compile,使其非常适合研究和企业工作流程。

这些工具已经为广泛的实际应用提供支持。在药物研发中,图变换器 (Graph Transformers) 通过将原子相互作用建模为图来帮助预测分子特性。在物流和供应链优化中,它们可以表示和推理由货运、仓库和路线组成的动态网络。电子商务公司使用它们将产品共同购买和浏览行为理解为关系图,从而改进推荐。在网络安全领域,基于图的模型可用于通过分析访问模式、网络拓扑和事件序列来检测异常。

在每一种设置中,从复杂、相互连接的结构中学习,而不完全依赖手工制作的特征的能力,被证明是一项巨大的优势。

技术注意事项

尽管 Graph Transformer 潜力巨大,但也存在一些工程上的权衡。完全自注意力机制会随着节点数量的平方级增长,这使得内存和计算效率成为首要考虑因素,尤其是在大规模或高密度图的情况下。许多现实世界中的图也包含有向边,这引入了不对称性,使得结构信息的编码方式变得复杂。在实际部署中,输入很少是统一的:将图结构数据与文本、时间序列或图像相结合,需要谨慎的架构选择和强大的数据预处理。

这些挑战并非不可克服,但确实需要周到的系统设计,尤其是在从研究原型过渡到可用于生产的模型时。

下一步:法学硕士与图表的碰撞

一个主要的研究方向是大型语言模型 (LLM) 与图结构的集成。这些混合系统使用 LLM 来编码文本上下文或提取实体,然后将这些信息嵌入到图中以进行推理和决策。

在生物学中,这为以下工具提供了动力: AlphaFold在企业 AI 领域,它支持将文档和行为图谱相结合的客户支持系统。图谱转换器 (Graph Transformers) 也发挥着越来越重要的作用,它使 AI 代理能够推理结构化状态表示并动态地确定交互的优先级,从而做出更智能、更可操作的决策。这种融合有助于代理更好地理解层级关系,跟踪随时间变化的依赖关系,并在复杂环境中调整其行为。

该领域仍处于新兴阶段,但潜力巨大。

结语

Graph Transformers 不仅仅是 GNN 的下一代迭代;它们代表了注意力机制、结构化和可扩展性的融合。无论您从事金融、生命科学还是推荐系统工作,其核心信息都很明确:您的数据构成了图,您的模型也应该如此。