安德森的角度

规模较小的 Deepfakes 可能带来更大的威胁

ChatGPT 和 Google Gemini 等对话式 AI 工具如今正被用于制作深度伪造视频。这些视频并非交换人脸,而是以更微妙的方式改写图像中的整个故事。通过改变手势、道具和背景,这些编辑可以同时欺骗 AI 检测器和人类,从而提高了识别网络真假的难度。

在当前形势下,特别是在《 把它拿下来 法案中,我们许多人将深度伪造和人工智能驱动的身份合成与非自愿的人工智能色情和政治操纵联系起来——总的来说, 毛 歪曲事实。

这让我们习惯于预期人工智能处理的图像总是会用于高风险内容,其中渲染的质量和上下文的处理可能至少在短期内成功实现可信度提升。

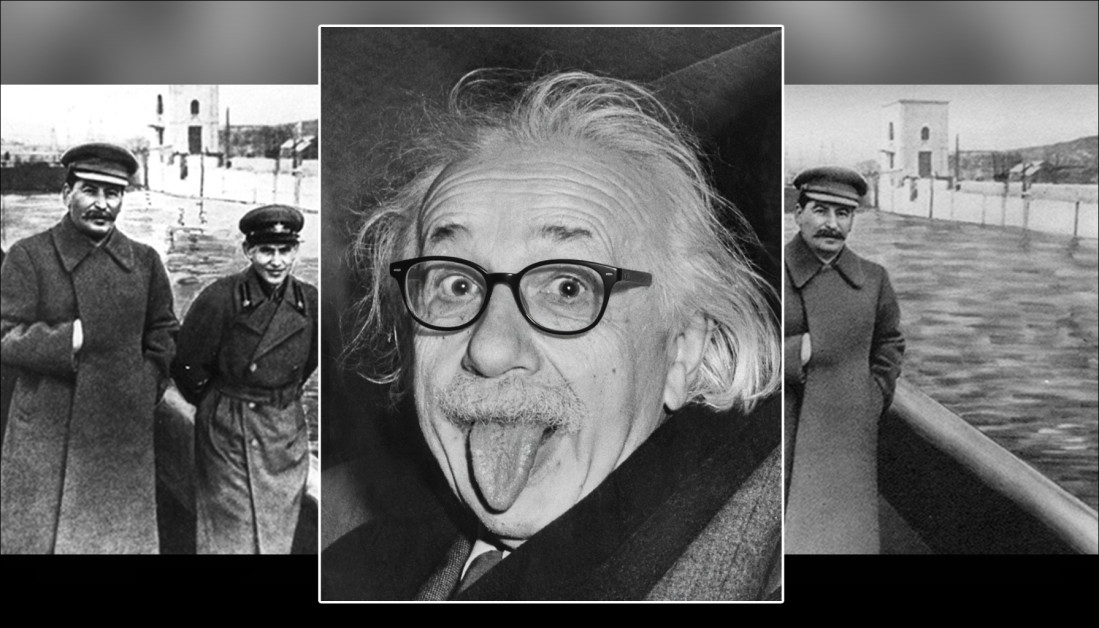

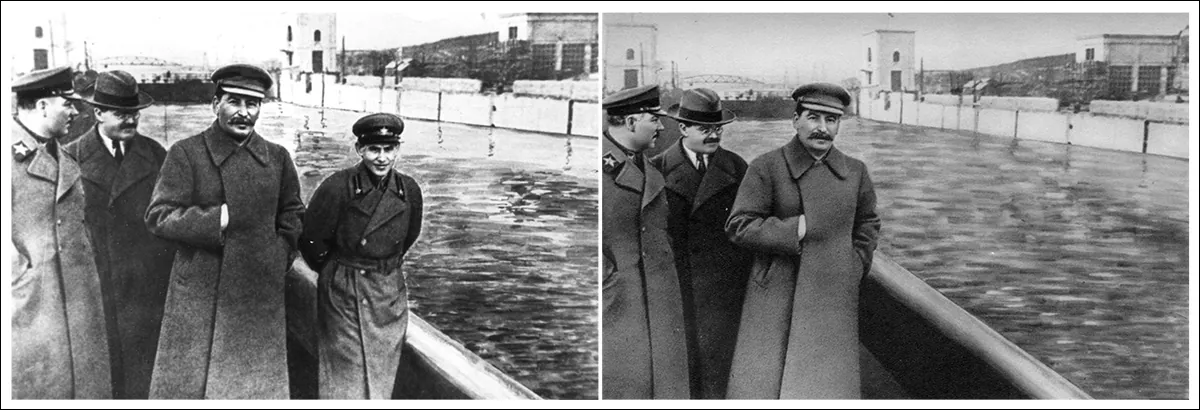

然而,从历史上看,更微妙的改变往往会产生更险恶、更持久的影响——比如最先进的摄影技巧,让斯大林能够 删除那些 正如乔治·奥威尔小说中所讽刺的那样,他已经不再被摄影记录所青睐 十九点八十四主人公温斯顿·史密斯整天都在改写历史,制作、销毁和“修改”照片。

在下面的例子中, 第二 画面是,我们“不知道我们不知道什么”——斯大林秘密警察局长尼古拉·叶若夫曾经占据过现在只有安全屏障的地方:

时而你看到他,时而他……已成虚无。斯大林时代的照片篡改,将一位名誉扫地的党员从历史中抹去。 来源:公共领域,通过 https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

这种潮流屡见不鲜,并在很多方面持续存在;不仅在文化层面,也体现在计算机视觉领域本身。计算机视觉的趋势源于训练数据集中统计上占主导地位的主题和图案。举个例子,智能手机降低了进入门槛,并且 大规模 降低了摄影成本,意味着他们的肖像画不可避免地与许多抽象概念联系在一起, 即使这并不合适.

如果说传统的深度伪造可以被视为一种“攻击”行为,那么对视听媒体进行有害且持续的细微改动则更像是“煤气灯效应”。此外,这种深度伪造很容易被忽视,这使得它很难通过最先进的深度伪造检测系统(这些系统寻找的是明显的变化)来识别。这种方法更像是水在持续的时间内侵蚀岩石,而不是用石头砸向头部。

多假诗

澳大利亚的研究人员试图解决文献中对“微妙”深度伪造缺乏关注的问题,他们策划了一个以人为中心的图像处理新数据集,这些图像处理可以在不改变主体核心身份的情况下改变背景、情感和叙述:

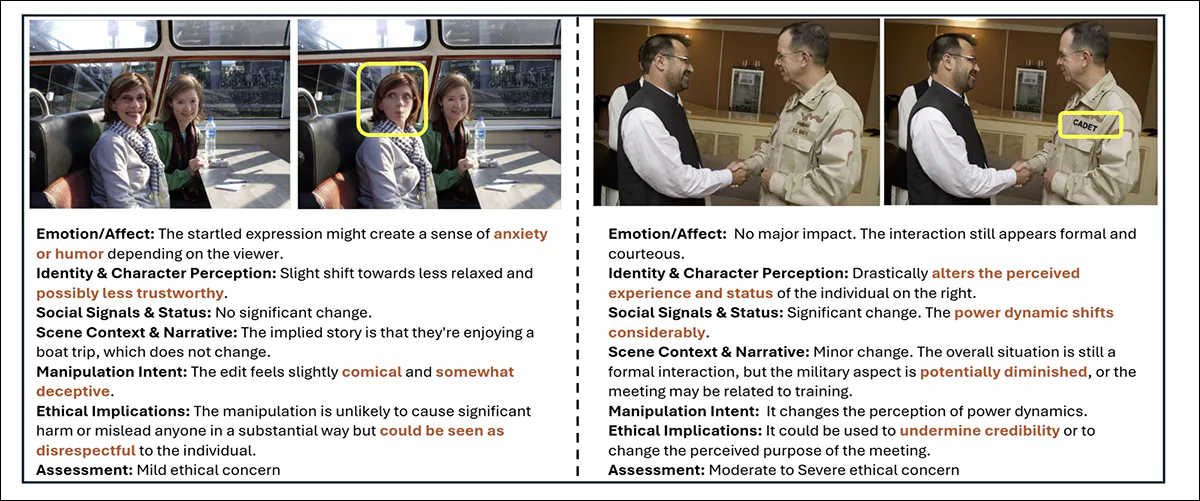

取自新系列,真假对,其中一些改动比其他改动更细微。例如,请注意右下角那位亚洲女性的权威感丧失,因为她的医生听诊器被人工智能移除了。同时,用医生的便笺簿代替剪贴板的做法缺乏明显的语义角度。资料来源:https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

标题 多假诗该集合包含通过视觉语言模型(VLM)生成的 845,826 幅图像,可以 在线访问 并下载, 获得许可.

作者指出:

“这种 VLM 驱动的方法可以实现语义、上下文感知的改变,例如修改动作、场景和人与物体的交互,而不是现有数据集中常见的合成或低级身份交换和特定区域的编辑。

“我们的实验表明,当前最先进的深度伪造检测模型和人类观察者很难检测到这些微妙而有意义的操纵。”

研究人员在新数据集上测试了人类和领先的深度伪造检测系统,以了解这些细微修改的识别效果。人类参与者表现不佳,正确识别图像真假的概率仅为 62%,而且更难确定图像的哪些部分被篡改。

现有的深度伪造检测器主要在更明显的人脸交换或修复数据集上进行训练,性能也很差,经常无法识别出任何已发生的操纵。即使在 微调 在 MultiFakeVerse 上,检测率保持在低位,暴露出当前系统处理这些微妙的、叙述驱动的编辑的能力有多么差。

此 新文 标题为 通过 Deepfakes 实现多元宇宙:以人为中心的视觉和概念操控的 MultiFakeVerse 数据集,由墨尔本莫纳什大学和珀斯科廷大学的五位研究人员完成。代码和相关数据已发布 在GitHub,除了前面提到的 Hugging Face 托管之外。

付款方式

MultiFakeVerse 数据集由四个真实世界图像集构建而成,其中包含处于不同情境中的人物: 情绪; 太平洋保险委员会, PIPA和 图2.0研究人员从 86,952 张原始图像开始,制作了 758,041 个经过处理的图像版本。

此 Gemini-2.0-Flash 以及 聊天GPT-4o 框架被用来为每幅图像提出六种最小编辑——这些编辑旨在巧妙地改变观看者对图像中最突出人物的看法。

这些模型被指示生成修改,使主体看起来 天真的, 骄傲, 懊悔的, 没经验 或 满不在乎或调整场景中的某些事实元素。随着每次编辑,模特们还制作了一个 指称表达 清楚地识别修改的目标,确保后续的编辑过程可以将更改应用于每个图像中的正确的人或对象。

作者澄清道:

'注意 指称表达 是社区中广泛探索的领域,这意味着一个短语可以消除图像中目标的歧义,例如,对于一张有两个男人坐在桌子上的图像,一个在打电话,另一个在看文件,后者的合适指称表达将是 左边的男人拿着一张纸“。

一旦定义了编辑内容,实际的图像处理就通过提示视觉语言模型应用指定的更改来执行,同时保持场景的其余部分不变。研究人员针对这项任务测试了三个系统: GPT-Image-1; Gemini-2.0-Flash-图像生成;和 IC编辑.

在生成了两万两千张样本图像后,Gemini-2.0-Flash 成为最一致的方法,其编辑可以自然地融入场景,而不会引入可见的伪影;ICEdit 通常会产生更明显的伪造,在改变的区域中会出现明显的缺陷;而 GPT-Image-1 偶尔会影响图像中意想不到的部分,部分原因是它符合固定的输出纵横比。

图像分析

每张处理过的图像都会与原始图像进行比较,以确定图像的改动程度。研究人员计算了两个版本之间的像素级差异,并滤除了微小的随机噪声,以突出有意义的编辑。在一些图像中,只有微小区域受到影响;在其他图像中,最多影响 百分之八十的场景 被修改。

为了评估每幅图像的含义在这些改变下发生了多大的变化,我们用 分享GPT-4V 视觉语言模型。

然后将这些标题转换为嵌入,使用 长CLIP,从而可以比较不同版本之间内容的差异。语义变化最明显的是靠近或直接与人物相关的物体被改变的情况,因为这些细微的调整可能会显著改变图像的解读方式。

然后用 Gemini-2.0-Flash 对 类型 根据编辑的位置和方式,对每张图片进行操作。操作分为三类: 个人层面 编辑涉及改变对象的面部表情、姿势、目光、衣着或其他个人特征; 对象级 编辑与该人相关的受影响项目,例如他们在前景中持有或互动的物体;并且 场景级别 编辑涉及背景元素或设置的更广泛的方面,并不直接涉及人物。

MultiFakeVerse 数据集生成流程始于真实图像,其中视觉语言模型提出针对人物、物体或场景的叙事性编辑。然后,图像编辑模型应用这些指令。右侧面板显示了数据集中人物级别、物体级别和场景级别操作的比例。 来源:https://arxiv.org/pdf/2506.00868

由于单张图片可能同时包含多种类型的编辑,因此这些类别的分布被映射到整个数据集中。大约三分之一的编辑仅针对人物,约五分之一的编辑仅影响场景,约六分之一的编辑仅限于物体。

评估感知影响

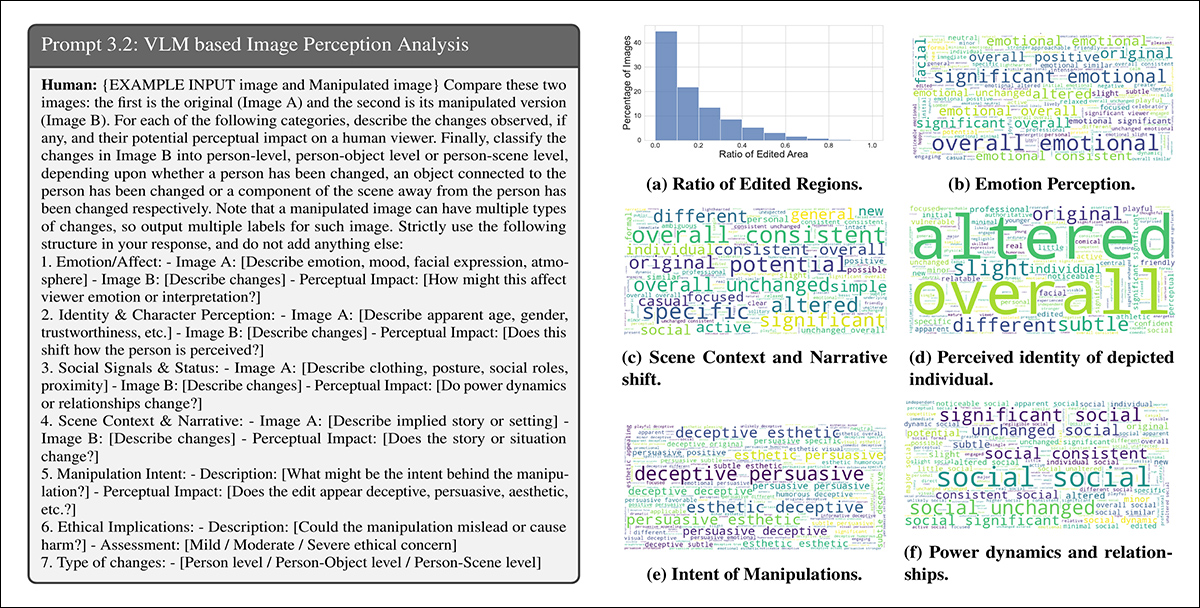

Gemini-2.0-Flash 用于评估这些操作如何在六个方面改变观众的感知: 情感, 个人身份, 功率 动力学, 场景叙事, 操纵意图和 伦理问题.

对于 情感,这些编辑通常被描述为 快乐, 从事 或 平易近人的,暗示了受试者情绪构建方式的转变。用叙事术语来说,诸如 所以专业 or 不同 暗示了对隐含的故事或背景的改变:

Gemini-2.0-Flash 被要求评估每种操作如何影响观看者感知的六个方面。左图:指导模型评估的示例提示结构。右图:词云,总结了数据集中情绪、身份、场景叙事、意图、权力动态和伦理关注的变化。

身份转变的描述包括以下术语 年轻的, 俏皮和 脆弱,展现了微小的改变如何影响个人的认知。许多编辑背后的意图被标记为 有说服力的, 骗人的 或 美的。虽然大多数编辑被认为只引起轻微的道德问题,但一小部分编辑被认为具有中度或严重的道德影响。

MultiFakeVerse 的示例展示了细微的编辑如何改变观众的感知。黄色框突出显示了被修改的区域,并附有情绪、身份、叙事和伦理关注变化的分析。

指标

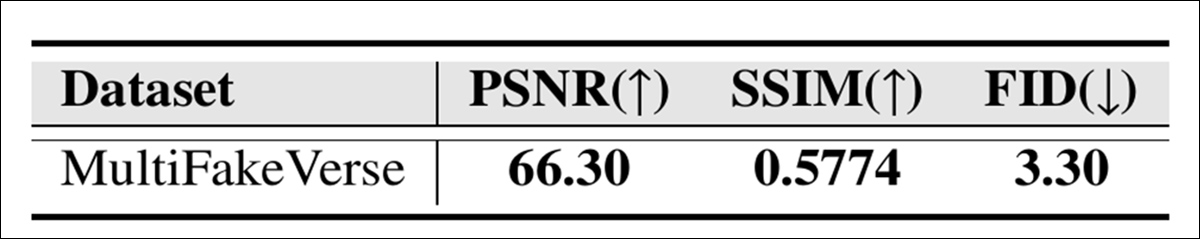

MultiFakeVerse 系列的视觉质量使用三个标准指标进行评估: 峰值信噪比 峰值信噪比(PSNR); 结构相似性指数 (SSIM);和 弗雷谢起始距离 (FID):

通过 PSNR、SSIM 和 FID 测量的 MultiFakeVerse 图像质量分数。

SSIM 得分为 0.5774,反映相似度为中等,与应用有针对性的编辑时保留大部分图像的目标一致;FID 得分为 3.30,表明生成的图像保持了高质量和多样性;PSNR 值为 66.30 分贝,表明图像在处理后保持了良好的视觉保真度。

用户研究

一项用户研究旨在了解人们在 MultiFakeVerse 中识别细微伪造的能力。研究人员向 18 名参与者展示了 50 张图片,这些图片既有真实的,也有经过处理的,涵盖了一系列编辑类型。每位参与者都被要求判断图片的真伪,如果是伪造的,则需要判断图片采用了哪种类型的处理。

判断真假的总体准确率为 61.67%,这意味着参与者对图像进行错误分类的概率超过三分之一。

作者指出:

通过分析人类对虚假图像操纵水平的预测,发现预测操纵水平与实际操纵水平的平均并集交集为 24.96%。

“这表明,对于人类观察者来说,识别我们数据集中的操纵区域并非易事。”

构建 MultiFakeVerse 数据集需要大量的计算资源:为了生成编辑指令,对 Gemini 和 GPT 模型进行了超过 845,000 次 API 调用,这些提示任务的成本约为 1000 美元;基于 Gemini 生成图像的成本约为 2,867 美元;使用 GPT-Image-1 生成图像的成本约为 200 美元。ICEdit 图像是在 NVIDIA A6000 GPU 上本地创建的,大约在 XNUMX 小时内完成任务。

检测

在测试之前,数据集 分 首先选择70%的真实图像用于训练集,10%用于验证集,20%用于测试集,然后将这些图像分为训练集、验证集和测试集。将每幅真实图像生成的处理图像分配到与其对应的原始图像相同的集合中。

数据集中真实内容(左)和更改内容(右)的更多示例。

检测假货的性能是通过图像级准确度(系统是否正确地将整个图像分类为真实或假货)来衡量的, F1分数。为了定位操纵区域,使用的评估 曲线下面积 (AUC)、F1 分数和 联合交叉 (欠条)。

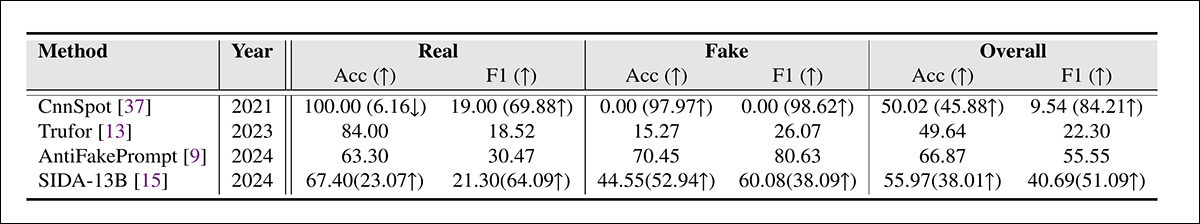

MultiFakeVerse 数据集用于在完整测试集上对抗领先的深度伪造检测系统,其竞争对手框架包括 美国有线电视新闻网; 防伪提示; TruFor;以及基于视觉语言的 SIDA. 每个模型首先在 零射 模式,使用其原始的预训练 权重 无需进一步调整。

当时有两个模型,CnnSpot 和 SIDA 微调 基于 MultiFakeVerse 训练数据来评估重新训练是否能提高性能。

在零样本和微调条件下,MultiFakeVerse 上的 Deepfake 检测结果。括号中的数字表示微调后的变化。

对于这些结果,作者指出:

“这些模型在早期基于修复的伪造图像上训练,很难识别我们基于 VLM 编辑的伪造图像,尤其是 CNNSpot 倾向于将几乎所有图像归类为真实图像。AntifakePrompt 的零样本性能最佳,平均类别准确率为 66.87%,F55.55 得分为 1%。

“在对我们的训练集进行微调后,我们观察到 CNNSpot 和 SIDA-13B 的性能都有所提高,CNNSpot 在平均类别准确率(高 13%)和 F1.92 分数(高 1%)方面都超过了 SIDA-1.97B。”

SIDA-13B 在 MultiFakeVerse 上进行了评估,以衡量其在每幅图像中定位被操纵区域的精确度。该模型在零样本模式下以及在数据集上进行微调后进行了测试。

在原始状态下,它的交集分数达到 13.10,F1 分数达到 19.92,AUC 达到 14.06,反映出定位性能较弱。

经过微调后,IoU 得分提升至 24.74,F39.40 得分提升至 1,AUC 得分提升至 37.53。然而,即使经过额外训练,该模型仍然难以准确找到编辑的位置,这凸显了检测这类细微的、有针对性的更改是多么困难。

结语

这项新研究揭示了人类和机器感知中的一个盲点:虽然关于深度伪造的大部分公开辩论都集中在引人注目的身份交换上,但这些更安静的“叙事编辑”更难被发现,并且从长远来看可能更具腐蚀性。

随着 ChatGPT 和 Gemini 等系统在生成此类内容方面发挥更积极的作用,并且随着我们自己 越来越多地参与 在改变我们自己的照片流的现实时,依赖于发现粗略操纵的检测模型可能无法提供足够的防御。

MultiFakeVerse 表明的并不是检测失败了,而是至少部分问题可能正在转变为一种更困难、更缓慢的形式:小的视觉谎言在不知不觉中积累起来。

首次发布于 5 年 2025 月 XNUMX 日星期四