安德森的角度

眼不见,心不烦:解决人工智能视频领域的最大难题

即使是最好的 AI 视频生成器,其最大的问题也是它们患有慢性失忆症——而中国的新研究正在努力解决这一难题。

即使是最好、最先进的AI视频生成系统,其最大的问题也在于它们都存在以下问题: 慢性失忆症如果摄像机从聚焦的物体上移开,然后再移回来,它就永远找不到最初在那里的物体了——角色会消失,外观和/或动作类型会改变,背景也可能已经改变。

这是因为基于扩散的发电系统滚动能力有限。 注意力窗口并且因为它总是与……有关 那一刻它能看到什么;在真正的演绎中 唯我论, 什么是 学校以外 对于生成式人工智能而言,帧不存在——它会被直接从内存中清除。

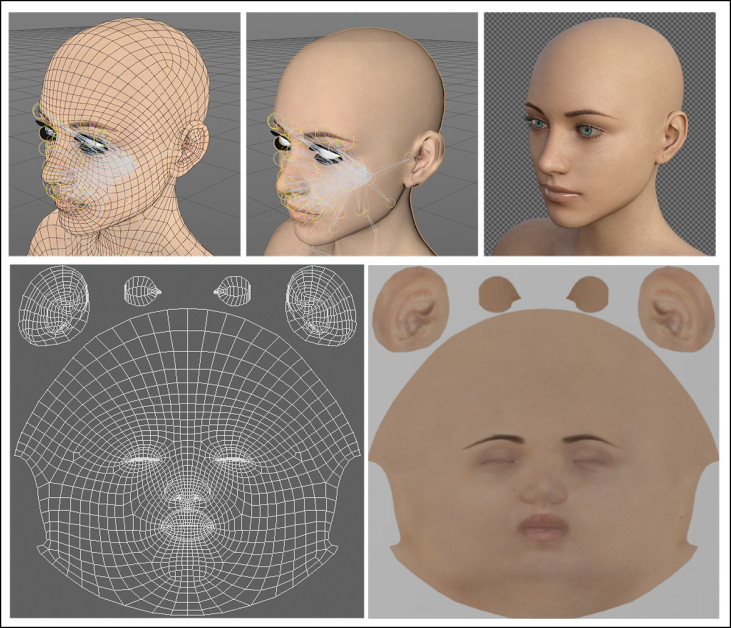

这能 在传统CGI中,这从来都不是问题。它可以随时指代并准确地重现渲染视频中可能需要再次使用的对象,包括外观和动作:

传统的 CGI 网格和位图纹理总是可以重新绘制到渲染中,从而提供一致的外观——这在 AI 方法中要难得多,因为没有等效的“平面参考”文件或相关文件的集合。

这是因为 CGI 的组成元素,如网格和纹理(见上图),以及运动文件和其他动态行为,可以独立地存储在磁盘上,并随时绘制到合成中。

生成式视频人工智能中并不存在这样的“扁平存储库”;它所能达到的最接近的功能是…… LoRA – 经过专门训练的辅助文件,可在消费级设备上进行训练,从而实现新颖的角色和特定的服装。 被迫进入视频:

点击播放。 通过使用 LoRA,可以在一定程度上缓解 AI 视频的唯我论问题——但结果可能令人难以承受。

但这并非理想的解决方案。首先,LoRa 与特定版本的基金会模型(例如 Wan2+ 或 )绑定。 混元视频), 需要重新创建 每次基础模型发生变化时。另外,LoRA 往往会扭曲权重 根据基础模型,LoRa训练好的身份信息会被应用到场景中的所有角色。此外, 微调 这类方法是 非常敏感 针对质量低劣的数据集。

精准返场

现在,中国一项新的产学研合作项目提出了一个重要的解决方案,这是我在过去三年多报道该问题以来首次发现的。该方法采用了研究人员称之为……的技术。 混合内存 为了保持屏幕外角色及其周围环境的活跃性和准确性 潜在空间 该模型使得当我们的视角重新回到它们时,效果保持一致:

点击播放。 从新论文的项目网站来看,有两个 AI 生成的(WAN)字符离开帧并准确重新进入帧的例子。 来源

需要强调的是,这与实现目标并非同一回事。 字符一致性 跨越不同的镜头——据称已经实现了这一点 一年前 在 Runway 的第四代版本中,并且仍然 an 正在进行 追求 在研究文献中。

相反,这里解决的问题,是我见过的任何商业或实验框架都无法实现的—— 视觉上一致的重新出现 描绘一个未出现在屏幕上的角色之前的外貌、动作和环境:

点击播放。 新倡议项目网站上给出的另外两个主要例子。

显然,这里所应用的原理同样可以应用于其他领域,例如城市探索、POV驾驶或其他类型的非角色渲染。

还应强调的是,这种新方法并没有解决或应对 Runway Gen4 和其他闭源平台声称已经解决的问题,即通过重新创建角色来解决的问题。 不同镜头相反,它做到了它们都尚未成功做到的事情——将角色和环境持久地保留在记忆中。 无需始终对观众可见.

这项新工作包含一个专门生成的数据集,该数据集是通过以下方式生成的: 虚幻引擎此外,该框架还包含针对唯我论问题的自定义指标*,以及基于广域网构建的定制生成框架。在与少数类似系统的对比测试中,作者声称取得了最先进的结果,并评论道:

“[记忆]机制已成为推进世界模型发展的关键前沿,因为记忆容量决定了生成内容的空间和时间一致性。

具体来说,正是认知锚点使得模型能够在观点转变或长期推断过程中保留历史背景。

“如果没有强大的记忆功能,模拟世界很快就会崩溃成脱节、混乱的片段。”

此 新文 标题为 眼不见心不烦:面向动态视频世界模型的混合存储器该研究由华中科技大学的七位研究人员和快手科技的克林团队共同完成。

付款方式

新作品的核心是 混合内存这有助于“视野外推断”——即在观众“移开视线”(或角色本身退出视野)时,仍能保留角色及其背景信息。在这种情况下,框架需要执行以下操作。 时空解耦其中,它同时关注观众可见的生成过程,以及现在不在画面中的角色的屏幕外存在。

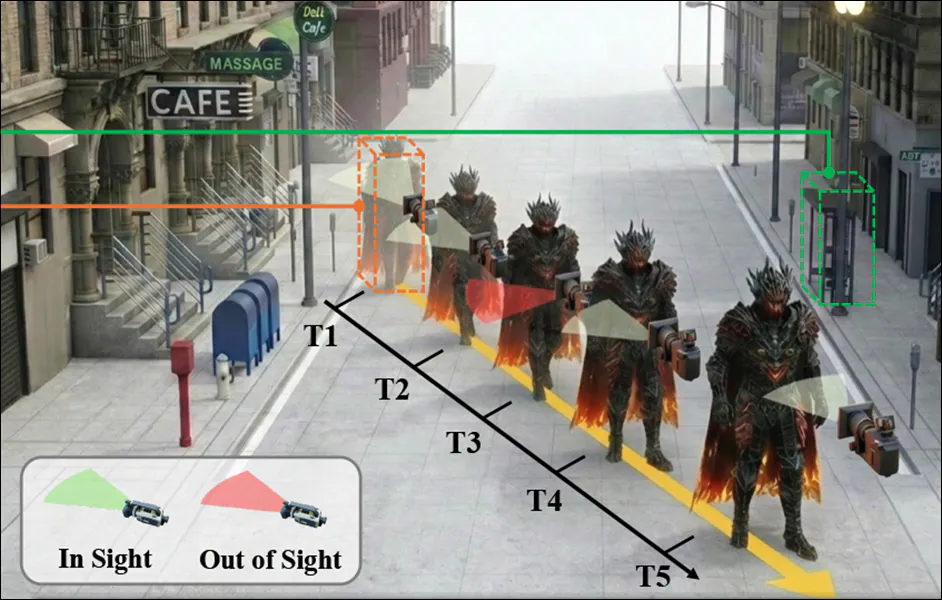

镜头进出画面运动示例。在这些例子中,是摄像机的移动导致角色离开画面,但在一些例子中,我们也可以看到角色自身暂时移出屏幕。 来源

作者指出,在扩散潜伏期 嵌入需要提取和使用的特征非常多。 纠缠 以及其他特征和属性;而且试图提取它们往往会导致主体“冻结”在背景中。因此,他们设计并策划了 HM-World 数据集**,专门用于训练混合记忆:

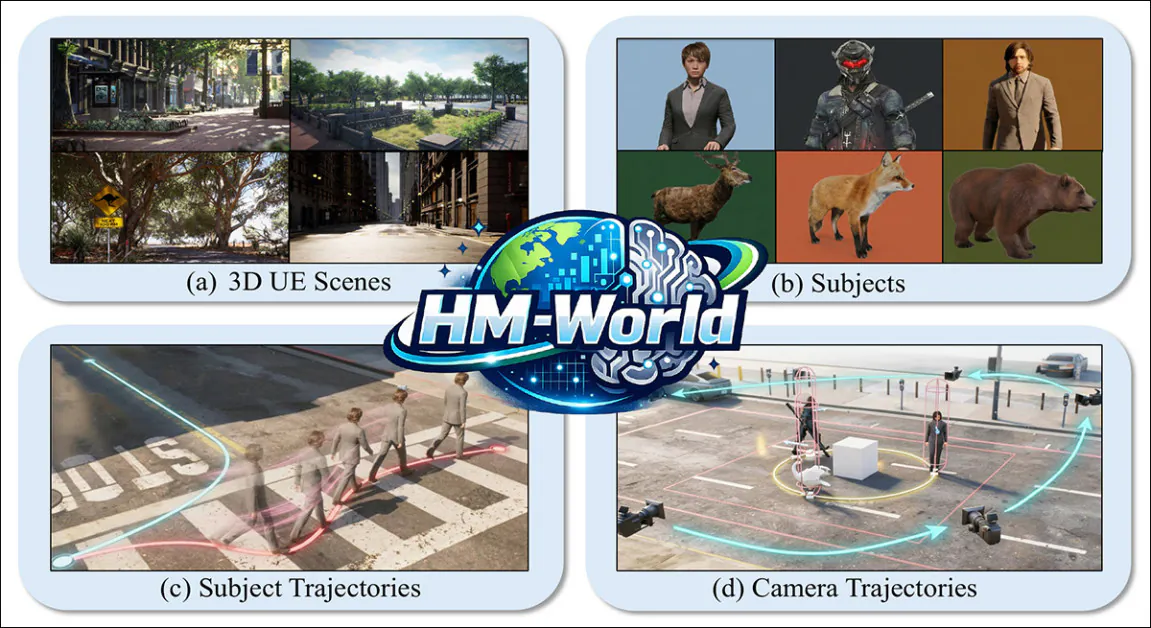

本文选取了 HM-World 数据集中包含的四个类别的样本。

该系列作品的构建围绕四个维度展开: 主体轨迹, 相机轨迹, 场景和 主题.

此 综合数据 《HM-World》包含17个场景和49个对象,其中包括各种外貌的人物以及多种动物。这些对象通过虚幻引擎以程序化的方式组合放置在场景中,每个对象都拥有独特的动作动画,并沿着随机选择的轨迹移动。

作者指出,一组多样化的 出入口 数据集中描绘了各种事件,其中包括 28 条不同的相机轨迹,每条轨迹都有多个起点。

最终收录的视频片段共计59,225个,每个片段都附有注释。 MiniCPM-V 多模态大型语言模型(MLLM)。

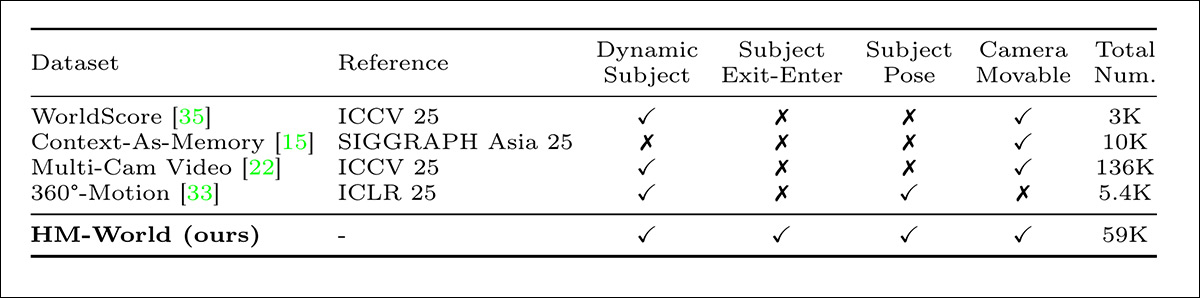

研究人员指出,与以往的数据集相比,他们收集的数据具有统计学优势。 世界评分; 上下文即记忆; 多机位视频;和 360°运动:

现有数据集与 HM-World 数据集的比较,其中“动态主体”表示存在移动实体,“主体出入”表示包含主体离开和重新进入画面的片段,“主体姿态”是指包含带注释的 3D 姿态。

少有人走的路

给定若干帧历史图像和已知的摄像机路径,任务是在观察者视角变化时预测未来的画面,同时还要考虑独立移动且可能离开画面后再返回的物体。这不仅仅需要保持背景稳定,因为模型还必须保留每个移动物体外观和行为的连贯内部记录,即使在物体不可见的时间段内也是如此。

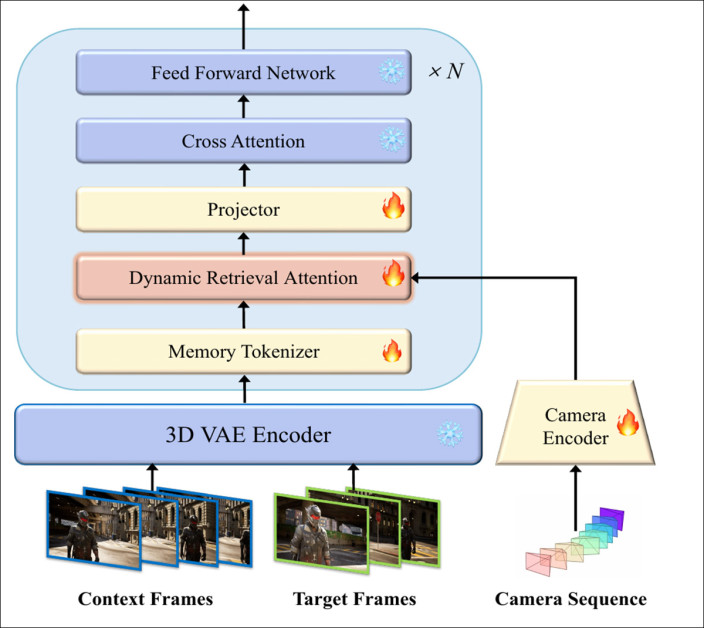

作者们 混合动态检索注意力 (HyDRA)方法通过引入专用的记忆通路来解决这个问题,该通路将动态主体与静态场景表征分离,使它们能够随着时间的推移而持续存在,并以一致的外观和运动重新出现:

HyDRA模型的概念图。

HyDRA 是建立在……之上的 Wan2.1-T2V-1.3B核心扩散管道基本保持不变,同时引入了一种改进型扩散管道。 变压器 该模块整合了动态检索注意力机制。这使得模型能够选择性地从过去的帧中回忆运动和外观线索,而不是依赖于固定或局部的上下文。

这个过程采用了一种改进的 流量匹配 以培训目标代替标准 扩散损失.

为了使场景与摄像机运动保持一致,摄像机轨迹被注入为显式的条件信号,每一帧的姿态由旋转和平移定义,然后转换为紧凑的表示,以捕捉视角随时间演变的方式。

与之前的(Kling)一致 ReCamMaster 然后,该结果由摄像头编码器解析,该编码器实现为 多层感知器然后广播并添加到 扩散变压器 具备相关功能,使模型能够在相机移动时保持物体位置的一致性。

符号化

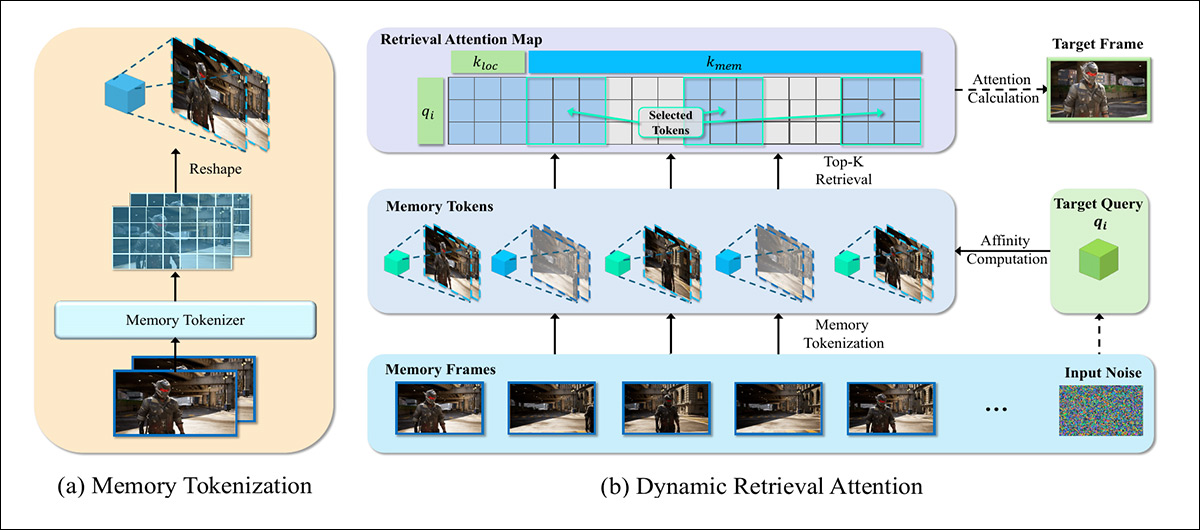

原始扩散潜能将主体运动、外观和背景混合成一个纠缠的表示,试图直接从这个空间中检索信息可能会引入无关的背景,或者导致移动的主体“融入”场景中。

HyDRA 通过基于 3D 卷积的记忆标记器来解决这个问题,它将空间和时间一起处理——它不是转发完整的潜在历史,而是将它们压缩成紧凑的、运动感知的记忆标记,从而保留主体的外观和运动方式:

HyDRA 概述。左图:记忆标记器将过去的帧转换为紧凑的、运动感知的记忆标记;右图:动态检索注意力机制根据这些标记评估当前查询,检索最相关的标记,并使用它们来恢复生成的帧中一致的外观和运动。

这些标记构成了一种结构化的混合记忆,它能够过滤噪声,同时保留长程动态信息。这些标记被传递给动态检索注意力模块,使模型能够选择性地回忆起屏幕外的对象,从而使它们以一致的外观、运动和上下文再次出现。

动态检索注意力

HyDRA的双记忆机制也采用了 动态检索注意力 在框架内扮演着独特但互补的角色。

记忆标记化将过去的潜在表征压缩成结构化的、运动感知的标记,从而将动态主体与静态场景内容区分开来,减少了主体与背景混淆的常见现象。这些标记构成了一个持久的记忆库,而非完整的帧历史记录。

动态检索注意力机制在画面生成过程中会作用于这个信息库,将当前查询与存储的标记进行比对,并选择性地调用与当前画面变化最相关的标记。这使得画面外的物体能够继续其潜在的演变过程(例如,在观众看不到它们时继续行走、奔跑),并在重新出现在画面中时保持一致的外观和动作,而不是重置或退化。

数据与测试

在测试中,基于 Wan 的 HyDRA 系统对 77 个上下文帧进行编码和下采样,然后使用 3D 变分自编码器对其进行解析(阿联酋),而上述内存标记器使用 3D 卷积 在 内核大小 2x4x4。

该模型在 HW-World 数据集上进行了 10,000 次迭代训练,使用了 32 个(未指定)GPU。 批量大小 32。

测试中使用了异常多的指标:除了常用的峰值信噪比(信噪比),结构相似性指数(SSIM卡),以及学习到的感知相似性度量(LPIPS作者们还采用了 主题一致性 以及 背景一致性 来自 工作台 套件,用于评估帧级一致性。

此外,他们还设计了一个名为“自定义指标”的指标 动态主体一致性 (DSC),它使用来自以下位置的边界框: YOLO V11,用于创建以运动对象为特征的裁剪区域,从中提取语义特征,然后计算它们的相似性。

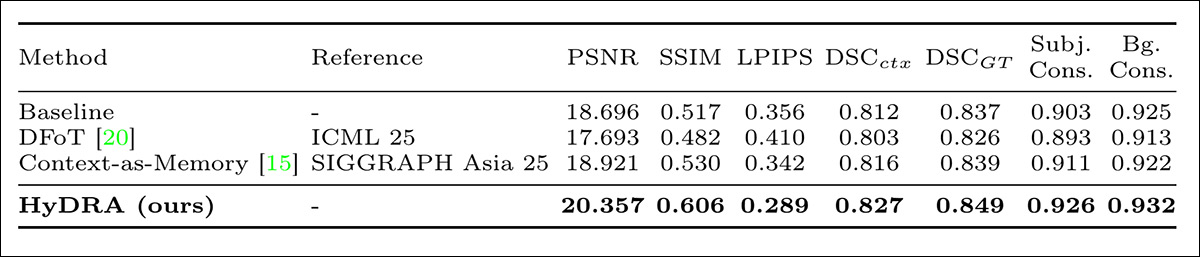

HyDRA 曾与……对抗 扩散强迫变压器 (DFoT),以及 上下文即记忆与配备摄像头编码器的基准模型 Wan2.1-T2V-1.3B(用于表示所有片段共有的主观视角)相比,所有模型均在 HW-World 数据集上进行训练。 世界游戏 也被用作零样本二次检测样本库:

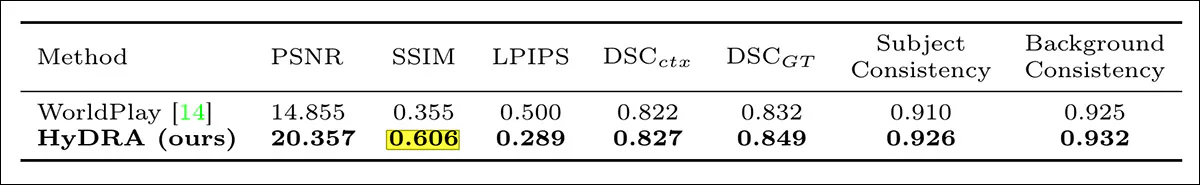

在初步的定量比较中,HyDRA 的性能优于所有基线模型,PSNR 从 18.696 提升至 20.357,SSIM 从 0.517 提升至 0.606。它还获得了最高的上下文和真实 Dice 系数,分别为 0.827 和 0.849,主体和背景一致性分别达到 0.926 和 0.932。

与先前方法进行初步定量比较的结果。

DFoT 的 PSNR 达到 17.693,Context as Memory 的 PSNR 达到 18.921,其提升归功于记忆标记化与动态检索注意力的结合:

将 HyDRA 与当前最先进的技术进行定量比较。

关于针对 WorldPlay 的测试,作者指出:

“我们的方法在所有指标上都超越了 WorldPlay,PSNR 差距显著,达到 5.502。虽然 WorldPlay 由于领域分布差距和缺乏特定的微调,在 GT 参考指标上表现较差(例如,PSNR 为 14.855,DSCGT 为 0.832),但它在上下文参考指标上表现出了卓越的鲁棒性,实现了 0.822 的 DSCctx。

“这一观察结果不仅证实了经过广泛训练的模型具有相当的混合一致性,而且间接验证了我们提出的 DSC 指标在反映动态主体一致性方面的合理性。

“最终,这些令人印象深刻的结果突显了我们模型的卓越性能,证明了它甚至优于现有的商业模型。”

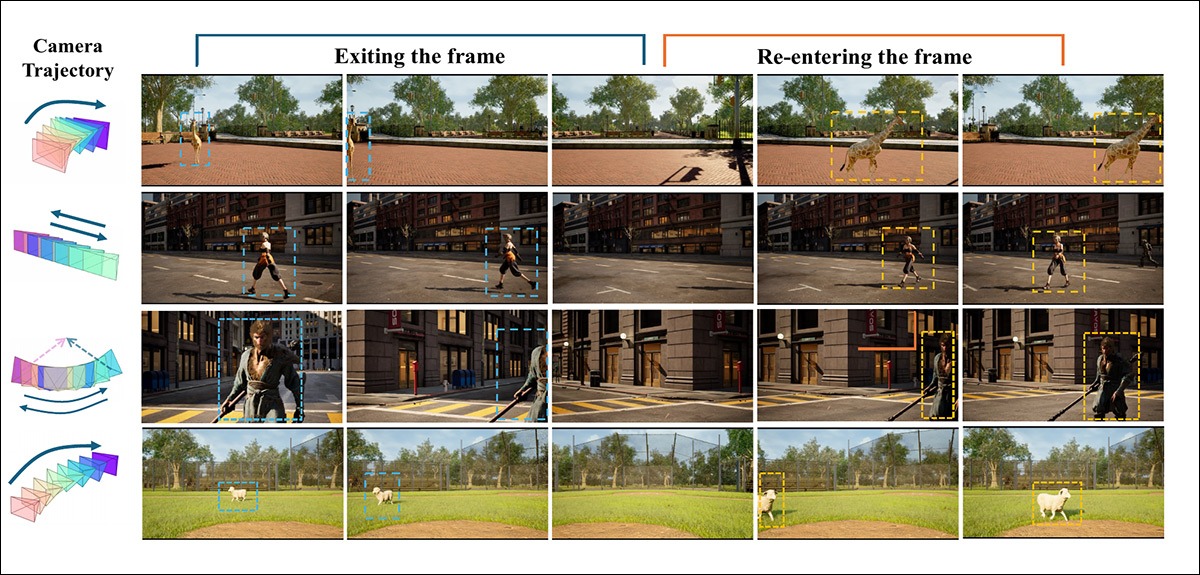

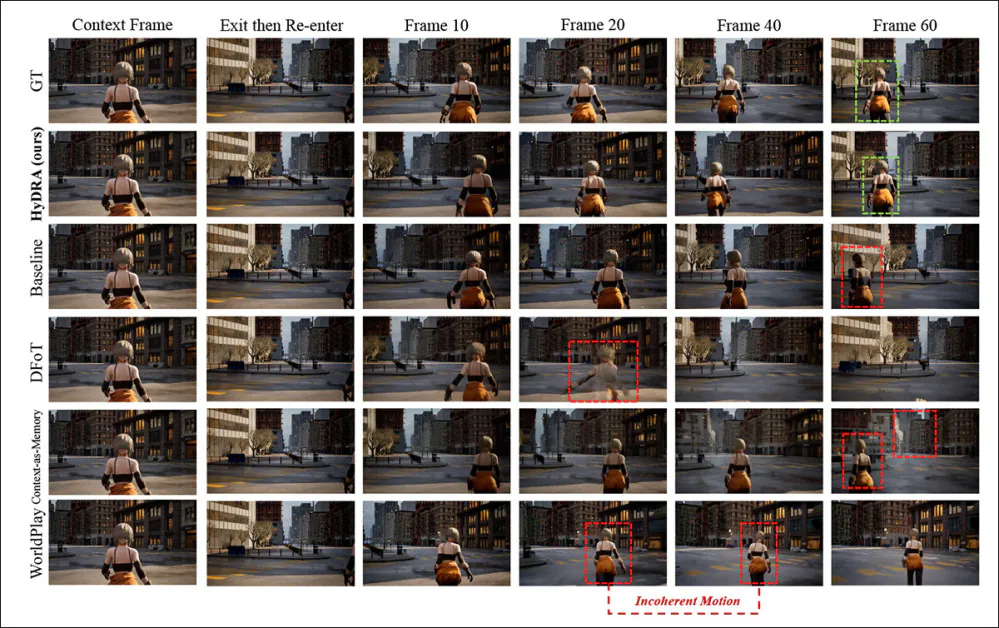

本文对测试中开展的定性比较进行了静态表示:

对摄像机运动下出入画面的情况进行定性比较。作者指出,HyDRA 在出入画面后仍能保持被摄对象的身份、姿态和运动连续性,与真实情况高度吻合;而其他方法则会出现漂移、运动不连贯或被摄对象退化等问题(图中红色部分为重现部分,绿色部分为重现部分)。

针对这些结果,作者评论道:

在处理复杂的出入事件时,基线模型和基于情境记忆的模型都存在严重的主体变形和运动不连贯性问题。DFoT模型无法保持主体的完整性,导致主体完全消失。虽然WorldPlay模型能够保持主体外观的一致性,但它存在动作卡顿和不自然的问题。

“相比之下,我们的方法成功地保持了混合一致性,在受试者重新进入画面后,既保留了受试者的身份,又保持了运动的连贯性。”

更多结果可以观看视频版,网址为: 补充网站其中前四个例子已由我们剪辑成以下视频:

点击播放。 项目现场公布了六项测试结果中的四项。 来源

结语

虽然任何试图解决 AI 视频生成中最大的难题之一的尝试都值得欢迎,但在我看来,对于这类退出/重新进入问题,最佳解决方案似乎不可避免地会像 CGI 一样,以可以单独编辑并引入作曲空间的独立参考材料的形式出现。

这种试图在嵌入式系统中保持其活性的做法 特设 这种即兴操作的方式似乎令人疲惫,而且也无法提供清晰的途径来实现目前诸如 Runway 等各种黑盒门户网站所提供的镜头内一致性。如果后续镜头需要访问前一个镜头的潜在空间,为什么不让两个镜头分别嵌入独立的角色信息呢?

* 还没有其他人给它命名,没有共同的术语,讨论就很难进行。

**目前项目页面上显示“即将推出”。

首次发布于 27 年 2026 月 XNUMX 日星期五