安德森的角度

新的研究论文质疑人工智能聊天的“代币”定价

新的研究表明,人工智能服务采用代币计费的方式,向用户隐瞒了实际成本。提供商可以通过伪造代币数量或添加隐藏步骤来悄悄抬高费用。有些系统会运行一些额外的流程,这些流程不会影响输出,但仍会显示在账单上。虽然有人提出了审计工具,但由于缺乏真正的监督,用户最终支付的费用超出了他们的预期。

在几乎所有情况下,我们作为消费者为人工智能聊天界面支付的费用,例如 聊天GPT-4o,目前以 令牌:在使用过程中不被注意的不可见文本单元,但为了计费目的而精确计算;虽然每次交换都是根据处理的代币数量来定价,但用户没有直接的方法来确认数量。

尽管我们(充其量)对所购买的“代币”单元所能获得的东西的理解并不完善,但基于代币的计费已经成为跨供应商的标准方法,而这种方法建立在可能被证明是不可靠的信任假设之上。

标记词

标记与单词并不完全相同,尽管它们通常起着类似的作用,并且大多数提供商使用术语“标记”来描述文本的小单位,例如单词、标点符号或单词片段。单词 '难以置信'例如,可能被一个系统视为一个令牌,而另一个系统可能会将其拆分为 un, 相信 以及 能够,每增加一块,成本就会增加。

该系统适用于用户输入的文本和模型的回复,价格基于这些单元的总数。

困难在于用户 看不到这个过程。大多数界面在对话过程中不会显示令牌计数,而且令牌的计算方式很难重现。即使显示了计数 后 回复后,判断是否公平已经太晚了,导致用户看到的内容与他们支付的内容不匹配。

最近的研究指出了更深层次的问题: 一项研究中 展示了提供商如何在不违反规则的情况下,通过以用户无法察觉的方式增加令牌数量来收取过高的费用; 另一个 界面显示的内容与实际计费不匹配,导致用户产生效率的错觉,而实际上可能根本没有效率; 第三 揭示模型如何定期生成从未向用户显示但仍出现在发票上的内部推理步骤。

研究结果描述了一个系统 似乎 精准,精确的数字意味着清晰,但其底层逻辑却隐藏着。无论这是设计使然,还是结构缺陷,结果都是一样的:用户支付的费用超出了他们所能看到的,而且往往超出了他们的预期。

一打便宜一打?

在 第一 这些论文的标题是 你的法学硕士收费过高?代币化、透明度和激励机制来自马克斯普朗克软件系统研究所的四位研究人员——作者认为,基于代币的计费的风险不仅限于不透明性,还指出提供商存在增加代币数量的内在动机:

问题的核心在于字符串的标记化并非唯一。例如,假设用户向提供商提交“下一届 NeurIPS 在哪里举行?”这个问题,提供商将其输入到 LLM 中,然后模型生成由两个标记组成的输出“|San| Diego|”。

由于用户对生成过程毫不知情,自私自利的提供商有能力向用户错误地报告输出的标记化信息,甚至无需更改底层字符串。例如,提供商可以简单地共享标记化“|S|a|n| |D|i|e|g|o|”,并向用户多收九个标记,而不是两个!

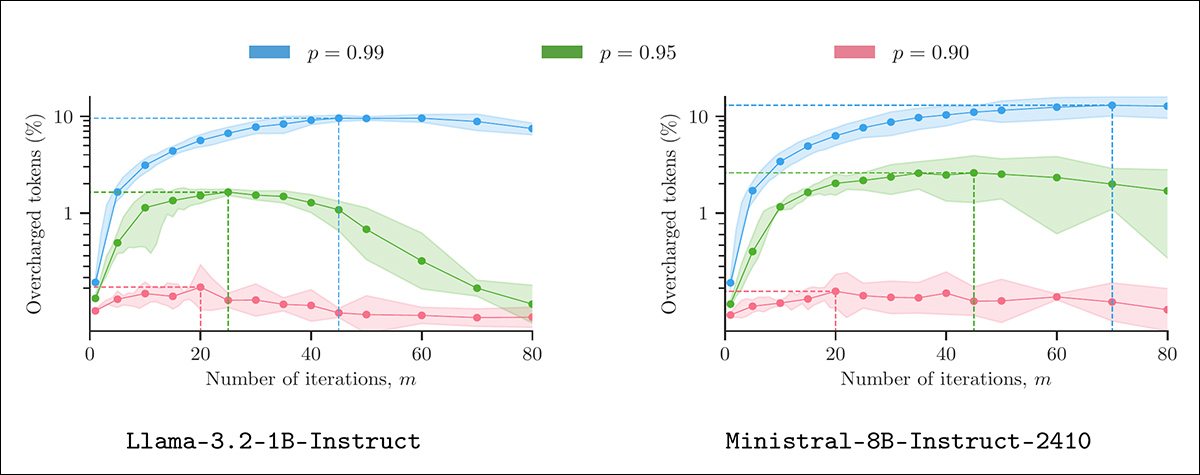

本文提出了一种启发式方法,能够在不改变可见输出的情况下执行此类不诚实的计算,并且在典型的解码设置下不会违反合理性。在以下模型上进行了测试: 骆驼, 寒冷西北风 以及 芽 系列中,使用真实提示,该方法实现了可测量的过充电而不会出现异常:

使用“似是而非的误报”进行代币膨胀。每个面板显示了提供商在不同采样参数(m 和 p)下,将算法 1 应用于 400 个 LMSYS 指令输出后,代币超额收费的百分比。所有输出均在温度 1.3 下生成,每个设置重复 90 次,以计算 XNUMX% 的置信区间。 来源:https://arxiv.org/pdf/2505.21627

为了解决这个问题,研究人员呼吁根据 字符数 他们认为,这是唯一能让服务提供商诚实报告使用情况的方法。如果目标是公平定价,那么将成本与可见字符(而非隐藏流程)挂钩是唯一经得起推敲的选择。他们认为,基于字符的定价可以消除误报的动机,同时还能奖励更短、更高效的输出。

然而,这里还有一些额外的考虑(大多数情况下作者也承认了这一点)。首先,提出的基于字符的方案引入了额外的商业逻辑,可能对供应商有利,而非消费者:

“从不误报的提供商有明确的动机来生成尽可能短的输出令牌序列,并改进当前的标记化算法(如 BPE),以便它们尽可能地压缩输出令牌序列”

这里的乐观之处在于,这能鼓励供应商提供简洁、更有意义、更有价值的输出。实际上,供应商显然没有其他更明智的方法来减少文本数量。

其次,作者指出,有理由认为,公司可能需要立法才能从晦涩难懂的代币系统过渡到更清晰的基于文本的计费方式。未来,一家新兴的初创公司可能会决定通过推出这种定价模式来让自己的产品脱颖而出;但任何拥有真正有竞争力的产品(并且运营规模低于)的人, EEE 类别) 没有动力这么做。

最后,像作者提出的这种盗窃算法本身也会产生计算成本;如果计算“附加费”的成本超过了潜在的利润收益,那么这种方案显然毫无价值。然而,研究人员强调,他们提出的算法是有效且经济的。

作者提供了他们的理论的代码 在GitHub.

交换机

第二 纸 – 标题为 看不见的代币,看得见的账单:迫切需要审计不透明的LLM服务中的隐藏操作来自马里兰大学和伯克利大学的研究人员认为,商业语言模型 API 中的激励机制错位不仅限于 token 拆分,还扩展到 整个班级 隐藏的操作。

这些包括内部模型调用、推测推理、工具使用和多代理交互——所有这些都可能向用户收费,而用户无法看到或追索。

各大提供商的推理 LLM API 的定价和透明度。所有列出的服务都向用户收取隐藏的内部推理令牌的费用,并且没有一个在运行时显示这些令牌。成本差异很大,尽管透明度相同,但 OpenAI 的 o1-pro 模型每百万令牌的收费却是 Claude Opus 4 或 Gemini 2.5 Pro 的十倍。 资料来源:https://www.arxiv.org/pdf/2505.18471

与传统计费不同,传统计费的服务数量和质量是可以验证的,作者认为,当今的 LLM 平台在 结构不透明:根据报告的令牌和 API 使用情况向用户收费,但无法确认这些指标是否反映了真实或必要的工作。

论文指出了两种主要的操纵形式: 数量通胀,令牌或调用的数量增加而用户却没有受益;并且 质量降级其中,性能较低的模型或工具被默默地用来代替优质组件:

在推理 LLM API 中,提供商通常会维护同一模型系列的多个变体,这些变体在容量、训练数据或优化策略方面有所不同(例如,ChatGPT o1、o3)。模型降级是指默默替换成本较低的模型,这可能会导致预期服务质量与实际服务质量之间的不一致。

例如,一个提示可能由一个较小规模的模型来处理,而计费保持不变。这种做法很难被用户察觉,因为最终答案对于许多任务来说可能仍然看起来合理。

论文记录了超过 90% 的已计费代币从未向用户展示的情况,其内部原因导致代币使用量膨胀了 20 倍以上。无论是否合理,这些步骤的不透明性都剥夺了用户评估其相关性或合法性的任何依据。

在代理系统中,不透明度会增加,因为人工智能代理之间的内部交换可能会产生费用,而不会对最终输出产生重大影响:

除了内部推理之外,代理还通过交换提示、摘要和规划指令进行通信。每个代理都会解释来自其他代理的输入,并生成输出以指导工作流程。这些代理间消息可能会消耗大量令牌,而这些令牌通常无法直接被最终用户看到。

代理协调过程中消耗的所有令牌,包括生成的提示、响应和与工具相关的指令,通常都不会向用户显示。当代理本身使用推理模型时,计费会变得更加不透明。

为了应对这些问题,作者提出了一个分层审计框架,其中包括内部活动的加密证明、模型或工具身份的可验证标记以及独立监督。然而,潜在的担忧是结构性的:目前的法学硕士计费方案依赖于一种持久的 信息不对称导致用户面临无法核实或分摊的成本。

计算无形之物

最后一篇论文来自马里兰大学的研究人员,他们重新定义了计费问题,不再将其视为滥用或误报的问题,而是结构问题。 纸 – 标题为 CoIn:计算商业不透明 LLM API 中的隐形推理标记以及马里兰大学的十位研究人员观察到,大多数商业法学硕士服务现在都隐藏了 中级推理 这有助于模型的最终答案,然而 这些代币仍需收费.

论文声称,这将创建一个不可观察的计费表面,其中整个序列可以在不被检测到的情况下被伪造、注入或夸大*:

“[这种]隐形性使得供应商能够 错误报告令牌数量 or 注入低成本、虚构的推理令牌,人为地增加令牌数量。我们将这种做法称为 代币数量膨胀.

例如,OpenAI 的 o3 模型运行的单个高效 ARC-AGI 消耗了 111 亿个代币, 成本核算 $66,772.3 鉴于这种规模,即使是小规模的操纵也可能造成巨大的财务影响。

“这种信息不对称使得人工智能公司可以向用户收取过高的费用,从而损害他们的利益。”

为了应对这种不对称,作者提出 硬币,这是一个第三方审计系统,旨在验证隐藏代币而不泄露其内容,并使用散列指纹和语义检查来发现通货膨胀的迹象。

不透明商业 LLM 的 CoIn 审计系统概述。面板 A 展示了如何将推理代币嵌入哈希到 Merkle 树中进行代币数量验证,且不泄露代币内容。面板 B 展示了语义有效性检查,其中轻量级神经网络将推理块与最终答案进行比较。这些组件共同作用,使第三方审计人员能够检测隐藏的代币通胀,同时保护专有模型行为的机密性。资料来源:https://arxiv.org/pdf/2505.13778

一个组件使用加密方式验证令牌计数 梅克尔树;另一个通过将隐藏内容与答案嵌入进行比较来评估其相关性。这使得审计人员能够检测到填充或不相关的内容——这些迹象表明,插入令牌只是为了抬高账单。

在测试部署中,CoIn 对某些形式的通货膨胀的检测成功率接近 95%,且底层数据暴露程度极低。尽管该系统仍然依赖于服务提供商的自愿合作,并且在极端情况下的解决方案有限,但其更广泛的意义是毋庸置疑的:当前 LLM 计费的架构本身就假设了一种无法验证的诚实性。

结语

除了从用户那里获得预付费的优势之外, 便条货币(例如 城市人工智能)有助于使用户脱离他们所消费货币或所购买商品的真实价值。同样,给予供应商自由定义其 自己的计量单位 进一步让消费者不清楚他们实际花了多少钱。

像 拉斯维加斯缺少时钟,此类措施通常旨在让消费者不计较成本或漠视成本。

鲜为人知的 象征可以用多种方式来消费和定义,但可能不是 LLM 消费的合适计量单位——尤其是因为它可以 花费更多代币 与英语课程相比,非英语课程的法学硕士 (LLM) 成绩较差。

然而,正如马克斯·普朗克研究人员所建议的那样,基于字符的输出可能会更倾向于使用更简洁的语言,并惩罚 自然冗长的语言由于诸如贬值的令牌计数器之类的视觉指示可能会让我们在法学硕士课程中更加挥霍,因此这种有用的 GUI 添加似乎不太可能很快出现——至少在没有立法行动的情况下。

* 作者的重点。我将作者的行内引用转换为超链接。

首次发布于 29 年 2025 月 XNUMX 日星期四