机器人

通过直接视觉控制无人机

中国的研究人员开发了一种新算法,可以通过直接解释用户的视觉来控制无人机的飞行。有效地,人类操作员“成为”无人机,并根据用户的凝视方向来引导其轨迹。

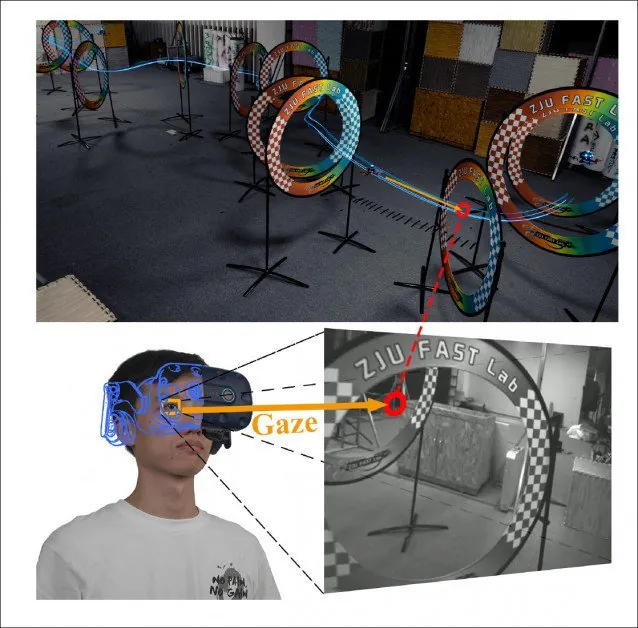

用户的视角出现在左下角,无人机的飞行路径由阴影设备外部捕获。请参阅文章末尾的视频以获取完整的动态画面。 来源:https://www.youtube.com/watch?v=WYujLePQwB8

该 论文 名为 GPA-Teleoperation: Gaze Enhanced Perception-aware Safe Assistive Aerial Teleoperation,来自浙江大学的控制科学与工程研究所和南京理工学院的自动化学院的研究人员。研究人员还发布了一段视频,展示了该系统的功能(请参阅文章末尾)。

超越抽象控制

研究人员旨在消除无人机控制的抽象层,认为次要控制单元需要培训,并且只能粗略地抽象出用户的意图,从而导致不可预测的机动和对指导运动的误解。

今年早些时候,同一研究人员发表的一篇论文强调了无人机导航中视线可见性的重要性,而当前的工作是对该研究的发现的发展。

上图为无人机测试实验室的“障碍赛道”(请参阅文章末尾的视频以获取外部测试的自然开放环境)。下图,操作员佩戴眼动跟踪器,直接查看四轴飞行器的前置摄像头(右下)。 来源:https://arxiv.org/pdf/2109.04907.pdf

算法

GPA 使用后端优化器来精化用户的凝视,基本上相当于视频游戏中的“自动瞄准”,延迟几乎为零。

无人机子系统模块直接安装在无人机上,包括状态估计、规划、映射和控制模块。局部系统从用户佩戴的眼动跟踪器中接收眼动数据,提供初始拓扑路径,该系统必须实时清理。

为了为远程控制器创建一个连贯的体验,用户接收到的单色视图由无人机系统自动居中,因为如果没有这一点,很难解释新的预期路线偏差(如凝视方向的变化所示)。

系统首先从图像流中解析估计的向量坐标。由于研究人员系统的视频输入目前是单目摄像头,使用摄像头的深度感知边界来获得第二个(深度)向量,该向量被叠加到从图像中推导出的 2D 向量上。理论上,后期迭代可以使用立体摄像头来改进这一流程,尽管还需要确定是否会保留基于硬件的 3D 感知的好处。

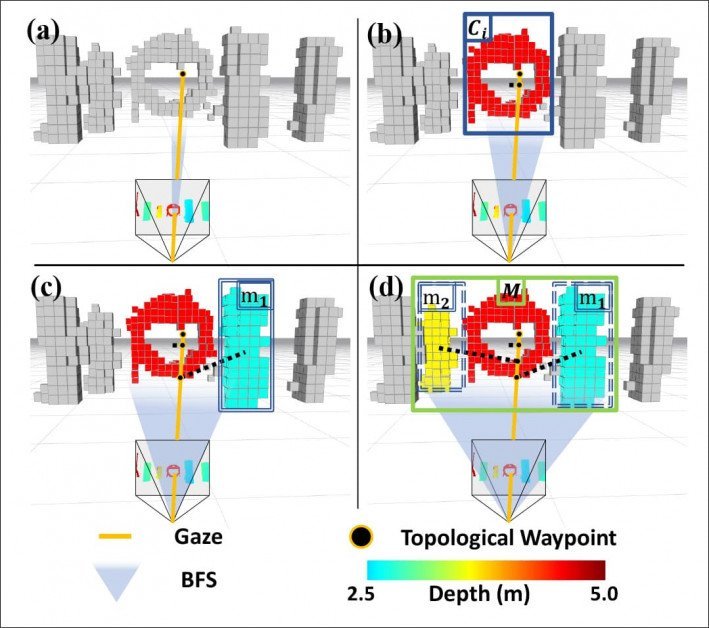

无论如何,有了 3D 值,计算被用作 广度优先搜索(BFS)的起点。BFS 中被排除的像素(即被识别为已经在界限内的像素)被用作 DBSCAN 聚类 的锚点(如果尚未聚类),然后从最后一个断点重新开始 BFS 评估。

GPA 的架构。

该过程迭代,直到在视野(FOV)参数对应的范围内识别和标记对象(在这种情况下,必须绝对清晰,以避免碰撞)。

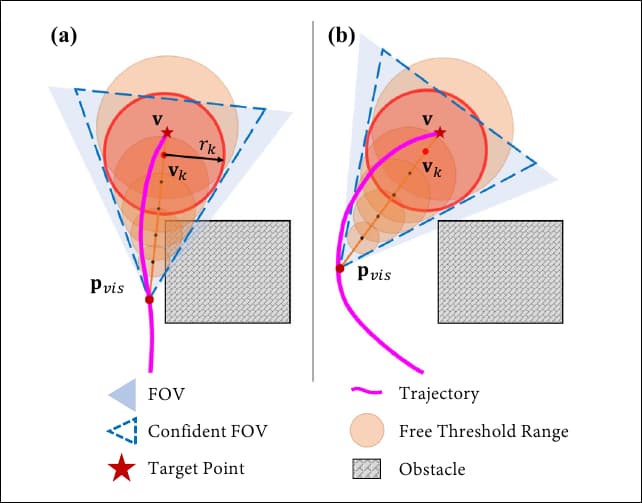

最后,向量计算被用来生成清晰的路径,或者验证用户的凝视方向已经是一个安全的路径,通过或过去障碍物。

系统忽略可见性(左)和系统重新计算轨迹以考虑可见性至关重要的飞行路径(右)。

测试

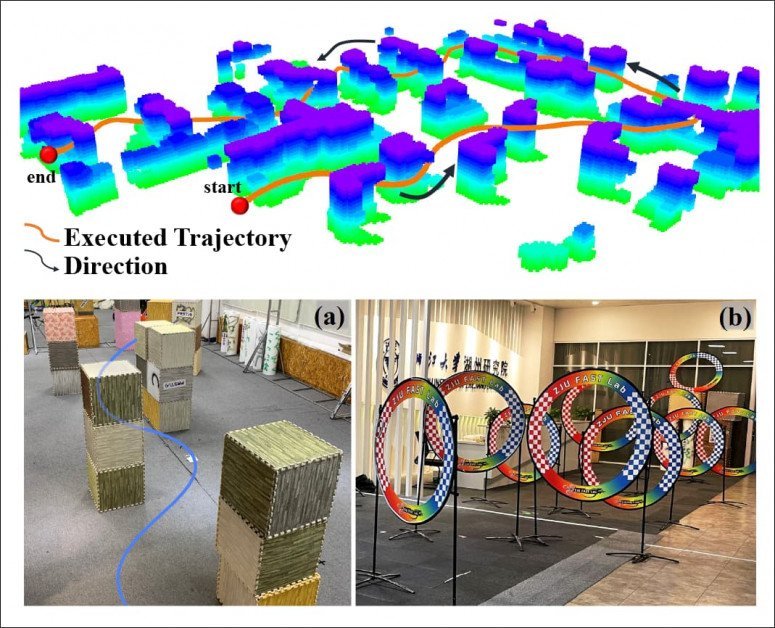

为了测试基于凝视的无人机控制系统,中国研究人员使用了一组对该系统没有任何了解且没有无人机飞行控制经验的志愿者。受试者被要求仅使用三个简短的定向程序来熟悉系统的基本操作,就在封闭和外部环境中导航障碍课程。

此外,在简要介绍了障碍的基本拓扑后,研究人员添加了“惊喜障碍”,这些障碍没有包含在简报中。

上图为在线四轴飞行器的轨迹,按高度着色。下图为可导航的障碍,从盒子开始,然后是环形。

在实践中,该系统能够有效地纠正凝视数据,因此使用的空间关键无人机能够在不碰撞的情况下通过(或穿过)环形和盒形障碍,研究人员得出结论:他们的系统既直观又安全,在操作中具有很高的安全裕度。

研究人员还将他们的方法与 Mavic Air 2 系统中的 FocusTrack 架构进行了比较,得出结论:他们的方法更胜一筹,因为它能够衡量和执行精确的用户意图。

眼动跟踪技术在自动驾驶汽车数据采集、机器学习基于 SDV 系统等领域得到了广泛的研究,也在研究飞行员的注意力模式等领域得到了应用。在今年的 7 月,保加利亚的一支研究团队 发表 了关于无人机飞行员的观察结果,发现飞行的着陆阶段是新手学习者最具挑战性的阶段。

请查看研究人员的官方视频,网址如下。

https://www.youtube.com/watch?v=WYujLePQwB8