公告

Cerebras 推出 Qwen3-235B:AI 速度、规模和成本的新时代

Cerebras系统 已正式启动 Qwen3-235B,一款尖端的 AI 模型,全面支持 131,000 个 token 上下文,为推理、代码生成和企业级 AI 应用的性能树立了新的标杆。该模型现已通过 Cerebras 推理云提供,其功能可与最先进的前沿系统相媲美,同时运行速度是当今领先的闭源模型的 30 倍,成本仅为其十分之一。

实时AI推理速度突破

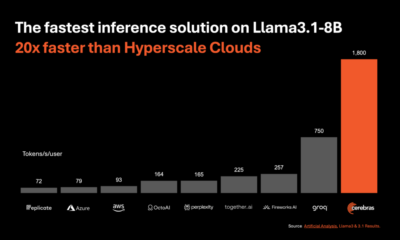

人工智能推理速度历来缓慢,大型模型通常需要一分钟或更长时间才能响应复杂的查询。Cerebras 消除了这一瓶颈。其专有的 晶圆级引擎 3 (WSE‑3),Qwen3-235B 实现 每秒 1,500 个令牌,创造了前沿人工智能推理的世界纪录。

这种性能水平彻底改变了用户体验——即使在处理高级推理任务或运行检索增强生成 (RAG) 等多步骤工作流程时,延迟也从 60-120 秒缩短至仅 0.6 秒。根据 Artificial Analysis 的基准测试结果,目前没有任何其他提供商(无论是开放的还是封闭的)能够匹敌这种前沿级模型的推理速度。

上下文中的新标准:用于实际应用的 131K 代币

与此版本同步,Cerebras 将其模型上下文窗口从 32K 扩展到 Qwen131-3B 支持的完整 235K 个 token。上下文大小的飞跃使模型能够提取和推理海量数据——涵盖完整的代码库、多文档存储库和长篇技术资料。

32K 上下文支持基本的生成任务,而 131K 上下文则开启了生产级开发的大门。AI 现在可以充当深度代码协作者,实时合成数十个文件并管理复杂的依赖关系,使其成为软件工程、文档分析和科学计算等企业用例的理想选择。

Cerebras 为何与众不同:专为 AI 设计的硬件

Cerebras Systems 由一支由先锋计算机架构师、AI 研究人员和系统工程师组成的团队创立,他们采取了一种截然不同的方法来解决生成式 AI 扩展的挑战。Cerebras 并未依赖 GPU 集群,而是围绕其自主研发的芯片 Wafer-Scale Engine 3 构建了一台专用的 AI 超级计算机。

这款芯片与业内其他芯片截然不同。它只有餐盘大小,却搭载了数十万个 AI 优化核心,以及数十 GB 的片上内存。这种设计允许计算和内存并排放置,从而消除了传统多 GPU 解决方案的延迟、带宽限制和编排复杂性。

通过聚类 CS-3 系统Cerebras 可以轻松创建能够运行万亿参数模型的 AI 超级计算机,同时避免分布式计算的技术负担。这种统一的方法是其创纪录推理速度的基础,也是全新高语境能力的赋能者。

MoE 效率显著降低成本

Qwen3‑235B 采用 混合专家 (MoE) 架构——一种根据输入仅激活一部分内部专家的模型设计,从而大大提高计算效率。

正因如此,Cerebras 能够以远低于闭源替代方案的价格提供该模型。具体来说,推理成本为每百万输入令牌 0.60 美元,每百万输出令牌 1.20 美元,与 OpenAI、Anthropic 或 Google 的专有模型相比,成本降低了 90% 以上。

与 VS Code 中的 Cline 无缝集成

为了展示 Qwen3‑235B 的速度和实际应用,Cerebras 与 克莱因,Microsoft Visual Studio Code 中领先的代理编码代理,目前已有超过 1.8 万开发人员安装。

Cline 用户目前已可以使用免费套餐中的 Qwen3-32B 及其 64K 上下文。随着今天的公告发布,支持范围将扩展至 Qwen3-235B 及其完整的 131K 上下文,从而实现此前无法实时实现的编辑器内推理和代码生成水平。

萨乌德·里兹万Cline 首席执行官解释道,“借助 Cerebras 的推理能力,使用 Cline 的开发者得以一窥未来,因为 Cline 能够近乎实时地推理问题、读取代码库并编写代码。一切都发生得如此之快,以至于开发者能够保持流畅,以思维的速度进行迭代。这种快速推理不仅仅是锦上添花——它向我们展示了当 AI 真正与开发者保持同步时,未来的可能性。

封闭模式的开放替代方案

经独立基准测试验证,Qwen3‑235B 的性能与当今市场上一些最复杂的 AI 模型相当,包括 Claude 4 Sonnet、Gemini 2.5 Flash 和 DeepSeek R1。此外,Cerebras 以开放访问的形式提供 QwenXNUMX‑XNUMXB,从而提供了封闭模型所缺乏的透明度和可移植性。

这种开放模式使企业能够:

- 定制和微调专有数据

- 在私有基础设施或混合云环境中部署人工智能

- 避免供应商锁定和数据隐私风险

结合 Cerebras 的可扩展云平台和 CS-3 系统的可选内部部署,组织可以完全控制如何将 AI 应用于关键任务。

这对行业意味着什么

Qwen3-235B 的推出标志着一个转折点。Cerebras 将前沿智能与前所未有的速度和成本效率相结合,重新定义了大型语言模型的极限。

现在可以构建以下 AI 工具:

- 实时响应开发者的查询

- 推理胜过完整的文档或知识库

- 在 IDE 中实时生成和调试生产级代码

- 扩展到企业用例,无需 GPU 扩张或每月六位数的推理费用

随着对 AI 基础设施的需求不断增长,Cerebras 证明了您无需在性能、价格和开放性之间做出妥协。从晶圆级引擎到 Cerebras 推理云,其软硬件协同设计指向了一种全新的 AI 部署模式——更快、更简单、更易于访问。

最后的想法

通过发布具有 3K 上下文、超快速推理和实惠代币定价的 Qwen235‑131B, Cerebras系统 已将自己定位为 GPU 驱动的现有 AI 领域仅有的真正挑战者之一。对于企业、研究人员和开发者而言,此次发布不仅仅是一个更快的模型,更是一个转折点,让实时、生产级、开放的 AI 触手可及。