人工智能

人工智能模型在基本读钟方面表现不佳,而人类则表现出色

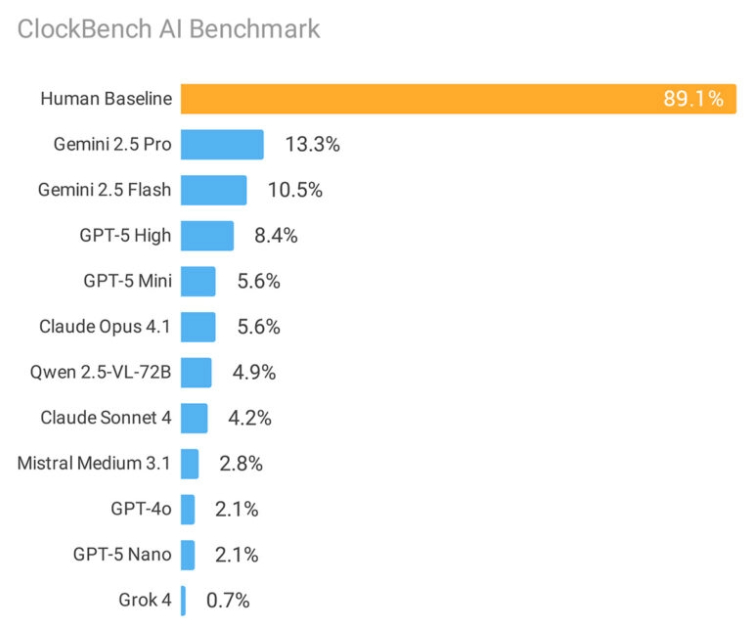

A 综合学习 一项针对 11 个领先 AI 模型与人类在读模拟时钟方面的测试,揭示了当前人工智能系统的一个惊人弱点。人类读时准确率高达 89.1%,而谷歌表现最佳的模型在同一测试中的准确率仅为 13.3%。

研究员 Alek Safar 开展的 ClockBench 研究表明,即使是最先进的人工智能系统,在处理大多数人从小就掌握的视觉任务时也举步维艰。谷歌的基准测试系统 OpenAI, 人类的以及其他主要 AI 实验室使用了 180 个定制设计的模拟时钟。

这超越了时钟本身。研究结果凸显了人工智能系统处理和推理视觉信息方面的根本局限性。Safar 在研究论文中指出:“读取模拟时钟为在视觉空间内进行推理设定了很高的标准。” 这项任务要求模型识别时钟指针,理解它们之间的关系,并将视觉定位转化为数字时间。

在检查错误模式时,性能差距变得更加显著。当人类犯错时,平均误差仅为三分钟。相比之下,人工智能模型的误差则高达一到三个小时——大致相当于在12小时制时钟上随机猜测。

暴露的具体弱点

人工智能系统尤其面临以下挑战:

- 罗马数字(准确率为 3.2%)

- 镜像或反向的钟面

- 色彩丰富的背景或复杂的设计

- 需要精确读数的带有秒针的时钟

有趣的是,当AI模型成功读取时钟时,它们在后续任务(例如添加时间或转换时区)上也表现良好。这表明核心挑战在于最初的视觉识别,而非数学推理。

行业表现细分

谷歌的模型领先, 双子座2.5专业版 准确率达到 13.3%,Gemini 2.5 Flash 达到 10.5%。 OpenAI的GPT-5 得分为 8.4%,而 Anthropic 的 克劳德 模型表现较低,Claude 4 Sonnet 为 4.2%,Claude 4.1 Opus 为 5.6%。

xAI 的 Grok 4 的准确率出人意料地低,仅为 0.7%,但这是因为该模型错误地将 63% 的时钟标记为显示不可能的时间,而实际上只有 20.6% 的时钟显示不可能的时间。

资料来源:Alek Safar

对人工智能发展的更广泛影响

这项研究建立在 ARC-AGI 等测试中常见的“对人类来说很容易,对人工智能来说很难”的基准方法之上, 简单基准测试虽然人工智能系统已经迅速征服了知识密集型任务,甚至在许多标准化测试中超越了人类的表现,但基本的视觉推理仍然存在问题。

研究表明,当前的扩展方法可能无法解决视觉推理的挑战。Safar 假设,模拟时钟在训练数据中的代表性可能不足,而将视觉时钟表征转换为文本进行推理会带来额外的复杂性。

ClockBench 加入了日益壮大的基准测试集合,旨在识别传统测试中无法立即显现的 AI 局限性。完整的数据集将保持私密,以防止影响未来的 AI 训练,仅会公开少量样本进行测试。

研究结果引发了一些问题:现有的人工智能开发范式是否能够解决这些视觉推理差距,或者是否需要全新的方法——类似于测试时计算如何解锁其他领域的进步。

目前,不起眼的模拟时钟出人意料地成为了对抗人工智能的堡垒,几乎任何人都可以读取,但却让世界上最复杂的人工智能系统感到困惑。