Yapay Zekâ

Neden Üretken Video Sistemleri Tam Uzun Metrajlı Filmler Yapamaz?

Üretken AI video’nun ortaya çıkışı ve ilerlemesi, birçok casual gözlemcinin tahmin etmesine neden oldu. makine öğrenimi, sinema endüstrisinin ölümünü kanıtlayacak – bunun yerine, tek yaratıcılar, yerel veya bulut tabanlı GPU sistemlerinde Hollywood tarzı blockbuster’lar yaratabilecekler.

Bu mümkün mü? Eğer mümkün ise, birçok kişi tarafından düşünüldüğü gibi yakın mı?

Bireylerin, tutarlı karakterler, anlatı sürekliliği ve toplam foto gerçekçiliği ile, bizim tanıdığımız şekliyle filmler yaratmasının mümkün olması – ve belki de kaçınılmaz olması.

Ancak, Latent Diffusion Models tabanlı video sistemleri ile bu olasılığın gerçekleşmesi için birkaç temel neden var.

Bu son nokta önemli çünkü, şu anda, bu kategori her popüler metin-video (T2) ve resim-video (I2V) sistemini içeriyor, včetně Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (ve, elimizden geldiğince anladığımız kadarıyla, Adobe Firefly’in gelecek video işlevselliği); çoğu diğer arasında.

Burada, gerçek auteur tam uzun metrajlı gen-AI yapımlarının, bireyler tarafından yaratıldığı, tutarlı karakterler, sinematografi ve görsel efektler ile, şu anda Hollywood’un sahip olduğu durumun en azından aynı seviyede olduğu prospektiflerini düşünüyoruz.

Şimdi, bu zorlukların en büyük pratik engelini inceleyelim.

1: Doğru Bir İzleme Çekintisi Yapamazsınız

Anlatı tutarlılığı, bu engellerin en büyüğü. Gerçek şu ki, şu anda mevcut hiçbir video üretim sistemi真正 bir ‘izleme’ çekintisi yapamaz*.

Bu, gürültü azaltma difüzyon modeli nin temelinde yatan ilke, rastgele gürültü ye dayanması ve bu temel ilkenin aynı içeriği iki kez yorumlamaya (yani, farklı açılardan veya önceki çekimi geliştirerek bir izleme çekintisi oluşturarak) elverişli olmamasıdır.

Metin.prompt’ları kullanıldığında, yalnız veya yüklü ‘tohum’ resimleri (çoğul modal girdi) ile birlikte, token ler,prompt’tan elde edilir ve gizli uzay dan semantik olarak uygun içeriği sağlar.

Ancak, ‘rastgele gürültü’ faktöründen daha da engellenen, aynı şekilde iki kez bunu yapmayacak.

Bu, video’daki karakterlerin kimliklerinin değişmesine, nesnelerin ve çevrelerin ilk çekim ile eşleşmemesine neden olur.

Bu, neden viral kliplerin, olağanüstü görselleri ve Hollywood düzeyinde çıktıları gösteren, ancak her çekim farklı karakterler ve çevreler gösteren ‘gösteri montajı’ olduğunu açıklar.

Marco van Hylckama Vlieg’den üretilen AI montajından alıntılar – kaynak: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Bu tür video üretimlerinin (ticari sistemlerin durumunda belki de dürüst olmayan) altındaki sistemlerin gerçekten sürekli ve tutarlı anlatılar yaratabileceği izlenimini verir.

Burada kullanılan analoji, bir film fragmanıdır, filmdeki bir veya iki dakika süren görüntüleri gösterir, ancak izleyiciye tüm filmin mevcut olduğu izlenimini verir.

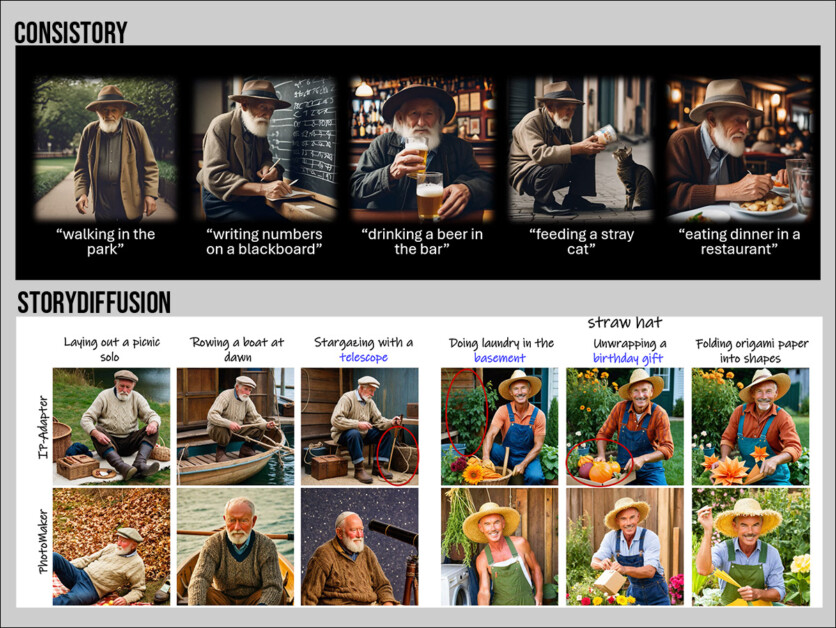

Şu anda, sadece still resimler üreten ve tutarlı anlatıları sunan sistemler mevcut. Bunlar, NVIDIA’nın ConsiStory ve bilimsel literatürdeki çeşitli projeleri içerir, örneğin TheaterGen, DreamStory ve StoryDiffusion.

Son modellerden ‘statik’ anlatı tutarlılığı örnekleri:: Kaynaklar: https://research.nvidia.com/labs/par/consistry/ ve https://arxiv.org/pdf/2405.01434

Teoride, bu tür sistemlerin daha iyi bir versiyonunu kullanarak, bir dizi resim-çekim oluşturup, bunları bir diziye bağlayabilirsiniz.

Şu anda, bu yaklaşım, inandırıcı bir izleme çekintisi oluşturmaz ve zaten auteur hayalinden, karmaşıklık ekleyerek uzaklaşıyoruz.

Ayrıca, Low Rank Adaptation (LoRA) modellerini, karakter, nesne veya çevre için özel olarak eğiterek, çekimlerde tutarlılığı sağlayabiliriz.

Ancak, bir karakterin yeni bir kostüm giymesini istiyorsanız, genellikle karakteri bu kostümle giydirilmiş olarak gösteren yeni bir LoRA eğitmeniz gerekir (alt kavramlar gibi ‘kırmızı elbise’ gibi kavramlar, bireysel LoRA’lara entren edilebilir, ancak her zaman kolay çalış不).

Bu, bir film açılış sahnesinde, bir kişinin yataktan kalkması, bir sabahlık giymesi, esnemesi, yatak odası penceresine bakması ve dişlerini fırçalamak için banyoya gitmesi gibi bir sahneyi yaratmak için önemli bir karmaşıklık ekler.

Bu sahne, yaklaşık 4-8 çekimden oluşabilir ve geleneksel film yapım prosedürleri ile bir sabah içinde çekilebilir; ancak şu anda üretilen AI ile, bu, haftalarca çalışma, çoklu eğitilmiş LoRA’lar (veya diğer yardımcı sistemler) ve önemli miktarda post-prodüksiyon gerektirecektir.

Alternatif olarak, video-çevrimiçi kullanılabilir, burada sıradan veya CGI çekimleri, metin-prompt’ları ile alternatif yorumlara dönüştürülür. Runway böyle bir sistem sunar, örneğin.

CGI (solda) Blender’dan, Mathieu Visnjevec tarafından yapılan bir Runway video-çevrimiçi deneyinde yorumlandı – Kaynak: https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Burada iki sorun vardır: çekimlerin çekilmesi için zaten filmi iki kez yapmanız gerekir, hatta sentetik bir sistem gibi UnReal’in MetaHuman kullanıyorsanız bile.

Eğer CGI modeller (yukarıdaki klipte olduğu gibi) oluşturup, bunları video-resim dönüşümünde kullanırsanız, çekimlerdeki tutarlılıkları garanti edemezsiniz.

Bu, video difüzyon modellerinin ‘büyük resmi’ görememesi, yalnızca önceki çerçeveden veya bazı durumlarda yakın gelecek çerçevesinden yeni bir çerçeve oluşturması ve bazı durumlarda yakın gelecek çerçevesini dikkate almasıdır; ancak, bir satranç oyununa benzer şekilde, ‘on adım ilerisini’ düşünemez ve ‘on adım gerisini’ hatırlayamaz.

İkinci olarak, bir difüzyon modeli, karakter, çevre ve aydınlatma stilinin LoRA’larını dahil etse bile, çekimlerde tutarlı bir görünüm sağlamak için mücadele edecektir; çünkü yukarıda belirtilen nedenlerle.

2: Bir Çekimi Kolayca Düzenleyemezsiniz

Eğer geleneksel CGI yöntemleriyle bir karakterin sokakta yürümesini gösterirseniz ve çekimin bir yönünü değiştirmek istiyorsanız, modeli ayarlayıp yeniden render edebilirsiniz.

Eğer gerçek bir çekim ise, sadece sıfırlar ve değişikliklerle yeniden çekersiniz.

Ancak, bir gen-AI video çekimi üretir ve onu seversiniz, ancak bir yönünü değiştirmek istiyorsanız, bunu ancak 30-40 yıl önce geliştirilen zahmetli post-prodüksiyon yöntemleriyle gerçekleştirebilirsiniz: CGI, rotoskopi, modelleme ve matting – hepsi emek yoğun ve pahalı, zaman alan prosedürler.

Difüzyon modellerinin çalışma şekli, bir metin-prompt’ının (hatta çoklu modal prompt’ta bir kaynak tohum resmi sağlarsanız bile) yalnızca bir yönünü değiştirmesi, üretilen çıktının çoklu yönlerini değiştirecektir; bu, bir ‘whack-a-mole’ oyununa dönüşür.

3: Fizik Yasalarına Güvenemezsiniz

Geleneksel CGI yöntemleri, akışkan dinamiği, gaz hareketi, ters kinematik (insan hareketinin doğru modellemesi), kumaş dinamiği, patlamalar ve çeşitli diğer gerçek dünya olaylarını simüle edebilen algoritmik fizik tabanlı modeller sunar.

Ancak, difüzyon tabanlı yöntemler, kısa bir hafızaya sahiptir ve sınırlı bir hareket önceliği (eğitim veri kümesinde bulunan eylemler) sahiptir.

OpenAI’nin eski bir sürümünde, şirket bu konuda sınırlamaları kabul etti (ancak bu metin daha sonra kaldırıldı):

‘[Sora] karmaşık bir sahnenin fiziksel simülasyonunda zorluk çekebilir ve neden-sonuç ilişkilerini comprend edemeyebilir (örneğin, bir karakter bir kurabiye ısırdığında, kurabiyede bir iz olmayabilir).

‘Model, ayrıca, bir prompt’ta belirtilen mekansal ayrıntıları karıştırabilir, soldan sağa ayırt edemeyebilir veya zaman içinde gelişen olayların precisa açıklamalarını理解 edemeyebilir.’

Pratik olarak, çeşitli API tabanlı üretken video sistemlerinin kullanımı, fiziksel olayların doğru bir şekilde betimlenmesinde benzer sınırlamaları ortaya koyar. Ancak, patlamalar gibi bazı ortak fiziksel olaylar, eğitim veri kümelerinde daha iyi temsil edilmektedir.

Bazı hareket önceliği gömme, ya modelin içine eğitilir ya da bir kaynak videosundan beslenir, ancak tamamlanması zaman alabilir (örneğin, bir kişinin karmaşık ve tekrarlamayan bir dans dizisini bir süslü kostümle gerçekleştirmesi) ve difüzyon modelinin dar attention penceresi, içeriği (yüz kimliği, kostüm ayrıntıları vb.) değiştirecektir.

Ancak, LoRA’lar bu sorunu bir ölçüde hafifletebilir.

Post-Prodüksiyonda Düzeltme

Saf ‘tek kullanıcı’ AI video üretiminin diğer eksiklikleri, hızlı hareketlerin betimlenmesindeki zorluk ve genel olarak daha önemli bir problem olan zamanlı tutarlılık elde etme zorluğu.

Ayrıca, belirli yüz performansları ve diyalog için lip-sync oluşturmak oldukça şans işi.

Her iki durumda da, yardımcı sistemlerin kullanımı, örneğin LivePortrait ve AnimateDiff, VFX topluluğu arasında popülerlik kazanmaktadır, çünkü bu, en azından geniş yüz ifadeleri ve lip-sync’i mevcut üretilen çıktıya aktarmaya izin verir.

Bir ifade aktarımının (alt solda bulunan sürücü videosu) bir hedef videoya LivePortrait ile uygulanması örneği. Video, Generative Z TunisiaGenerative’den. Daha iyi kalitede tam uzunlukta versiyonu https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/? adresinde bulunabilir

Ayrıca, çeşitli karmaşık çözümler, ComfyUI gibi Stable Diffusion GUI ve profesyonel kompozit ve manipülasyon uygulaması Nuke gibi araçları içerir ve ayrıca gizli uzay manipülasyonu, AI VFX uygulayıcılarının yüz ifadesi ve tutum üzerinde daha büyük kontrol kazanmasına izin verir.

VFX profesyoneli Francisco Contreras, yüz animasyonunu ComfyUI’de ‘işkence’ olarak tanımlasa da, bir prosedür geliştirdi, bu da lip fonemleri ve diğer yüz/baş betimlemeleri uygulamaya izin verir.

Stable Diffusion, Nuke ile güçlendirilmiş bir ComfyUI iş akışıyla, VFX profesyoneli Francisco Contreras’ın yüz özellikleri üzerinde alışılmadık bir kontrolü sağladı. Tam video, daha iyi çözünürlükte https://www.linkedin.com/posts/7243056650012495872/ adresinde bulunabilir

Sonuç

Hiçbiri, tutarlı ve foto gerçekçi, blockbuster tarzı tam uzun metrajlı filmler yaratma olasılığı için umut verici değil, gerçekçi diyalog, lip-sync, performanslar, çevreler ve tutarlılık ile.

Ayrıca, bu engeller, özellikle difüzyon tabanlı üretken video modelleri ile ilgili olarak, ‘her an’ çözülebilecek gibi görünmüyor, forum yorumları ve medya ilgisine rağmen.

AI sentez araştırmalarında, bilimsel araştırmaların tümünde olduğu gibi, parlak fikirlerimiz bazen potansiyelleri ile bizi şaşkına uğratır, ancak daha fazla araştırma, onların temel sınırlamalarını ortaya koyar.

Üretken/sentez alanında, bu zaten Generative Adversarial Networks (GANs) ve Neural Radiance Fields (NeRF) ile oldu, her ikisi de sonunda çok zor ticari sistemlere dönüştürülmüş, yıllarca akademik araştırma rağmen. Bu teknolojiler şimdi, alternatif mimarilerdeki yardımcı bileşenler olarak ortaya çıkıyor.

Tıpkı film stüdyolarının, lisanslı film kataloglarından eğitim yaparak VFX sanatçılarını ortadan kaldırabileceğini umması gibi, AI aslında ek roller ekliyor.

Difüzyon tabanlı video sistemlerinin, gerçekten anlatı tutarlı ve foto gerçekçi film üreticilerine dönüştürülebileceği veya tüm işin sadece başka bir alkimik takip olduğu, önümüzdeki 12 ay içinde belli olacak.

Belki de tamamen yeni bir yaklaşıma ihtiyacımız var; veya belki de Gaussian Splatting (GSplat), 1990’ların başlarında geliştirilen ve yakın zamanda image synthesis alanında popülerlik kazanan, difüzyon tabanlı video üretimine bir alternatif olabilir.

GSplat’ın 34 yıl önce ortaya çıkması ve şimdi ön plana çıkması mogelijk, NeRF, GANs ve hatta latent difüzyon modelleri gibi eski rakiplerin henüz günlerini görmemiş olabileceğini gösteriyor.

* Kaiber’in AI Storyboard özelliği bu tür işlevselliği sunar, ancak gördüğüm sonuçlar üretim kalitesinde değil.

Martin Anderson, metaphysic.ai’nin eski bilimsel araştırma içeriği başkanı

İlk olarak 23 Eylül 2024’te yayınlandı