Anderson’un Açısı

AI Video Oluşturma’da Toplam Kontrol Yönünde

Video temel modelleri gibi Hunyuan ve Wan 2.1, güçlü olsalar da, film ve TV prodüksiyonu (özellikle VFX prodüksiyonu) tarafından talep edilen türden ayrıntılı kontrolleri kullanıcılarına sunmazlar.

Profesyonel görsel efekt stüdyolarında, bu gibi açık kaynaklı modeller, daha önce Stable Diffusion, Kandinsky ve Flux gibi görüntü tabanlı (video tabanlı değil) modellerle birlikte, spesifik yaratıcı ihtiyaçları karşılamak için ham çıkışlarını uyarlayacak bir dizi destek aracı ile birlikte kullanılır. Bir yönetmen, “Harika görünüyor, ama bunu biraz daha [n] yapabilir miyiz?” dediğinde, modelin bu tür talepleri karşılayacak kadar kesin olmadığını söyleyemezsiniz.

Bunun yerine, bir AI VFX ekibi, video sentezinin sınırlarını biraz daha ileriye taşımak için geleneksel CGI ve kompozisyon teknikleri ile zaman içinde geliştirilen özel prosedürler ve iş akışlarını, geleneksel tekniklerle birleştirir.

Bu nedenle, bir temel video modeli, bir web tarayıcısı gibi Chrome’un varsayılan kurulumuna benzer; kutudan çıktığında çok şey yapabilir, ancak ihtiyaçlarınıza uyarlamak istiyorsanız, bunun için bazı eklentilere ihtiyacınız olacaktır.

Kontrol manyakları

Diffüzyon tabanlı görüntü sentezinin dünyasında, bu tür üçüncü taraf sistemlerin en önemlisi ControlNetdir.

ControlNet, difüzyon tabanlı generatif modellere yapılandırılmış kontrol eklemek için bir tekniktir ve kullanıcıların kenar haritaları, derinlik haritaları veya pozisyon bilgileri gibi ek girdilerle görüntü veya video oluşturmasını sağlar.

görüntü (üst satır), anlamsal segmentasyon>görüntü (alt sol) ve insan ve hayvanların poz güdümlü görüntü oluşturmasını sağlar (alt sol).” width=”779″ height=”422″ /> ControlNet’in çeşitli yöntemleri, derinlik>görüntü (üst satır), anlamsal segmentasyon>görüntü (alt sol) ve insan ve hayvanların poz güdümlü görüntü oluşturmasını sağlar (alt sol).

Metin promtlarına yalnızca güvenmek yerine, ControlNet, bu koşullandırma sinyallerini işlerken temel modelin generatif yeteneklerini koruyan ayrı nöral ağ dalları veya adaptörler tanıtır.

Bu, kullanıcı spesifikasyonlarına daha yakından uyan ince ayarlı çıktılar sağlar ve özellikle precisa kompozisyon, yapı veya hareket kontrolü gereken uygulamalarda özellikle yararlıdır:

Bir rehber poz ile, ControlNet aracılığıyla çeşitli doğru çıktı tipleri elde edilebilir. Kaynak: https://arxiv.org/pdf/2302.05543

Ancak, bu tür adaptör tabanlı çerçeveler, çok içe dönük olan bir dizi nöral işlem üzerinde dışarıdan çalışır. Bu yaklaşımlar beberapa dezavantajlara sahiptir.

İlk olarak, adaptörler bağımsız olarak eğitilir, bu da dal çatışmaları oluşturur ve birden fazla adaptör birleştirildiğinde, bu durum generasyon kalitesinin bozulmasına neden olabilir.

İkincisi, parametre fazlalığı oluştururlar, bu da her adaptör için ek hesaplama ve bellek gerektirir, bu da ölçeklendirilmesi verimsiz hale getirir.

Üçüncüsü, esnekliklerine rağmen, adaptörler genellikle alt optimal sonuçlar üretir, bu da tam olarak çok koşullu generasyon için eğitilen modellere kıyasla daha az etkili olur.

İdeal olarak, ControlNet’in yetenekleri modelin içine yerleşik olarak eğitilmelidir, daha sonraki ve çok öngörülen yenilikler gibi video/ses sentezi veya yerel dudak senkronizasyonu gibi özellikler için modüler bir şekilde tasarlanmalıdır.

Şu anda, her ek işlev ya bir post-prodüksiyon görevi ya da navigasyon için işletilen temel modelin duyarlı ve sıkı bağlantılı ağırlıklarını geçmek zorunda olan bir yerel olmayan prosedürü temsil eder.

FullDiT

Bu çıkmaza, Çin’den yeni bir teklif gelir, bu teklif, ControlNet tarzı önlemlerin, eğitim zamanında bir generatif video modeline doğrudan entegre edildiği bir sistemi önerir, bunun yerine sonradan eklenmez.

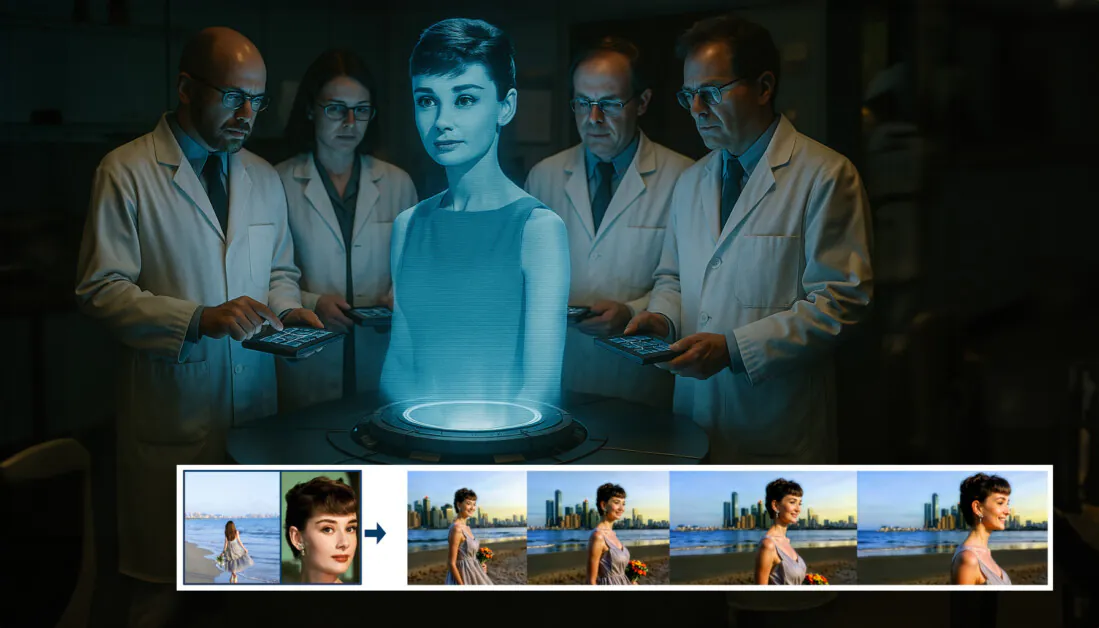

Yeni makaledeki FullDiT yaklaşımı, kimlik dayatması, derinlik ve kamera hareketini yerel bir oluşturma içine dahil edebilir ve aynı anda bunların herhangi bir kombinasyonunu çağırabilir. Kaynak: https://arxiv.org/pdf/2503.19907

FullDiT olarak adlandırılan bu yeni yaklaşım, kimlik transferi, derinlik eşlemesi ve kamera hareketi gibi çoklu görev koşullarını, eğitilen bir generatif video modelinin entegre bir parçası haline getirir ve yazarlar, bir prototip eğitilmiş model ve eşlik eden video klipleri ile bir proje sitesini üretmiştir.

Aşağıdaki örnekte, kamera hareketi, kimlik bilgileri ve metin bilgileri (yani, kullanıcı metin promtları) dahil olmak üzere oluşturmaları görüyoruz:

Oynatmak için tıklayın. Yalnızca yerel olarak eğitilmiş bir temel model ile ControlNet tarzı kullanıcı dayatması örnekleri. Kaynak: https://fulldit.github.io/

Ayrıca not edilmelidir ki, yazarlar, deneysel eğitilmiş modelini işlevsel bir temel model olarak önermezler, ancak yerel metin-veya-görüntüden-video (T2V ve I2V) modelleri için bir kavram kanıtı olarak önerirler ve yalnızca bir görüntü promtı veya metin promtından daha fazla kontrol sunan kullanıcılar için.

Henüz böyle modeller mevcut olmadığından, araştırmacılar, çoklu görev videolarının değerlendirilmesi için FullBench adlı yeni bir referans oluşturdular ve kendi tasarladıkları testlerde önceki yaklaşımlara kıyasla en iyi performansı iddia ettiler. Ancak, FullBench yazarlar tarafından tasarlandığından, nesnelliği test edilmemiştir ve 1.400 vaka içeren veri kümesi daha geniş sonuçlar için fazla olabilir.

Belki de makalenin önerdiği mimarinin en ilginç yönü, yeni tür kontrolleri dahil etme potansiyelidir. Yazarlar şöyle diyor:

‘Bu çalışmada, yalnızca kamera, kimlikler ve derinlik bilgisi kontrol koşullarını araştırıyoruz. Ses, konuşma, nokta bulutu, nesne sınırlama kutuları, optik akış gibi diğer koşulları ve modaliteleri daha fazla araştırmadık. FullDiT’nin tasarımı, minimal mimari değişiklik ile diğer modaliteleri sorunsuz bir şekilde entegre edebilir, ancak mevcut modelleri yeni koşullara ve modalitelere hızlı ve maliyet etkin bir şekilde nasıl uyarlayacağımız, hala daha keşfedilmesi gereken önemli bir sorudur.’

Yazarlar, FullDiT’yi, çoklu görev video oluşturması alanında bir adım olarak sunsalar da, bu yeni çalışma, aslında mevcut mimariler üzerine kuruludur.

Ancak, FullDiT şu anda, ‘sabitlenmiş’ ControlNet tarzı tesislere sahip bir video temel modeli olarak tek başına duruyor – ve gelecekteki yenilikleri de barındırabileceğini görmek güzel.

Oynatmak için tıklayın. Proje sitesinden kullanıcı kontrollü kamera hareketleri örnekleri.

Yeni makale FullDiT: Tam Dikkatle Çoklu Görev Video Oluşturma Temel Modeli olarak adlandırılmış ve Kuaishou Teknoloji ve Hong Kong Çin Üniversitesi’nden dokuz araştırmacı tarafından yapılmıştır. Proje sayfası burada ve yeni referans verisi Hugging Face’de bulunmaktadır.

Yöntem

Yazarlar, FullDiT’nin birleşik dikkat mekanizmasının, koşullar arasında hem uzaysal hem de zamansal ilişkileri yakalayarak, daha güçlü çapraz modalite temsili öğrenimi sağladığını iddia ediyorlar:

Yeni makaleye göre, FullDiT, tam self-dikkat aracılığıyla birden fazla girdi koşulunu birleştirir ve bunları birleşik bir diziye dönüştürür. Buna karşılık, adaptör tabanlı modeller (en soldaki), her girişin ayrı modüllerini kullanır, bu da fazlalığına, çatışmalara ve daha zayıf performansa yol açar.

Adaptör tabanlı kurulumların her girdi akışını ayrı olarak işlediğinin aksine, bu paylaşılan dikkat yapısı, dal çatışmalarını önler ve parametre yükünü azaltır. Ayrıca, mimarinin yeni girdi türlerini büyük bir yeniden tasarım olmadan ölçeklenebileceğini iddia ediyorlar.

Üçlü Güç

FullDiT, her kontrol sinyalini, tüm koşulların birlikte işlenebileceği birleşik bir token formatına dönüştürür. Kamera hareketi için, model, her kare için dışsal parametrelerin bir diziğini (örneğin, konum ve yön) kodlar. Bu parametreler zaman damgalı ve temporal niteliğini yansıtan gömme vektörlerine proje edilir.

Kimlik bilgileri, esasen uzaysal rather än zamansal olduğu için farklı bir şekilde ele alınır. Model, hangi karakterlerin her karenin hangi kısımlarında bulunduğunu gösteren kimlik haritalarını kullanır. Bu haritalar parçalara bölünür ve her parça, belirli varlıklarla belirli bölgeleri ilişkilendirmeyi sağlayan bir gömmeye projektlenir.

Derinlik, bir uzay-zamansal sinyaldir ve model, derinlik videolarını uzay ve zaman boyunca uzanan 3B parçalara ayırarak bunu işler. Bu parçalar, yapılarını kareler boyunca koruyan bir şekilde gömme edilir.

Bu tokenler birleştirildikten sonra, FullDiT, tam self-dikkat kullanarak birlikte işlenebilir.

Veri ve Testler

FullDiT’nin eğitim yaklaşımı, her koşul türü için özel olarak etiketlenmiş veri kümelerine dayanıyordu, chứ değil tüm koşulların aynı anda mevcut olması gerektiği.

Metinsel koşullar için, girişim, MiraData projesinde belirtilen yapılandırılmış altyazı yaklaşımını izledi.

MiraData projesinden video toplama ve anlama işleme hattı. Kaynak: https://arxiv.org/pdf/2407.06358

Kamera hareketi için, RealEstate10K veri kümesi, yüksek kaliteli yerleşik kamera parametreleri anotasyonları nedeniyle ana veri kaynağı olarak kullanıldı.

Ancak, yazarlar, yalnızca statik sahne kamera veri kümeleri gibi RealEstate10K ile eğitim yapmanın, oluşturulan videolarda dinamik nesne ve insan hareketlerini azaltabileceğini gözlemlediler. Bunu karşılamak için, daha dinamik kamera hareketleri içeren iç veri kümeleri kullanarak ek bir fine-tuning aşaması gerçekleştirdiler.

Kimlik anotasyonları, ConceptMaster projesi için geliştirilen işlem hattı kullanılarak oluşturuldu, bu da ince kimlik bilgilerinin verimli bir şekilde filtrelenmesini ve çıkarılmasını sağladı.

ConceptMaster çerçevesi, özdeşlikten ayrılma sorunlarını giderirken, özgün videolarda kavram bütünlüğünü korur. Kaynak: https://arxiv.org/pdf/2501.04698

Derinlik anotasyonları, Panda-70M veri kümesinden Derinlik Her Şey kullanılarak elde edildi.

Veri Düzenleme ile Optimizasyon

Yazarlar ayrıca, daha zorlu koşulları eğitim başlangıcında tanıtacak bir ilerici eğitim takvimi uyguladılar, böylece model, daha basit görevler eklendiğinde önce zor görevler için güçlü temsiller edinebildi. Eğitim sırası, metin koşullarından kamera koşullarına, ardından kimlik ve son olarak derinlik koşullarına geçti, daha kolay görevler genellikle daha az örneklerle daha geç tanıtılırdı.

Yazarlar, bu şekilde iş yükünü sıralamanın değerini vurguladılar:

‘Ön eğitim aşamasında, daha zorlu görevlerin daha uzun eğitim süresi gerektirdiğini ve öğrenme sürecinin başlangıcında tanıtılması gerektiğini gözlemledik. Bu zorlu görevler, çıktı videodan önemli ölçüde farklı olan karmaşık veri dağılımlarını içerir ve modelin bunları doğru bir şekilde yakalayabilmesi ve temsil edebilmesi için yeterli kapasiteye sahip olması gerekir.

‘Tersine, daha kolay görevleri çok erken tanıtmak, modelin bu görevleri öncelikli olarak öğrenmesine yol açabilir, çünkü bunlar daha hızlı optimizasyon geri bildirimi sağlar ve daha zorlu görevlerin yakınsamasını engelleyebilir.’

Araştırmacıların benimsediği veri eğitim sırasının bir illüstrasyonu, kırmızı daha büyük veri hacmini gösterir.

İlk ön eğitimden sonra, final fine-tuning aşaması, görsel kaliteyi ve hareket dinamiklerini daha da iyileştirdi. Eğitim, ardından standart bir difüzyon çerçevesinin eğitimini izledi: video latents’e gürültü eklendi ve model, gürültüyü tahmin etmek ve kaldırmak için, gömme koşul tokenlerini rehberlik olarak kullandı.

FullDiT’yi ve mevcut yöntemlerle adil bir karşılaştırma yapmayı etkili bir şekilde değerlendirmek için, yazarlar, 1.400 ayrı test vakasından oluşan bir dizi olan FullBench adlı yeni bir referans oluşturdular.

Yeni FullBench referansının veri gezgini örneği. Kaynak: https://huggingface.co/datasets/KwaiVGI/FullBench

Her veri noktası, çeşitli koşul sinyalleri için yerleşik anotasyonlar sağladı, bunlar arasında kamera hareketi, kimlik ve derinlik bulunuyordu.

Metrikler

Yazarlar, metin hizalama, kamera kontrolü, kimlik benzerliği, derinlik doğruluğu ve genel video kalitesi gibi beş ana performansı kapsayan on metrikle FullDiT’yi değerlendirdiler.

Metin hizalaması, CLIP benzerliği kullanılarak ölçüldü, kamera kontrolü ise rotasyon hatası (RotErr), tercüme hatası (TransErr) ve kamera hareketi tutarlılığı (CamMC) ile değerlendirildi, CamI2V (CameraCtrl projesinde) yaklaşımını izleyerek.

Kimlik benzerliği, DINO-I ve CLIP-I ile değerlendirildi ve derinlik kontrolü doğruluğu, Ortalama Mutlak Hata (MAE) ile ölçüldü.

Video kalitesi, MiraData’dan üç metrik ile değerlendirildi: pürüzsüzlük için kare düzeyinde CLIP benzerliği; dinamik için optik akış tabanlı hareket mesafesi; ve görsel çekicilik için LAION-Aesthetic puanları.

Eğitim

Yazarlar, FullDiT’yi, yaklaşık bir milyar parametreye sahip bir dahili (ifşa edilmeyen) metin-veya-görüntüden-video difüzyon modeli kullanarak eğittiler. Modest bir parametre boyutu seçtiler, böylece önceki yöntemlerle karşılaştırmalar adil ve yeniden üretilebilir olsun.

Eğitim videolarının uzunluğu ve çözünürlüğü farklıydı, bu nedenle yazarlar, her partiyi standardize etmek için videoları ortak bir çözünürlüğe yeniden boyutlandırdılar ve her diziden 77 kare örnekleme yaptı ve eğitim etkinliğini optimize etmek için uygulamaya dikkat ve kayıp maskeleri kullandı.

Adam optimizatörü, 1×10−5 öğrenme hızında kullanıldı, 64 NVIDIA H800 GPU’sinin bir kümesinde, toplam 5.120GB VRAM (hevesli sentez topluluklarında, RTX 3090’da 24GB hala lüks bir standart olarak kabul ediliyor) ile birlikte.

Model, yaklaşık 32.000 adımda eğitildi, her videosunda en fazla üç kimlik, 20 kare kamera koşulu ve 21 kare derinlik koşulu ile birlikte, her biri 77 kareden eşit olarak örneklendi.

Çıktı için, model 384×672 piksel çözünürlükte (yaklaşık beş saniye, 15 kare/saniye) 50 difüzyon çıkarım adımı ve beş sınıflandırıcıdan bağımsız rehberlik ölçeği ile videolar oluşturdu.

Önceki Yöntemler

Kamera-veya-video değerlendirmesi için, yazarlar FullDiT’yi MotionCtrl, CameraCtrl ve CamI2V ile karşılaştırdı, tüm modeller RealEstate10K veri kümesi kullanılarak eğitildi, böylece tutarlılık ve adillik sağlandı.

Kimlik koşullu oluşturmada, karşılaştırılabilir açık kaynaklı çoklu kimlik modelleri mevcut olmadığından, model 1B-parametreli ConceptMaster modeli ile test edildi, aynı eğitim verisi ve mimari kullanıldı.

Derinlik-veya-video görevleri için, Ctrl-Adapter ve ControlVideo ile karşılaştırmalar yapıldı.

Tekli görev video oluşturma için nicel sonuçlar. FullDiT, kamera-veya-video oluşturma için MotionCtrl, CameraCtrl ve CamI2V ile karşılaştırıldı; kimlik-veya-video için 1B-parametreli ConceptMaster; ve derinlik-veya-video için Ctrl-Adapter ve ControlVideo. Tüm modeller, varsayılan ayarlarıyla değerlendirildi. Tutarsızlık için, her yöntem 16 kare eşit olarak örneklendi, önceki modellerin çıktı uzunluğunu eşleştirdi.

Sonuçlar, FullDiT’nin, birden fazla koşul sinyalini aynı anda işlerken, metin, kamera hareketi, kimlik ve derinlik kontrolleri ile ilgili metriklere göre en iyi performansı sağladığını gösteriyor.

Genel kalite metriklerinde, sistem genellikle diğer yöntemleri aştı, ancak pürüzsüzlüğü ConceptMaster’dan biraz daha düşüktü. Yazarlar şöyle diyor:

‘FullDiT’nin pürüzsüzlüğü, ConceptMaster’dan biraz daha düşük çünkü pürüzsüzlük hesaplaması, bitişik kareler arasındaki CLIP benzerliğine dayanır. FullDiT, ConceptMaster’a kıyasla önemli ölçüde daha büyük dinamiklere sahiptir, bu nedenle pürüzsüzlük metriği, bitişik kareler arasındaki büyük varyasyonlardan etkilenir.

‘Görsel çekicilik puanı için, since ControlVideo genellikle resim-stil videolar üretebiliyor ve puanlama modeli resim-stil görüntülere önyargılı, ControlVideo yüksek bir puan elde ediyor.’

Nitel bir karşılaştırma için, FullDiT projesi sitesindeki örnek videolara başvurmak daha iyi olabilir, çünkü PDF örnekleri kaçınılmaz olarak statiktir (ve burada tamamen yeniden üretmek için çok büyüktür).

PDF’deki nitel sonuçların ilk bölümü. Ek örnekler için lütfen kaynak makaleye başvurun, bunlar burada tamamen yeniden üretmek için çok geniştir.

Yazarlar şöyle diyor:

‘FullDiT, kimlik korunumu ve video oluşturma kalitesi açısından ConceptMaster’a göre daha iyi performans gösterir. Bu, aynı temel model üzerinde eğitildikleri için, koşullandırma enjeksiyonunun tam dikkat ile etkinliğini vurgular.

‘…Diğer sonuçlar, FullDiT’nin, mevcut derinlik-veya-video ve kamera-veya-video yöntemlerine kıyasla daha iyi kontrollü ve daha yüksek kaliteli video oluşturma yeteneğini gösterir.’

PDF’deki FullDiT’nin birden fazla sinyalle çıktı örneklerinin bir bölümü. Ek örnekler için lütfen kaynak makaleye ve proje sitesine başvurun.

Sonuç

FullDiT, daha full-featured bir video temel modeli türüne doğru heyecan verici bir adımdır, ancak kontrol benzeri araçlara olan talebin, özellikle FOSS projeleri için, bu tür özelliklerin büyük ölçekte uygulanmasını haklı çıkarıp çıkarlamayacağı merak konusudur.

Birincil zorluk, sistemlerin genellikle ControlNet ve Poz gibi sistemlerin kullanımını gerektirmesidir, bu da ComfyUI gibi nispeten karmaşık kullanıcı arayüzleri ile çalışmayı gerektirir. Bu nedenle, bu tür bir işlevsel FOSS modelinin geliştirilmesi muhtemelen, büyük ticari şirketlerin aksine, daha küçük VFX şirketleri tarafından gerçekleştirilecektir.

Öte yandan, API tabanlı ‘kiralık-AI’ sistemleri, modellere doğrudan entegre edilmiş yardımcı kontrol sistemleri için daha basit ve daha kullanıcı dostu yorumlama yöntemleri geliştirmek için motive olabilirler.

Oynatmak için tıklayın. Derinlik+Metin kontrolleri, FullDiT kullanarak video oluşturması.

* Yazarlar, bilinen bir temel modeli (örneğin, SDXL vb.) belirtmez

İlk olarak 27 Mart 2025 Perşembe günü yayımlandı