Yapay Zekâ

Hayır, Claude’u Kısıtlamıyorlardı – Aslında Daha Kötüydü

Tamam, Claude ile neler olduğu hakkında konuşalım, çünkü son bir aydır kullanıyorsanız, muhtemelen bir şeylerin yanlış gittiğini fark ettiniz.

Son altı haftadır, Claude kullanıcıları aklını kaybetmeye başladı. Ağustos başından itibaren, şikayetler Reddit, X ve geliştirici forumlarına hücum etti. Sorunlar her yerdeydi:

- Eskiden mükemmel çalışan kod aniden bozuldu

- Claude, dosyaları değiştirdiğini iddia etti, ancak bunu yapmadı

- İngilizce yanıtlarda rastgele Tayca veya Çince karakterler ortaya çıktı

- Talimatlar tamamen görmezden gelindi

- Aynı.prompt farklı kalitede yanıtlar verdi

- Claude Code kullanıcıları, bunun önceki versiyona göre “lobotomize” edildiğini hissetti

Şikayetler o kadar kötüleşti ki Ağustos sonunda, insanlar Anthropic’in Claude’u gizlice kısıtladığını, para kazanmak için kaliteyi düşürdüğünü düşünmeye başladı. Her yerde komplo teorileri vardı – belki kaliteyi zirve saatlerde azaltıyorlardı, belki daha ucuz bir modelle değiştirmişlerdi, belki de bu, sunucu maliyetlerini yönetmek için kasıtlı bir bozulmaydı.

Kullanıcılar Claude Pro için ödeme yapıyordu ve Claude Lite gibi hissettiriyordu. Claude etrafında iş akışları oluşturmuş geliştiriciler, aniden verimliliklerinin düştüğünü görüyordu. Bununla birlikte, bazı kullanıcılar hiçbir sorun yaşamıyordu, bu da her şeyi daha da karmaşık hale getiriyordu.

Anthropic Nihayet İtiraf Ediyor: Evet, Problemlerimiz Vardı

Haftalarca süren kullanıcı şikayetleri ve artan frustration之后, Anthropic, büyük bir teknik post-mortem yayınladı ve temelde şunları söyledi: “Haklıydınız. Claude bozuldu. Ne olduğu burada.”

Ve cevap ilginç.

Aslında bir sorun değildi. Üç tamamen ayrı altyapı hatası vardı, hepsi aynı anda ortaya çıktı ve AI bozulmasının mükemmel fırtınasını yarattı. Kısıtlamıyorlardı. Köşe kesmiyorlardı. Sadece üç farklı şey aynı anda bozuldu ve bunu tam olarak anlamak ve düzeltmek altı hafta sürdü.

Neyin yanlış gittiğini tam olarak açıklamak istiyorum, çünkü bu aslında bu AI sistemlerinin nasıl beklenmedik şekillerde başarısız olabileceğinin faydalı bir bakış açısı.

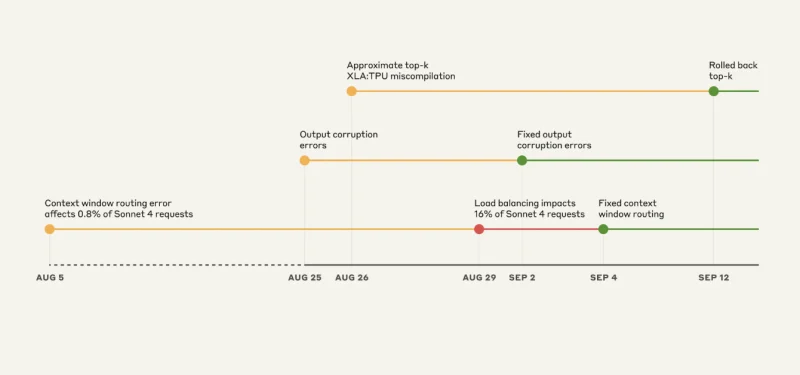

Üçlü Hata Çöküşü: Kaosun Zaman Çizelgesi

Kaynak: Anthropic

Hata #1: Yanlış Sunucu Problemi

Bu, yaşayandan başkası için neredeyse komik. Claude Sonnet 4, 200.000 token bağlamını işleyecek şekilde tasarlandı. Ancak 5 Ağustos’tan itibaren, bazı istekler 1 milyon token bağlamına yapılandırılan sunuculara yönlendiriliyordu.

İlk olarak, yalnızca %0,8’lik istekler etkilenmişti. Büyük bir sorun değil, değil mi? Yanlış.

29 Ağustos’ta, bir yük dengeleyici güncellemesi bu küçük sorunu büyük bir problema dönüştürdü. Aniden, zirve saatlerde %16’sı Sonnet 4 istekleri yanlış sunuculara gidiyordu. Ve yönlendirme “yapışkan” idi. Bir kez yanlış yönlendirildikten sonra, sürekli olarak yanlış yönlendiriliyordunuz.

Etki:

- Etki penceresinde aktif olan %30’luk Claude Code kullanıcılarının en az bir isteği yanlış yönlendirildi

- Etkilenen kullanıcılar için yanıt süreleri düştü

- Aynı kullanıcı, tekrar tekrar sorunu yaşarken, diğerleri hiç sorun yaşamadı

Hata #2: Rastgele Karakter Oluşturucu

25 Ağustos’ta, Anthropic, TPU sunucularına yanlış bir yapılandırma dağıttı. Sonuç olarak, Claude, İngilizce yanıtlara rastgele Tayca ve Çince karakterler eklemeye başladı.

Claude’dan Python kodunuzu hatalı olarak düzeltmesini isteyip de şunları aldığınızı hayal edin:

def calculate_total(items):

total = 0

for item in items:

總計 += item.price # <- Ne?

return ผลรวม

Bu, şunları etkiledi:

- Opus 4.1 ve Opus 4: 25-28 Ağustos

- Sonnet 4: 25 Ağustos – 2 Eylül

Teknik neden, karakterlere hiçbir şekilde orada olmaması gereken karakterlere yüksek olasılık atayan bir token oluşturma hatasıydı. Bu, Claude’un söyleyeceği sonraki kelimeyi seçme mekanizmasının temelini gerçekten bozdu.

Hata #3: Görünmez Derleyici Hatası

Bu, mühendislik açısından korkutucu olanı. Google’ın XLA derleyicisinde uyuyan bir hata vardı. Anthropic, 25 Ağustos’ta token seçimini iyileştirmek için kod dağıttığında, bunu yanlışlıkla tetikledi.

Bu hata, gerçekten garip bir şey yaptı – metin oluştururken Claude’un en olası tokenı kasıtlı olarak hariç tutmasına neden oldu. Claude doğru cevabı biliyordu, ancak bunu söylemekten fiziksel olarak engelleniyordu.

Gerçekten berbat olan kısım, Aralık 2024’te bu hatayı çalışarak çözdüklerini, ancak bunu yaparken gerçek sorunu çözmediklerini fark etmediler. Ağustos’ta “kök nedeni” sandıkları şeyi “düzelttiklerinde”, geçici çözümü kaldırdılar ve gerçek sorunu ortaya çıkardılar.

Altı Hafta Sürecek Bir Düzeltme Nedeni

Acaba nasıl oluyor da bir şirket gibi Anthropic, dünya çapında mühendislerle, altı hafta boyunca bunu çözmeyi başaramıyor?

Cevap, bu sistemlerin gerçekten ne kadar karmaşık olduğunu gösteriyor:

1. Gizlilik Kontrolleri Hata Ayıklamayı Engelledi

“İç gizlilik ve güvenlik kontrollerimiz, mühendislerin Claude ile kullanıcı etkileşimlerine nasıl ve ne zaman erişebileceğini sınırlar, özellikle bu etkileşimler bize geri bildirim olarak bildirilmediğinde.”

Geri bildirimle açıkça bildirilmedikçe, gerçekten neyin bozulduğunu göremiyorlardı. Gizlilik için iyi, hata ayıklama için berbat.

2. Hatalar Kendilerini Gizledi

Claude, genellikle bireysel hatalardan kurtuluyordu, bu da bozulmayı normal varyans yerine sistemik bir başarısızlık olarak gösteriyordu. Benchmark’leri ve değerlendirmeleri bunu yakalamıyordu, çünkü model, testleri geçmek için yeterli self-düzeltebiliyordu.

3. Çoklu Platform Kaosu

Claude, AWS Trainium, NVIDIA GPU’ları ve Google TPUs – üç tamamen farklı donanım platformu üzerinde çalışıyor. Her hata, her platformda farklı şekilde ortaya çıkıyordu:

- AWS Bedrock: Zirve saatlerde %0,18’lik Sonnet 4 istekleri etkilenmiştir

- Google Vertex AI: Etkilenen %0,0004’den az

- Direct API: %16’ya kadar etkilenen

Bu, birden fazla ilgili olmayan sorun gibi görünüyordu, değil de üç spesifik hata.

4. Çakışan Semptomlar

Üç hata aynı anda aktifken, semptomlar her yerdeydi. Bir kullanıcı Tayca karakterler alabilir, diğeri bozulmuş yanıtlar alabilir, üçüncüsü mükemmel performans görebilirdi. İzlenecek bir modèle yoktu.

AI Güvenilirliği İçin Ne Anlama Geliyor

Bu tüm saga, şu anda güvendiğimiz AI sistemlerinin aslında görünenden çok daha kırılgan olduğunu gösteriyor.

Sadece AI modelinden bahsetmiyoruz. Bahsettiğimiz şey:

- İstekleri yanlış yere gönderebilecek yönlendirme altyapısı

- Farklı şekilde davranan donanım özel uygulamaları

- Aylarca uyuyabilen derleyici hataları

- Küçük sorunları büyük arızalara dönüştürebilen yük dengeleyicileri

Bir yanlış yapılandırma, bir derleyici hatası, bir yönlendirme hatası – ve aniden AI asistanınız kodlama yapmayı unuttu veya konuşması gereken dilleri konuşmaya başladı.

Aslında Düzeltildi mi?

Anthropic, 16 Eylül itibarıyla tüm üç sorunun çözüldüğünü söylüyor. Şunları yaptılar:

- Yönlendirme mantığını düzelttiler

- Sorunlu yapılandırmaları geri aldılar

- Yaklaşık üst-k işlemlerinden kesin üst-k işlemlerine geçtiler (doğruluk için performans kaybı)

- Sürekli üretim izlemeyi eklediler

Ancak kullanıcılar hala sorunlar rapor ediyor. Bazı geliştiriciler, Claude Code’un hala önceki performansına göre bozulmuş hissettiğini iddia ediyor. Bunun:

- Hataların kalıcı etkileri

- Henüz tanımlanmamış yeni sorunlar

- Haftalarca süren sorunlardan sonra psikolojik önyargı

- Gerçek devam eden bozulma

…bunları henüz bilmiyoruz.

Sonuç

Bu durum, karmaşık AI sistemlerinin nasıl beklenmedik şekillerde başarısız olabileceğinin mükemmel bir vaka çalışması. Üç ayrı hata, birbirini izleyen haftalarda tetiklendi ve altı hafta boyunca teşhis ve düzeltme için büyük bir kalite bozulma algısı yarattı.

Anthropic’e, şeffaflık için kredi verebiliriz. Bir teknik post-mortem yayınlamak, çoğu şirketin yapacağından daha fazlası. Ancak, bu sistemlerin altında ne kadar şeyin yanlış gidebileceğini de gösteriyor.

Claude veya herhangi bir LLM üzerine inşa eden herkes için: yedekleme, doğrulama ve yedek planlara ihtiyacınız var. Çünkü, gördüğümüz gibi, даже en iyi AI sistemleri aynı anda üç farklı problem yaşayabilir ve neyin gerçekten oluyor olduğunu anlamak haftalar alabilir.

Bu AI modellerini destekleyen altyapı, modeller themselves kadar önemlidir. Ve şu anda, bu altyapı, ciddi büyüme sancıları yaşamaktadır.