Ortaklıklar

Infineon Technologies ve d-Matrix, Düşük Gecikmeli AI Altyapısı Üzerine İş Birliği Yapıyor

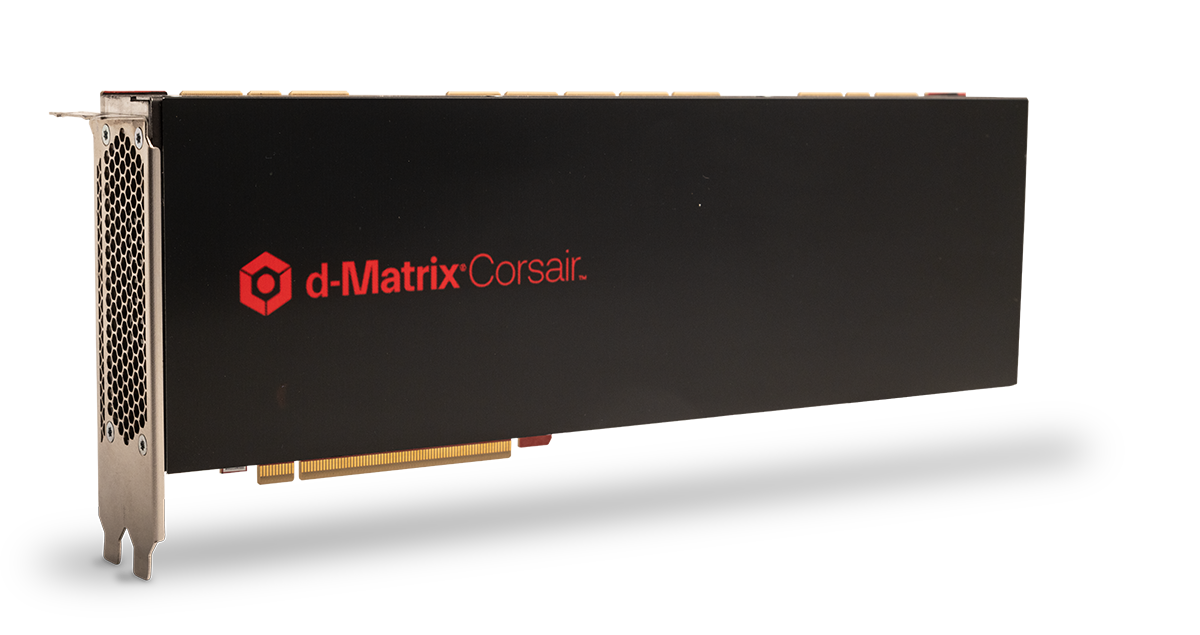

Infineon Technologies, modern veri merkezlerinde kullanılan AI çıkarımı sistemlerinin performansını ve enerji verimliliğini iyileştirmeye odaklanan d-Matrix ile bir合作 duyurdu. İş birliği, d-Matrix’in Corsair AI çıkarımı hızlandırıcı platformu ve Infineon’un OptiMOS çift-fazlı güç modüllerini etrafında dönüyor. Bu modüller, etkileşimli AI iş yükleri için yüksek yoğunluklu hesap ortamlarını desteklemek üzere tasarlandı.

Duyuru, AI donanım endüstrisinde büyüyen bir değişimi vurguluyor. Geçtiğimiz birkaç yıl boyunca altyapı patlaması, giderek daha büyük AI modellerini eğitmeye odaklanırken, endüstri şimdi hızlı bir şekilde çıkarıma – chatbot’lar, ajent AI sistemleri, kaptanlar, arama, finansal analiz ve sağlık karar destek sistemleri gibi gerçek dünya uygulamalarında modelleri çalıştırma sürecine – doğru genişliyor. Bu iş yükleri, özellikle gecikme, tepkisellik ve enerji tüketimi açısından donanım üzerinde farklı talepler yaratıyor.

AI Çıkarımı Neden Büyük Bir Donanım Savaşı Alanı Oluyor

AI Çıkarımı, etkileşimli AI sistemlerinin saniyeler yerine milisaniyeler içinde cevaplar gerektirdiği için AI altyapısı pazarının en hızlı büyüyen segmentlerinden biri haline geldi. d-Matrix, Corsair’i özellikle bu iş yükleri için konumlandırıyor ve ultra düşük gecikme ve enerji verimli çıkarım vurguluyor.

d-Matrix’e göre, Corsair, génératif AI çıkarımını yavaşlatan bellek tıkanıklıklarını azaltmaya yönelik bir dijital bellek-içinde-hesaplama mimarisi etrafında tasarlandı. Şirket, platformun, özellikle etkileşimli uygulamalar için geleneksel GPU-merkezli çıkarım sistemlerine kıyasla önemli ölçüde daha düşük gecikme ve daha iyi verimlilik sağladığını iddia ediyor.

Infineon ile iş birliği, başka bir kritik zorluğu ele alıyor: güç teslimi.

AI sunucularının yoğunluğunu artırmasıyla birlikte, hızlandırıcılara güç teslimi, altyapının ölçeklendirilmesinde sınırlayıcı bir faktör haline geldi. Infineon’un OptiMOS TDM2254xx modülleri, elektriksel kayıpları azaltırken kompakt sunucu sistemlerinde güç yoğunluğunu iyileştiren dikey güç teslimi mimarileri için tasarlandı.

Gerçek Zamanlı AI Sistemlerine Doğru Kayma

Şirketler, iş birliğini “etkileşimli AI” yükselişi etrafında konumlandırıyor, burada çıkarım sistemlerinin çok düşük gecikme ile sürekli olarak çıktılar üretmesi gerekiyor. Bu, konuşma AI, AI ajentleri, gerçek zamanlı akıl yürütme sistemleri ve büyük dil modellerinden hızlı token üretimi gerektiren uygulamaları içerir.

d-Matrix kurucu CEO’su Sid Sheth, Corsair’in arkasındaki mimarinin özellikle 2 milisaniye altı token gecikmesi için tasarlandığını söyledi, bu metric giderek daha önemli hale geliyor çünkü şirketler AI sistemlerini deneylerden müşteri odaklı ortamlara taşıyor.

Geniş AI endüstrisi de, çıkarım altyapısının eğitim altyapısından farklı bir şekilde evrimleşebileceğini tanımaya başlıyor. GPU kümeleri, generatif AI’nin ilk genişleme aşamasını domine ederken, çıkarım giderek daha fazla bellek bant genişliği, gecikme, ağ ve enerji verimliliğine optimize edilmiş mimarileri ödüllendiriyor.

Güç Verimliliği AI Ölçeklendirilmesinde Merkezi Hale Geliyor

Hyperscaler’lar ve AI bulut sağlayıcıları için karşılaşılan en büyük kısıtlamalardan biri elektrik talebidir. AI çıkarımı iş yükleri, gün boyunca milyonlarca istek boyunca sürekli çalışabilir, bu nedenle operasyonel verimlilik, dağıtım maliyetleri için kritik hale gelir.

Infineon, AI altyapısı içinde silikon, silikon karbür (SiC) ve galliyum nitrit (GaN) tabanlı yarı iletken teknolojileri aracılığıyla konumunu giderek genişletiyor. Şirket, AI hızlandırıcıları ve sunucu altyapısının altında bulunan güç teslimi katmanını tedarik etmeye odaklanıyor.

d-Matrix ile iş birliği, yarı iletken şirketlerinin AI hızlandırıcı startup’ları ile daha da entegre hale geldiğini gösteriyor, çünkü endüstri geleneksel GPU-ağırlıklı mimarilere alternatifler arıyor.

AI Altyapısı Geleneksel GPU’lerin Ötesine Genişliyor

İş birliği, AI donanımında deneylerin arttığı bir dönemde gerçekleşiyor. Çıkarıma, bellek-merkezli hesaplama veya AI ağlarına odaklanan özel hızlandırıcılar geliştiren startup’ların sayısı giderek artıyor.

d-Matrix, hesap-bellek teknolojilerine ve büyük dil modelleri için düşük gecikmeli çıkarım sistemlerine vurgusuyla kendini ayırt etti. Şirket, ayrıca altyapı stratejisini sadece hızlandırıcı çiplerden öteye genişletti ve yakın zamanda ağ, bileşik altyapı ve çıkarım kümeleri için tam sistem optimizasyonuna vurgu yaptı.

AI uygulamaları giderek daha fazla ajent ve etkileşimli hale geldikçe, altyapı sağlayıcılarının gecikmeyi azaltmaya, enerji tüketimini düşürmeye ve tüm veri merkezi yığınları boyunca sistem düzeyinde verimliliği artırmaya odaklanması bekleniyor, yalnızca ham işlem gücüne odaklanmak yerine.