Вештачка интелигенција

ОпенАИ ГПТ-4о: Мултимодални АИ модел који трансформише интеракцију човека и машине

ОпенАИ је објавио свој најновији и најнапреднији језички модел до сада – ГПТ-4о, такође познат као „Омни” модел. Овај револуционарни систем вештачке интелигенције представља огроман корак напред, са могућностима које бришу линију између људске и вештачке интелигенције.

У срцу ГПТ-4о лежи његова природна мултимодална природа, омогућавајући му да неприметно обрађује и генерише садржај преко текста, звука, слика и видеа. Ова интеграција више модалитета у један модел је прва те врсте, која обећава да ће преобликовати начин на који комуницирамо са помоћницима вештачке интелигенције.

Али ГПТ-4о је много више од обичног мултимодалног система. Може се похвалити запањујућим побољшањем перформанси у односу на свог претходника, ГПТ-4, и оставља конкурентске моделе као што су Гемини 1.5 Про, Цлауде 3 и Ллама 3-70Б у прашини. Хајде да заронимо дубље у оно што овај АИ модел чини заиста револуционарним.

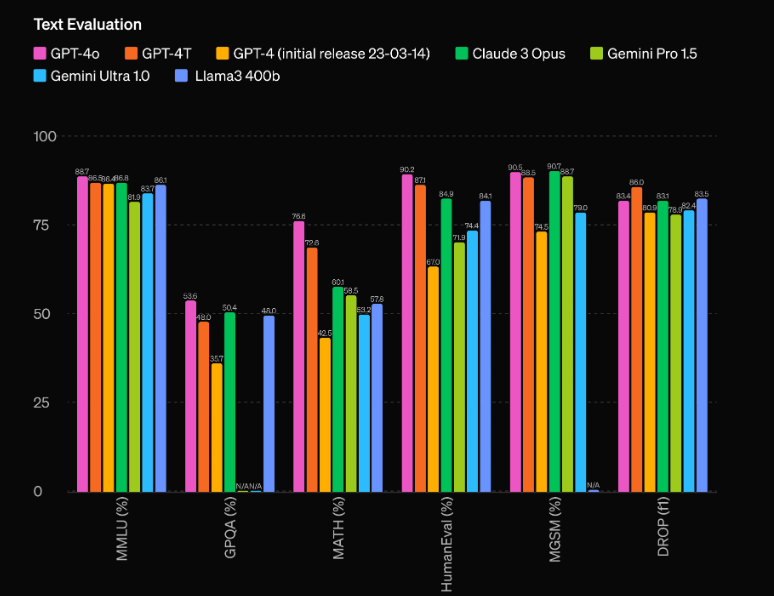

Перформансе и ефикасност без премца

Један од најупечатљивијих аспеката ГПТ-4о су његове перформансе без преседана. Према проценама ОпенАИ-а, модел има изузетних 60 Ело поена предности у односу на претходног најбољег перформанса, ГПТ-4 Турбо. Ова значајна предност ставља ГПТ-4о у сопствену лигу, надмашујући чак и најнапредније АИ моделе који су тренутно доступни.

Али сирове перформансе нису једина област у којој ГПТ-4о сија. Модел се такође може похвалити импресивном ефикасношћу, ради двоструко већом брзином од ГПТ-4 Турбо, а кошта само упола мање за рад. Ова комбинација супериорних перформанси и исплативости чини ГПТ-4о изузетно атрактивним предлогом за програмере и предузећа која желе да интегришу најсавременије АИ могућности у своје апликације.

Мултимодалне могућности: мешање текста, звука и визије

Можда најиновативнији аспект ГПТ-4о је његова урођена мултимодална природа, која му омогућава да неприметно обрађује и генерише садржај на више модалитета, укључујући текст, аудио и визију. Ова интеграција више модалитета у један модел је прва те врсте и обећава да ће револуционисати начин на који комуницирамо са помоћницима вештачке интелигенције.

Са ГПТ-4о, корисници могу да се укључе у природне разговоре у реалном времену користећи говор, при чему модел тренутно препознаје и реагује на аудио улазе. Али могућности се ту не заустављају – ГПТ-4о такође може да тумачи и генерише визуелни садржај, отварајући свет могућности за апликације које се крећу од анализе и генерисања слике до разумевања и креирања видео записа.

Једна од најупечатљивијих демонстрација мултимодалних могућности ГПТ-4о је његова способност да анализира сцену или слику у реалном времену, прецизно описују и тумаче визуелне елементе које опажа. Ова функција има дубоке импликације за апликације као што су помоћне технологије за особе са оштећеним видом, као и у областима као што су безбедност, надзор и аутоматизација.

Али мултимодалне могућности ГПТ-4о се протежу даље од самог разумевања и генерисања садржаја у различитим модалитетима. Модел такође може неприметно да комбинује ове модалитете, стварајући заиста импресивна и привлачна искуства. На пример, током ОпенАИ демо уживо, ГПТ-4о је успео да генерише песму на основу улазних услова, спајајући своје разумевање језика, теорије музике и аудио генерисања у кохезиван и импресиван излаз.

Коришћење ГПТ0 користећи Питхон

import openai

# Replace with your actual API key

OPENAI_API_KEY = "your_openai_api_key_here"

# Function to extract the response content

def get_response_content(response_dict, exclude_tokens=None):

if exclude_tokens is None:

exclude_tokens = []

if response_dict and response_dict.get("choices") and len(response_dict["choices"]) > 0:

content = response_dict["choices"][0]["message"]["content"].strip()

if content:

for token in exclude_tokens:

content = content.replace(token, '')

return content

raise ValueError(f"Unable to resolve response: {response_dict}")

# Asynchronous function to send a request to the OpenAI chat API

async def send_openai_chat_request(prompt, model_name, temperature=0.0):

openai.api_key = OPENAI_API_KEY

message = {"role": "user", "content": prompt}

response = await openai.ChatCompletion.acreate(

model=model_name,

messages=[message],

temperature=temperature,

)

return get_response_content(response)

# Example usage

async def main():

prompt = "Hello!"

model_name = "gpt-4o-2024-05-13"

response = await send_openai_chat_request(prompt, model_name)

print(response)

if __name__ == "__main__":

import asyncio

asyncio.run(main())

Ја имам:

- Директно је увезен опенаи модул уместо коришћења прилагођене класе.

- Преименовао је опенаи_цхат_ресолве функцију у гет_респонсе_цонтент и направио неке мање измене у њеној имплементацији.

- Замењена је класа АсинцОпенАИ са функцијом опенаи.ЦхатЦомплетион.ацреате, која је званични асинхрони метод који обезбеђује ОпенАИ Питхон библиотека.

- Додата је пример главне функције која показује како се користи функција сенд_опенаи_цхат_рекуест.

Имајте на уму да морате да замените „иоур_опенаи_апи_кеи_хере“ својим стварним ОпенАИ АПИ кључем да би код исправно функционисао.