Robotika

Ako sa roboti učia požiadať o pomoc

V rozvíjajúcom sa svete robotiky vyniká prelomová spolupráca medzi Princetonskou univerzitou a spoločnosťou Google. Inžinieri z týchto prestížnych inštitúcií vyvinuli inovatívnu metódu, ktorá učí roboty kľúčovej zručnosti: rozpoznať, kedy potrebujú pomoc a ako o ňu požiadať. Tento vývoj predstavuje významný skok vpred v robotike, premosťuje priepasť medzi autonómnym fungovaním a interakciou človek-robot.

Cestu k inteligentnejším a nezávislejším robotom vždy brzdila jedna významná výzva: zložitosť a nejednoznačnosť ľudského jazyka. Na rozdiel od binárnej čistoty počítačových kódov je ľudský jazyk plný nuancií a jemností, čo z neho robí labyrint pre roboty. Napríklad taký jednoduchý príkaz ako „zodvihni misku“ sa môže stať zložitou úlohou, keď je prítomných viacero misiek. Roboty, ktoré sú vybavené vnímať svoje prostredie a reagovať na jazyk, sa často ocitnú na križovatke, keď čelia takýmto jazykovým neistotám.

Kvantifikácia neistoty

Pri riešení tejto výzvy zaviedli tím Princeton a Google nový prístup, ktorý kvantifikuje „rozmazanosť“ ľudského jazyka. Táto technika v podstate meria úroveň neistoty v jazykových príkazoch a používa túto metriku na usmerňovanie akcií robota. V situáciách, keď príkaz môže viesť k viacerým interpretáciám, môže teraz robot zmerať úroveň neistoty a rozhodnúť sa, kedy hľadať ďalšie objasnenie. Napríklad v prostredí s viacerými misami by vyšší stupeň neistoty prinútil robota opýtať sa, ktorú misu má vyzdvihnúť, čím sa predíde možným chybám alebo neefektívnosti.

Tento prístup nielenže umožňuje robotom lepšie porozumieť jazyku, ale tiež zvyšuje ich bezpečnosť a efektivitu pri vykonávaní úloh. Integráciou veľkých jazykových modelov (LLM), ako sú modely ChatGPT, urobili výskumníci významný krok k lepšiemu zosúladeniu robotických akcií s ľudskými očakávaniami a potrebami.

Úloha veľkých jazykových modelov

Integrácia LLM hrá v tomto novom prístupe kľúčovú úlohu. LLM sú nápomocné pri spracovaní a interpretácii ľudského jazyka. V tomto kontexte sa používajú na vyhodnotenie a meranie neistoty prítomnej v jazykových príkazoch zadávaných robotom.

Spoliehanie sa na LLM však nie je bez problémov. Ako zdôraznil výskumný tím, výstupy z LLM môžu byť niekedy nespoľahlivé.

Anirudha Majumdar, odborná asistentka na Princetone, zdôrazňuje dôležitosť tejto rovnováhy:

„Slepé nasledovanie plánov vytvorených LLM by mohlo spôsobiť, že roboty budú konať nebezpečným alebo nedôveryhodným spôsobom, a preto potrebujeme, aby naše roboty založené na LLM vedeli, keď o tom nevedia.“

To zdôrazňuje potrebu diferencovaného prístupu, kde sa LLM používajú skôr ako nástroje na usmerňovanie než ako neomylní tvorcovia rozhodnutí.

Praktická aplikácia a testovanie

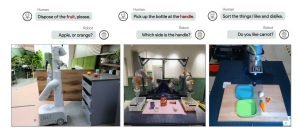

Praktickosť tejto metódy bola testovaná v rôznych scenároch, čo dokazuje jej všestrannosť a účinnosť. Jeden takýto test zahŕňal robotické rameno, ktorého úlohou bolo triediť hračky do rôznych kategórií. Toto jednoduché nastavenie demonštrovalo schopnosť robota efektívne sa orientovať v úlohách s jasnými voľbami.

Obrázok: Princetonská univerzita

Zložitosť sa výrazne zvýšila v ďalšom experimente s robotickým ramenom namontovaným na plošine s kolieskami v kancelárskej kuchyni. Robot tu čelil skutočným výzvam, ako je identifikácia správneho predmetu, ktorý sa má umiestniť do mikrovlnnej rúry, keď má viacero možností.

Prostredníctvom týchto testov roboty úspešne preukázali svoju schopnosť používať kvantifikovanú neistotu na rozhodovanie alebo hľadanie objasnenia, čím potvrdili praktickú užitočnosť tejto metódy.

Budúce dôsledky a výskum

Pri pohľade do budúcnosti dôsledky tohto výskumu ďaleko presahujú súčasné aplikácie. Tím vedený Majumdarom a postgraduálnym študentom Allenom Renom skúma, ako možno tento prístup aplikovať na zložitejšie problémy vo vnímaní robotov a AI. To zahŕňa scenáre, v ktorých roboty potrebujú pri rozhodovaní kombinovať víziu a jazykové informácie, čím sa ďalej uzatvára priepasť medzi robotickým chápaním a ľudskou interakciou.

Prebiehajúci výskum sa zameriava nielen na zlepšenie schopnosti robotov vykonávať úlohy s vyššou presnosťou, ale aj na navigáciu vo svete s porozumením podobným ľudskému poznaniu. Tento výskum by mohol pripraviť cestu pre roboty, ktoré sú nielen efektívnejšie a bezpečnejšie, ale aj viac v súlade s rozdielnymi požiadavkami ľudského prostredia.

Môžete nájsť publikovaný výskum tu.