Искусственный интеллект

Нет, они не душили Клода — на самом деле всё было хуже

Хорошо, давайте поговорим о том, что происходит с Клод, потому что если вы пользовались им в течение последнего месяца, вы, вероятно, заметили, что что-то не так.

Последние шесть недель пользователи Клода сходят с ума. С начала августа Жалобы начали заполонять Reddit, X и форумы разработчиковПроблемы были повсюду:

- Код, который раньше работал идеально, внезапно сломался

- Клод утверждал, что вносил изменения в файлы, хотя на самом деле этого не было.

- Случайные тайские или китайские иероглифы, встречающиеся в английских ответах

- Инструкции полностью игнорируются

- Один и тот же запрос дает совершенно разные по качеству ответы

- Пользователи Claude Code говорят, что по сравнению с предыдущими версиями ощущали себя «лоботомированными»

Жалобы стали настолько серьёзными, что к концу августа люди были убеждены, что Anthropic тайно снижает производительность Claude, чтобы сэкономить. Теории заговора циркулировали повсюду: возможно, они снижали качество в часы пик, возможно, они тихо заменили модель на более дешёвую, а возможно, это было намеренное снижение производительности для управления расходами на сервер.

Пользователи платили за Клод Про и получили то, что было похоже на Claude Lite. Разработчики, выстраивавшие рабочие процессы на основе Claude, внезапно обнаружили, что их производительность резко упала. При этом некоторые пользователи вообще не столкнулись с какими-либо проблемами, что ещё больше запутывало ситуацию.

Anthropic наконец признаёт: да, у нас были проблемы

После недель жалоб пользователей и растущего разочарования, Anthropic только что опубликовала масштабное техническое исследование По сути, это означает: «Вы были правы. Клод был сломлен. Вот что произошло».

И ответ интересный.

Оказалось, что проблема была не одной. Это были три совершенно разные ошибки инфраструктуры, возникшие одновременно, создав настоящий шторм деградации ИИ. Они не ограничивали производительность. Они не экономили на ресурсах. Просто три разных компонента сломались одновременно, и на полное понимание и исправление причин у них ушло шесть недель.

Позвольте мне подробно рассказать, что пошло не так, потому что это на самом деле полезный взгляд на то, как системы искусственного интеллекта могут давать сбои способами, которые никто не ожидает.

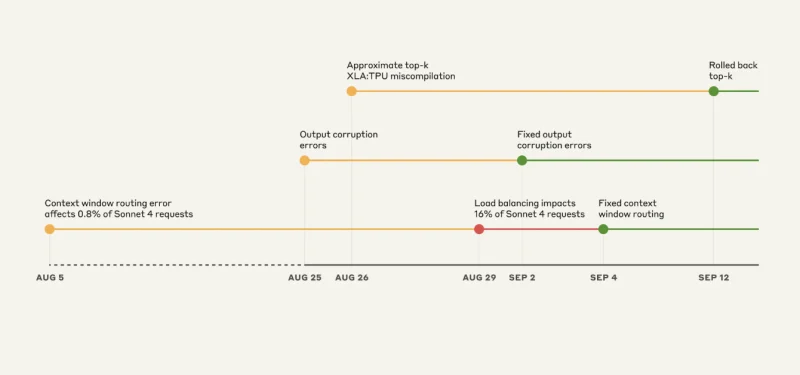

Тройной кризис: хронология хаоса

Источник: Антропный

Ошибка №1: проблема с неправильным сервером

Это почти смешно, если вы сами с этим не сталкивались. Claude Sonnet 4 был разработан для обработки 200,000 5 контекстов токенов. Но с 1 августа некоторые запросы стали перенаправляться на серверы, настроенные на обработку XNUMX миллиона контекстов токенов.

Изначально это затронуло всего 0.8% запросов. Ничего страшного, правда? Неправда.

29 августа плановое обновление балансировщика нагрузки превратило эту незначительную проблему в серьёзную. Внезапно, в пиковый момент, 16% запросов Sonnet 4 стали поступать на неправильные серверы. Маршрутизация стала «липкой». Если однажды произошла ошибка маршрутизации, она повторялась.

Влияние:

- Около 30% пользователей Claude Code, которые были активны в течение окна, имели по крайней мере один неправильно направленный запрос.

- Время отклика для пострадавших пользователей резко сократилось

- Один и тот же пользователь сталкивался с этой проблемой неоднократно, в то время как у других не было никаких проблем.

Ошибка №2: Генератор случайных символов

25 августа компания Anthropic внедрила неверную конфигурацию на своих серверах TPU. В результате Клод начал случайным образом вставлять тайские и китайские иероглифы в ответы на английском языке.

Представьте, что вы просите Клода отладить ваш код Python и получаете следующее:

def calculate_total(items):

total = 0

for item in items:

總計 += item.price # <- What?

return ผลรวม

Это коснулось:

- Opus 4.1 и Opus 4: 25-28 августа

- Сонет 4: 25 августа – 2 сентября

Технической причиной стала ошибка генерации токенов, из-за которой высокая вероятность присваивалась символам, которым там не место. Это буквально сломало фундаментальный механизм выбора Клодом следующего слова.

Ошибка №3: Невидимая ошибка компилятора

Это пугает с инженерной точки зрения. В компиляторе XLA от Google была скрытая ошибка, которая до этого не проявлялась. Когда 25 августа Anthropic развернули код для улучшения выбора токенов, они случайно её активировали.

Действие этой ошибки было поистине странным: она заставляла Клода непреднамеренно исключать наиболее вероятный токен при генерации текста. Клод знал правильный ответ, но физически не мог его произнести.

А что действительно плохого? Они, сами того не осознавая, обошли эту ошибку ещё в декабре 2024 года. Когда в августе они «исправили» то, что, по их мнению, было корневой причиной, они убрали обходной путь и высвободили настоящую проблему.

Почему на исправление ушло шесть недель

Вы, возможно, задаетесь вопросом: как такой компании, как Anthropic, с ее инженерами мирового класса, потребовалось шесть недель, чтобы разобраться с этим?

Ответ показывает, насколько сложны эти системы на самом деле:

1. Настройки конфиденциальности блокируют отладку

«Наши внутренние средства контроля конфиденциальности и безопасности ограничивают то, как и когда инженеры могут получать доступ к взаимодействиям пользователей с Клодом, в частности, когда эти взаимодействия не сообщаются нам в качестве обратной связи».

Они буквально не могли увидеть, что именно сломалось, пока пользователи не сообщали об этом в отзыве. Это хорошо для конфиденциальности, но плохо для отладки.

2. Насекомые спрятались

Клод часто восстанавливался после отдельных ошибок, представляя деградацию как нормальное отклонение, а не как систематический сбой. Их бенчмарки и оценки не выявляли этого, поскольку модель самокорректировалась ровно настолько, чтобы пройти тесты.

3. Мультиплатформенный хаос

Клод работает на AWS Trainium, NVIDIA Графические процессоры и Google TPU — три совершенно разные аппаратные платформы. Каждая ошибка проявлялась по-разному на каждой платформе:

- AWS Bedrock: затронуто 0.18% запросов Sonnet 4 в пиковый период

- Google Vertex AI: менее 0.0004% уязвимости

- Прямой API: затронуто до 16%

Из-за этого возникло ощущение, что это несколько несвязанных проблем, а не три конкретных ошибки.

4. Перекрывающиеся симптомы

При одновременном возникновении трёх ошибок симптомы были самыми разными. У одного пользователя могли появляться тайские иероглифы, у другого — ухудшение ответа, у третьего — идеальная производительность. Чёткой закономерности не наблюдалось.

Что это на самом деле означает для надежности ИИ

Вся эта история раскрывает нечто важное о текущем состоянии систем ИИ: они гораздо более хрупкие, чем кажутся.

Мы говорим не только о самой модели ИИ. Мы говорим о:

- Инфраструктура маршрутизации, которая может отправлять запросы не туда

- Аппаратно-специфические реализации, которые ведут себя по-разному

- Ошибки компилятора, которые могут не проявляться месяцами

- Балансировщики нагрузки, которые могут превратить незначительные проблемы в серьезные сбои

Одна неправильная конфигурация, одна ошибка компилятора, одна ошибка маршрутизации — и внезапно ваш ИИ-помощник забывает, как писать код, или начинает говорить на языках, на которых не должен.

Это действительно исправлено?

Anthropic сообщает, что по состоянию на 16 сентября они решили все три проблемы.. Они:

- Исправлена логика маршрутизации

- Откатили проблемные конфигурации

- Переключился с приблизительных на точные операции с топ-k (что снизило производительность ради точности)

- Добавлен непрерывный мониторинг производства

Созданием цифровых двойников возможности пользователи все еще сообщают о проблемахНекоторые разработчики утверждают, что Claude Code по-прежнему выглядит менее производительным по сравнению с предыдущей версией. Например:

- Затяжные последствия от насекомых

- Новые проблемы, которые не были выявлены

- Психологическая предвзятость после недель проблем

- Или фактическая продолжающаяся деградация

…мы пока не знаем.

Выводы

Эта ситуация — прекрасный пример того, как сложные системы искусственного интеллекта могут давать сбои совершенно неожиданным образом. Три отдельные ошибки, возникшие с разницей в несколько недель, создали впечатление значительного снижения качества, на диагностику и устранение которого ушло шесть недель.

Мы можем отдать должное Anthropic за прозрачность. Публикация подробного технического отчета — это больше, чем позволяет себе большинство компаний. Но это также показывает, сколько проблем может возникнуть в системах, на которые мы всё больше полагаемся.

Для всех, кто разрабатывает на основе Claude или любой другой программы LLM: вам нужны резервирование, валидация и планы резервного копирования. Потому что, как мы только что видели, даже самые лучшие системы искусственного интеллекта могут столкнуться с тремя разными проблемами одновременно, и могут пройти недели, прежде чем кто-то поймёт, что происходит на самом деле.

Инфраструктура, поддерживающая эти модели ИИ, так же важна, как и сами модели. И сейчас эта инфраструктура испытывает серьёзные трудности.