ဉာဏ်ရည်တု

ST-NeRF- ဗီဒီယိုပေါင်းစပ်ခြင်းနှင့် တည်းဖြတ်ခြင်း

တရုတ်သုတေသနလုပ်ငန်းစုတစ်ခုရှိသည်။ ဖွံ့ဖြိုးပြီး တည်းဖြတ်ခြင်းနှင့် ပေါင်းစပ်ခြင်းစွမ်းရည်များကို ယမန်နှစ်၏ အပူဆုံးပုံရိပ်ပေါင်းစပ်ခြင်းဆိုင်ရာ သုတေသနကဏ္ဍတစ်ခုဖြစ်သည့် Neural Radiance Fields (NeRF) သို့ ယူဆောင်လာစေရန် နည်းစနစ်များ။ စနစ်အား ST-NeRF (Spatio-Temporal Coherent Neural Radiance Field) ဟုခေါ်သည်။

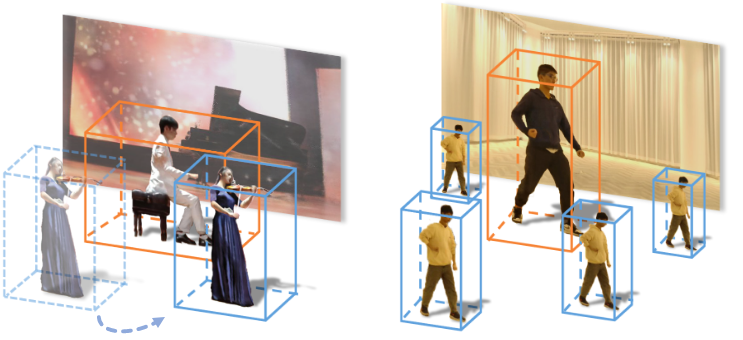

အောက်ပါပုံရှိ ရုပ်ပိုင်းဆိုင်ရာကင်မရာဝေ့ပုံပေါ်သည့်အရာသည် အမှန်တကယ်တွင် အသုံးပြုသူသည် 4D နေရာလွတ်ရှိ ဗီဒီယိုအကြောင်းအရာအပေါ် ရှုထောင့်များမှတဆင့် 'လှိမ့်နေသည်' မျှသာဖြစ်သည်။ POV သည် ဗီဒီယိုတွင် ဖော်ပြထားသည့် လူများ၏ စွမ်းဆောင်ရည်အတွက် သော့မခတ်ထားပါ၊

ဗီဒီယိုအတွင်းမှ အသွင်အပြင်တစ်ခုစီသည် ဒိုင်းနမစ်စူးစမ်းရှာဖွေနိုင်သည့် ပေါင်းစပ်ပေါင်းစပ်ထားသော မြင်ကွင်းတစ်ခုအဖြစ် တိကျစွာဖမ်းယူထားသော ဒြပ်စင်တစ်ခုဖြစ်သည်။

အသွင်အပြင်များကို အခင်းအကျင်းအတွင်း လွတ်လပ်စွာ ပွားနိုင်သည် သို့မဟုတ် ပြန်လည်အရွယ်အစား-

ထို့အပြင်၊ အသွင်အပြင်တစ်ခုစီ၏ ယာယီအမူအကျင့်များကို အလွယ်တကူ ပြောင်းလဲခြင်း၊ နှေးကွေးခြင်း၊ နောက်ပြန်ပြေးခြင်း သို့မဟုတ် နည်းလမ်းများစွာဖြင့် ခြယ်လှယ်နိုင်ပြီး၊ ဗိသုကာလက်ရာများကို စစ်ထုတ်ရန် လမ်းကြောင်းဖွင့်ကာ အလွန်မြင့်မားသော အဓိပ္ပာယ်ဖွင့်ဆိုနိုင်မှုအဆင့်ကို လုပ်ဆောင်နိုင်သည်။

သီးခြား NeRF အသွင်အပြင်နှစ်ခုသည် တူညီသောအခင်းအကျင်းတွင် မတူညီသောအမြန်နှုန်းဖြင့် လည်ပတ်သည်။ အရင်းအမြစ်- https://www.youtube.com/watch?v=Wp4HfOwFGP4

ရိုတိုစကုပ်ဖြင့် ဖျော်ဖြေသူများ သို့မဟုတ် ပတ်၀န်းကျင်ကို မလိုအပ်ဘဲ၊ သို့မဟုတ် ဖျော်ဖြေသူများသည် ၎င်းတို့၏ လှုပ်ရှားမှုများကို မျက်စိစုံမှိတ်ပြီး ရည်ရွယ်ထားသော မြင်ကွင်း၏ ဆက်စပ်မှုကို ဆောင်ရွက်ရန် မလိုအပ်ပါ။ ယင်းအစား၊ 16 ဒီဂရီဖုံးလွှမ်းထားသော ဗီဒီယိုကင်မရာ ၁၆ လုံး၏ ခင်းကျင်းမှုမှတစ်ဆင့် သဘာဝအတိုင်း ရိုက်ကူးနိုင်သည်-

အထက်ဖော်ပြပါ အချက်သုံးချက်၊ လူနှစ်ဦးနှင့် ပတ်ဝန်းကျင်သည် ကွဲပြားပြီး သရုပ်ဖော်ရန်အတွက်သာ ဖော်ပြထားပါသည်။ တစ်ခုချင်းစီကို လဲလှယ်နိုင်ပြီး တစ်ခုချင်းစီကို ၎င်းတို့၏ ရိုက်ကူးမှုအချိန်ဇယားတွင် အစောပိုင်း သို့မဟုတ် နောက်ပိုင်းတွင် အမှတ်အသားတစ်ခုစီတွင် ထည့်သွင်းနိုင်သည်။

ST-NeRF သည် Neural Radiance Fields တွင် သုတေသနပြုတီထွင်မှုတစ်ခု (NeRF) များပြားလှသော လေ့ကျင့်မှုဖြင့် ရှုထောင့်မျိုးစုံကို ဖမ်းယူနိုင်သည့် စက်ဖြင့် သင်ယူမှုဘောင်တစ်ခု (ရှုထောင့်တစ်ခုတည်းကို ရိုက်ကူးခြင်းသည် NeRF သုတေသန၏ ကဏ္ဍခွဲတစ်ခုဖြစ်သော်လည်း)။

Neural Radiance Fields သည် ဖမ်းယူမှုဆိုင်ရာ ရှုထောင့်များစွာကို ပေါင်းစပ်ကာ တစ်ခုတည်းသော ပေါင်းစပ်ပြီး သွားလာနိုင်သော 3D အာကာသတစ်ခုအဖြစ် ပေါင်းစပ်ကာ၊ လွှမ်းခြုံခန့်မှန်းချက်နှင့် အာရုံကြောကွန်ရက်မှ ပြန်ဆိုထားသည့်ကြားကွာဟမှုများကြားတွင် ကွာဟချက်နှင့်အတူ အလုပ်လုပ်ပါသည်။ ဗီဒီယို (ရုပ်ပုံများထက်) အသုံးပြုသည့်အခါ၊ လိုအပ်သော rendering အရင်းအမြစ်များသည် မကြာခဏဆိုသလို များပြားပါသည်။ အရင်းအမြစ်- https://www.matthewtancik.com/nerf

NeRF ကို လွန်ခဲ့သည့် ကိုးလအတွင်း စိတ်ဝင်စားမှု ပြင်းထန်လာပြီး Reddit ကို ထိန်းသိမ်းထားသည်။ စာရင်း ဆင်းသက်လာသော သို့မဟုတ် စူးစမ်းရှာဖွေရေး NeRF စာတမ်းများ၏ လက်ရှိ ပရောဂျက်ခြောက်ဆယ်ကို စာရင်းပြုစုထားသည်။

မူရင်း NeRF စာရွက်၏ အပျက်အစီးများစွာထဲမှ အနည်းငယ်မျှသာ။ အရင်းအမြစ်- https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

တတ်နိုင်တဲ့ သင်တန်း

အဆိုပါစာတမ်းသည် Shanghai Tech University မှ သုတေသီများနှင့် ပူးပေါင်းဆောင်ရွက်ခြင်းဖြစ်ပါသည်။ DGene ဒစ်ဂျစ်တယ်နည်းပညာစိတ်အားထက်သန်မှုအချို့နှင့် လက်ခံခဲ့သည်။ Open Review မှာ.

ST-NeRF သည် ML မှရရှိသော ရေကြောင်းသွားလာနိုင်သော ဗီဒီယိုနေရာများတွင် ယခင်လုပ်ဆောင်မှုများထက် ဆန်းသစ်တီထွင်မှုများစွာကို ပေးဆောင်ပါသည်။ အနည်းဆုံးတော့ ကင်မရာ 16 လုံးသာရှိတဲ့ realism အဆင့်ကို ရရှိနိုင်ပါတယ်။ ဖေ့စ်ဘုတ်ရှိသော်လည်း၊ DyNeRF ၎င်းထက်ပို၍ ကင်မရာနှစ်လုံးကိုသာ အသုံးပြုသည်၊ ၎င်းသည် ပိုမိုကန့်သတ်ထားသော လမ်းကြောင်းပြကွက်ကို ပေးဆောင်သည်။

Facebook ၏ DyNeRF ပတ်၀န်းကျင်၏ ဥပမာတစ်ခု၊ ပိုမိုအကန့်အသတ်ရှိသော လှုပ်ရှားမှုနယ်ပယ်နှင့် မြင်ကွင်းကို ပြန်လည်တည်ဆောက်ရန်အတွက် တစ်စတုရန်းပေလျှင် ကင်မရာများ ပိုမိုလိုအပ်သည်။ အရင်းအမြစ်- https://neural-3d-video.github.io

တစ်သီးပုဂ္ဂလအသွင်အပြင်များကို တည်းဖြတ်နိုင်စွမ်းမရှိသည့်အပြင် DyNeRF သည် တွက်ချက်မှုဆိုင်ရာအရင်းအမြစ်များနှင့်ပတ်သက်၍ အထူးစျေးကြီးသည်။ ဆန့်ကျင်ဘက်အားဖြင့်၊ တရုတ်သုတေသီများက ၎င်းတို့၏ ဒေတာအတွက် လေ့ကျင့်ရေးစရိတ်သည် ဒေါ်လာ ၉၀၀ မှ ၃၀၀၀ ကြားရှိပြီး ခေတ်မီသော ဗီဒီယိုမျိုးဆက်သစ်မော်ဒယ် DVDGAN နှင့် DyNeRF ကဲ့သို့သော ပြင်းထန်သောစနစ်များအတွက် ဒေါ်လာ 900 နှင့် နှိုင်းယှဉ်ပါက တစ်နေရာမှ ထွက်လာသည်ဟု ဆိုသည်။

ST-NeRF သည် ရုပ်ပုံပေါင်းစပ်မှု ဖြစ်စဉ်မှ သင်ယူမှု ရွေ့လျားမှု ဖြစ်စဉ်ကို ခွဲထုတ်ရာတွင် အဓိက ဆန်းသစ်တီထွင်မှု တစ်ခု ပြုလုပ်ကြောင်း ဆန်းစစ်သူများမှ မှတ်ချက်ပြုခဲ့သည်။ ဤခြားနားမှုသည် ယခင်ချဉ်းကပ်မှုများကို ကန့်သတ်ပြီး မျဉ်းသားနှိုင်းယှဉ်ခြင်းဖြင့် တည်းဖြတ်ခြင်းနှင့် ပေါင်းစပ်ခြင်းတို့ကို လုပ်ဆောင်နိုင်စေသောအရာဖြစ်သည်။

ကင်မရာ 16 လုံးသည် စက်ဝိုင်းခြမ်းအပြည့်မြင်ကွင်းအတွက် အလွန်အကန့်အသတ်ရှိသော array တစ်ခုဖြစ်သော်လည်း သုတေသီများသည် proxy ကြိုတင်စကင်န်ဖတ်ထားသော static backgrounds နှင့် data-driven scene modeling ချဉ်းကပ်မှုများကို အသုံးပြုခြင်းဖြင့် နောက်ပိုင်းတွင် ဤအရေအတွက်ကို ထပ်မံလျှော့ချနိုင်မည်ဟု မျှော်လင့်ပါသည်။ ၎င်းတို့သည် ပြန်လည်အလင်းရောင်ပေးနိုင်စွမ်းကို ထည့်သွင်းရန်လည်း မျှော်လင့်ထားသည်။ လတ်တလော ဆန်းသစ်တီထွင်မှု NeRF သုတေသနတွင်။

ST-NeRF ၏ကန့်သတ်ချက်များကိုဖြေရှင်းခြင်း။

စွန့်ပစ်စာအဆုံးစာပိုဒ်တွင် စနစ်အသစ်၏ အမှန်တကယ်အသုံးပြုနိုင်မှုကို အမှိုက်ပစ်လေ့ရှိသည့် ပညာရေး CS စာတမ်းများ၏ အခြေအနေတွင်၊ သုတေသီများက ST-NeRF အတွက် အသိအမှတ်ပြုသည့် ကန့်သတ်ချက်များသည်ပင် ပုံမှန်မဟုတ်ပေ။

စနစ်သည် လောလောဆယ်တွင် မြင်ကွင်းတစ်ခုရှိ အရာဝတ္ထုများကို သီးခြားခွဲခြားပြီး သီးခြားထုတ်ပြနိုင်မည်မဟုတ်ကြောင်း သတိပြုမိသည်၊ အကြောင်းမှာ ဗီဒီယိုဖိုင်ရှိလူများသည် လူသားများကို မှတ်မိရန်နှင့် အရာဝတ္ထုများမဟုတ်ဘဲ အရာဝတ္ထုများကို ဒီဇိုင်းထုတ်ထားသော စနစ်တစ်ခုမှတစ်ဆင့် တစ်ခုချင်းစီသို့ အပိုင်းပိုင်းခွဲထားသောကြောင့်ဖြစ်သည် - YOLO နှင့် ဆင်တူသည့်ပြဿနာကို အလွယ်တကူဖြေရှင်းနိုင်ပုံရသည်။ လူ့ဗီဒီယိုကို ထုတ်ယူရန် ပိုမိုခက်ခဲသော အလုပ်နှင့်အတူ မူဘောင်များ ပြီးမြောက်နေပြီဖြစ်သည်။

Slow-motion ကို လောလောဆယ်တွင် ထုတ်လုပ်ရန် မဖြစ်နိုင်ကြောင်း သုတေသီများက သတိပြုမိသော်လည်း၊ frame interpolation ကဲ့သို့သော ရှိပြီးသား ဆန်းသစ်တီထွင်မှုများကို အသုံးပြု၍ ၎င်းကို အကောင်အထည်ဖော်ရန် တားဆီးရန် အနည်းငယ်မျှသာ ရှိပုံရသည်။ DAIN နှင့် ရုန်းရင်းဆန်ခတ်.

NeRF အကောင်အထည်ဖော်မှုများအားလုံးနှင့် ကွန်ပျူတာအမြင်သုတေသန၏ အခြားကဏ္ဍများစွာတွင်၊ ST-NeRF သည် အကြောင်းအရာအား အခြားသူတစ်ဦး သို့မဟုတ် အရာဝတ္ထုတစ်ခုမှ ခေတ္တဖုံးကွယ်ထားပြီး ဆက်တိုက်ခြေရာခံရန် သို့မဟုတ် တိကျရန်ခက်ခဲနိုင်သည် နောက်မှ ပြန်လည်ရယူပါ။ အခြားနေရာများတွင်ကဲ့သို့ပင် ဤအခက်အခဲသည် အထက်ပိုင်းဖြေရှင်းချက်များကို စောင့်ရပေလိမ့်မည်။ ထိုအတောအတွင်း၊ ဤပိတ်လှောင်ထားသောဘောင်များတွင် လက်ဖြင့်ဝင်ရောက်စွက်ဖက်ရန် လိုအပ်ကြောင်း သုတေသီများက ဝန်ခံသည်။

နောက်ဆုံးတွင်၊ လူသား အပိုင်းခွဲခြင်းဆိုင်ရာ လုပ်ထုံးလုပ်နည်းများသည် လက်ရှိတွင် လူနှစ်ဦးကို အပိုင်းခွဲကွက်တစ်ခုအဖြစ် မရည်ရွယ်ဘဲ ပေါင်းစပ်သွားနိုင်သည့် အရောင်ကွဲပြားမှုများကို မှီခိုနေရကြောင်း သုတေသီများက သတိပြုမိသည်မှာ - ST-NeRF တွင် မကန့်သတ်ထားဘဲ၊ အသုံးပြုနေသည့် စာကြည့်တိုက်အတွက် ပင်ကိုယ်ပါ ထိမိ၍လဲစရာ၊ optical flow analysis နှင့် အခြားသော ပေါ်ပေါက်လာသော နည်းပညာများဖြင့် ဖြေရှင်းနိုင်သည် ။

7 ခုနှစ် မေလ 2021 ရက်နေ့တွင် ပထမဆုံးထုတ်ဝေခဲ့သည်။