Kënschtlech Intelligenz

AI Bild Matting Dat versteet Szenen

An den Extras Dokumentarfilm mat der 2003 DVD Verëffentlechung vun friem3 (1992), visuell Effekter Legend Richard Edlund erënnert mat Schrecken un de 'Sumo Wrestling' vun der photochemescher Matt Extraktioun déi visuell Effekter Aarbecht tëscht dem dominéiert huet. spéit 1930s an de spéiden 1980er. Den Edlund beschreift d'Hit-and-Miss Natur vum Prozess als 'Sumo Wrestling', am Verglach mat den digitale blo/gréngen Écran Techniken déi an de fréien 1990er iwwerholl hunn (an hien huet zréckkomm zu der Metapher zënter).

E Virgrondelement (wéi eng Persoun oder e Raumschëffmodell) aus engem Hannergrond extrahéieren, sou datt dat ausgeschniddene Bild an eng Hannergrondplack zesummegesat ka ginn, gouf ursprénglech erreecht andeems de Virdergrondobjekt géint en eenheetlechen bloen oder gréngen Hannergrond gefilmt gouf.

Laborious photochemical Extraktioun Prozesser fir e VFX Schoss vun ILM fir 'Return of the Jedi' (1983). Quell: https://www.youtube.com/watch?v=qwMLOjqPmbQ

An de resultéierende Footage gëtt d'Hannergrondfaarf duerno chemesch isoléiert an als Schabloun benotzt fir de Virdergrondobjekt (oder Persoun) an engem opteschen Dréckerspäicher als 'floating' Objet an enger soss transparenter Filmzell.

De Prozess war bekannt als Color Separation Overlay (CSO) - obwuel dëse Begrëff schlussendlech méi mat der Brut ass verbonne ginn 'Chromakey' Video Effekter am niddereg-budgettéierten Fernsehausgang vun den 1970er an 1980er Joren, déi mat analogen anstatt chemeschen oder digitale Mëttelen erreecht goufen.

Eng Demonstratioun vu Color Separation Overlay am Joer 1970 fir déi britesch Kannershow 'Blue Peter'. Source: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

Op alle Fall, ob fir Film- oder Videoelementer, duerno konnten déi extrahéiert Footage an all aner Footage agesat ginn.

Och wann Disney notamment méi deier a propriétaire ass Natrium-Dampprozess (wat op giel geschwat huet, speziell, a war och benotzt fir dem Alfred Hitchcock säin 1963 Horror The Birds) huet besser Definitioun a knusprech Matte ginn, photochemesch Extraktioun blouf ustrengend an onzouverlässeg.

Disney's propriétaire Natriumdampextraktiounsprozess erfuerdert Hannergrënn no beim gielen Enn vum Spektrum. Hei ass d'Angela Lansbury op Drot suspendéiert wärend der Produktioun vun enger VFX-gesond Sequenz fir 'Bedknobs and Broomsticks' (1971). Source

Doriwwer eraus Digital Matting

An den 1990er huet d'digitale Revolutioun d'Chemikalien verzichten, awer net de Besoin fir gréng Schiirme. Et war elo méiglech de gréngen (oder wéi eng Faarf och ëmmer) Hannergrond ze läschen just andeems Dir no Pixelen an engem Toleranzberäich vun där Faarf sicht, an Pixel-Editiounssoftware wéi Photoshop, an eng nei Generatioun vu Video-Compositing Suiten déi automatesch ausschlësselen kënnen déi faarweg Hannergrënn. Bal iwwer Nuecht, siechzeg Joer vun der optescher Drockindustrie goufen an d'Geschicht verschéckt.

Déi lescht zéng Joer vun der GPU-beschleunegter Computervisiounsfuerschung lancéiert d'Matte Extraktioun an en drëtten Alter, fuerdert d'Fuerscher mat der Entwécklung vu Systemer, déi qualitativ héichwäerteg Matten extrahéieren ouni de Besoin fir gréng Schiirme. Bei Arxiv eleng sinn Pabeieren am Zesummenhang mat Innovatiounen am Maschinnléiere-baséiert Virdergrondextraktioun eng wëchentlech Feature.

Setzt eis an d'Bild

Dëse Locus vum akademeschen an Industrieinteresse an der AI Extraktioun huet schonn de Konsumentraum beaflosst: rau awer funktionell Implementatioune si mir all vertraut a Form vun Zoom an Skype Filteren déi eise Wunnzëmmer hannergrond mat tropeschen Inselen ersetzen, et al, a Videokonferenzen.

Allerdéngs verlaangen déi bescht Matte nach eng gréng Écran, wéi Zoom bemierkt leschte Mëttwoch.

Lénks, e Mann virun engem gréngen Ecran, mat gutt extrahéiert Hoer iwwer Zoom's Virtual Background Feature. Richteg, eng Fra virun enger normaler Hausszen, mat Hoer algorithmesch extrahéiert, manner präzis a mat méi héije Rechenfuerderunge. Quell: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

A weider Post vun der Zoom Support Plattform warnt datt net-gréng Écran Extraktioun och méi Rechenkraaft am Capture-Apparat erfuerdert.

De Besoin Et Ausschneiden

Verbesserunge vun der Qualitéit, der Portabilitéit an der Ressourcewirtschaft fir 'an der Wëld' matte Extraktiounssystemer (dh Leit ze isoléieren ouni de Besoin fir gréng Schiirme) si relevant fir vill méi Secteuren a Verfollegungen wéi just Videokonferenzfilter.

Fir Datesaz Entwécklung, verbessert Gesiichts-, Vollkop- a Vollkierpererkennung bitt d'Méiglechkeet ze garantéieren datt extern Hannergrondelementer net an Computervisiounsmodeller vu mënschleche Sujeten trainéiert ginn; méi genee Isolatioun géif vill verbesseren semantesch Segmentatioun Techniken entwéckelt fir Domainen z'ënnerscheeden an ze assimiléieren (dh 'kaz', 'Persoun', 'boot'), a verbesseren Och an transformer-baséiert baséiert Bildsynthesesystemer wéi dem OpenAI seng nei DALL-E2; a besser Extraktioun Algorithmen géif de Besoin fir deier manuell reduzéieren Rotoskopéieren an deier VFX Pipelines.

Tatsächlech, den Opstig vun multimodal (normalerweis Text/Bild) Methodologien, wou en Domain wéi 'Katze' souwuel als Bild a mat assoziéierten Textreferenzen kodéiert ass, mécht schonn d'Bildveraarbechtung op. Ee rezent Beispill ass de Text2Live Architektur, déi multimodal (Text / Bild) Training benotzt fir Videoen ze kreéieren vun, ënner villen anere Méiglechkeeten, Kristallschwanen a Glasgiraffen.

Zeen-bewosst AI Matting

Eng gutt Partie Fuerschung an AI-baséiert automatesch Matting huet sech op Grenzerkennung an Evaluatioun vu Pixel-baséiert Gruppéierungen an engem Bild- oder Videoframe konzentréiert. Wéi och ëmmer, nei Fuerschung aus China bitt eng Extraktiounspipeline déi d'Ofgrenzung an d'matte Qualitéit verbessert duerch d'Leberung Text-baséiert Beschreiwunge vun enger Szen (eng multimodal Approche déi an de Computervisiounsfuerschungssektor an de leschten 3-4 Joer Traktioun gewonnen huet), behaapt datt se op fréier Methoden op e puer Weeër verbessert hunn.

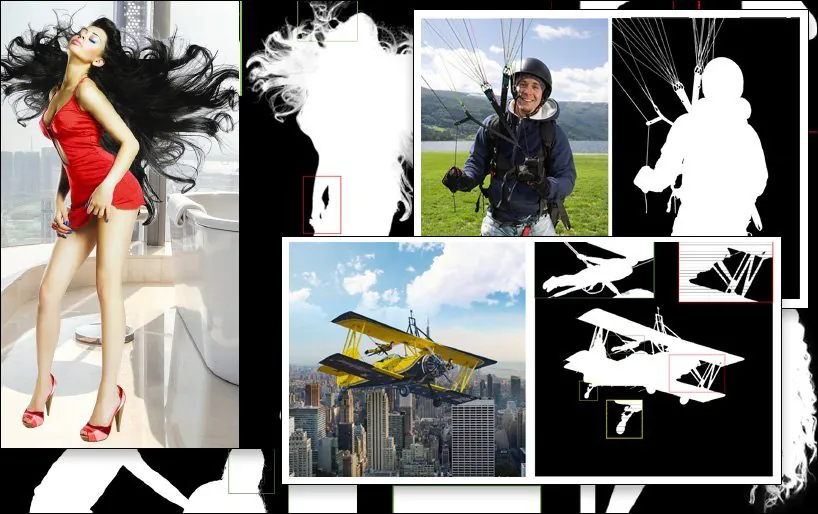

E Beispill SPG-IM Extraktioun (lescht Bild, ënnen riets), Verglach géint Competitioun virdrun Methoden. Source: https://arxiv.org/pdf/2204.09276.pdf

D'Erausfuerderung fir den Extraktiounsfuerschungs-Subsektor ass Workflows ze produzéieren déi e minimale Minimum vu manueller Annotatioun a mënschlech Interventioun erfuerderen - am Idealfall keng. Nieft de Käschte-Implikatioune beobachten d'Fuerscher vum neie Pabeier datt Annotatiounen a manuelle Segmentatiounen, déi vun outsourcéierten Crowdworker a verschiddene Kulturen duerchgefouert goufen, verursaache kënnen d'Biller op verschidde Weeër ze markéieren oder souguer segmentéiert ze ginn, wat zu inkonsistenten an onzefriddenstellenden Algorithmen féiert.

Ee Beispill dovun ass déi subjektiv Interpretatioun vun deem wat e 'Virgrondobjekt' definéiert:

Aus dem neie Pabeier: virdrun Methoden L.F.M. an MODNet ('GT' bedeit Ground Truth, en 'ideal' Resultat dat dacks manuell oder duerch net-algorithmesch Methoden erreecht gëtt), hunn verschidden a verschidden effektiv Iwwerleeungen op d'Definitioun vum Virdergrondinhalt, wärend déi nei SPG-IM Method méi effektiv 'no Inhalt' delineéiert ' duerch Zeen Kontext.

Fir dëst unzegoen, hunn d'Fuerscher eng zwee-Etapp Pipeline mam Titel entwéckelt Situatiouns Perceptioun Guided Image Matting (SPG-IM). Déi zwee-Etapp Encoder / Decoder Architektur ëmfaasst Situatioun Perception Destillatioun (SPD) a Situational Perception Guided Matting (SPGM).

Als éischt pretrains SPD visuell-zu-textuell Feature Transformatiounen, generéiert Ënnertitelen entspriechend zu hiren assoziéierte Biller. Duerno gëtt d'Virdergrond Mask Prognose aktivéiert andeems d'Pipeline mat engem Roman verbënnt Saliency Prognose Technik.

Dann erausginn SPGM eng geschätzte Alpha Matte baséiert op der Matière RGB Bild Input an der generéiert Mask am éischte Modul kritt.

D'Zil ass situational Perceptioun Leedung, an där de System e kontextuellt Verständnis huet vu wat d'Bild besteet, wat et erlaabt - zum Beispill - d'Erausfuerderung ze kadréieren fir komplex Hoer aus engem Hannergrond géint bekannte Charakteristike vun esou enger spezifescher Aufgab ze extrahieren.

Am Beispill hei ënnen versteet SPG-IM datt d'Schnouer intrinsesch sinn zu engem 'Fallschierm', wou MODNet dës Detailer net behalen an definéieren. Och hei uewen ass déi komplett Struktur vum Spillplazapparat arbiträr am MODNet verluer.

déi nei Pabeier heescht Situatiouns Perceptioun Guided Image Matting, a kënnt vu Fuerscher am OPPO Research Institute, PicUp.ai, an Xmotors.

Intelligent Automatiséiert Matten

SPG-IM bitt och en Adaptive Focal Transformation (AFT) Refinement Network dat lokal Detailer a globale Kontext getrennt veraarbecht kann, wat 'intelligent Matte' erliichtert.

Zeenkontext verstoen, an dësem Fall 'Meedchen mat Päerd', kann potenziell Virdergrondextraktioun méi einfach maachen wéi virdrun Methoden.

De Pabeier seet:

"Mir gleewen datt visuell Representatioune vun der visueller-zu-textueller Aufgab, z Bildopschrëft, fokusséiert op méi semantesch ëmfaassend Signaler tëscht a) Objet zum Objet an b) Objet zum Ambientëmfeld fir Beschreiwunge ze generéieren déi souwuel déi global Informatioun a lokal Detailer kënnen ofdecken. Zousätzlech, am Verglach mat der deier Pixel Annotatioun vun Bild Matte, Text Etiketten kann massiv op eng ganz niddreg Käschten gesammelt ginn.

D'SPD Branche vun der Architektur ass zesumme mat der University of Michigan's pretrained VirTex Transformator-baséiert textuellen Decoder, dee visuell Representatioune vu semantesch dichten Iwwerschrëften léiert.

VirTex trainéiert zesummen e ConvNet an Transformers iwwer Bild-Iwwerschrëft-Koupletten, an iwwerdréit déi kritt Abléck op downstream Visiounsaufgaben wéi Objekterkennung. Source: https://arxiv.org/pdf/2006.06666.pdf

Ënnert aneren Tester an Ablatiounsstudien hunn d'Fuerscher SPG-IM géint de modernste getest. trimap-baséiert Methoden Deep Image Matting (Dim), IndexNet, Context-Aware Image Matting (CAM), guidéiert kontextuell Opmierksamkeet (GCA), FBA, a Semantic Image Mapping (SIM).

Aner getest virdrun Kaderen abegraff trimap-gratis Approche L.F.M., HAttMatt, an MODNet. Fir e faire Verglach goufen d'Testmethoden ugepasst baséiert op de verschiddene Methodologien; wou Code net verfügbar war, goufen d'Techniken vum Pabeier aus der beschriwwener Architektur reproduzéiert.

Am neie Pabeier steet:

'Eis SPG-IM iwwerhëlt all konkurréiere Trimap-gratis Methoden ([LFM], [HAttMatting], an [MODNet]) mat enger grousser Margin. Mëttlerweil weist eise Modell och bemierkenswäert Iwwerleeënheet iwwer déi modernst (SOTA) Trimap-baséiert a Mask-guidéiert Methoden a punkto all véier Metriken iwwer déi ëffentlech Datesätz (dh Composition-1K, Distinction-646, a Human -2K), an eise Multi-Object-1K Benchmark.'

A weider:

'Et kann selbstverständlech observéiert ginn datt eis Method fein Detailer behält (zB Hoer Tipp Siten, transparent Texturen, a Grenzen) ouni d'Leedung vun Trimap. Ausserdeem, am Verglach mat anere konkurréiere Trimap-gratis Modeller, kann eise SPG-IM eng besser global semantesch Vollständegkeet behalen.'

Éischt publizéiert 24. Abrëll 2022.