AGI

現代のジェネレーティブAIアプリケーションにおけるベクトルデータベースの役割

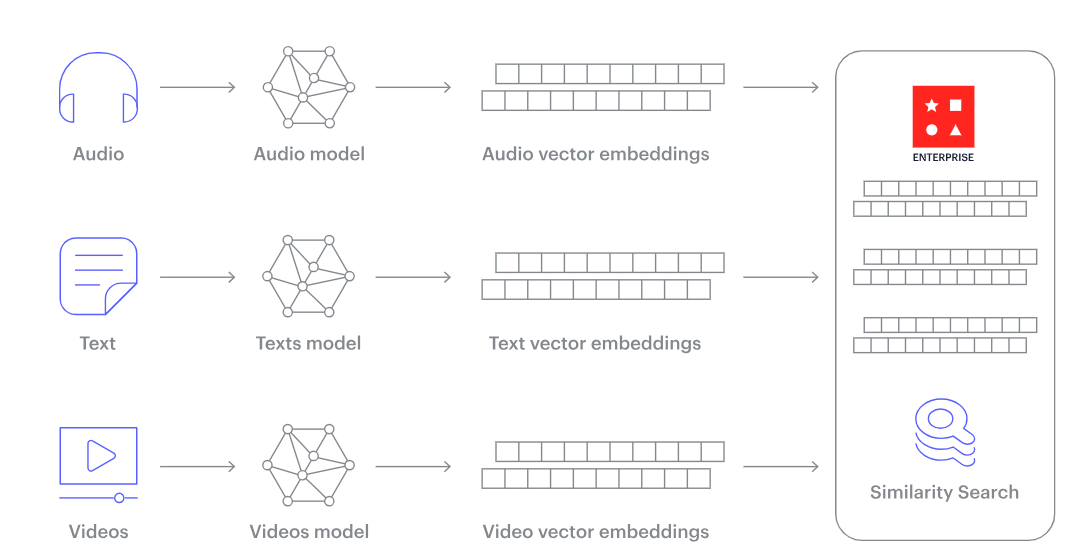

大規模なジェネレーティブAIアプリケーションが効果的に機能するには、多量のデータを処理するための優れたシステムが必要です。そのような重要なシステムの1つがベクトルデータベースです。このデータベースが際立つのは、テキスト、音、画像、動画などの多種多様なデータを数値/ベクトル形式で処理できることです。

ベクトルデータベースとは?

ベクトルデータベースは、高次元ベクトルを効率的に処理するために特別に設計されたストレージシステムです。これらのベクトルは、多次元空間内の点と考えられ、画像、テキスト、または音などのより複雑なデータの埋め込みまたは圧縮された表現を表すことができます。

ベクトルデータベースを使用すると、これらのベクトル間の類似性検索を迅速に実行でき、大規模なデータセットから最も類似したアイテムを迅速に取得できます。

伝統的なデータベースとベクトルデータベース

ベクトルデータベース:

- 高次元データの処理: ベクトルデータベースは、高次元空間内のデータを管理およびストアするように設計されています。これは、データポイント(画像やテキストなど)を多次元空間内のベクトルとして表現できる機械学習などのアプリケーションに特に役立ちます。

- 類似性検索の最適化: ベクトルデータベースの特徴の1つは、類似性検索を実行できることです。データを正確な一致に基づいて照会するのではなく、これらのデータベースを使用すると、指定された照会に「類似した」データを取得できます。これは、画像またはテキストの取得などのタスクに不可欠です。

- 大規模データセットの拡張: AIおよび機械学習アプリケーションが成長するにつれて、処理するデータの量も増加します。ベクトルデータベースは、パフォーマンスを損なうことなく大量のデータを処理できるように設計されています。

伝統的なデータベース:

- 構造化データのストレージ: 伝統的なデータベース(リレーショナルデータベースなど)は、構造化データをストアするように設計されています。これは、データが事前に定義されたテーブル、行、列に組織されていることを意味し、データの完全性と一貫性を確保します。

- CRUD操作の最適化: 伝統的なデータベースは、主にCRUD操作(作成、読み取り、更新、削除)に最適化されています。これは、Webサービスからエンタープライズソフトウェアまで、幅広いアプリケーションに適していることを意味します。

- 固定スキーマ: 伝統的なデータベースの特徴の1つは、固定スキーマです。データベース構造が一度定義されると、変更することは複雑で時間がかかります。この堅牢性はデータの一貫性を確保しますが、スキーマのないまたは動的なスキーマを持つ一部のモダンダータベースほど柔軟ではありません。

伝統的なデータベースは、埋め込みの複雑さに苦労することが多く、これはベクトルデータベースによって容易に解決されます。

ベクトル表現

ベクトルデータベースの動作の根底にある基本的な概念は、数値ベクトルを使用してさまざまな種類のデータを表現することです。画像を例に挙げます。猫の画像を見たとき、それは私たちにとってはただの可愛い猫の画像かもしれませんが、機械にとっては一意の512次元ベクトルに変換できます。

[0.23, 0.54, 0.32, …, 0.12, 0.45, 0.90]

ベクトルデータベースを使用すると、ジェネレーティブAIアプリケーションは、意味に基づいて情報を取得し、長期間にわたって情報を記憶できます。興味深いのは、この方法が画像のみに限定されていないことです。テキストデータも、ベクトル形式でコンテキストと意味を埋め込むことができます。

ジェネレーティブAIとベクトルデータベースの必要性

ジェネレーティブAIには、埋め込みが含まれます。自然言語処理(NLP)におけるワード埋め込みを考えてみましょう。単語または文は、意味を捉えたベクトルに変換されます。人間のようなテキストを生成するとき、モデルは関連する埋め込みを迅速に比較および取得する必要があり、生成されたテキストがコンテキストを維持することを保証します。