ベスト

10のベスト機械学習アルゴリズム

私たちはGPUアクセラレーションによる機械学習の並外れた革新の時代を生きていますが、最新の研究論文には、頻繁に(そして目立つ形で)数十年、場合によっては70年前のアルゴリズムが登場します。 これらの古い手法の多くは「統計分析」の分野に属し、機械学習ではないと主張する人もいるかもしれません。そして、この分野の始まりを、パーセプトロンの発明があった1957年までしか遡らないことを好むかもしれません。 しかし、これらの古いアルゴリズムが、機械学習における最新のトレンドや注目を集める発展をどの程度支え、絡み合っているかを考えると、これは議論の余地のある立場です。それでは、最新の革新を支えるいくつかの「古典的」な構成要素と、AIの殿堂入りを早くも目指している新しい参入者たちを見てみましょう。

1: トランスフォーマー

2017年、Google Researchが主導した研究協力は、論文『Attention Is All You Need』で頂点を迎えました。この研究は、アテンション機構を、エンコーダー/デコーダーやリカレントネットワークモデルにおける「配管」的な役割から、それ自体が中心的な変革技術へと昇格させる新しいアーキテクチャを概説しました。 このアプローチはトランスフォーマーと名付けられ、それ以来自然言語処理(NLP)における革命的な方法論となり、多くの例の中でも、自己回帰型言語モデルでありAIの象徴的存在であるGPT-3を支えています。

大規模トランスフォーマーNLPプロジェクトのタイムライン。 出典: Microsoft

トランスフォーマーアーキテクチャは、NLPからコンピュータビジョンにも進出し、OpenAIのCLIPやDALL-Eなどの画像合成フレームワークの新世代を支えています。これらはテキスト>画像のドメインマッピングを使用して、不完全な画像を完成させたり、学習済みドメインから新しい画像を合成したりします。関連するアプリケーションは増え続けています。

DALL-Eがプラトンの胸像の部分的な画像を完成させようとしている。 出典: https://openai.com/blog/dall-e/

2: 生成的敵対ネットワーク(GAN)

トランスフォーマーはGPT-3のリリースと採用を通じて並外れたメディア報道を得ていますが、生成的敵対ネットワーク(GAN)はそれ自体が認知されるブランドとなり、やがてdeepfakeのように動詞として使われるようになるかもしれません。 主に画像合成に使用されるGANは、2014年に初めて提案され、ジェネレーターとディスクリミネーターで構成されるアーキテクチャです。ジェネレーターはデータセット内の何千もの画像を繰り返し処理し、それらを再構築しようと試みます。各試行に対して、ディスクリミネーターはジェネレーターの作業を採点し、ジェネレーターに戻って改善するよう指示しますが、前回の再構築がどこで間違っていたかについての洞察は一切与えません。

出典: https://developers.google.com/machine-learning/gan/gan_structure

これにより、ジェネレーターは、ディスクリミネーターが間違いを指摘した場合に生じたかもしれない行き止まりを追うのではなく(下記の#8参照)、多様な道筋を探求することを余儀なくされます。トレーニングが終了する頃には、ジェネレーターはデータセット内のポイント間の関係について詳細かつ包括的なマップを獲得しています。

論文『Improving GAN Equilibrium by Raising Spatial Awareness』より:新しいフレームワークは、GANの時として謎めいた潜在空間を循環し、画像合成アーキテクチャに応答性のある操作手段を提供する。 出典: https://genforce.github.io/eqgan/

比喩的に言えば、これはロンドン中心部への単調な通勤ルートを1つ学ぶことと、「ザ・ナレッジ」(ロンドンのタクシー運転手の試験)を苦労して習得することの違いです。 その結果、学習済みモデルの潜在空間には、高レベルの特徴の集合が形成されます。高レベル特徴の意味的指標は「人物」かもしれませんが、その特徴に関連する特異性を掘り下げると、「男性」や「女性」などの他の学習済み特性が明らかになるかもしれません。より低いレベルでは、サブ特徴は「金髪」「白人」などに分解できます。 GANやエンコーダー/デコーダーフレームワークの潜在空間では、絡み合いが顕著な問題です。GANで生成された女性の顔の笑顔は、潜在空間における彼女の「アイデンティティ」の絡み合った特徴なのか、それとも並列の分岐なのか?

thispersondoesnotexistからのGAN生成顔。 出典: https://this-person-does-not-exist.com/en

過去数年間で、この点に関する新しい研究イニシアチブが増えており、GANの潜在空間に対して、特徴レベルでのPhotoshopスタイルの編集への道を開くかもしれません。しかし現時点では、多くの変換は事実上「全部か無か」のパッケージです。特に、NVIDIAの2021年末のEditGANリリースは、セマンティックセグメンテーションマスクを使用することで潜在空間における高い解釈可能性を実現しています。 一般的な用途 人気のあるディープフェイク動画への(実際にはかなり限定的な)関与のほか、画像/ビデオ中心のGANは過去4年間で急増し、研究者と一般大衆の両方を魅了してきました。新しいリリースの目まぐるしいペースと頻度に追いつくのは困難ですが、GitHubリポジトリのAwesome GAN Applicationsは包括的なリストを提供することを目指しています。 生成的敵対ネットワークは、理論的には、テキストを含む、適切に枠組み化されたあらゆるドメインから特徴を導き出すことができます。

3: SVM

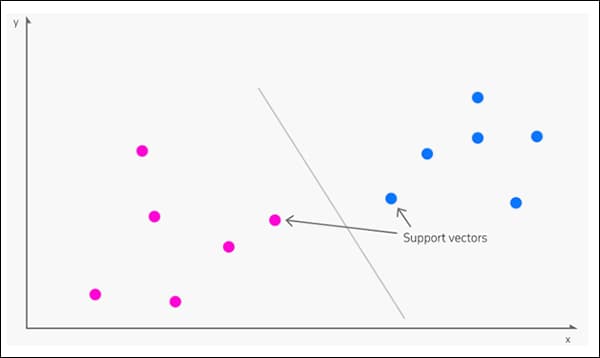

1963年に起源を持ち、サポートベクターマシン(SVM)は、新しい研究に頻繁に登場するコアアルゴリズムです。SVMでは、ベクトルがデータセット内のデータポイントの相対的な配置をマッピングし、サポートベクターが異なるグループ、特徴、または特性間の境界を描きます。

サポートベクターはグループ間の境界を定義する。 出典: https://www.kdnuggets.com/2016/07/support-vector-machines-simple-explanation.html

導出された境界は超平面と呼ばれます。 特徴レベルが低い場合、SVMは二次元(上の画像)ですが、認識されるグループやタイプの数が多い場合は三次元になります。

より深いポイントとグループの配列は、三次元SVMを必要とする。 出典: https://cml.rhul.ac.uk/svm.html

サポートベクターマシンは、さまざまな種類の高次元データを効果的かつ不可知論的に扱うことができるため、ディープフェイク検出、画像分類、ヘイトスピーチ分類、DNA分析、人口構造予測など、さまざまな機械学習分野で広く登場します。

4: K-Meansクラスタリング

クラスタリング全般は、教師なし学習のアプローチであり、密度推定を通じてデータポイントを分類し、研究対象のデータの分布マップを作成しようとします。

K-Meansクラスタリングは、データ内のセグメント、グループ、コミュニティを見出す。 出典: https://aws.amazon.com/blogs/machine-learning/k-means-clustering-with-amazon-sagemaker/

は、このアプローチの最も一般的な実装となり、データポイントを特徴的な「Kグループ」に導きます。これは、人口統計セクター、オンラインコミュニティ、または生の統計データに発見を待つその他の可能な秘密の集合を示すかもしれません。 <img class="wp-image-180125 size-full" src="https://www