人工知能

StyleTTS 2: 人間レベルのテキストからスピーチへの合成を実現する大規模なスピーチ言語モデル

自然なスピーチと合成スピーチの生成アプローチの増加により、AI 業界が過去 few 年間で達成した主な成果の 1 つは、オーディオブック、仮想アシスタント、声優ナレーションなど、さまざまな業界で利用可能な、テキストからスピーチへの合成フレームワークを効果的に合成することです。さらに、一部の最先端モデルは、幅広いスピーチ関連タスクで人間レベルのパフォーマンスと効率を実現しています。ただし、それらの強力なパフォーマンスにもかかわらず、表現力のあるスピーチ、ゼロショット テキストからスピーチへの合成フレームワークを最適化するための大量のトレーニング データの必要性、および OOD (Out of Distribution) テキストのロバスト性のために、まだ改善の余地があります。これにより、開発者はよりロバストでアクセスしやすいテキストからスピーチへの合成フレームワークの作成に取り組むようになりました。

この記事では、StyleTTS-2 という、StyleTTS フレームワークの基礎に築かれた、新しい革新的なテキストからスピーチへの合成フレームワークについて説明します。StyleTTS2 フレームワークは、スピーチ スタイルを潜在的なランダム変数としてモデル化し、確率論的拡散モデルを使用してこれらのスピーチ スタイルまたはランダム変数をサンプリングします。したがって、StyleTTS2 フレームワークは、参照オーディオ入力なしでリアルなスピーチを効果的に合成できます。アプローチにより、StyleTTS2 フレームワークは、現在の最先端のテキストからスピーチへの合成フレームワークと比較して、より優れた結果を実現し、高い効率を示します。さらに、拡散モデル フレームワークによって提供される多様なスピーチ合成を活用できます。この記事では、StyleTTS2 フレームワークのアーキテクチャと方法論について詳細に説明し、フレームワークによって達成された結果を確認します。では、始めましょう。

StyleTTS2 によるテキストからスピーチへの合成: はじめに

StyleTTS2 は、人間レベルの TTS フレームワークを構築するための次のステップとなる、革新的なテキストからスピーチへの合成モデルです。StyleTTS2 フレームワークは、StyleTTS フレームワークの基礎に築かれています。StyleTTS2 フレームワークは、スピーチ スタイルを潜在的なランダム変数としてモデル化し、確率論的拡散モデルを使用してこれらのスピーチ スタイルまたはランダム変数をサンプリングします。したがって、StyleTTS2 フレームワークは、参照オーディオ入力なしでリアルなスピーチを効果的に合成できます。StyleTTS2 フレームワークは、潜在的なランダム変数としてスタイルをモデル化することで、StyleTTS フレームワークと異なります。StyleTTS2 フレームワークは、入力テキストに最も適したスピーチ スタイルを生成することを目的とし、参照オーディオ入力は必要としません。さらに、StyleTTS2 フレームワークは、拡散モデルによって提供される多様なスピーチ合成の能力を活用しながら、効果的な潜在的な拡散を実現できます。

StyleTTS2 フレームワークは、事前トレーニングされた大規模な SLM (Speech Language Model) をディスクリミネーターとして使用し、WavLM フレームワークを使用します。さらに、StyleTTS2 フレームワークは、独自の新しい差分期間モデリング アプローチを使用して、フレームワークをエンドツーエンドでトレーニングし、最終的に自然なスピーチを生成します。アプローチにより、StyleTTS2 フレームワークは、現在の最先端のスピーチ生成タスクを超えるパフォーマンスを実現し、ゼロショット設定でのスピーカー適応タスクのための大規模なスピーチ モデルの事前トレーニングに最も効率的なフレームワークの 1 つです。

次に、人間レベルのテキストからスピーチへの合成を実現するために、StyleTTS2 フレームワークは、既存の研究成果を活用しています。拡散モデルは、スピーチ合成タスクで使用されます。拡散モデルは、スピーチの微妙な制御と多様なスピーチ サンプリングの能力を提供します。ただし、拡散モデルは、GAN ベースの非反復フレームワークほど効率的ではなく、主な理由は、スピーチのターゲット期間まで反復的に潜在的な表現、波形、メル スペクトログラムをサンプリングする必要があるためです。

一方、最近の研究では、大規模なスピーチ言語モデルは、テキストからスピーチへの生成タスクの品質を向上させ、スピーカーに適応する能力を示しています。大規模なスピーチ言語モデルは、通常、テキスト入力を、スピーチ再構築タスクのために事前トレーニングされたスピーチ言語フレームワークから派生した量子化または連続表現に変換します。ただし、これらのスピーチ言語モデルの機能は、直接スピーチ合成に最適化されていません。対照的に、StyleTTS2 フレームワークは、スピーチ言語モデルの機能を、潜在的な空間マップを使用せずに、スピーチ言語モデルの特徴を合成するために、対抗的なトレーニングを使用して、スピーチ合成の最適化された潜在的な空間を直接学習します。

StyleTTS2: アーキテクチャと方法論

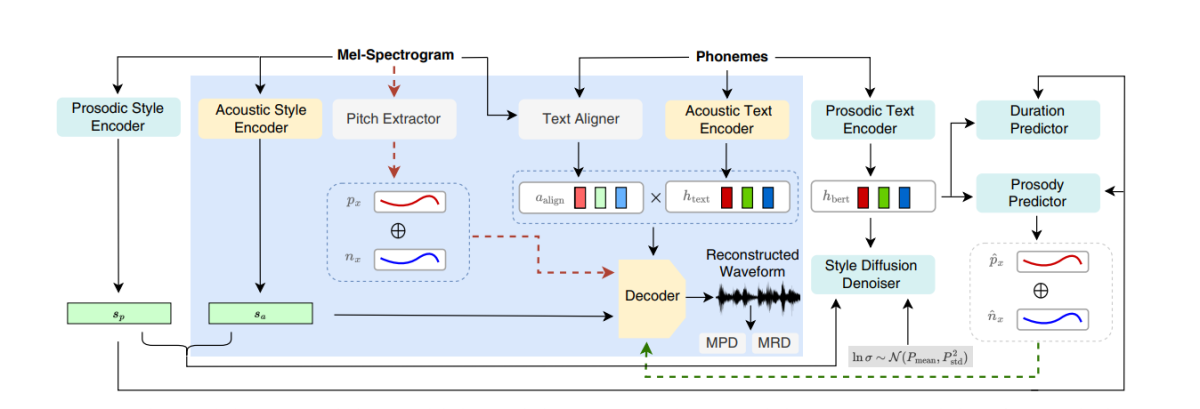

StyleTTS2 の核心は、StyleTTS フレームワークに基づいています。StyleTTS フレームワークは、スタイル エンコーダーを使用して参照オーディオからスタイル ベクトルを導出し、自然なスピーチ生成を可能にします。StyleTTS フレームワークのスタイル ベクトルは、AdaIN (Adaptive Instance Normalization) を使用してエンコーダー、期間、予測器に直接組み込まれています。したがって、StyleTTS モデルは、Prosody、期間、感情が異なるスピーチ出力を生成できます。StyleTTS フレームワークは、3 つのカテゴリに分類される 8 つのモデルで構成されています。

- 音響モデルまたはスピーチ生成システム: スタイル エンコーダー、テキスト エンコーダー、スピーチ デコーダーが含まれます。

- テキストからスピーチへの予測システム: Prosody と期間予測器を使用します。

- ユーティリティ システム: テキスト アライナー、ピッチ抽出器、トレーニング目的のディスクリミネーターが含まれます。

StyleTTS フレームワークは、コントロール可能なスピーチ合成と多様なスピーチ合成に関連する最先端のパフォーマンスを実現しています。ただし、このパフォーマンスには、サンプルの品質の低下、表現の制限、リアルタイム アプリケーションでのスピーチの低下などの欠点があります。

StyleTTS フレームワークを改良した StyleTTS2 モデルは、表現力のあるテキストからスピーチへのタスクを向上させ、分布外のパフォーマンスを改善し、人間レベルの品質を高めています。StyleTTS2 フレームワークは、エンドツーエンドのトレーニング プロセスを使用して、さまざまなコンポーネントを対抗的なトレーニングと直接波形合成を組み合わせて最適化します。StyleTTS フレームワークとは異なり、StyleTTS2 フレームワークは、スピーチ スタイルを潜在的な変数としてモデル化し、拡散モデルを使用してこれらのスピーチ スタイルをサンプリングします。したがって、StyleTTS2 フレームワークは、参照オーディオを使用せずに多様なスピーチ サンプルを生成できます。詳細を見てみましょう。

エンドツーエンド トレーニングによる干渉

StyleTTS2 フレームワークでは、固定コンポーネントに依存せずに、テキストからスピーチへのさまざまなコンポーネントを干渉のためにエンドツーエンドでトレーニングするアプローチを使用します。StyleTTS2 フレームワークは、デコーダーをスタイル ベクトル、ピッチおよびエネルギー曲線、およびアラインド表現から直接波形を生成するように変更することでこれを実現します。次に、デコーダーの最後のプロジェクション層を削除し、波形デコーダーに置き換えます。StyleTTS2 フレームワークは、2 つのエンコーダーを使用します。HifiGAN ベースのデコーダーは直接波形を生成し、iSTFT ベースのデコーダーは位相と大きさを生成し、波形に変換します。

上の図は、事前トレーニングとジョイント トレーニングに使用される音響モデルを示しています。トレーニング時間を短縮するために、モジュールは事前トレーニング段階で最適化され、ジョイント トレーニング段階では、ピッチ抽出器を除くすべてのコンポーネントが最適化されます。ジョイント トレーニングでピッチ抽出器を最適化しない理由は、ピッチ抽出器がピッチ曲線の基準となるからです。

上の図は、WavLM フレームワークを使用したスピーチ言語モデルの対抗的なトレーニングと干渉を示しています。プロセスは、事前トレーニングされた WavLM フレームワークを使用しますが、事前調整は行われません。プロセスは、異なる入力テキストを使用できますが、各バッチで勾配を蓄積してパラメーターを更新します。

スタイル拡散

StyleTTS2 フレームワークは、スピーチを潜在的な変数を通じて条件付き分布としてモデル化することを目的とし、この変数は一般化されたスピーチ スタイルと呼ばれ、音素コンテンツの範囲を超えたスピーチ サンプルの任意の特性を表します。スタイルは、レキシカルなストレス、Prosody、話し手の速度、フォルマント遷移などを含みます。

スピーチ言語モデル ディスクリミネーター

スピーチ言語モデルは、幅広いセマンティクスと音響的側面に関する有価な情報をエンコードする一般的な能力で知られています。スピーチ言語モデルの表現は、従来、人間の認識を模倣して生成された合成スピーチの品質を評価するために使用されてきました。StyleTTS2 フレームワークは、対抗的なトレーニング アプローチを使用して、スピーチ言語モデルのエンコーダーが生成タスクを実行する能力を利用し、12 層の WavLM フレームワークをディスクリミネーターとして使用します。このアプローチにより、フレームワークは OOD (Out of Distribution) テキストのトレーニングを可能にし、パフォーマンスを向上させることができます。さらに、オーバーフィッティングの問題を防ぐために、フレームワークは OOD テキストとインディストリビューション テキストを等しい確率でサンプリングします。

微分可能期間モデリング

従来、テキストからスピーチへのフレームワークでは、音素期間を生成する期間予測器が使用されます。ただし、期間予測器が使用するアップサンプリング方法は、E2E トレーニング中の勾配フローを妨げることがあります。NaturalSpeech フレームワークは、人間レベルのテキストからスピーチへの変換のために、注意ベースのアップサンプラーを使用します。ただし、StyleTTS2 フレームワークは、対抗的なトレーニング中に不安定になるため、このアプローチを使用しません。長さの不一致により、ソフト ダイナミック タイム ワーピング アプローチを使用することは、計算コストが高く、対抗的な目的またはメル再構築タスクで不安定になる可能性があるため、実用的ではありません。したがって、人間レベルのパフォーマンスを実現し、トレーニング プロセスを安定させるために、StyleTTS2 フレームワークは、非パラメトリック アップサンプリング アプローチを使用します。ガウシアン アップサンプリングは、期間の異なるアライメントを正確にモデル化できないため、ガウシアン カーネルの固定長の制限があるため、非パラメトリック アップサンプリングの一般的なアプローチです。

この制限に対処するために、StyleTTS2 フレームワークは、追加のトレーニングなしで、変化するアライメントの長さを考慮できる新しい非パラメトリック アップサンプリング アプローチを提案します。各音素について、StyleTTS2 フレームワークは、アライメントをランダム変数としてモデル化し、音素がアラインメントするスピーチ フレームのインデックスを示します。

モデル トレーニングと評価

StyleTTS2 フレームワークは、VCTK、LibriTTS、LJSpeech の 3 つのデータセットでトレーニングおよび実験されます。StyleTTS2 フレームワークのシングル スピーカー コンポーネントは、LJSpeech データセットでトレーニングされます。LJSpeech データセットには、約 13,000 のオーディオ サンプルが含まれています。これは、12,500 のトレーニング サンプル、100 の検証サンプル、および約 500 のテスト サンプルに分割され、合計実行時間は約 24 時間です。StyleTTS2 フレームワークのマルチ スピーカー コンポーネントは、VCTK データセットでトレーニングされます。VCTK データセットには、100 を超えるネイティブ スピーカーが含まれており、さまざまなアクセントで約 44,000 のオーディオ クリップがあり、43,500 のトレーニング サンプル、100 の検証サンプル、および約 500 のテスト サンプルに分割されています。最後に、ゼロショット適応機能を StyleTTS2 フレームワークに与えるために、LibriTTS データセットでトレーニングされます。LibriTTS データセットには、約 250 時間のオーディオ クリップが含まれており、1,150 を超える個別のスピーカーが含まれています。パフォーマンスを評価するために、モデルは 2 つのメトリックを使用します。MOS-N (自然さの平均意見スコア) と MOS-S (類似性の平均意見スコア) です。

結果

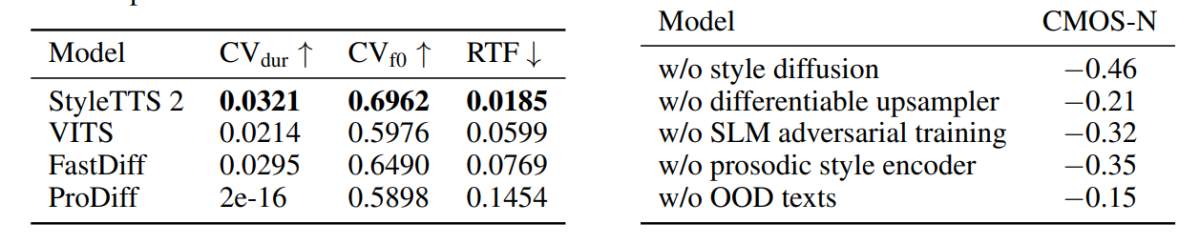

StyleTTS2 フレームワークのアプローチと方法論は、そのパフォーマンスに示されています。StyleTTS2 フレームワークは、NaturalSpeech データセットで最先端の TTS フレームワークを超え、データセットの新しい基準を設定します。さらに、StyleTTS2 フレームワークは、VCTK データセットで最先端の VITS フレームワークを超え、結果は次の図に示されています。

StyleTTS2 モデルは、LJSpeech データセットでも以前のモデルを超えています。さらに、StyleTTS2 フレームワークは、以前のフレームワークと比較して、分布外のテキストで品質の低下を示しません。さらに、ゼロショット設定では、StyleTTS2 モデルは、自然さでは既存の Vall-E フレームワークを超え、類似性では後ろに落ちます。ただし、StyleTTS2 フレームワークは、Vall-E フレームワークの 60,000 時間のトレーニングに比べて、わずか 245 時間のオーディオ サンプルでトレーニングされたため、既存の大規模な事前トレーニング方法の代替手段としてデータ効率が高いことが示されています。

さらに、感情ラベル付きオーディオ テキスト データが不足しているため、StyleTTS2 フレームワークは、GPT-4 モデルを使用して、さまざまな感情に対して 500 を超えるインスタンスを生成します。StyleTTS2 フレームワークの拡散プロセスを使用してスタイル ベクトルを視覚化するために使用されます。

最初の図では、入力テキストの感情に対するスタイル ベクトルが示されており、LJSpeech モデルのスタイル ベクトルを示しています。StyleTTS2 フレームワークがさまざまな感情で表現力のあるスピーチを合成できることを示しています。2 番目の図では、5 人の個別のスピーカーに対して明確なクラスターが形成されており、単一のオーディオ ファイルから得られる幅広い多様性を示しています。最後の図では、スピーカー 1 の感情の緩いクラスターが示されており、重複はあるものの、感情ベースのクラスターが目立っています。つまり、参照オーディオ サンプルや入力トーンに関係なく、スピーカーの感情の調子を操作できる可能性があることを示しています。拡散ベースのアプローチを使用しているにもかかわらず、StyleTTS2 フレームワークは、VITS、ProDiff、FastDiff を含む既存の最先端のフレームワークを超えています。

最終的な考え

この記事では、StyleTTS2 という、StyleTTS フレームワークの基礎に築かれた、新しい革新的なテキストからスピーチへの合成フレームワークについて説明しました。StyleTTS2 フレームワークは、スピーチ スタイルを潜在的なランダム変数としてモデル化し、確率論的拡散モデルを使用してこれらのスピーチ スタイルまたはランダム変数をサンプリングします。StyleTTS2 フレームワークは、スタイル拡散とスピーチ言語モデルのディスクリミネーターを使用して、テキストからスピーチへのタスクで人間レベルのパフォーマンスを実現し、幅広いスピーチタスクで既存の最先端のフレームワークを超えています。