Umjetna inteligencija

GOTCHA– CAPTCHA sustav za Live Deepfake

Novo istraživanje sa Sveučilišta u New Yorku pridodaje rastućim pokazateljima da ćemo uskoro morati polagati deepfake ekvivalent 'testu pijanosti' kako bismo se autentificirali prije započinjanja osjetljivog videopoziva – poput videokonferencije vezane uz posao ili bilo kojeg drugi osjetljivi scenarij koji bi mogao privući prevarante deepfake u stvarnom vremenu softver za strujanje.

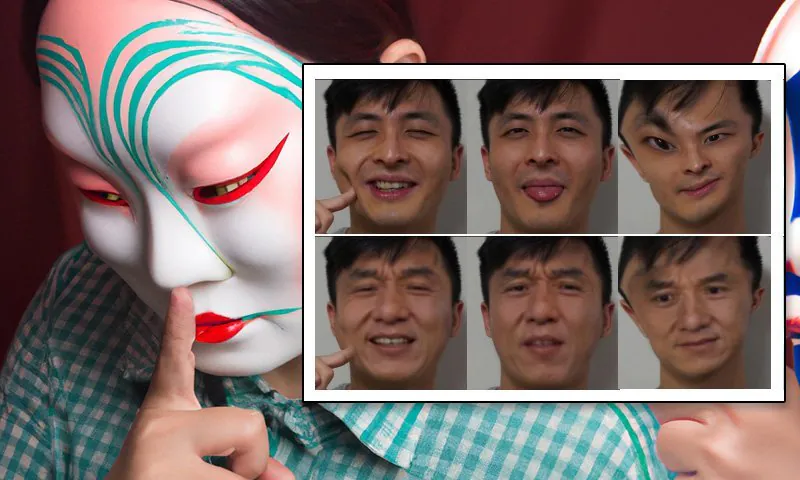

Neki od aktivnih i pasivnih izazova primijenjenih na scenarije videopoziva u GOTCHA. Korisnik mora udovoljiti i proći izazove, dok se koriste dodatne 'pasivne' metode (poput pokušaja preopterećenja potencijalnog deepfake sustava) na koje sudionik nema utjecaja. Izvor: http://export.arxiv.org/pdf/2210.06186

Predloženi sustav je nazvan GOTCHA – posveta CAPTCHA sustavima koji su postali sve veća prepreka web-pretraživanju u posljednjih 10-15 godina, pri čemu automatizirani sustavi zahtijevaju od korisnika izvršavanje zadataka u kojima su strojevi loši, kao što je identificiranje životinja ili dešifriranje iskrivljenog teksta (i, ironično, ti izazovi često okreću korisnika u slobodan AMT-style vanjski anotator).

U biti, GOTCHA produljuje kolovoz 2022 DF-Captcha rad sa Sveučilišta Ben-Gurion, koji je prvi predložio da se osoba s druge strane poziva natjera da skoči kroz nekoliko vizualno semantičkih obruča kako bi dokazala svoju autentičnost.

Rad Sveučilišta Ben Gurion iz kolovoza 2022. prvi je predložio niz interaktivnih testova za korisnika, uključujući zatvaranje lica ili čak pritiskanje kože – zadatke koje čak i dobro uvježbani live deepfake sustavi možda nisu predvidjeli ili mogli fotorealistično riješiti . Izvor: https://arxiv.org/pdf/2208.08524.pdf

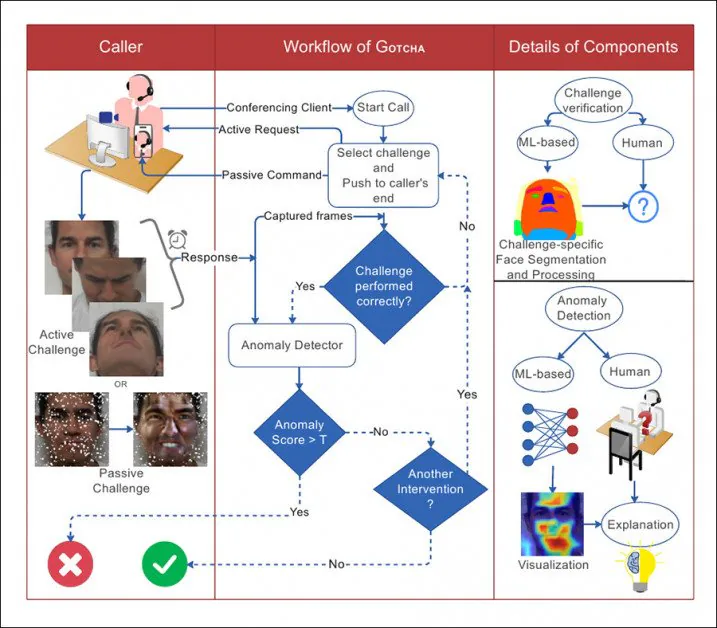

Naime, GOTCHA dodaje 'pasivne' metodologije u 'kaskadu' predloženih testova, uključujući automatsko preklapanje nestvarnih elemenata preko lica korisnika i 'preopterećenje' okvira koji prolaze kroz izvorni sustav. Međutim, samo zadaci koji odgovaraju korisniku mogu se procijeniti bez posebnih dopuštenja za pristup lokalnom sustavu korisnika – što bi, vjerojatno, dolazilo u obliku lokalnih modula ili dodataka popularnim sustavima kao što su Skype i Zoom, ili čak u oblik namjenskog vlasničkog softvera posebno zaduženog za uklanjanje lažnjaka.

Iz papira, ilustracija interakcije između pozivatelja i sustava u GOTCHA, s točkastim linijama dok odluka teče.

Istraživači su potvrdili sustav na novom skupu podataka koji sadrži više od 2.5 milijuna video okvira od 47 sudionika, od kojih je svaki poduzeo 13 izazova iz GOTCHA. Tvrde da okvir izaziva 'konzistentno i mjerljivo' smanjenje kvalitete duboko lažnog sadržaja za prevarantske korisnike, opterećujući lokalni sustav sve dok očigledni artefakti ne razjasne prijevaru golom ljudskom oku (iako GOTCHA također sadrži neke suptilnije metode algoritamske analize).

The novom papiru naslovljen je Gotcha: Sustav odgovora na izazove za otkrivanje lažnih lažnih sadržaja u stvarnom vremenu (ime sustava je velikim slovom u tijelu, ali ne i naslov publikacije, iako nije akronim).

Niz izazova

Uglavnom u skladu s Ben Gurionovim dokumentom, stvarni izazovi s kojima se suočava korisnik podijeljeni su u nekoliko vrsta zadataka.

Za okluzija, od korisnika se traži ili da zakloni svoje lice rukom ili drugim predmetima ili da svoje lice predstavi pod kutom za koji nije vjerojatno da je uvježban u model deepfake (obično zbog nedostatka podataka za uvježbavanje za ' čudne poze – pogledajte niz slika na prvoj ilustraciji iznad).

Osim radnji koje korisnik može sam izvesti u skladu s uputama, GOTCHA može postaviti nasumične izreze lica, naljepnice i filtre proširene stvarnosti, kako bi 'pokvario' tok lica koji lokalno obučeni deepfake model može očekivati, uzrokujući neuspjeh . Kao što je prije navedeno, iako je ovo 'pasivan' proces za korisnika, on je nametljiv za softver, koji mora biti u mogućnosti intervenirati izravno u tok krajnjeg dopisnika.

Zatim, od korisnika se može tražiti da postavi svoje lice u neobične izraze lica koji će vjerojatno ili biti odsutni ili nedovoljno zastupljeni u bilo kojem skupu podataka za obuku, uzrokujući smanjenje kvalitete duboko lažiranog izlaza (slika 'b', drugi stupac slijeva , na prvoj slici iznad).

Kao dio ovog niza testova, od korisnika se može tražiti da pročita tekst ili započne razgovor koji je osmišljen da izazove lokalni sustav za duboko lažiranje uživo, koji možda nije trenirao odgovarajući raspon fonema ili drugih vrsta podataka o ustima do razine gdje može rekonstruirati točan pokret usana pod takvim nadzorom.

Naposljetku (a čini se da ovo dovodi u pitanje glumačke talente krajnjeg dopisnika), u ovoj kategoriji od korisnika se može tražiti da izvede mikroekspresiju – kratak i nehotičan izraz lica koji odbija emociju. O tome, piše list '[to] obično traje 0.5-4.0 sekunde i teško ga je odglumiti'.

Iako rad ne opisuje kako izvući mikroizraz, logika sugerira da je jedini način da se to učini stvoriti odgovarajuću emociju kod krajnjeg korisnika, možda nekom vrstom zapanjujućeg sadržaja koji im se prezentira kao dio rutine testa. .

Izobličenje lica, osvjetljenje i Neočekivani gosti

Dodatno, u skladu s prijedlozima iz kolovoškog rada, novi rad predlaže da se od krajnjeg korisnika traži da izvede neobične facijalne distorzije i manipulacije, kao što je pritiskanje prsta u obraz, interakcija s njihovim licem i/ili kosom i izvođenje drugih kretnje koje niti jedan trenutačni live deepfake sustav vjerojatno neće moći dobro obraditi, budući da su to marginalne radnje – čak i da su prisutne u skupu podataka za obuku, njihova bi reprodukcija vjerojatno bila niske kvalitete, u skladu s drugim 'outlier' podacima.

Osmijeh, ali ovo 'depresivno lice' nije dobro prevedeno lokalnim sustavom deepfake uživo.

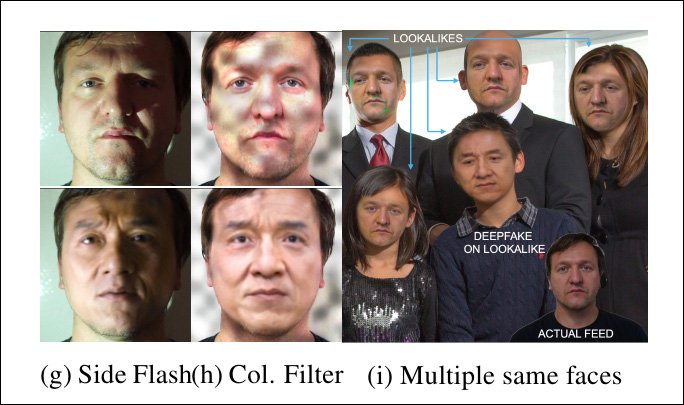

Dodatni izazov leži u promjeni uvjeta osvjetljenja u kojima se krajnji korisnik nalazi, budući da je moguće da je obuka modela deepfake optimizirana za standardne situacije osvjetljenja videokonferencije ili čak točne uvjete osvjetljenja u kojima se odvija poziv. .

Stoga se od korisnika može tražiti da svjetiljkom na svom mobilnom telefonu osvijetli svoje lice ili na neki drugi način promijeni osvjetljenje (i vrijedi napomenuti da je ovaj pristup središnji prijedlog još jedan živi papir za otkrivanje deepfakea koji je izašao ovog ljeta).

Live deepfake sustave izaziva neočekivano osvjetljenje – pa čak i više ljudi u struji, gdje se očekivalo samo jednog pojedinca.

U slučaju da predloženi sustav ima mogućnost ubacivanja u lokalni korisnički tok (za koji se sumnja da skriva deepfake posrednika), dodavanje neočekivanih uzoraka (pogledajte srednji stupac na gornjoj slici) može ugroziti sposobnost deepfake algoritma da održi simulaciju .

Osim toga, iako je nerazumno očekivati da će dopisnik imati dodatne ljude pri ruci koji će mu pomoći u autentifikaciji, sustav može umetnuti dodatna lica (krajnja desna slika iznad) i vidjeti hoće li neki lokalni deepfake sustav pogriješiti preusmjeravanjem pažnje – ili čak i pokušavajući ih sve duboko lažirati (autoenkoder deepfake sustavi nemaju mogućnosti 'prepoznavanja identiteta' koje bi mogle zadržati pozornost usmjerenu na jednu osobu u ovom scenariju).

Steganografija i preopterećenje

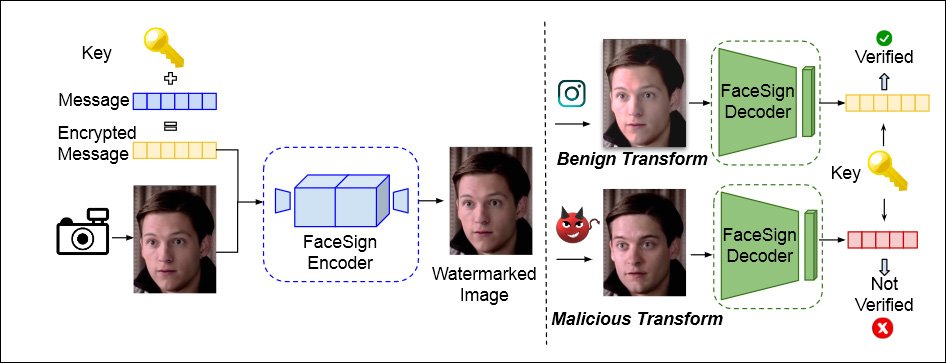

GOTCHA također uključuje pristup prvo predložio od UC San Diego u travnju ove godine, a koji koristi steganografiju za šifriranje poruke u korisnički lokalni videostream. Deepfake rutine će potpuno uništiti ovu poruku, što će dovesti do neuspjeha autentifikacije.

Iz dokumenta iz travnja 2022. sa Sveučilišta Kalifornija San Diego i Državnog sveučilišta San Diego, metoda utvrđivanja autentičnog identiteta tako da se vidi preživi li steganografski signal poslan u korisnički videostream netaknut u lokalnoj petlji – ako ne, lažno lažiranje može biti pri ruci. Izvor: https://arxiv.org/pdf/2204.01960.pdf

Dodatno, GOTCHA je sposoban preopteretiti lokalni sustav (dobivanjem pristupa i dopuštenja), dupliciranjem streama i predstavljanjem 'pretjeranih' podataka bilo kojem lokalnom sustavu, dizajniranom da uzrokuje neuspjeh replikacije u lokalnom sustavu deepfake.

Sustav sadrži daljnje testove (pogledajte članak za detalje), uključujući izazov, u slučaju dopisnika koji se temelji na pametnom telefonu, okretanja telefona naopako, što će iskriviti lokalni sustav deepfake-a:

Opet, ovakva stvar funkcionira samo s uvjerljivim slučajem upotrebe, gdje je korisnik prisiljen odobriti lokalni pristup streamu, a ne može se implementirati jednostavnom pasivnom procjenom korisničkog videa, za razliku od interaktivnih testova (kao što je pritiskanje prst u lice).

Praktičnost

U radu se kratko dotiče do koje mjere testovi ove prirode mogu smetati krajnjem korisniku ili mu na neki način stvarati neugodnosti – na primjer, obvezujući korisnika da ima pri ruci niz predmeta koji bi mogli biti potrebni za testove, kao što su sunčane naočale.

Također priznaje da bi moglo biti teško natjerati moćne dopisnike da se pridržavaju rutina testiranja. U vezi sa slučajem video-poziva s direktorom, autori navode:

'Upotrebljivost bi ovdje mogla biti ključna, tako da neformalni ili neozbiljni izazovi (kao što su iskrivljenja lica ili izrazi) možda nisu prikladni. Izazovi korištenjem vanjskih fizičkih članaka možda nisu poželjni. Kontekst je ovdje prikladno modificiran i GOTCHA prilagođava svoj skup izazova u skladu s tim.'

Podaci i testovi

GOTCHA je testiran protiv četiri vrste lokalnog live deepfake sustava, uključujući dvije varijacije vrlo popularnog autoencoder deepfake kreatora DeepFaceLab ('DFL', međutim, začudo, novine ga ne spominju DeepFaceLive, koji je bio, od kolovoza 2021, 'živa' implementacija DeepFaceLaba i čini se najvjerojatnijim početnim resursom za potencijalnog lažnjaka).

Četiri sustava su DFL trenirana 'lagano' na neslavnoj osobi koja je sudjelovala u testovima i uparenoj slavnoj osobi; DFL je potpunije obučen, na 2m+ iteracija ili koraka, pri čemu bi se očekivao puno učinkovitiji model; Animator latentne slike (LIA); i Generativna kontradiktorna mreža zamjene lica (FSGAN).

Za podatke, istraživači su snimili i kurirali gore spomenute video isječke, koji prikazuju 47 korisnika koji izvode 13 aktivnih izazova, pri čemu je svaki korisnik emitirao oko 5-6 minuta 1080p videa pri 60fps. Autori također navode da će ti podaci u konačnici biti javno objavljeni.

Detekciju anomalija može izvesti ili ljudski promatrač ili algoritamski. Za potonju opciju, sustav je treniran na 600 lica od Skup podataka FaceForensics. Funkcija gubitka regresije bila je moćna naučena perceptualna sličnost slike (LPIPS), dok je binarna unakrsna entropija korištena za obuku klasifikatora. EigenCam korišten je za vizualizaciju težine detektora.

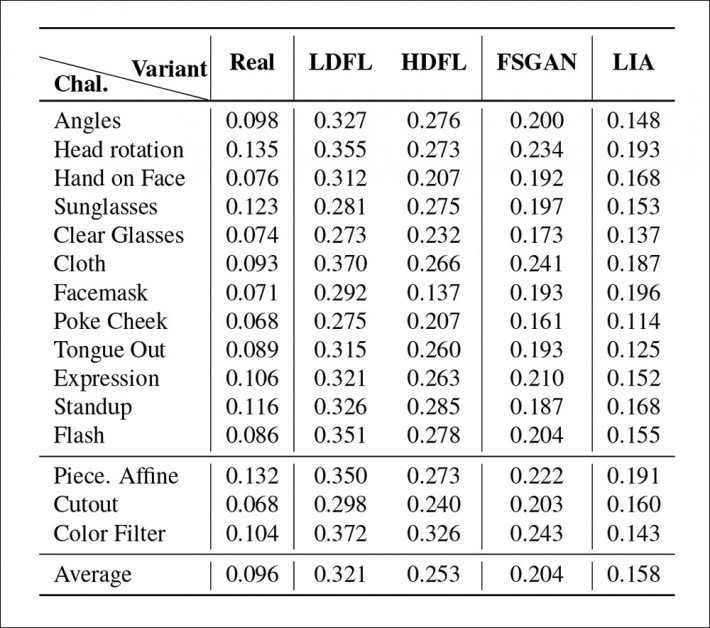

Primarni rezultati testova za GOTCHA.

Istraživači su otkrili da je za punu kaskadu testova u četiri sustava, najmanji broj i ozbiljnost anomalija (tj. artefakata koji bi otkrili prisutnost dubinskog lažnog sustava) dobiveni bolje obučenom DFL distribucijom. Slabije uvježbana verzija posebno se mučila s rekreiranjem složenih pokreta usana (koji zauzimaju vrlo malo okvira, ali dobivaju veliku ljudsku pozornost), dok je FSGAN zauzimao sredinu između dviju DFL verzija, a LIA se pokazala potpuno neprikladnom zadatku , a istraživači smatraju da LIA ne bi uspjela u stvarnoj implementaciji.

Prvi put objavljeno 17. listopada 2022.