Angle d’Anderson

La programmation Vibe souffre lorsque le rôle de l’IA s’étend

Une nouvelle étude constate que la programmation vibe s’améliore lorsque les humains donnent les instructions, mais décline lorsque l’IA le fait, avec le meilleur dispositif hybride qui maintient les humains au premier plan, avec l’IA en tant qu’arbitre ou juge.

De nouvelles recherches aux États-Unis, examinant ce qui se passe lorsque les systèmes d’IA sont autorisés à diriger la programmation vibe, plutôt que de simplement exécuter les instructions humaines, ont constaté que lorsque les grands modèles de langage (LLM) prennent un rôle directionnel plus important, les résultats sont presque toujours pires.

Bien que les chercheurs aient utilisé le GPT-5 d’OpenAI comme cadre pour leurs expériences de collaboration humaine/IA, ils ont confirmé par la suite que l’Claude Opus 4.5 d’Anthropic et le Google Gemini 3 Pro étaient soumis à la même courbe de dégradation à mesure que les responsabilités augmentaient, affirmant que « même une implication humaine limitée améliore constamment les performances » :

‘[Les humains] fournissent des conseils de haut niveau efficaces à travers les itérations, [alors que] les conseils de l’IA mènent souvent à un effondrement des performances. De plus, nous constatons qu’une allocation de rôle soigneuse qui maintient les humains en charge de la direction tout en déchargeant l’évaluation à l’IA peut améliorer les performances hybrides.’

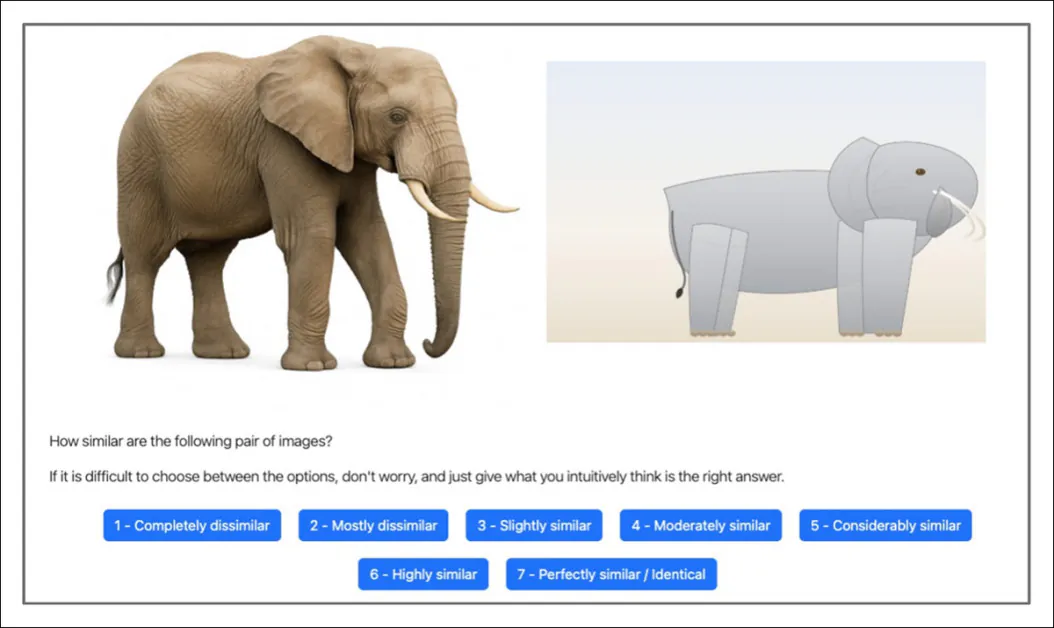

Pour fournir un test cohérent qui puisse être évalué de la même manière par les humains et l’IA, un cadre expérimental contrôlé a été construit autour d’une tâche de codage itérative dans laquelle une image de référence – présentant une photo d’un chat, d’un chien, d’un tigre, d’un oiseau, d’un éléphant, d’un manchot, d’un requin, d’un zèbre, d’un girafe, ou d’un panda – devait être recréée à l’aide de graphiques vectoriels escalables (SVG), et que cette recréation devait être jugée par rapport à l’image source à partir de laquelle elle a été dérivée :

Les participants humains et l’IA ont été présentés une image de référence photographique aux côtés d’une reconstruction SVG générée par l’IA, et ont été invités à évaluer à quel point les deux étaient similaires sur une échelle de sept points. Source

À chaque tour, un agent fournissait des instructions de haut niveau en langage naturel pour guider un générateur de code, et un autre décidait s’il fallait conserver la nouvelle version ou revenir à la version précédente – une boucle structurée qui reflète les flux de travail collaboratifs réels.

Sur 16 expériences impliquant 604 participants et des milliers d’appels d’API, des tours de test entièrement dirigés par des humains ont été comparés directement avec des tours entièrement dirigés par l’IA, dans des conditions identiques.

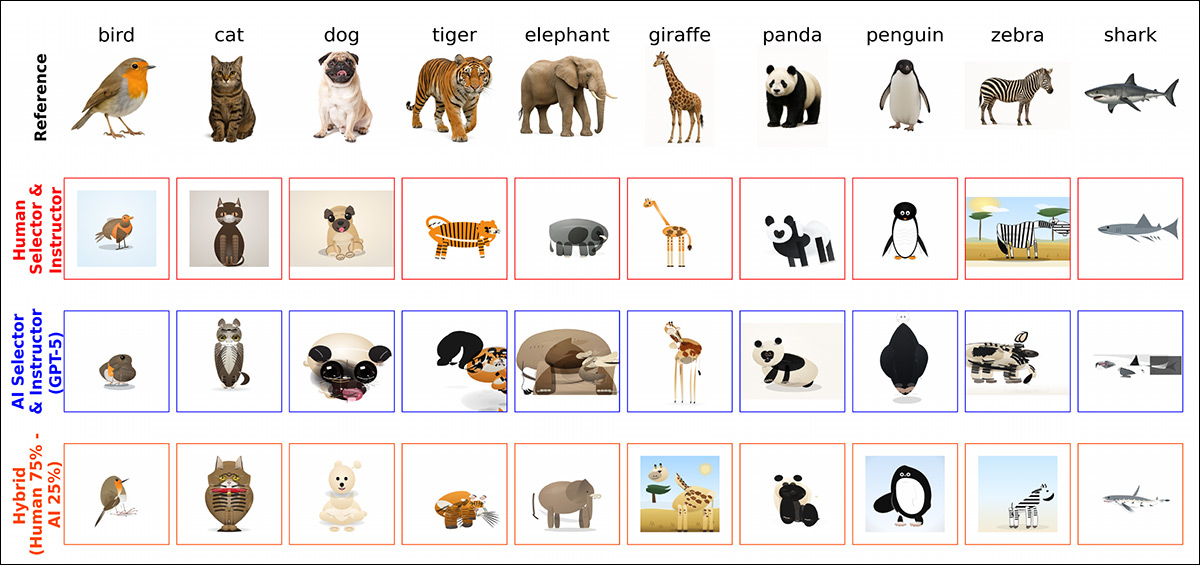

Certaines des solutions variées obtenues par différentes combinaisons de pourcentages et de types de collaboration humaine/IA (prises d’une illustration plus grande dans le document source, auquel nous renvoyons le lecteur).

Bien que les humains et l’IA aient performé à des niveaux similaires au début des tests, au fil du temps, leurs trajectoires ont divergé : lorsque les humains fournissaient les instructions et prenaient les décisions de sélection, les scores de similarité augmentaient à travers les itérations, avec une amélioration cumulative constante ; mais lorsque les systèmes d’IA remplissaient les deux rôles, les performances n’ont montré aucune amélioration constante, et ont souvent décliné au fil des tours – même si le même modèle sous-jacent a été utilisé pour la génération de code, et que l’IA avait accès à la même information que les participants humains.

L’effet de prolixité

Les résultats ont également montré que les instructions humaines étaient généralement courtes et axées sur l’action, se concentrant sur ce qui devait être modifié ensuite dans l’image actuelle ; à l’inverse, les instructions de l’IA étaient beaucoup plus longues et descriptives (un facteur qui a été paramétré pour GPT-5), détaillant les attributs visuels plutôt que de prioriser la correction incrémentale.

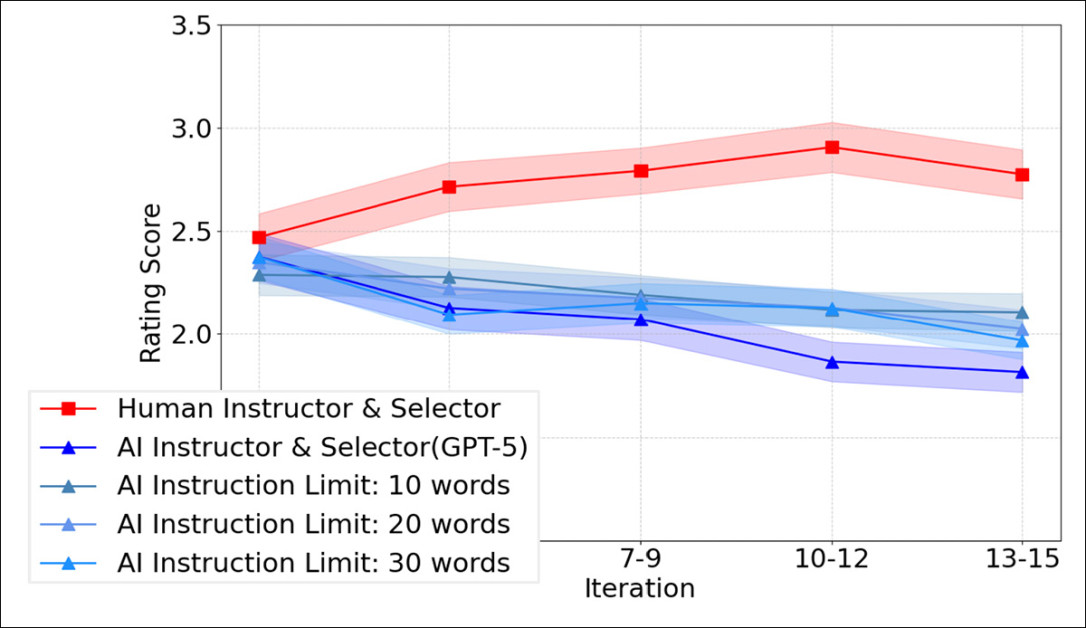

Mais, comme le montre le graphique ci-dessous, imposer des limites de mots strictes aux instructions de l’IA n’a pas inversé le modèle ; même lorsqu’elles étaient limitées à 10, 20 ou 30 mots, les chaînes dirigées par l’IA n’ont pas amélioré les performances au fil du temps :

Évaluations de similarité à travers les itérations pour les tours dirigés par des humains par rapport aux tours entièrement dirigés par l’IA et aux tours dirigés par l’IA limités à 10, 20 ou 30 mots d’instruction. Évidemment, la réduction des invites de l’IA ne prévient pas le déclin des performances itératives observé lorsque l’IA dirige à la fois l’instruction et la sélection.

Les expériences hybrides ont rendu le modèle plus clair, montrant qu’ajouter même un peu d’implication humaine améliorait les résultats, par rapport aux dispositifs entièrement dirigés par l’IA ; cependant, les performances ont généralement décliné à mesure que la part de conseils de l’IA augmentait.

Lorsque les rôles étaient séparés, l’évaluation et la sélection pouvaient être confiées à l’IA avec une perte de qualité relativement faible ; mais remplacer les instructions de haut niveau humaines par des conseils de l’IA a conduit à des baisses de performances remarquables, suggérant que ce qui importe le plus n’est pas qui génère le code, mais qui définit et maintient la direction à travers les itérations.