Angle d’Anderson

La verbosité diminue la précision dans les grands modèles de langage

De nouvelles recherches révèlent que forcer les grands modèles de langage à donner des réponses plus courtes améliore de manière notable la précision et la qualité de leurs réponses.

Quiconque a déjà essayé d’empêcher un chatbot de « bavarder » reconnaîtra les conclusions de ces nouvelles recherches : forcer l’IA à donner des réponses plus courtes la rend plus précise.

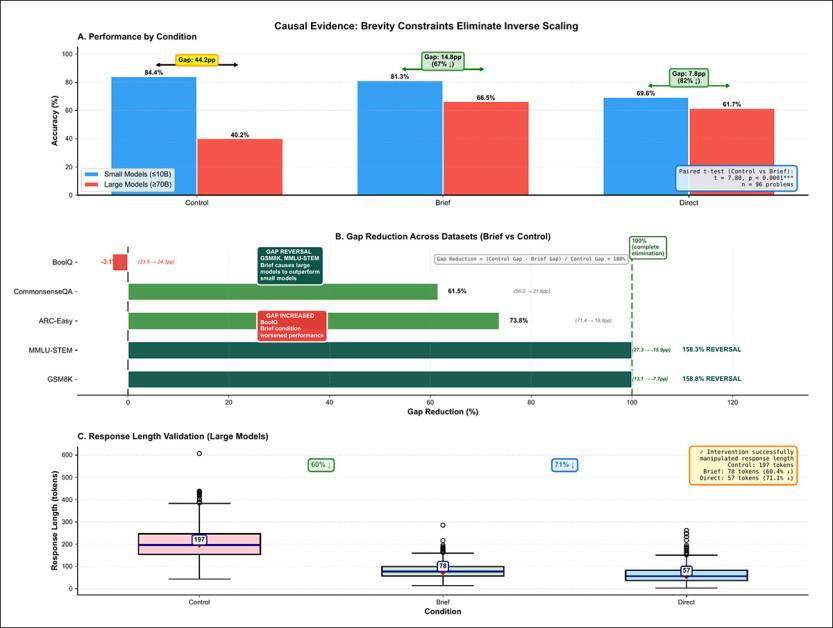

En investiguant les raisons pour lesquelles les plus grands chatbots IA performent moins bien que les plus petits dans certains cas (appelés inverse scaling), les recherches ont constaté que forcer 31 grands modèles de langage (LLM) à donner des réponses plus courtes a entraîné une amélioration de jusqu’à 26,3 % de la précision de leurs réponses :

‘Les résultats fournissent des preuves causales convaincantes : les contraintes de brièveté améliorent la précision des grands modèles de 26,3 points de pourcentage et réduisent l’écart d’inverse scaling de 67 % (de 44,2 % à 14,8 %, test t apparié : t = 7,80, p < 0,0001).’

La verbosité excessive est une plainte fréquente parmi les utilisateurs finals, en particulier parmi ceux qui utilisent des modèles de niveau commercial tels que ChatGPT, où les forums de support mettent en avant ce sujet fréquemment.

Le domaine le plus touché par le remède à la verbosité dans les réponses est les mathématiques, où les IA testées étaient contraintes de répondre en 50 mots ou moins. Pour les tâches de compréhension de lecture, elles étaient limitées à une simple réponse de 10 mots.

Le document définit la tendance de l’IA à la verbosité comme une surenchère, dans laquelle le message central n’est pas seulement obscurci par des verbiages, mais parfois même affecté négativement par celui-ci. Le modèle plus petit est, observe le document, le remède est moins nécessaire, ou fonctionne.

Les recherches concluent qu’il n’y a rien d’architectural qui nécessite d’être abordé pour appliquer cette solution de manière systématique. Cependant, dans une session de chat d’un utilisateur, une directive vers la brièveté devrait probablement être répétée, alors qu’un système de prompt global – qui nécessiterait d’être mis en œuvre comme une défaut d’ingénierie sur des plateformes telles que ChatGPT – pourrait rendre les réponses plus courtes comme comportement par défaut.

Vents contraires

Rien de tout cela n’explique exactement pourquoi les plus grands modèles tendent vers la verbosité, puisque cela affecte également les modèles open source. Le document suggère que les protocoles et les pratiques courantes dans les techniques d’apprentissage par renforcement à partir de la rétroaction humaine (RLHF) pourraient offrir une explication* :

‘Une origine plausible est la formation d’alignement RLHF, où les annotateurs humains récompensent la complétude de manière disproportionnée dans les plus grands modèles ayant une plus grande capacité à agir sur les signaux de longueur – conforme aux différences de verbosité étant plus importantes dans les variantes de modèle de base que dans les variantes de modèle de base.

‘Des travaux antérieurs documentent les biais de longueur systématiques dans les modèles de récompense, où les annotateurs confondent la longueur avec la qualité.

‘Les plus grands modèles, ayant une plus grande capacité à satisfaire les signaux de récompense de longueur, peuvent internaliser la génération verbale plus profondément que les plus petits modèles, produisant le surpensonnement dépendant de l’échelle que nous observons.’

Chez les humains, la verbosité peut survenir pour combler un silence, ou pour masquer des sentiments de gêne, en raison d’une maladie mentale, ou pour cacher un manque de connaissance. En effet, une IA ne pourrait être influencée par ces facteurs qu’à travers l’absorption de données de formation qui reflètent/manifestent ces traits.

Dans les corpus de données, d’autres motivations existent pour des réponses prolixes, telles que l’incitation SEO à produire du contenu texte plus long, par exemple dans les publications de recettes, où la longueur devient (souvent à tort) associée à l’autorité.

Ce qui ne peut pas être entièrement écarté, c’est que les plateformes basées sur les API, incitées à pousser les utilisateurs vers un niveau d’abonnement plus élevé et plus coûteux, encouragent ou ne surveillent pas la verbosité, car elle augmente l’utilisation de jetons de manière assez peu coûteuse, sans avoir besoin d’un raisonnement excessif ou d’appels RAG†.

Le nouveau document est intitulé Les contraintes de brièveté inversent les hiérarchies de performance dans les modèles de langage, et provient du Département d’informatique de l’Institut polytechnique de Suède à Chattogram, au Bangladesh.

Méthode

Pour tester les théories du document, 31 modèles de langage ont été évalués – trop nombreux pour être énumérés sous forme de texte ici, mais représentés dans l’image ci-dessous :

Les grands modèles de langage (LLM) testés dans diverses parties des essais pour le nouveau document.

Les modèles ont été évalués contre cinq collections de référence : GSM8K, pour le raisonnement mathématique ; BoolQ, pour la compréhension de lecture ; CommonsenseQA, pour le raisonnement basé sur le bon sens ; ARC-Easy, couvrant les questions scientifiques ; et MMLU-STEM, également pour les connaissances scientifiques.

Les réponses ont été générées à l’aide de la décoding glouton pour assurer des sorties déterministes, puis extraites avec des règles spécifiques à la tâche, avec une précision mesurée comme le pourcentage de réponses correctes par rapport à la vérité de base.

Les modèles ont été divisés par taille, avec ceux d’une taille inférieure ou égale à dix milliards de paramètres traités comme « petits », et ceux supérieurs à soixante-dix milliards comme « grands », sur la base des écarts de performance observés.

L’inverse scaling a été quantifié en comparant les performances de ces groupes sur chaque problème, en marquant les cas où les plus petits modèles surpassaient les plus grands ; la taille de l’effet statistique a ensuite été utilisée pour confirmer que ces écarts reflétaient des différences cohérentes et significatives plutôt que du bruit.

Éliminer le rappel

Pour écarter la possibilité que les modèles se contentent simplement de se souvenir des données de formation, trois vérifications distinctes ont été effectuées, examinant à quel point les réponses étaient variées ; à quel point leur longueur fluctuait ; et comment les erreurs étaient commises. Si les modèles reposaient sur des modèles mémorisés, les réponses tendraient à se répéter ou à suivre des modèles fixes ; au lieu de cela, les réponses se sont avérées principalement uniques entre les modèles, avec une variation notable de la longueur, d’une réponse à l’autre.

Les erreurs ont également été inspectées directement, avec la plupart des échecs prenant la forme de longues explications incorrectes, plutôt que de courtes réponses évasives – indiquant que les modèles génèrent un raisonnement réel. plutôt que de récupérer des réponses stockées.

Données et tests

Lors des tests pour des questions individuelles plutôt que pour des scores globaux, une grande partie des tâches de référence s’est avérée non informative, avec 27,1 % ne parvenant pas à séparer les modèles du tout parce que soit tous les systèmes ont réussi, soit tous les systèmes ont échoué, ne laissant aucun signal réel sur les performances relatives :

La ventilation au niveau des problèmes à travers cinq références a montré qu’une part importante des tâches n’a pas distingué les modèles, tandis qu’une petite mais constante partie a présenté un inverse scaling, où les plus petits modèles ont surpassé les plus grands. La distribution globale à travers 1 485 problèmes indique que 7,7 % présentent un inverse scaling. Source

Parmi les questions qui ont distingué les modèles, la plupart se sont comportés comme prévu, avec les plus grands systèmes performant mieux, mais un petit groupe a montré le schéma inverse, avec les plus petits modèles prenant les devants. À travers tous les problèmes, l’inverse scaling est apparu dans 7,7 % des cas, indiquant que l’effet n’est pas marginal.

L’inverse scaling émerge

À travers les cinq références, 115 problèmes ont été trouvés où les plus petits modèles ont surpassé les plus grands, constituant 7,7 % de l’ensemble des 1 485 tâches, indiquant que l’inverse scaling n’est pas une occurrence rare ou marginale dans ce contexte.

En fait, l’effet s’est manifesté dans tous les ensembles de données : le plus fortement dans BoolQ, et plus faiblement dans CommonsenseQA, ARC-Easy, GSM8K et MMLU-STEM, indiquant qu’il est répandu, mais varie selon la tâche :

L’inverse scaling est apparu à travers toutes les références, allant de 3,9 % dans MMLU-STEM à 11,3 % dans BoolQ, avec 115 problèmes au total. Les écarts de performance ont favorisé les plus petits modèles d’un point de pourcentage moyen de 28,4. La précision a diminué à mesure que la taille du modèle augmentait, avec les plus petits modèles atteignant 66,1 %, par rapport à 41,5 % pour les plus grands.

La taille de l’écart s’est avérée substantielle, avec les plus petits modèles en tête d’un point de pourcentage moyen de 28,4, et chaque cas montrant le même sens d’avantage, indiquant une baisse de performance cohérente, plutôt que des erreurs occasionnelles ou ad hoc.

Le même schéma s’est maintenu à travers les différentes familles de modèles, y compris Llama, Qwen, Gemma, et Mistral, où les versions plus grandes sous-performaient par rapport aux plus petites, avec une précision tendant à diminuer à mesure que la taille du modèle augmentait sur ces problèmes.

L’écart entre les plus petits et les plus grands modèles était suffisamment important pour que le hasard ne puisse pas l’expliquer ; et parce que le même schéma est apparu à travers différentes références, tâches et familles de modèles, l’inverse scaling est apparu comme un effet cohérent plutôt que aléatoire.

En regardant à l’intérieur de chaque famille de modèles, les versions plus grandes ont répétitivement performé moins bien que les plus petites sur ces problèmes, suggérant que la baisse pourrait être liée à l’échelle elle-même, plutôt qu’aux différences de conception.

Les résultats montrent également qu’il existe une limite pour chaque tâche, où l’augmentation de la taille du modèle commence à nuire à la performance, montrant que les plus grands modèles ne conduisent pas toujours à de meilleurs résultats.

Examiner le surpensonnement

Ayant établi que les plus grands modèles performaient parfois moins bien dans certains domaines, l’analyse s’est tournée vers la raison pour laquelle cela se produit, en proposant que le problème n’est pas un manque de capacité, mais trop d’explication – c’est-à-dire des cas où des réponses plus longues commencent à obscurcir le raisonnement correct.

À travers les données, des réponses plus longues ont été liées à une précision plus faible sur ces problèmes difficiles, même si les grands et les petits modèles ont produit un nombre similaire d’étapes de raisonnement, suggérant que le problème n’est pas la quantité de raisonnement effectué, mais la façon dont il est exprimé :

Des réponses plus courtes améliorent les performances des grands modèles et réduisent l’écart avec les plus petits modèles, réduisant la différence de 44,2 points de pourcentage à 14,8 (et dans certains cas, l’inversant complètement), tandis que les formats de réponses directes rétrécissent encore davantage. Les gains les plus importants sont apparus dans GSM8K et MMLU-STEM, où les classements ont basculé en faveur des plus grands modèles, et les vérifications de longueur de réponse ont confirmé que l’intervention a fonctionné, avec des sorties passant d’environ 197 jetons à moins de 80, reliant la verbosité réduite à une précision améliorée.

Lorsque les réponses étaient forcées d’être plus courtes, les grands modèles ont amélioré de manière significative, réduisant un écart de performance considérable, et, dans certains cas, l’ont presque éliminé. À l’inverse, les plus petits modèles ont changé très peu, indiquant que la verbosité nuisait activement aux plus grands systèmes.

L’effet s’est avéré varier selon la tâche, avec certaines références bénéficiant fortement de réponses plus courtes, et d’autres nécessitant un certain degré d’explication ; mais dans plusieurs cas, le classement entre les plus petits et les plus grands modèles a complètement basculé une fois que la verbosité a été contrainte, révélant que les plus grands modèles avaient une capacité cachée qui était masquée par une surenchère.

Une analyse plus approfondie a montré que les plus grands modèles tendaient à produire des sorties plus longues dans l’ensemble, malgré l’utilisation de légèrement moins d’étapes de raisonnement explicites, indiquant un style de raisonnement plus diffus et moins structuré.

À l’inverse, les plus petits modèles ont donné des réponses plus courtes et plus directes, suggérant que la façon dont le raisonnement est exprimé, plutôt que la quantité de raisonnement elle-même, est à l’origine de la baisse de performance.

Les auteurs concluent en général que les contraintes de brièveté apportent des avantages en termes de précision, et considèrent que cela pourrait devenir une fonctionnalité fondamentale dans les modèles de langage, plutôt qu’une contrainte répétitive et appliquée par l’utilisateur qui ne survive pas d’une session à l’autre ; et ils déclarent :

‘Les contraintes [de brièveté] aident les grands modèles de manière spectaculaire, tout en affectant à peine les plus petits modèles.

‘Si la verbosité était incidente plutôt que causale, des changements d’exactitude uniformes seraient attendus à travers les deux catégories de taille. La réponse différentielle confirme que le surpensonnement est un mode d’échec spécifique à l’échelle, et non un effet de difficulté de tâche.’

Conclusion

Au-delà des versions open source testées par les chercheurs, le problème de verbosité apparaît, de manière anecdotique, avec une certaine fréquence à travers de nombreux modèles majeurs autres que ChatGPT, notamment Claude, Gemini, et Grok.

Que ces plateformes ignorent ou non le problème de verbosité parce qu’il augmente l’utilisation de jetons et encourage les dépenses plus élevées†, il ne semble pas raisonnable qu’elles acceptent la baisse de précision qui l’accompagne.

Il serait intéressant de voir si une méthode empirique pourrait déterminer avec certitude d’où vient la tendance à la verbosité. Quiconque a déjà essayé d’obtenir qu’un chatbot discute réellement, plutôt que de fournir des réponses verbales et multétapes aux utilisateurs, a réalisé que le modèle a été gravement imprégné de guides « tout-en-un » et de « solutions acceptées » dans ses données de formation.

Il serait donc très intéressant de voir si un modèle spécifiquement formé sur des conversations étape par étape pourrait réellement s’éloigner de la tendance à la verbosité et à la synthèse. Cependant, il semble probable que certaines contraintes ou filtres devraient être placés sur le poids que le modèle est formé pour accorder à la « réponse décidée », afin qu’il se forme directement également sur le matériel précédent – essentiellement, le raisonnement explicite dans les conversations basées sur les tours.

Puisque des données appropriées de ce type semblent susceptibles d’être rares, peut-être que la seule voie à suivre avec cette approche serait via des données synthétiques, dans lesquelles des conclusions « composées » finales sont décomposées de manière conversationnelle – ironiquement, de la même manière que les podcasts IA que Google NotebookLM peut interpréter à partir de l’entrée de texte simple.

* Ma conversion des citations en ligne des auteurs en hyperliens.

† Mais soyons honnêtes, le déficit entre les coûts réels de fourniture d’IA et les frais d’abonnement est actuellement si important que cela nuirait à la réputation de la base d’utilisateurs sans résoudre les graves problèmes économiques de cette phase de la « conversion » et de la « convergence » de l’IA.

Publié pour la première fois dimanche 5 avril 2026