Angle d’Anderson

Les données ‘Rogue’ polluant les performances des IA génératives

Une nouvelle étude constate que de nombreux jeux de données d’images populaires utilisés pour entraîner les modèles d’IA sont contaminés par des images de test ou des quasi-duplicats, permettant aux modèles de tricher en mémorisant les réponses au lieu d’apprendre. Les fuites sont généralisées mais généralement non détectées, gonflant discrètement les scores et donnant un avantage injuste aux modèles formés sur des données à l’échelle du web.

Lorsque vous passez un examen de conduite, on ne vous indique généralement pas à l’avance exactement quels routes seront utilisées pour l’examen. Si c’était le cas (et que vous manquiez un peu d’intégrité), vous pourriez « optimiser » pour l’examen en pratiquant à plusieurs reprises sur cette route, au lieu de développer des compétences de conduite plus larges qui peuvent gérer n’importe quelle route de manière raisonnable.

Dans la formation de modèles d’apprentissage automatique, c’est une analogie raisonnable pour un test split – une division des données du jeu de formation entre (généralement) une division de 70 % pour les données qui seront utilisées pour former le modèle, avec les 30 % restants utilisés comme données « dans la nature ».

Puisque les données dans la nature n’ont jamais été vues par le modèle, si le modèle se comporte bien sur ces données, on peut supposer qu’il est efficace et performant ; si ce n’est pas le cas, le modèle peut avoir surapprentissage sur un ensemble équilibré – ou bien les données nécessitaient une curatorisation et une définition supplémentaires.

De toute façon, ne pas évaluer les modèles sur leurs données de formation est la pierre angulaire de la méthode actuelle dans la recherche et le développement en IA.

Same Again, Please

Selon un nouveau document de recherche du Japon, le secteur de la recherche en vision par ordinateur et en IA générative n’a pas du tout égalé les efforts des chercheurs en LLM pour s’assurer que les données de test ne polluent pas les données de formation ; lors des tests, les chercheurs ont constaté que chaque jeu de données à grande échelle qu’ils ont étudié, y compris ceux qui alimentent certains des plus grands systèmes d’IA générative actuels, a dans une certaine mesure permis à ses données de test de se croiser avec ses données de formation – ce qui signifie que les références et les rapports de performance pour les modèles formés sur ces divisions ne seront pas plus précis qu’un résultat d’examen de quelqu’un qui a introduit une copie dans la salle d’examen, et ne refléteront pas les performances réelles dans des données vraiment nouvelles.

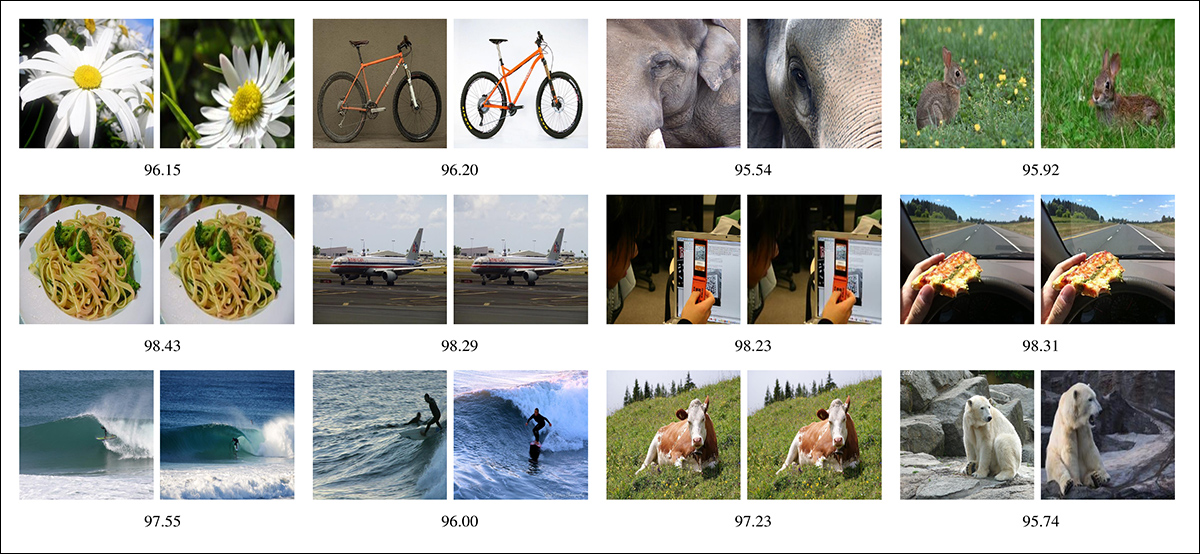

Exemples de contamination des données trouvés par les chercheurs, où des points de données en double ou quasi-doubles existent à la fois dans les données de formation et de test. Source : https://arxiv.org/pdf/2508.17416

Dans l’image ci-dessus, issue du nouveau document, nous voyons des exemples de points de données en double ou quasi-doubles trouvés à la fois dans les données de formation de base et les données de test de divers modèles – suffisamment pour invalider les performances du modèle sur ces données, et gonfler légèrement ses scores généraux dans l’ensemble, facilitant l’apparence d’un niveau de généralisation que le modèle n’a peut-être pas réellement atteint.

Pour aggraver les choses, la contamination semble se produire dans une diversité de scénarios possibles, notamment la ‘préformation‘, où les poids des modèles ancestraux plus anciens sont utilisés pour « lancer » un nouveau modèle. Si le modèle ancestral en amont a certaines des mêmes données que le nouveau jeu de données qui est préformé, alors une contamination croisée peut se produire même si la division 70/30 ou 80/20 est propre.

Cumulative Effect

Il est presque certain que cela se produira même dans les derniers jeux de données : la portée des jeux de données de vision/langue a considérablement augmenté au cours des cinq dernières années, englobant non seulement les nouvelles données d’images sur le web, mais également récoltant une grande partie des mêmes données qui peuplaient ces anciens jeux de données historiques.

De plus, les routines automatisées conçues pour traquer et filtrer des milliards d’images pour les doublons et les quasi-doublons sont maintenant confrontées à une tâche si lourde que la curatorisation elle-même – son coût en termes de temps et d’argent – doit désormais être considérée dans le contexte des limites budgétaires.

Pendant ce temps, la duplication d’images est une conséquence inévitable du type de ad hoc de traçage web derrière de vastes collections telles que Common Crawl, en raison de la pratique courante de réaffichage et de recompression d’images, et d’application d’éditions telles que des crops, et même de retournement (pour éviter la détection, lorsque l’image peut avoir été utilisée sans autorisation, par exemple).

Les auteurs observent* :

‘La fuite de données est un problème répandu, prévalent dans la plupart des jeux de données visuels. La fuite peut obscurcir la capacité de généralisation des modèles, ce qui est particulièrement problématique lors de la comparaison de modèles formés sur différents jeux de données, conduisant à des comparaisons injustes.

‘Nous exhortons les concepteurs de jeux de données à considérer soigneusement les implications de ces évaluations. Pour une évaluation de modèle plus équitable, nous recommandons l’utilisation de détecteurs de doublons qui prennent en compte à la fois les fuites dures et douces.

‘Idéalement, les images fuies devraient être supprimées de l’ensemble de formation, et si ce n’est pas possible, elles devraient au moins être supprimées de l’ensemble de test.’

Le document élabore sur un certain nombre de tests que les chercheurs ont effectués sur des jeux de données massifs et populaires – chacun d’entre eux a montré un certain niveau de contamination.

Le nouveau document est intitulé Fuite de données dans les jeux de données visuels, et provient de trois chercheurs de l’Université d’Osaka.

Méthode

Les auteurs du document définissent la fuite en termes de trois dimensions : modalité, couverture et degré.

Modalité distingue si seules les images sont fuies ou si les images et les étiquettes sont exposées ; couverture identifie si le chevauchement se produit au sein du même jeu de données ou entre différents jeux de données ; et degré définit si le contenu dupliqué est exactement le même ou simplement adjacent.

En ce qui concerne la fuite, les deux scénarios considérés dans le travail sont fuite intra-jeu de données (où les images d’évaluation réapparaissent dans la division de formation du même jeu de données), et fuite inter-jeux de données (où les images d’évaluation d’un jeu de données sont présentes dans un autre jeu de données utilisé pour la formation).

En ce qui concerne le degré, les deux niveaux définis sont fuite douce (où les images ne sont pas identiques mais présentent des variations mineures), et fuite dure (où les images sont exactement les mêmes dans les formations et les évaluations).

Les chercheurs abordent la détection de la fuite en termes de récupération d’images, en utilisant des encodeurs d’images pour représenter chaque image comme un vecteur de fonctionnalités. L’ensemble de requête est les données d’évaluation, tandis que la collection est l’ensemble de formation.

Pour les plus petits jeux de données, chaque vecteur de requête a été directement comparé à tous les vecteurs de formation à l’aide de similarité cosinus. Pour les plus grands jeux de données, un index Faiss a été créé pour permettre une recherche plus rapide de K-Nearest Neighbors (KNN).

Puisque l’encodeur doit capturer suffisamment d’informations visuelles pour détecter des similitudes subtiles, mais doit rester efficace face à des volumes de données très élevés, les auteurs ont reposé sur les fonctionnalités CLIP précalculées mises à disposition par les créateurs de jeux de données, dans le cas de la collection LAION qui sous-tend la diffusion stable, et des projets ultérieurs.

Les auteurs notent que permettre à CLIP d’utiliser sa compréhension distillée du jeu de données (au lieu de sonder les fichiers réels à grande échelle) a considérablement accéléré le processus et offert une meilleure cohérence entre les comparaisons.

Données et tests

L’encodeur d’images CLIP utilisé dans les tests pour le nouveau travail était le CLIP ViT-B/32 d’origine utilisé pour tamiser LAION. Pour établir si des images diverses étaient liées les unes aux autres, KNN a été utilisé sous AutoFaiss.

Les jeux de données ont été regroupés en trois types : jeux de données de préformation – de grandes collections de web-scraping utilisées pour former des modèles généralistes ; jeux de données de formation – de plus petites collections, souvent annotées, destinées à l’ajustement direct du modèle ; et jeux de données de référence – manuellement annotés, et utilisés exclusivement pour l’évaluation.

L’analyse a couvert vingt divisions à travers sept jeux de données : Microsoft COCO a été utilisé à la fois comme ensemble de formation et d’évaluation, incorporant les divisions de formation, de validation, de test et non étiquetées ; Flickr30k a servi exclusivement de référence ; et la collection Google Conceptual Captions (GCC) a été traitée comme une source de préformation, avec sa partie de validation également utilisée pour l’évaluation.

De plus, ImageNet a été utilisé à la fois pour la formation et la référence, tandis que le jeu de données LAION-400M a été utilisé uniquement pour la préformation.

OpenImages v4 a contribué aux données de formation et de référence, et TextCaps a fourni à la fois des divisions de formation et de test pour l’évaluation.

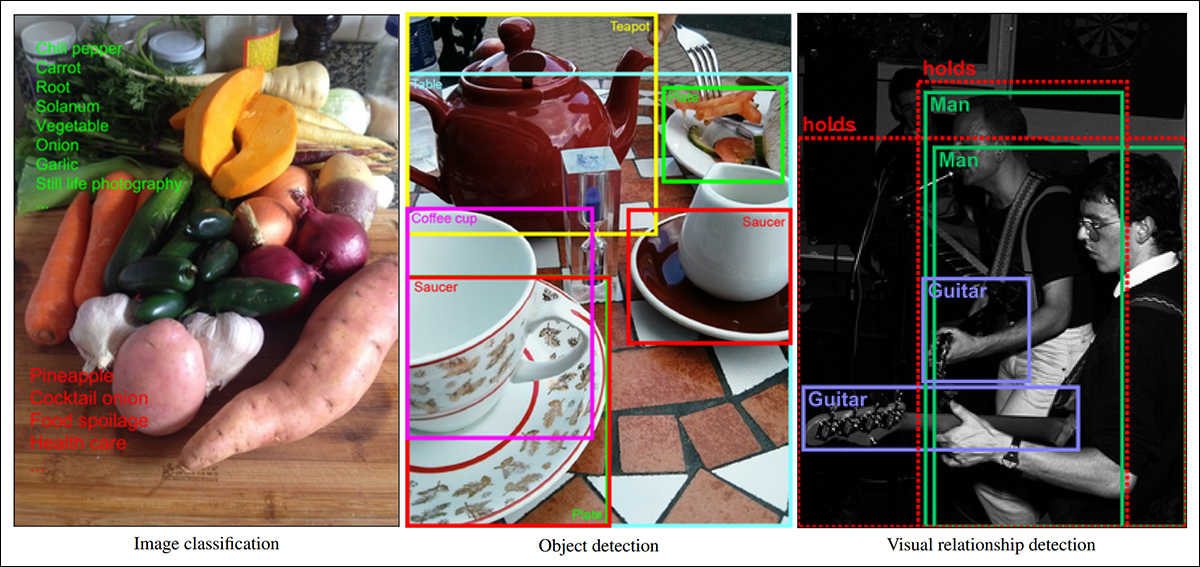

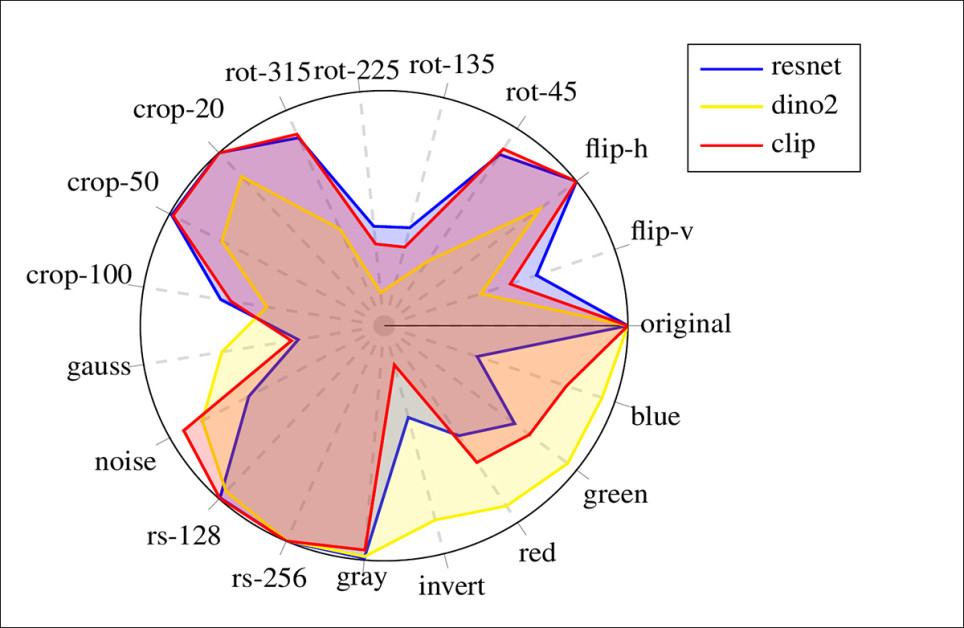

Exemples d’annotations d’images de l’ensemble de données Open Images de Google, examiné dans le nouveau travail. Source : https://arxiv.org/pdf/1811.00982

Pour évaluer à quel point la méthode peut détecter la fuite lorsque les images ont été subtilement modifiées par le redimensionnement, la découpe ou des transformations non sémantiques similaires, les auteurs ont testé sur Flickr30k, en sélectionnant aléatoirement 5 000 images comme requêtes, et en utilisant l’ensemble du jeu de données comme collection de référence.

Chaque image de requête a été transformée avant d’être encodée (c’est-à-dire soumise à une modification non sémantique telle que le redimensionnement ou la découpe), puis mise en correspondance avec l’élément le plus similaire de la collection à l’aide de la similarité cosinus ; une correspondance n’a été comptabilisée que si l’image originale a été récupérée comme résultat principal.

Les trois encodeurs comparés étaient ResNet-152 ; DINOv2 ViT-B/14 ; et CLIP ViT-B/32.

Quatre types de transformations d’images non sémantiques ont été utilisés : géométriques (retournements et rotations) ; découpe (suppression de 20, 50 ou 100 pixels de chaque bord) ; pixelisation (flou gaussien, ajout de bruit ou downsampling à 128 ou 256 pixels) ; et couleur (niveaux de gris, inversion ou surimpression rouge, verte ou bleue).

À partir du matériel supplémentaire, exemples de transformations appliquées aux données – routines typiques également dans le prétraitement de l’augmentation de données.

Les auteurs ont ensuite testé la fuite dans la récupération d’images :

Précision de détection de fuite sur 5 000 images de requête Flickr30k soumises à diverses transformations non sémantiques.

Les trois encodeurs ont obtenu des performances parfaites sur les images non modifiées, et CLIP est resté fiable à travers la découpe, les retournements horizontaux, le bruit et le redimensionnement, surpassant ResNet sur les modifications de niveau de pixel et de couleur.

DINOv2 a montré une résilience forte aux transformations de couleur (probablement en raison de sa conception auto-supervisée, estiment les auteurs), mais a été nettement plus faible sur les éditions géométriques et la découpe – les deux étant courantes dans les jeux de données dupliqués.

Puisque LAION inclut déjà des embeddings CLIP, et compte tenu de sa robustesse et de sa vitesse constantes, CLIP a été choisi comme encodeur par défaut pour l’analyse principale.

Fuite dure et douce

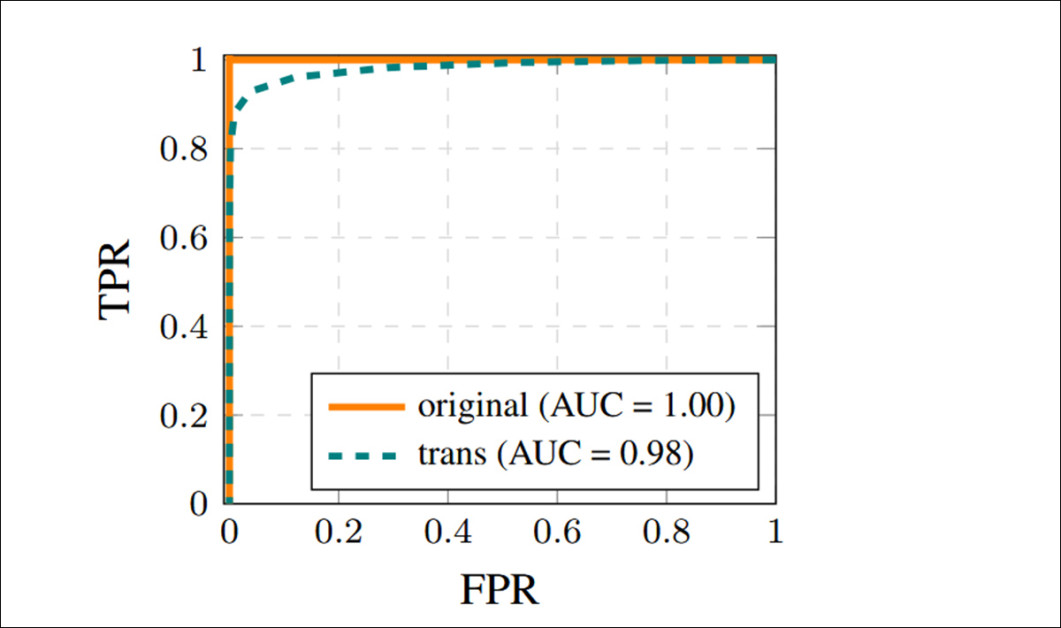

Les performances ont été évaluées à travers différents seuils de similarité cosinus pour distinguer les images en double exact et les images quasi-doubles (fuite dure et douce).

Un seuil de 0,98 a été sélectionné pour définir la fuite dure, aboutissant à aucune fausse positive et à une détection parfaite d’images identiques.

Pour la fuite douce, un seuil de 0,95 a été choisi, permettant à davantage de quasi-doublons d’être récupérés tout en maintenant un taux de fausses positives presque nul. La priorité a été donnée à la précision plutôt qu’à la recall, et les résultats ont donc été estimés de manière conservatrice :

Courbes de caractéristique de fonctionnement du récepteur ont été utilisées pour guider la sélection des seuils durs et doux pour la détection de fuite. Des scores AUC élevés dans les conditions transformées et non transformées démontrent que les quasi-doublons peuvent être distingués de manière fiable des images non liées, même lorsque des modifications minimales sont présentes.

Fuite intra-jeu de données

La fuite intra-jeu de données a été calculée en identifiant le chevauchement d’images entre les divisions de formation et d’évaluation au sein du même jeu de données. Seuls les jeux de données disposant à la fois de divisions de référence et de formation ou de préformation ont été pris en compte, ce qui a réduit l’analyse à COCO, GCC, ImageNet, OpenImages et TextCaps.

Pour COCO, l’ensemble de test a été comparé à l’ensemble de formation, à l’ensemble d’évaluation et aux sous-ensembles non étiquetés, et l’ensemble de validation a été comparé aux ensembles de formation et non étiquetés.

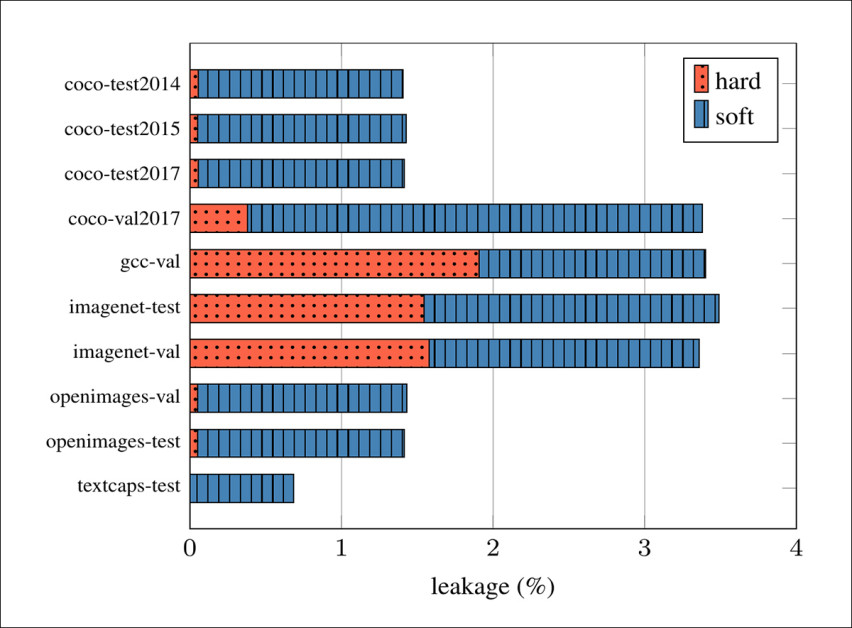

Les taux les plus élevés de fuite intra-jeu de données ont été observés dans les ensembles de test et de validation d’ImageNet, avec une fuite dure atteignant jusqu’à 1,58 % et une fuite douce juste en dessous de 2 %. GCC et COCO ont suivi, COCO val2017 montrant une fuite douce de 3 % et ses divisions de test allant de 1,35 % à 1,38 %. OpenImages a présenté une faible fuite dure à 0,05 %, mais la fuite douce a dépassé 1,3 % dans les ensembles de test et de validation. TextCaps a montré la fuite globale la plus faible, à 0,69 %, avec aucune fuite dure détectée :

Taux de fuite intra-jeu de données, montrant la proportion de chaque ensemble d’évaluation qui chevauche ses données de formation associées.

En ce qui concerne ces résultats, les auteurs déclarent† :

‘Ces résultats montrent que la fuite intra-jeu de données se produit dans tous les jeux de données analysés, soit dans son degré dur ou doux.

‘Compte tenu que la fuite de données peut compromettre l’évaluation du modèle et que les jeux de données sont spécifiquement conçus à cette fin, la fuite intra-jeu de données est un risque qui par conception ne devrait pas exister.

‘Pourtant, nous avons identifié de multiples instances dans tous les jeux de données.’

Fuite inter-jeux de données

Pour mesurer la fuite inter-jeux de données (où un modèle est formé sur un jeu de données et évalué sur un autre), quatre jeux de données ont été utilisés comme sources de données de formation : GCC de formation, ImageNet de formation, OpenImages de formation, et LAION.

Ces derniers ont été mis en correspondance avec les données d’évaluation tirées de la division de test de COCO 2014, Flickr30K, TextCaps test, la division de test et de validation d’OpenImages, et la division de test et de validation d’ImageNet.

Les embeddings CLIP ViT-B/32 ont été extraits pour tous les jeux de données, à l’exception de LAION, qui fournit ses propres embeddings précalculés. Cependant, puisque ces embeddings diffèrent légèrement de ceux générés à l’aide de la mise en œuvre officielle de CLIP, les images de requête ont été rééchelonnées conformément à la méthode utilisée dans le référentiel clip-retrieval pour assurer la compatibilité.

La récupération a été effectuée à l’aide d’une recherche KNN, bien que l’échelle de LAION ait nécessité un partitionnement en blocs d’images d’un million, avec chaque bloc indexé séparément :

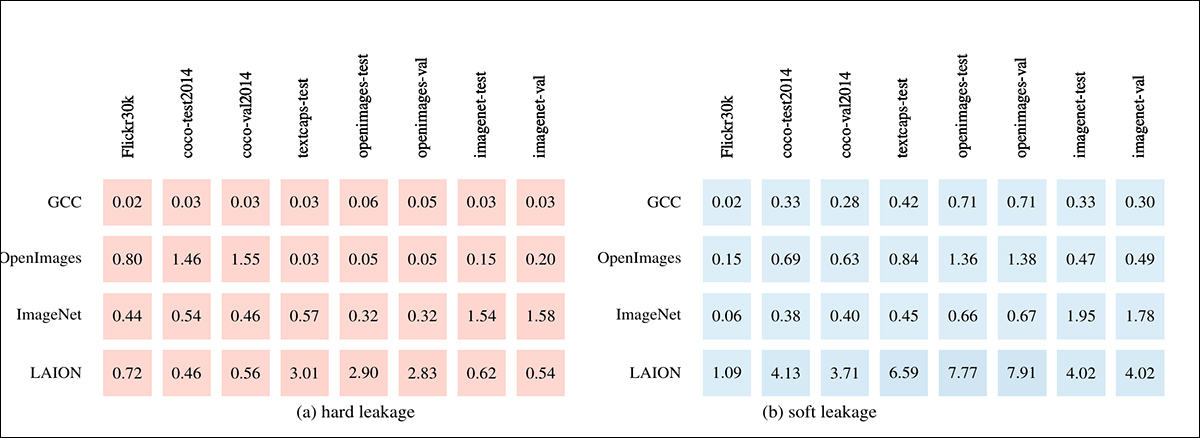

Fuite inter-jeux de données entre les jeux de données de référence (colonnes) et les jeux de données de préformation (lignes). Sur le côté gauche, nous voyons la ‘fuite dure’ (images identiques), et sur le côté droit la ‘fuite douce’ (quasi-doublons).

La fuite inter-jeux de données a été observée à travers tous les jeux de données de référence, avec des degrés de gravité variables. LAION a montré les taux les plus élevés de fuite dure (images identiques), en particulier pour les données de test d’OpenImages et TextCaps, dépassant chacune 3 %. OpenImages a également contribué à une petite quantité de fuite dure à COCO.

Bien que moins grave, ImageNet contenait encore des doublons durs provenant de chaque référence examinée ; et GCC a montré la fuite dure globale la plus faible, en dessous de 1 %.

La fuite douce (quasi-doublons) était plus répandue : LAION a encore produit les taux les plus élevés, avec jusqu’à 7,9 % de chevauchement pour certaines références ; OpenImages et TextCaps étaient les références les plus touchées dans l’ensemble ; et Flickr30k a montré la fuite la plus faible.

Bien que de tels chevauchements puissent ne représenter qu’une petite partie des ensembles de référence, les auteurs notent que leur présence peut permettre la mémorisation et compromettre la validité des tests :

Exemples d’images fuies. À gauche, des cas de ‘fuite dure’, où les images sont identiques dans un jeu de données (en haut) ou entre les jeux de données (en bas) ; à droite, des cas de ‘fuite douce’, où les images sont visuellement quasi-identiques.

Effet sur l’évaluation en aval

Le document examine ensuite comment la fuite de données affecte les évaluations en aval (c’est-à-dire les performances sur des tâches standard lorsque des modèles préformés sont testés sur des références qui contiennent des données de formation dupliquées).

Trois tâches ont été considérées : classification à zéro tir ; classification supervisée ; et récupération d’image-texte.

Pour chaque tâche, les performances du modèle ont été évaluées sur un jeu de données de référence pour lequel des échantillons fuies avaient déjà été identifiés dans les données de préformation. Les résultats ont été comparés à travers quatre sous-ensembles : l’ensemble de référence complet ; un sous-ensemble d’échantillons fuies ; un sous-ensemble d’échantillons non fuies ; et un sous-ensemble sélectionné aléatoirement de la même taille que le groupe fuie (utilisé comme contrôle).

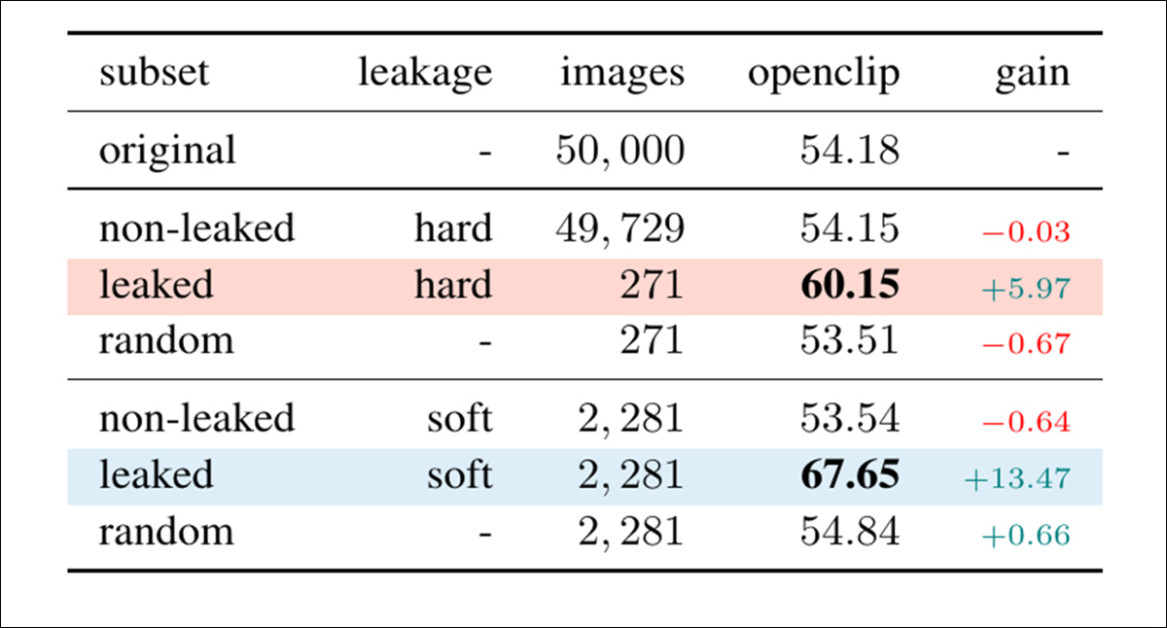

L’effet de la fuite de données sur trois tâches en aval a été mesuré en utilisant des sous-ensembles de référence connus pour contenir des images fuies. Dans la classification à zéro tir, un modèle préformé sur LAION a atteint une précision nettement plus élevée sur les images fuies de l’ensemble d’évaluation d’ImageNet, confirmant que l’exposition à des quasi-doublons pendant la formation fournit un avantage mesurable :

Précision de classification à zéro tir sur l’ensemble de validation d’ImageNet à travers des sous-ensembles avec et sans fuite. La dernière colonne rapporte les gains de précision relatifs à l’ensemble complet, et les lignes mises en évidence correspondent aux sous-ensembles fuies.

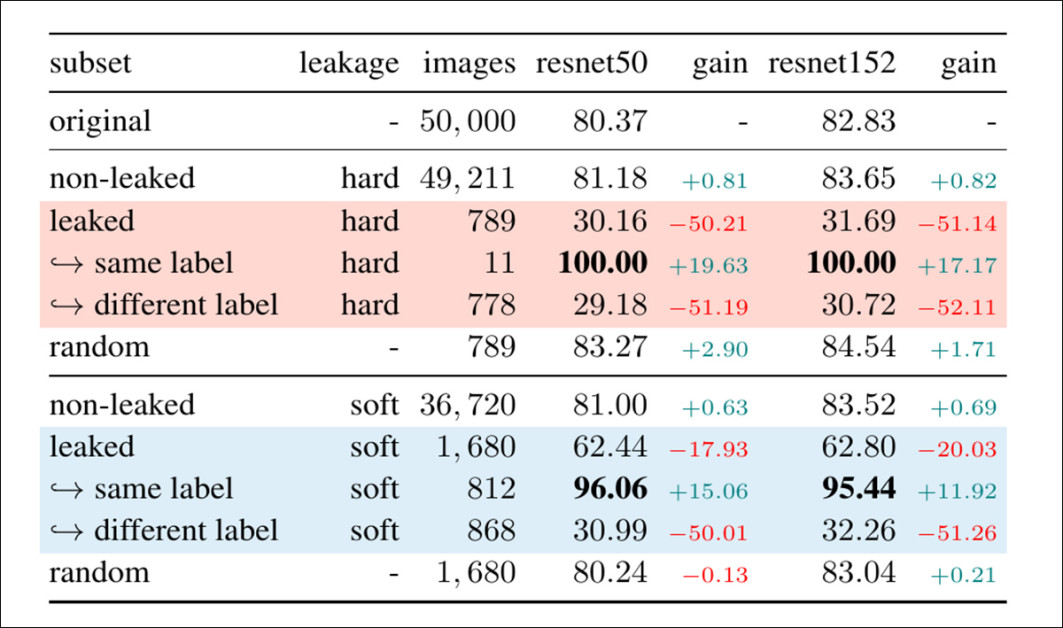

Pour la classification supervisée, la fuite dans ImageNet a entraîné une baisse spectaculaire des performances – à moins que l’image fuie ait la même étiquette dans les deux divisions, auquel cas le modèle a atteint une précision quasi parfaite, révélant un effet de mémorisation fort :

Précision de classification supervisée sur l’ensemble de validation d’ImageNet pour des sous-ensembles avec et sans fuite. Les colonnes de gain montrent le changement relatif à l’ensemble complet. Les sous-ensembles fuies sont mis en évidence.

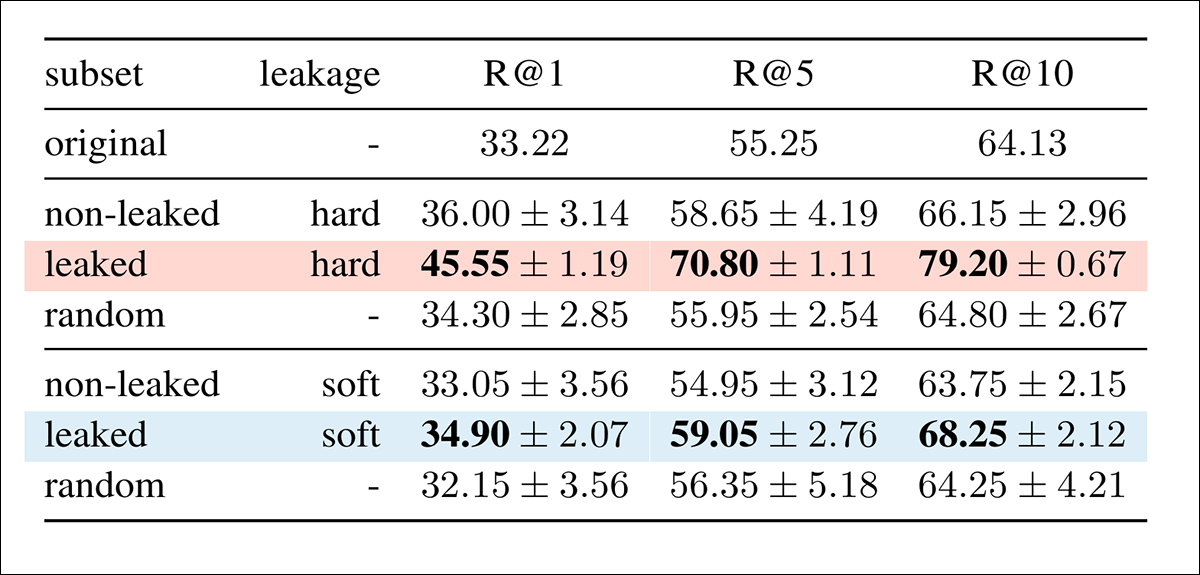

Dans la récupération d’image-texte, les performances ont à nouveau augmenté pour les échantillons fuies, avec à la fois la fuite dure et douce conduisant à un rappel plus élevé, et les sous-ensembles fuies produisant également des résultats plus cohérents entre les exécutions :

Performances de récupération d’image-texte sur Flickr30k à travers des sous-ensembles avec et sans fuite, avec les sous-ensembles fuies mis en évidence.