Santé

Reconnaître le stress des employés grâce à l’analyse faciale sur le lieu de travail

Dans le contexte de la culture changeante autour de l’étiquette des réunions Zoom, et de l’émergence de la fatigue Zoom, des chercheurs de Cambridge ont publié une étude qui utilise l’apprentissage automatique pour déterminer nos niveaux de stress via la couverture de webcam AI activée de nos expressions faciales sur le lieu de travail.

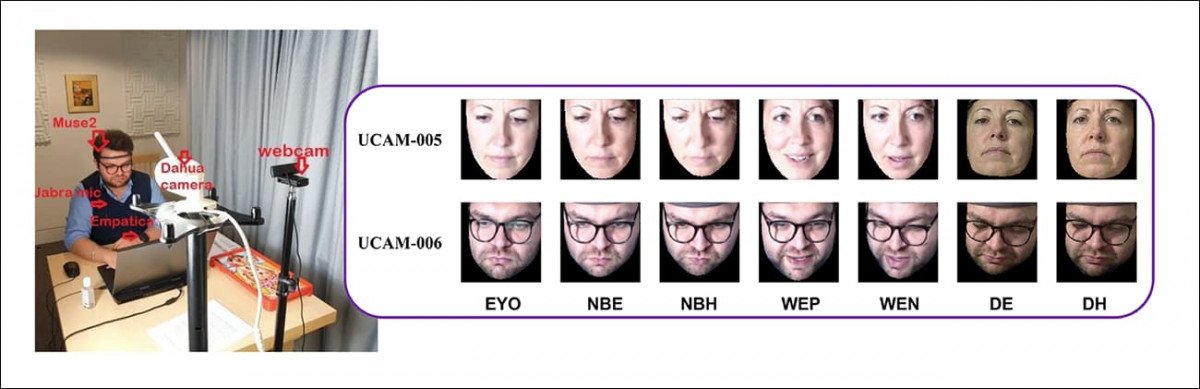

À gauche, l’environnement de collecte de données, avec plusieurs équipements de surveillance soit formés sur soit attachés à un volontaire ; à droite, exemples d’expressions faciales générées par les sujets de test à différents niveaux de difficulté de tâche. Source : https://arxiv.org/pdf/2111.11862.pdf

La recherche est destinée à l’analyse des affects (c’est-à-dire, la reconnaissance des émotions) dans les systèmes de « vie assistée ambiante » et est probablement conçue pour permettre des cadres de surveillance d’expression faciale basés sur la vidéo dans de tels systèmes ; bien que l’article ne développe pas cet aspect, l’effort de recherche n’a de sens que dans ce contexte.

Le domaine spécifique du projet est d’apprendre les modèles d’expression faciale dans les environnements de travail – y compris les dispositions de travail à distance – plutôt que des situations « de loisirs » ou « passives », telles que les voyages.

Reconnaissance des émotions basée sur le visage sur le lieu de travail

Alors que « la vie assistée ambiante » peut ressembler à un schéma de soins pour les personnes âgées, ce n’est pas le cas. En parlant des « utilisateurs finals » visés, les auteurs déclarent* :

‘Les systèmes créés pour les environnements de vie assistée ambiante [†] visent à être capables de réaliser à la fois l’analyse automatique des affects et la réponse. La vie assistée ambiante repose sur l’utilisation des technologies de l’information et de la communication (TIC) pour aider les personnes dans leur environnement de vie et de travail quotidien pour les maintenir en meilleure santé et les rendre plus actifs plus longtemps, et leur permettre de vivre de manière indépendante alors qu’ils vieillissent. Ainsi, la vie assistée ambiante vise à faciliter les travailleurs de la santé, les infirmières, les médecins, les travailleurs d’usine, les conducteurs, les pilotes, les enseignants ainsi que diverses industries via la détection, l’évaluation et l’intervention.

‘Le système est destiné à déterminer la contrainte physique, émotionnelle et mentale et à répondre et à s’adapter au besoin, par exemple, une voiture équipée d’un système de détection de somnolence peut informer le conducteur d’être attentif et lui suggérer de prendre une petite pause pour éviter les accidents [††].’

L’article intitulé Inferring User Facial Affect in Work-like Settings provient de trois chercheurs du laboratoire d’intelligence affective et de robotique de Cambridge.

Conditions de test

Puisque les travaux antérieurs dans ce domaine ont dépendu largement de collections ad hoc d’images collectées sur Internet, les chercheurs de Cambridge ont mené des expériences de collecte de données locales avec 12 volontaires du campus, 5 hommes et 7 femmes. Les volontaires venaient de neuf pays et avaient entre 22 et 41 ans.

Le projet visait à recréer trois environnements de travail potentiellement stressants : un bureau ; une ligne de production d’usine ; et une conférence téléphonique – comme le type d’appel de groupe Zoom qui est devenu une caractéristique fréquente du travail à domicile depuis l’avènement de la pandémie.

Les sujets ont été surveillés par divers moyens, notamment trois caméras, un microphone Jabra porté au cou, un bracelet Empatica (un dispositif portable sans fil offrant une rétroaction biologique en temps réel), et un capteur de bandeau Muse 2 (qui offre également une rétroaction biologique). De plus, les volontaires ont été invités à remplir des enquêtes et à évaluer leur humeur périodiquement.

Cependant, cela ne signifie pas que les futurs systèmes de vie assistée ambiante vous « brancheront » à ce point (si ce n’est pour des raisons de coût) ; tous les équipements et méthodes de surveillance non caméra utilisés dans la collecte de données, y compris les auto-évaluations écrites, sont destinés à vérifier les systèmes de reconnaissance d’expression faciale basés sur le visage activés par les images de la caméra.

Augmentation de la pression : le scénario du bureau

Dans les deux premiers des trois scénarios (‘Bureau’ et ‘Usine’), les volontaires ont commencé à un rythme facile, avec la pression augmentant progressivement sur quatre phases, avec différents types de tâches pour chacune.

Au niveau de stress le plus élevé, les volontaires ont également dû subir l’« effet du blanc » de quelqu’un qui les regardait par-dessus l’épaule, plus 85 décibels de bruit supplémentaire, ce qui est juste cinq décibels en dessous de la limite légale pour un environnement de bureau aux États-Unis, et la limite maximale spécifiée par le National Institute for Occupational Safety and Health (NIOSH).

Dans la phase de collecte de données similaire à un bureau, les sujets ont été chargés de se souvenir des lettres précédentes qui clignotaient sur leur écran, avec des niveaux de difficulté croissants (comme devoir se souvenir de séquences de deux lettres qui se sont produites deux écrans plus tôt).

Le scénario de l’usine

Pour simuler un environnement de travail manuel, les sujets ont été invités à jouer au jeu Operation, qui défie la dextérité de l’utilisateur en exigeant que le joueur retire de petits objets d’un plateau à travers de petites ouvertures à bord métallique sans toucher les côtés, ce qui déclenche un buzzer « d’échec ».

Lorsque la phase la plus difficile est arrivée, le volontaire a été mis au défi de retirer les 12 objets sans erreur en une minute. Pour contexte, le record du monde pour cette tâche, établi au Royaume-Uni en 2019, se situe à 12,68 secondes.

Le scénario de la téléconférence

Enfin, dans le test de travail à domicile/téléconférence, les volontaires ont été invités par un expérimentateur sur un appel MS Teams à rappeler leurs propres souvenirs positifs et négatifs. Pour la phase la plus stressante de ce scénario, le volontaire a été invité à rappeler un souvenir très négatif ou triste de son passé récent.

Les différentes tâches et scénarios ont été exécutés dans un ordre aléatoire et compilés dans un ensemble de données personnalisé intitulé Working-Environment-Context-Aware Dataset (WECARE-DB).

Méthode et formation

Les résultats des auto-évaluations des humeurs des utilisateurs ont été utilisés comme vérité de base et cartographiés sur les dimensions de valence et d’excitation. Les vidéos capturées des expériences ont été passées à travers un réseau de détection de points de repère faciaux network, et les images alignées ont été alimentées dans un réseau ResNet-18 formé sur l’ensemble de données AffectNet.

450 000 images d’AffectNet, toutes tirées/étiquetées d’Internet à l’aide de requêtes liées aux émotions, ont été annotées manuellement, indique l’article, avec des dimensions de valence et d’excitation.

Ensuite, les chercheurs ont affiné le réseau uniquement sur leur propre ensemble de données WECARE, tandis que l’encodage de représentation spectral a été utilisé pour résumer les prédictions basées sur les trames.

Résultats

Les performances du modèle ont été évaluées sur trois métriques couramment associées à la prédiction automatique des affects : Coefficient de corrélation Concordance ; Coefficient de corrélation de Pearson ; et Erreur quadratique moyenne (RMSE).

Les auteurs notent que le modèle affiné sur leur propre ensemble de données WECARE a surpassé ResNet-18 et en déduisent que la façon dont nous régulons nos expressions faciales est très différente dans un environnement de travail que dans les contextes plus abstraits à partir desquels les études antérieures ont dérivé du matériel source d’Internet.

Ils déclarent :

‘En regardant le tableau, nous observons que le modèle affiné sur WECARE-DB a surpassé le modèle ResNet-18 pré-formé sur [AffectNet], indiquant que les comportements faciaux affichés dans les environnements de travail sont différents par rapport aux paramètres Internet sauvages utilisés dans la base de données AffectNet. Ainsi, il est nécessaire d’acquérir des ensembles de données et de former des modèles pour reconnaître les affects faciaux dans les environnements de travail.’

En ce qui concerne l’avenir de la reconnaissance des affects sur le lieu de travail, activée par des réseaux de caméras formées sur les employés et faisant constamment des prédictions de leurs états émotionnels, les auteurs concluent* :

‘L’objectif ultime est de mettre en œuvre et d’utiliser les modèles formés en temps réel et dans des environnements de travail réels pour fournir des entrées aux systèmes de soutien à la décision pour promouvoir la santé et le bien-être des personnes pendant leur âge de travail dans le contexte du projet âge de travail de l’UE.’

* Mon accent.

† Ici, les auteurs font trois citations :

Reconnaissance automatique, dimensionnelle et continue des émotions – https://ibug.doc.ic.ac.uk/media/uploads/documents/GunesPantic_IJSE_2010_camera.pdf

Exploration du domaine de la vie assistée ambiante : une revue systématique – https://link.springer.com/article/10.1007/s12652-016-0374-3

Une revue des technologies de l’Internet des objets pour les environnements de vie assistée ambiante – https://mdpi-res.com/d_attachment/futureinternet/futureinternet-11-00259/article_deploy/futureinternet-11-00259-v2.pdf

†† Ici, les auteurs font deux citations :

Détection en temps réel de la somnolence du conducteur pour un système intégré à l’aide de la compression de modèles de réseaux de neurones profonds – https://openaccess.thecvf.com/content_cvpr_2017_workshops/w4/papers/Reddy_Real-Time_Driver_Drowsiness_CVPR_2017_paper.pdf

Système de détection de somnolence du conducteur en temps réel à l’aide de caractéristiques faciales – https://www.semanticscholar.org/paper/Real-Time-Driver-Drowsiness-Detection-System-Using-Deng-Wu/1f4b0094c9e70bf7aa287234e0fdb4c764a5c532