Intelligence artificielle

Non, ils n’étaient pas en train de ralentir Claude – C’était en fait pire

D’accord, parlons de ce qui se passe avec Claude, car si vous l’avez utilisé au cours du dernier mois, vous avez probablement remarqué que quelque chose n’allait pas.

Pendant six semaines, les utilisateurs de Claude ont perdu la tête. À partir du début du mois d’août, les plaintes ont inondé Reddit, X, et les forums de développeurs. Les problèmes étaient partout :

- Le code qui fonctionnait parfaitement était soudainement cassé

- Claude prétendait avoir apporté des modifications à des fichiers alors qu’il ne l’avait pas fait

- Des caractères thaïs ou chinois aléatoires apparaissant dans les réponses en anglais

- Les instructions étaient complètement ignorées

- La même invite donnant des réponses de qualité très différentes

- Les utilisateurs de Claude Code disaient qu’il ressemblait à un “lobotomisé” par rapport à avant

Les plaintes sont devenues si graves qu’à la fin du mois d’août, les gens étaient convaincus qu’Anthropic ralentissait secrètement Claude pour économiser de l’argent. Les théories du complot étaient partout – peut-être qu’ils réduisaient la qualité pendant les heures de pointe, peut-être qu’ils avaient discrètement remplacé par un modèle moins cher, peut-être que c’était une dégradation intentionnelle pour gérer les coûts de serveur.

Les utilisateurs payaient pour Claude Pro et obtenaient ce qui ressemblait à Claude Lite. Les développeurs qui avaient construit des flux de travail autour de Claude voyaient soudainement leur productivité chuter. Cela étant dit, certains utilisateurs n’ont rencontré aucun problème, ce qui rendait tout plus confus.

Anthropic admet enfin : Oui, nous avions des problèmes

Après des semaines de plaintes des utilisateurs et de frustration croissante, Anthropic vient de publier un énorme post-mortem technique qui dit essentiellement : “Vous aviez raison. Claude était cassé. Voici ce qui s’est passé.”

Et la réponse est intéressante.

Il s’est avéré que ce n’était pas un problème. Il y avait trois bogues d’infrastructure complètement séparés, tous frappant en même temps, créant une tempête parfaite de dégradation de l’IA. Ils ne ralentissaient pas. Ils ne coupaient pas dans les coins. Ils avaient simplement trois choses cassées simultanément de manière à ce qu’il leur faille six semaines pour les comprendre et les corriger.

Laissez-moi détailler exactement ce qui s’est passé, car c’est en fait un regard utile sur la façon dont ces systèmes d’IA peuvent échouer de manière que personne n’anticipe.

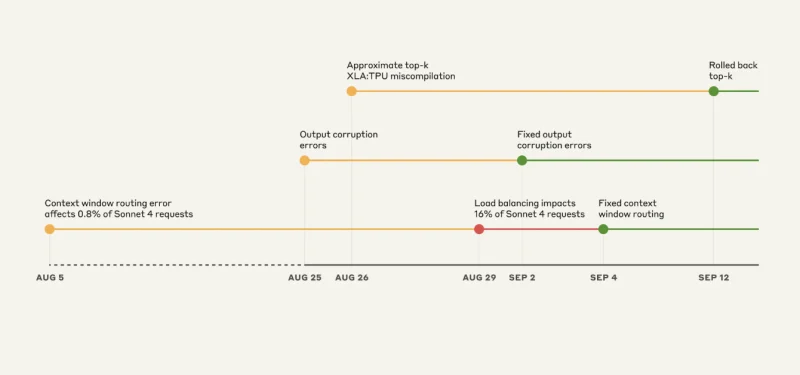

La triple erreur : Une chronologie du chaos

Source : Anthropic

Bogue #1 : Le problème de serveur incorrect

C’est presque drôle si vous n’étiez pas celui qui l’a vécu. Claude Sonnet 4 était conçu pour gérer 200 000 contextes de jetons. Mais à partir du 5 août, certaines requêtes étaient acheminées vers des serveurs configurés pour 1 million de contextes de jetons.

Initialement, seulement 0,8 % des requêtes étaient affectées. Pas de problème, n’est-ce pas ? Mauvaise nouvelle.

Le 29 août, une mise à jour de routine du load balancer a transformé ce problème mineur en un problème majeur. Soudain, à son apogée, 16 % des requêtes Sonnet 4 étaient acheminées vers les mauvais serveurs. Et l’acheminement était “collant”. Une fois que vous étiez mal acheminé, vous restiez mal acheminé.

L’impact :

- Environ 30 % des utilisateurs de Claude Code qui étaient actifs pendant la période avaient au moins une requête mal acheminée

- Les temps de réponse ont chuté pour les utilisateurs affectés

- Le même utilisateur a connu le problème à plusieurs reprises tandis que d’autres n’ont eu aucun problème

Bogue #2 : Le générateur de caractères aléatoires

Le 25 août, Anthropic a déployé une mauvaise configuration sur ses serveurs TPU. Le résultat était que Claude a commencé à insérer aléatoirement des caractères thaïs et chinois dans les réponses en anglais.

Imaginez demander à Claude de déboguer votre code Python et obtenir ceci :

def calculate_total(items):

total = 0

for item in items:

總計 += item.price# <- Qu'est-ce que c'est ?

return ผลรวม

Cela a affecté :

- Opus 4.1 et Opus 4 : 25-28 août

- Sonnet 4 : 25 août – 2 septembre

La cause technique était une erreur de génération de jeton qui a attribué une probabilité élevée à des caractères qui n’avaient rien à faire là. Cela a littéralement cassé le mécanisme fondamental de la façon dont Claude sélectionne le mot suivant à dire.

Bogue #3 : Le bogue de compilateur invisible

C’est le plus effrayant du point de vue de l’ingénierie. Il y avait un bogue latent dans le compilateur XLA de Google qui était resté inactif. Lorsqu’Anthropic a déployé du code pour améliorer la sélection de jetons le 25 août, ils ont accidentellement déclenché cela.

Ce que ce bogue faisait était vraiment bizarre – il faisait que Claude excluait involontairement le jeton le plus probable lors de la génération de texte. Claude connaissait la bonne réponse mais était physiquement empêché de la dire.

La partie vraiment dérangée ? Ils avaient déjà contourné ce bogue en décembre 2024 sans s’en rendre compte. Lorsqu’ils ont “corrigé” ce qu’ils pensaient être la cause racine en août, ils ont supprimé le contournement et déclenché le véritable problème.

Pourquoi cela a pris six semaines pour être corrigé

Vous vous demandez peut-être : comment une entreprise comme Anthropic, avec des ingénieurs de classe mondiale, peut mettre six semaines pour le diagnostiquer ?

La réponse révèle à quel point ces systèmes sont vraiment complexes :

1. Les contrôles de confidentialité ont bloqué le débogage

“Nos contrôles internes de confidentialité et de sécurité limitent la façon et le moment où les ingénieurs peuvent accéder aux interactions des utilisateurs avec Claude, en particulier lorsque ces interactions ne sont pas signalées à nous comme des commentaires.”

Ils ne pouvaient littéralement pas voir ce qui se cassait à moins que les utilisateurs ne le signalent explicitement avec des commentaires. Bon pour la confidentialité, terrible pour le débogage.

2. Les bogues se cachaient

Claude se rétablissait souvent d’erreurs individuelles, faisant que la dégradation ressemblait à une variance normale plutôt qu’à une défaillance systématique. Leurs benchmarks et évaluations ne le détectaient pas car le modèle se corrigait juste assez pour passer les tests.

3. Chaos multi-plateforme

Claude s’exécute sur AWS Trainium, NVIDIA GPUs, et Google TPUs – trois plateformes matérielles complètement différentes. Chaque bogue se manifestait différemment sur chaque plateforme :

- AWS Bedrock : 0,18 % des requêtes Sonnet 4 affectées à l’apogée

- Google Vertex AI : en dessous de 0,0004 % affectées

- API directe : jusqu’à 16 % affectées

Cela faisait qu’il ressemblait à des problèmes non liés plutôt qu’à trois bogues spécifiques.

4. Symptômes chevauchants

Avec trois bogues actifs simultanément, les symptômes étaient partout. Un utilisateur pourrait obtenir des caractères thaïs, un autre pourrait obtenir des réponses dégradées, un troisième pourrait voir des performances parfaites. Il n’y avait aucun modèle clair à suivre.

Ce que cela signifie vraiment pour la fiabilité de l’IA

Cette saga révèle quelque chose de crucial sur l’état actuel des systèmes d’IA : ils sont beaucoup plus fragiles qu’ils n’y paraissent.

Nous ne parlons pas seulement du modèle d’IA lui-même. Nous parlons de :

- L’infrastructure d’acheminement qui peut envoyer des requêtes à la mauvaise place

- Les implémentations spécifiques au matériel qui se comportent différemment

- Les bogues de compilateur qui peuvent rester latents pendant des mois

- Les load balancers qui peuvent amplifier les problèmes mineurs en pannes majeures

Un mauvais paramétrage, un bogue de compilateur, une erreur d’acheminement – et soudainement votre assistant d’IA oublie comment coder ou commence à parler des langues qu’il ne devrait pas.

Est-ce vraiment corrigé ?

Anthropic affirme avoir résolu les trois problèmes au 16 septembre. Ils ont :

- Corrigé la logique d’acheminement

- Rétabli les configurations problématiques

- Passé des opérations top-k approximatives à des opérations exactes (en prenant un coup de performance pour la précision)

- Ajouté une surveillance continue en production

Mais les utilisateurs signalent toujours des problèmes. Certains développeurs affirment que Claude Code ressemble encore à une version dégradée par rapport à ses performances antérieures. Que ce soit :

- Des effets résiduels des bogues

- De nouveaux problèmes qui n’ont pas été identifiés

- Un biais psychologique après des semaines de problèmes

- Ou une dégradation réelle continue

…nous ne le savons pas encore.

Le point clé

Cette situation est une étude de cas parfaite sur la façon dont les systèmes d’IA complexes peuvent échouer de manière complètement inattendue. Trois bogues distincts, tous déclenchés dans les semaines les uns après les autres, ont créé une perception d’une dégradation massive de la qualité qui a pris six semaines à diagnostiquer et à corriger.

Nous pouvons donner un peu de crédit à Anthropic pour la transparence. Publier un post-mortem technique détaillé est plus que ce que la plupart des entreprises feraient. Mais cela montre également à quel point les choses peuvent mal tourner sous le capot de ces systèmes sur lesquels nous nous appuyons de plus en plus.

Pour quiconque construit sur Claude ou tout LLM : vous avez besoin de redondance, de validation et de plans de secours. Parce que comme nous venons de le voir, même les meilleurs systèmes d’IA peuvent avoir trois problèmes différents simultanément, et cela peut prendre des semaines avant que quelqu’un découvre ce qui se passe vraiment.

L’infrastructure qui soutient ces modèles d’IA est tout aussi importante que les modèles eux-mêmes. Et en ce moment, cette infrastructure montre des douleurs de croissance sérieuses.