Intelligence Artificielle

NeRF fait un pas de plus vers le remplacement de CGI

Des chercheurs du MIT et de Google ont fait un grand pas en avant pour résoudre l'un des obstacles les plus fondamentaux à une technologie émergente basée sur l'IA qui pourrait éventuellement remplacer CGI - séparer l'imagerie du champ de rayonnement neuronal (NeRF) en ses composants visuels constitutifs, afin que l'imagerie puisse être re-texturé et rallumé.

La nouvelle approche, appelée NeRFactorComment, divise efficacement les images capturées en normales par objet (sur lesquelles des textures peuvent être attribuées), visibilité de la lumière, albédo (la proportion de lumière incidente réfléchie par une surface) et fonctions de distribution de réflectance bidirectionnelle (BRDF).

Avec ces facettes isolées, il est possible non seulement de changer de texture pour des objets individuels ou des groupes d'objets, mais également d'ajouter des sources d'éclairage et des implémentations d'ombres nouvelles et uniques, en excluant celles qui ont été capturées par les réseaux multi-caméras qui génèrent des entrées pour l'imagerie NeRF.

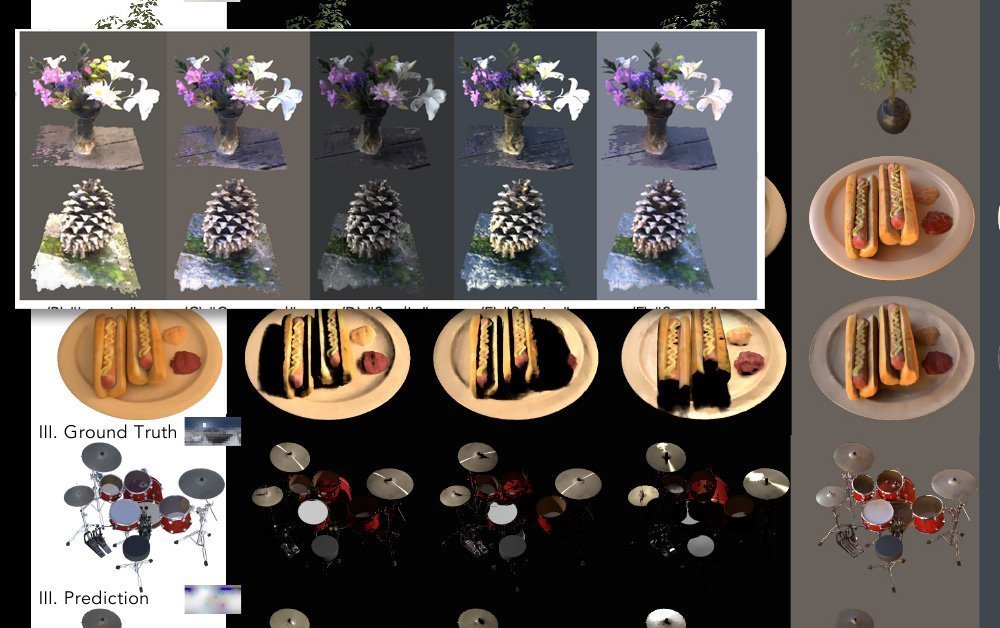

Normales, visibilité, albédo et BRDF séparés sous NeRFactor. Source : https://www.youtube.com/watch?v=UUVSPJlwhPg

Le modèle prend en charge les ombres douces ou dures provenant de sources d'éclairage arbitraires définies par l'utilisateur et sépare les quatre aspects de la vidéo capturée par programme, en utilisant une perte de reconstruction, des données provenant de calculs précédents de BRDF et une régularisation simple de base du lissage.

Flux de travail de NeRFactor, extrayant séparément des facettes exploitables d'images dérivées de réseaux de caméras multiples. Source : https://arxiv.org/pdf/2106.01970.pdf

NeRFactor utilise une sonde de lumière HDR, une approche bien établie qui a imprégné la scène visuelle industrielle et artistique depuis sa création. introduction en 1998, pour évaluer les trajets possibles des rayons, ce qui permet un éclairage arbitraire. Étant donné que cela génère un nombre incontrôlable de paramètres possibles, la sonde lumineuse est filtrée à travers un perceptron multicouche (MLP), qui mappe la géométrie perçue à la sonde sans tenter de calculer une carte complète du volume d'éclairage pour l'espace modèle.

Deux modèles de champ de rayonnement neuronal sont utilisés pour démontrer cinq modèles d'éclairage possibles sous NeRFactor. Cliquez sur l'image pour une résolution supérieure.

Motif de réflexion

La nouvelle recherche est peut-être la plus importante dans la séparation des couches d'images capturées qui contrôlent la réflexion. Cela reste l'un des plus grands défis pour l'imagerie du champ de rayonnement neuronal, car un système NeRF vraiment nouveau et flexible devra non seulement être capable de remplacer les textures, mais aura surtout besoin d'un moyen de refléter les objets en mouvement (en plus de l'environnement fixe général) qui seraient normalement pris en compte dans un workflow CGI.

Ce problème a été récemment signalé en ce qui concerne Intel nouvelle recherche impressionnante pour transformer des séquences de jeux vidéo en vidéos photoréalistes via des réseaux de neurones convolutifs. Dans de tels workflows, de nombreux aspects « préparés » du matériau source devraient être distincts et interchangeables, ce qui est sans doute plus facile à résoudre pour le rééclairage (qui dépend de la géométrie rendue dans NeRF) que pour les réflexions (qui utilisent une géométrie « hors écran », totalement hors du champ du modèle).

Par conséquent, l'isolation des couches dans la vidéo NeRF qui facilitent la réflexion rapproche NeRF de la résolution de son « défi de réflexion ».

L'utilisation d'un environnement HDR résout déjà le problème de la génération de reflets de l'environnement mondial (c'est-à-dire les cieux, les paysages et autres facteurs ambiants « fixes »), mais de nouvelles approches seront nécessaires pour introduire des reflets mobiles et dynamiques.

Photogrammétrie avec NeRF

L’imagerie Neural Radiance Field utilise l’analyse de l’apprentissage automatique pour développer un espace entièrement volumétrique à partir d’une scène ou d’un objet capturé sous plusieurs angles.

Différents systèmes basés sur NeRF, apparus l'année dernière, ont utilisé un nombre varié de caméras contributives ; certains utilisent 16 caméras ou plus, d'autres une ou deux seulement. Dans tous les cas, les points de vue intermédiaires sont « remplis » (c'est-à-dire interprétés) afin de permettre une navigation fluide dans la scène ou l'objet.

L'entité résultante est un espace complètement volumétrique, avec une compréhension 3D intrinsèque qui peut être exploitée de plusieurs façons, y compris la capacité de générer des maillages CG traditionnels à partir de la somme analysée en 3D des images d'entrée.

NeRF dans le contexte d'un « nouveau CGI »

L'imagerie du champ de rayonnement neuronal est tiré Directement à partir d'images du monde réel, y compris des images animées de personnes, d'objets et de scènes. En revanche, une méthodologie CGI « étudie » et interprète le monde, nécessitant des professionnels qualifiés pour créer des maillages, des structures et des textures exploitant des images du monde réel (captures faciales et environnementales). Il s'agit d'une approche essentiellement interprétative et artisanale, coûteuse et laborieuse.

De plus, CGI a rencontré des problèmes récurrents avec l'effet « vallée de l'étrange » dans ses efforts pour recréer des ressemblances humaines, ce qui ne présente aucune contrainte à une approche pilotée par NeRF, qui capture simplement des vidéos ou des images de personnes réelles et les manipule.

De plus, NeRF peut générer une géométrie de maillage de style CGI traditionnel directement à partir de photos si nécessaire, et en fait supplanter de nombreuses procédures manuelles qui ont toujours été nécessaires dans l'imagerie générée par ordinateur.

Défis pour NeRF

Cette dernière recherche du MIT et de Google s'inscrit dans le contexte d'un véritable flot d'articles NeRF au cours de l'année dernière, dont beaucoup ont proposé des solutions aux divers défis lancés par l'article initial de 2020.

En avril, l'innovation d'un consortium de recherche chinois a permis de isoler discrètement les chronologies individuelles des facettes d'une scène NeRF, y compris les personnes.

La recherche chinoise permet aux utilisateurs finaux de copier, coller et redimensionner les éléments capturés, en les dissociant de la chronologie linéaire de la vidéo source d'origine. Source : https://www.youtube.com/watch?v=Wp4HfOwFGP4

Cette approche permet non seulement de réimaginer la scène sous n'importe quel angle capturé par le réseau de caméras (et pas seulement la vue unique représentée dans une capture vidéo typique), mais permet également une composition polyvalente - et même la possibilité de représenter deux facettes du même des images qui s'exécutent dans leurs propres délais (ou même à l'envers, si nécessaire).

La recherche chinoise permet aux utilisateurs finaux de copier, coller et redimensionner les éléments capturés, en les dissociant de la chronologie linéaire de la vidéo source d'origine. Source : https://www.youtube.com/watch?v=Wp4HfOwFGP4

L'un des plus grands défis pour NeRF est de réduire les ressources considérables nécessaires pour former une scène, et cela a été abordé dans un certain nombre d'articles récents. Par exemple, l'Institut Max Planck pour les systèmes intelligents a récemment introduit KiloNeRF, qui non seulement accélère les temps de rendu par un facteur de 1000, mais permet même à NeRF de fonctionner de manière interactive.

KiloNeRF exécutant un environnement interactif à 50 ips sur une GTX 1080ti. Source : https://github.com/creiser/kilonerf

Cependant, l'innovation de vitesse NeRF qui a vraiment captivé l'imagination des chercheurs et du public en 2021 a été la PlenOctrees collaboration, dirigée par UC Berkeley, qui offre un rendu en temps réel des champs de rayonnement neuronal :

L'effet des capacités interactives de PlenOctrees a été reproduit dans un interface Web en direct.

Mouvement interactif en direct d'un objet PlenOctrees dans Firefox (le mouvement est plus fluide et plus dynamique que ce que représente ce GIF). Source : http://alexyu.net/plenoctrees/demo/

En outre, NeRF récursif (extrait d'un article de mai 2021 rédigé par des chercheurs de l'Université Tsinghua) offre un rendu récursif de haute qualité à la demande. Au lieu d'obliger l'utilisateur à restituer des scènes entières, y compris des parties non visibles, Recursive-NeRF offre une compression similaire à celle du JPEG et peut générer des sous-NeRF discrets pour gérer des images supplémentaires à la demande, ce qui permet d'importantes économies de ressources de calcul.

Conserver les détails tout en supprimant les calculs de rendu inutiles avec Recursive-NeRF. Cliquez sur l'image pour une résolution supérieure. Source : https://arxiv.org/pdf/2105.09103.pdf

D'autres approches incluent FastNeRF, qui prétend obtenir un rendu neuronal haute fidélité à 200 ips.

Il a été noté que de nombreuses techniques d’optimisation pour NeRF impliquent « cuire » la scène, en s'engageant sur des aspects que l'on souhaite rendre et en écartant d'autres facettes, ce qui limite l'exploration mais accélère grandement l'interactivité.

L'inconvénient est que la contrainte se déplace du GPU vers le stockage, car les scènes cuites occupent une quantité démesurée d'espace disque ; dans une certaine mesure, cela peut être atténué en sous-échantillonnant les données cuites, bien que cela implique également un certain engagement, en termes de fermeture de voies d'exploration ou d'interactivité.

En ce qui concerne la capture de mouvement et le rigging, une nouvelle approche des universités de Zheijang et Cornell, révélé en mai, a proposé une méthode pour recréer des humains animables à l'aide de champs de poids de mélange et de structures de squelette interprétées à partir de la vidéo d'entrée :

Structure squelettique dérivée dans Animatable NeRF. Source : https://www.youtube.com/watch?v=eWOSWbmfJo4

Quand NeRF aura-t-il son moment « Jurassic Park » ?

Malgré les progrès rapides de la synthèse d'images par champs de rayonnement neuronal, ce n'est qu'à cette époque que sera établie une quelconque « loi de la thermodynamique » quant à la capacité de déploiement du NeRF. Si l'on se base sur une chronologie analogue à celle de l'imagerie de synthèse, le NeRF oscille actuellement autour de 1973, juste avant la la première utilisation de CGI dans Westworld.

Cela ne signifie pas que NeRF devra nécessairement attendre neuf ans pour son équivalent Colère de Khan étape importante, ou des décennies pour les percées similaires que CGI a réalisées sous le patronage enthousiaste de James Cameron en 1989 The Abyss ou 1991 Terminator 2 – et puis, la technologie est vraiment révolutionnaire moment d'évasion en 1993 Jurassic Park.

Le monde de l'imagerie a beaucoup changé depuis la longue période de stagnation des effets visuels photochimiques, qui ont dominé la production cinématographique et télévisuelle depuis la naissance du cinéma jusqu'au début des années 1990. L'avènement de la révolution du PC et l'accélération de la loi de Moore ont conduit à la révolution CGI, qui aurait pu autrement avoir lieu dès les années 1960.

Il reste à voir s'il existe une barrière si implacable qu'elle pourrait retarder les progrès de NeRF pendant aussi longtemps - et si les innovations ultérieures en matière de vision par ordinateur ne pourraient pas entre-temps dépasser entièrement NeRF en tant que principal prétendant à la couronne de CGI, caractérisant les champs de rayonnement neuronal comme la « machine à fax » de courte durée de la synthèse d'images neuronales.

Jusqu'à présent, NeRF n'a pas été utilisé dans un contexte en dehors de la recherche universitaire ; mais il est à noter que des acteurs majeurs tels que Google Research et de nombreux laboratoires de recherche en vision par ordinateur parmi les plus importants sont en compétition pour la dernière avancée de NeRF.

La plupart des plus gros obstacles rencontrés par NeRF ont commencé à être directement abordés cette année ; si les recherches ultérieures offrent une solution au « problème de réflexion », et si les nombreux volets de la recherche d'optimisation de NeRF se fondent dans une solution décisive aux exigences considérables de traitement et/ou de stockage de la technologie, NeRF a vraiment une chance de devenir « le nouveau CGI » dans les cinq prochaines années.