Intelligence artificielle

NeRF : Entraînement de drones dans des environnements de radiance neurale

Les chercheurs de l’Université de Stanford ont conçu une nouvelle méthode pour entraîner des drones à naviguer dans des environnements photoréalistes et très précis, en exploitant l’intérêt récent pour les Champs de Radiance Neurale (NeRF).

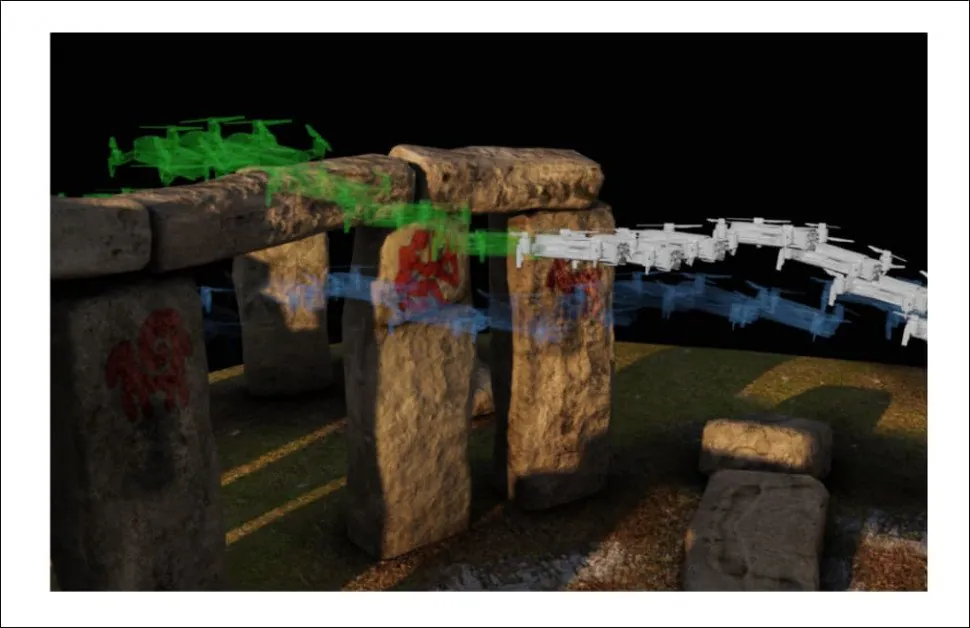

Les drones peuvent être entraînés dans des environnements virtuels cartographiés directement à partir de lieux réels, sans nécessité de reconstruction de scène 3D spécialisée. Dans cette image du projet, une perturbation du vent a été ajoutée comme obstacle potentiel pour le drone, et nous pouvons voir le drone être momentanément dévié de sa trajectoire et compenser à la dernière minute pour éviter un obstacle potentiel. Source : https://mikh3x4.github.io/nerf-navigation/

La méthode offre la possibilité d’un entraînement interactif de drones (ou d’autres types d’objets) dans des scénarios virtuels qui incluent automatiquement des informations de volume (pour calculer l’évitement de collision), des textures tirées directement de photos réelles (pour aider à entraîner les réseaux de reconnaissance d’images des drones de manière plus réaliste) et des éclairages du monde réel (pour s’assurer que divers scénarios d’éclairage sont intégrés au réseau, en évitant la sur-ajustement ou la sur-optimisation de la capture d’origine de la scène).

Un objet-canapé navigue dans un environnement virtuel complexe qui aurait été très difficile à cartographier en utilisant la capture de géométrie et la retexuration dans les flux de travail traditionnels AR/VR, mais qui a été recréé automatiquement dans NeRF à partir d’un nombre limité de photos. Source : https://www.youtube.com/watch?v=5JjWpv9BaaE

Les implémentations typiques de NeRF ne disposent pas de mécanismes de trajectoire, puisque la plupart des projets NeRF au cours des 18 derniers mois se sont concentrés sur d’autres défis, tels que la relighting de scène, le rendu de réflexion, la compositing et la disjonction des éléments capturés.

NeRF en tant que VR/AR

Le nouveau document s’intitule Vision-Only Robot Navigation in a Neural Radiance World, et est une collaboration entre trois départements de Stanford : Aéronautique et Astronautique, Génie mécanique et Informatique.

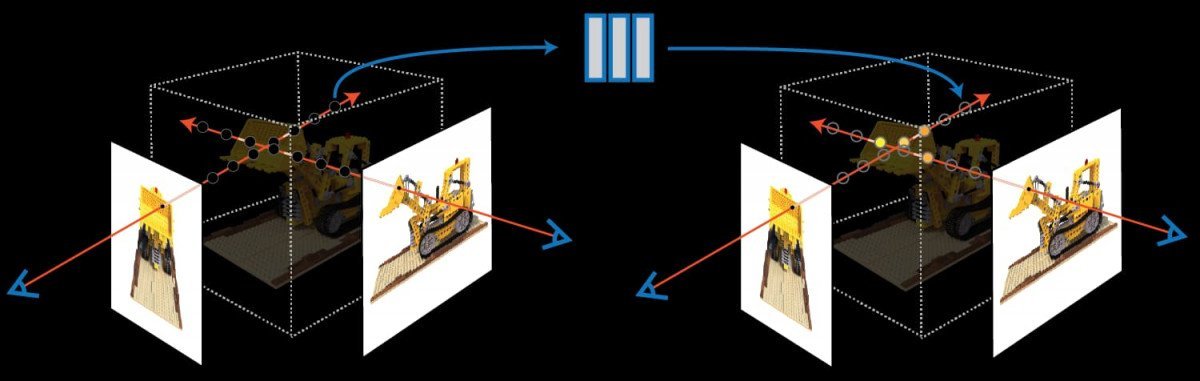

Le travail propose un cadre de navigation qui fournit à un robot un environnement NeRF pré-entraîné, dont la densité de volume délimite les chemins possibles pour l’appareil. Il comprend également un filtre pour estimer où se trouve le robot à l’intérieur de l’environnement virtuel, en fonction de la reconnaissance d’images de la caméra RGB embarquée du robot. De cette façon, un drone ou un robot peut « halluciner » plus précisément ce qu’il peut s’attendre à voir dans un environnement donné.

L’optimiseur de trajectoire du projet navigue à travers un modèle NeRF de Stonehenge généré par photogrammétrie et interprétation d’images (dans ce cas, de modèles de maillage) dans un environnement de radiance neurale. L’optimiseur de trajectoire calcule un certain nombre de chemins possibles avant d’établir une trajectoire optimale sur l’arc.

Puisque l’environnement NeRF comporte des occultations entièrement modélisées, le drone peut apprendre à calculer les obstructions plus facilement, puisque le réseau neuronal derrière NeRF peut cartographier la relation entre les occultations et la façon dont les systèmes de navigation basés sur la vision embarquée du drone perçoivent l’environnement. Le pipeline de génération automatique de NeRF offre une méthode relativement triviale pour créer des espaces d’entraînement hyper-réalistes avec seulement quelques photos.

Le cadre de replanification en ligne développé pour le projet Stanford facilite un pipeline de navigation entièrement basé sur la vision et résilient.

L’initiative de Stanford est l’une des premières à considérer les possibilités d’explorer un espace NeRF dans le contexte d’un environnement de réalité virtuelle (VR) navigable et immersif. Les champs de radiance neurale sont une technologie émergente, et font actuellement l’objet d’efforts académiques pour optimiser leurs besoins en ressources de calcul élevées, ainsi que pour disjoindre les éléments capturés.

NeRF n’est pas (vraiment) CGI

Puisque l’environnement NeRF est un espace 3D navigable, il est devenu une technologie mal comprise depuis son émergence en 2020, souvent perçue à tort comme une méthode d’automatisation de la création de maillages et de textures, plutôt que de remplacer les environnements 3D familiers aux téléspectateurs des départements d’effets visuels d’Hollywood et des scènes fantastiques des environnements de réalité virtuelle et augmentée.

NeRF extrait des informations de géométrie et de texture à partir d’un nombre limité de points de vue d’image, en calculant la différence entre les images comme informations volumétriques. Source : https://www.matthewtancik.com/nerf

En fait, l’environnement NeRF est plus comme un espace de rendu « en direct », où une combinaison d’informations de pixel et d’éclairage est conservée et naviguée dans un réseau neuronal actif et en cours d’exécution.

La clé du potentiel de NeRF est qu’il n’a besoin que d’un nombre limité d’images pour recréer des environnements, et que les environnements générés contiennent toutes les informations nécessaires pour une reconstruction à haute fidélité, sans nécessité de services de modeleurs, d’artistes de texture, de spécialistes de l’éclairage et des hordes d’autres contributeurs aux « CGI traditionnels ».

Segmentation sémantique

Même si NeRF constitue effectivement de l’imagerie générée par ordinateur (CGI), il offre une méthodologie entièrement différente, et un pipeline hautement automatisé. De plus, NeRF peut isoler et « encapsuler » les parties mobiles d’une scène, de sorte qu’elles puissent être ajoutées, supprimées, accélérées et fonctionner généralement comme des facettes distinctes dans un environnement virtuel – une capacité qui va bien au-delà de l’état actuel de l’art dans une interprétation « hollywoodienne » de ce que CGI est.

Une collaboration de l’Université de technologie de Shanghai, publiée en été 2021, propose une méthode pour individualiser les éléments NeRF mobiles en facettes « collables » pour une scène. Source : https://www.youtube.com/watch?v=Wp4HfOwFGP4

Négativement, l’architecture de NeRF est un peu une « boîte noire » ; il n’est pas actuellement possible d’extraire un objet d’un environnement NeRF et de le manipuler directement avec des outils traditionnels basés sur des maillages et des images, bien qu’un certain nombre d’efforts de recherche commencent à faire des percées dans la déconstruction de la matrice derrière les environnements de rendu en direct de NeRF.