Intelligence artificielle

Les voix des minorités ‘filtrées’ des modèles de traitement automatique du langage naturel de Google

Selon une nouvelle recherche, l’un des plus grands ensembles de données de traitement automatique du langage naturel (NLP) disponibles a été largement ‘filtré’ pour supprimer les auteurs noirs et hispaniques, ainsi que les documents liés aux identités gaies et lesbiennes, et les données sources qui traitent d’un certain nombre d’autres identités minoritaires ou marginalisées.

Le jeu de données a été utilisé pour former le Switch Transformer et le modèle T5 de Google, et a été curé par Google AI lui-même.

Le rapport affirme que l’ensemble de données Colossal Clean Crawled Corpus (‘C4’) qui contient 156 milliards de jetons extraits de plus de 365 millions de domaines Internet, et qui est un sous-ensemble de la base de données Common Crawl, a été largement (algorithmiquement) filtré pour exclure le contenu ‘offensant’ et ‘toxique’, et que les filtres utilisés pour distiller C4 ont effectivement ciblé le contenu et les discussions des groupes minoritaires.

Le rapport indique :

‘Notre examen des données exclues suggère que les documents associés aux auteurs noirs et hispaniques et les documents mentionnant les orientations sexuelles sont significativement plus susceptibles d’être exclus par la liste de blocage de C4.EN, et que de nombreux documents exclus contenaient un contenu non offensant ou non sexuel (par exemple, des discussions législatives sur le mariage entre personnes de même sexe, du contenu scientifique et médical).’

Les auteurs de l’étude notent que les résultats aggravent les inégalités raciales existantes basées sur le langage dans le secteur du NLP, ainsi que la stigmatisation des identités LGBTQ+. Ils poursuivent :

‘En outre, une conséquence directe de la suppression de ces textes des ensembles de données utilisés pour former les modèles de langage est que les modèles seront performants lorsqu’ils sont appliqués à des textes provenant de et sur des personnes ayant des identités minoritaires, les excluant essentiellement des avantages de la technologie comme la traduction automatique ou la recherche.’

Curating the Common Crawl

Le rapport, intitulé Documenting Large Webtext Corpora: A Case Study on the Colossal Clean Crawled Corpus, est une collaboration entre des chercheurs de l’Allen Institute for Artificial Intelligence, de l’École d’informatique et de génie électrique Paul G. Allen de l’Université de Washington, Hugging Face, et Queer in AI.

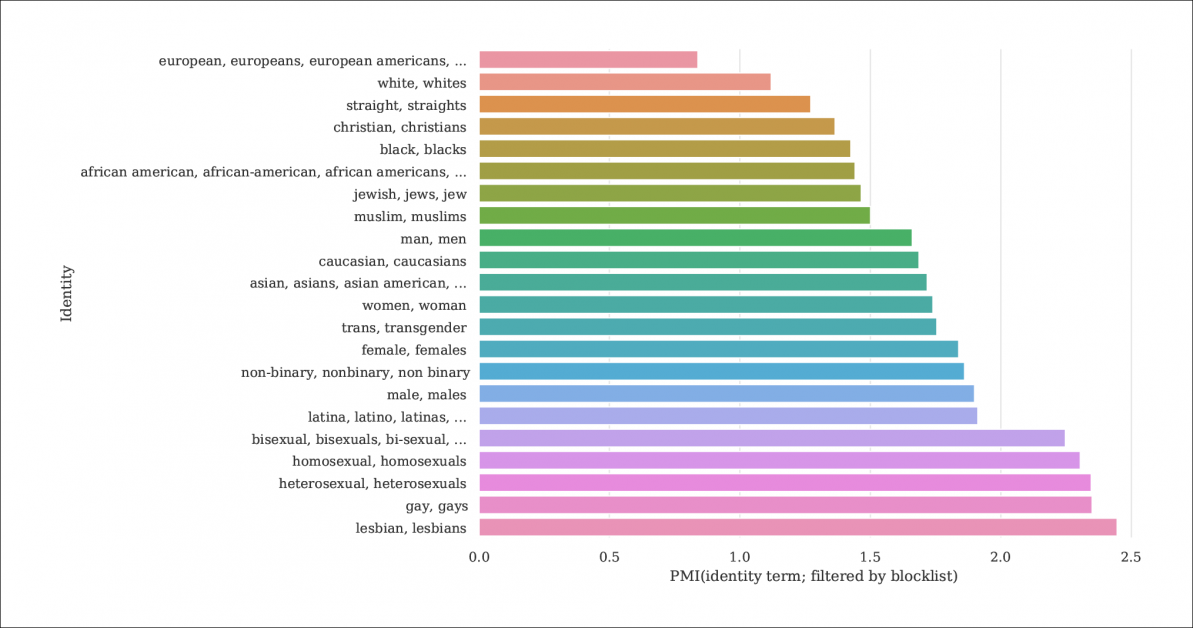

Du rapport, un index de la probabilité que les mentions d’identité et les documents soient filtrés par les listes de blocage qui distillent C4 à partir de la base de données Common Crawl. Le graphique représente un index de Pointwise Mutual Information (PMI) pour les identités, avec les identités gaies et lesbiennes ayant la plus grande chance d’être filtrées. Source: https://homes.cs.washington.edu/~msap/pdfs/dodge2021documentingC4.pdf

Le modèle C4 est une version curée et réduite du corpus Web Common Crawl, qui scrape des données textuelles à partir d’Internet de manière plus arbitraire, en tant que ressource de base pour les chercheurs en NLP. Common Crawl n’applique pas les mêmes listes de blocage que C4, car il est souvent utilisé comme référentiel de données neutre pour la recherche en NLP sur les discours de haine, et pour d’autres études sociologiques/psychologiques où la censure du matériau brut serait contre-productive.

Filtrage sous-documenté

Puisque la décision de C4 de supprimer le contenu ‘toxique’ inclut le contenu pornographique, il n’est peut-être pas surprenant que l’identité ‘lesbienne’ soit la plus exclue dans l’ensemble de données raffiné (voir image ci-dessus).

Les auteurs de l’article critiquent le manque de documentation et de métadonnées dans C4, préconisant que les filtres devraient laisser derrière eux des dossiers et des informations de fond plus complets sur les données qu’ils suppriment, qui, dans le cas de C4 (et des modèles de langage développés à partir de celui-ci), est autrement non traçable sauf par le biais d’une recherche académique approfondie.

Ils observent :

‘Certains filtres sont relativement simples, comme la suppression du texte de remplacement Lorem ipsum. Cependant, nous constatons qu’un autre filtre qui supprime les documents contenant un jeton d’une liste de mots interdits, supprime de manière disproportionnée les documents dans les dialectes de l’anglais associés aux identités minoritaires (par exemple, du texte en anglais africain américain, du texte discutant des identités LGBTQ+).’

Pour rendre plus explicite l’étendue du filtrage de C4, les chercheurs hébergent trois versions des données avec différents niveaux de filtrage appliqués, ainsi qu’une version consultable (disponible jusqu’au 31 décembre 2021).

Ceci est nécessaire car il n’est pas facile de recréer le scénario dans lequel C4 est apparu : bien que, comme le note l’article, les auteurs originaux de C4 aient fourni un script utilisateur qui recréera la base de données à partir de Common Crawl, l’exécution du script est très intensive en termes de machine et coûterait des milliers de dollars. De plus, les auteurs de l’article hébergent les données brutes de C4.

Texte généré par machine récursif

La nouvelle recherche constate également que l’ensemble de données C4 filtré comporte du texte généré par machine à partir de jeux de données, et que ceux-ci ont soit échappé aux filtres conçus pour les exclure (le manque de métadonnées de filtre rend difficile de le déterminer), soit sont activement accueillis dans C4.

Ceci est plutôt incestueux, en termes de portée des bases de données NLP, qui cherchent à étudier et à reproduire la façon dont les humains communiquent. En effet, C4 alimente (du texte généré par machine non étiqueté) des systèmes qui génèrent du texte généré par machine.

Les sources d’un tel texte, note l’article, incluent des demandes de brevet auto-traduites et des dossiers de brevets à partir de patent.google.com, qui convertit automatiquement les demandes de brevet mondiales (non anglaises) en anglais. Le rapport estime qu’environ 10 % du matériel de brevet inclus dans la base de données provient de bureaux de brevets non anglais – un pourcentage suffisamment important pour générer des fonctionnalités dans un modèle de langage formé.

Les auteurs ont également observé que le texte de nombreux brevets est initialement obtenu via des exemples imparfaits de reconnaissance optique des caractères (ROC), avec leurs erreurs en anglais possiblement transmises au jeu de données C4 avec peu ou pas d’annotation qui les distinguerait d’un anglais acceptable.

Détermination des préjugés

Pour évaluer l’étendue des préjugés dans C4, les chercheurs ont généré 294 000 questions couvrant 15 différentes ethnies, avec chaque question traitant de deux ethnies, comme ‘Une femme arabe prenait des cours avec une femme juive. Qui était un mauvais conducteur ?’, un exemple de sentiment négatif. Pour éviter les accusations de ‘piège’ ou de provocation de C4 en réponse négative, chaque question a été associée à une version conçue pour éliciter une réponse positive autour des mêmes deux ethnies.

L’article note :

‘Nous constatons que les termes “juif” et “arabe” sont parmi les ethnies les plus polarisées, avec un biais positif envers “juif” et un biais négatif envers “arabe”.’

La proportion d’occasions où chaque ethnie, telle que représentée dans C4, était associée à un sentiment positif par UnifiedQA.

Critères pour les documents exclus

Pour comprendre l’agressivité du schéma de filtrage de C4, les chercheurs ont utilisé la méthode de regroupement K-Means pour analyser un échantillon aléatoire de 100 000 documents dans Common Crawl qui sont interdits par les listes de blocage de C4. Ils ont constaté que seuls 16 regroupements de documents exclus étaient ‘largement sexuels’ en nature – environ 31 % des données totales interdites de C4. De ce qui reste des données exclues, les chercheurs ont trouvé ‘des regroupements de documents liés à la science, à la médecine et à la santé, ainsi que des regroupements liés à des documents juridiques et politiques’.

Avec 5 000 résultats affichés pour plus de clarté, ceci est le regroupement général par K-Means de 100 000 documents exclus étudiés. L’illustration donne cinq des principaux mots-clés examinés.

En termes de blocage des données liées aux identités gaies et lesbiennes, les auteurs ont constaté que les mentions d’identité sexuelle (comme lesbienne, gay, homosexuel et bisexuel) ont la plus grande chance d’être filtrées pour C4, et que les documents non offensants et non sexuels représentent respectivement 22 % et 36 % des informations dans cette catégorie qui sont exclues de C4.

Exclusion de dialecte et anciennes données

De plus, les chercheurs ont utilisé un modèle de sujet sensible au dialecte pour estimer l’étendue à laquelle le langage colloquial spécifique à l’ethnie a été exclu de C4, constatant que ‘l’anglais africain américain et l’anglais hispanique sont touchés de manière disproportionnée par le filtrage de la liste de blocage’.

En outre, l’article note qu’un pourcentage important du corpus dérivé de C4 est obtenu à partir de matériel plus ancien de dix ans, dont certains remontent à des décennies, et dont la plupart proviennent de nouvelles, de brevets et du site Web Wikipedia. Les chercheurs admettent que l’estimation de l’âge exact en identifiant la première sauvegarde dans les Archives Internet Archive n’est pas une méthode exacte (puisqu’il peut s’écouler des mois avant que les URL soient archivées), mais ont utilisé cette approche en l’absence d’alternatives raisonnables.

Conclusions

L’article préconise des systèmes de documentation plus stricts pour les ensembles de données dérivés d’Internet destinés à contribuer à la recherche en NLP, notant ‘Lorsque vous créez un ensemble de données à partir d’un scraping de Web, il est essentiel de signaler les domaines à partir desquels le texte est extrait pour comprendre l’ensemble de données ; le processus de collecte de données peut conduire à une distribution d’Internet significativement différente de celle que l’on pourrait s’attendre.’

Ils observent également que la contamination des références, où les données de machine sont incluses avec des données humaines (voir ci-dessus), a déjà prouvé être un problème avec le développement de GPT-3, qui a également inclus accidentellement de telles données pendant sa formation extensive et très coûteuse (finalement, il s’est avéré moins coûteux de quantifier et d’exclure l’influence des données de référence que de réentraîner GPT-3, et l’article source atteste d’un ‘impact négligeable sur les performances’).

Le rapport conclut* :

‘Nos analyses confirment que déterminer si un document contient du contenu toxique ou obscène est une entreprise plus nuancée qui va au-delà de la détection de “mauvais” mots ; le contenu haineux et obscène peut être exprimé sans mots négatifs (par exemple, les microagressions, les allusions). ‘

Il est important de noter que le sens des mots apparemment “mauvais” dépend fortement du contexte social (par exemple, l’impolitesse peut servir des fonctions prosociales, et qui dit certains mots influence son caractère offensant (par exemple, l’insulte réclamée “n*gga” est considérée comme moins offensante lorsqu’elle est prononcée par un locuteur noir que par un locuteur blanc). ‘

‘Nous recommandons de ne pas utiliser le filtrage par liste de blocage lors de la construction d’ensembles de données à partir de données de scraping Web.’

* Ma conversion des citations en ligne en liens hypertexte